The post Eine Kurzanleitung zur Adressstandardisierung und -überprüfung appeared first on Data Ladder.

]]>Unter Adressstandardisierung versteht man den Prozess der Aktualisierung und Implementierung eines Standards oder Formats für Ihre Adressdaten.

Schlechte Adressdaten sind ein komplexes Problem der Datenqualität, das sich auf Kunden, Unternehmen und sogar den Versanddienstleister auswirkt. Die überwältigende Menge an unzureichenden Adressdaten hat es für Unternehmen zur Pflicht gemacht, in robuste Adressstandardisierungs- und Verifizierungstools zu investieren, die ihnen helfen, einfach und mühelos von USPS geprüfte Adressen zu erhalten.

Lesen Sie weiter, wir helfen Ihnen beim Verstehen:

- Die Kosten für schlechte Daten

- Die Probleme mit Adressdaten

- Ursachen für schlechte Datenqualität

- Wie standardisieren Sie Ihre Adresse?

- Was ist die CASS-Adressstandardisierung?

- Wie wird eine Adresse validiert?

- Wie überprüft man eine Adresse bei USPS?

- Datenabgleich – die größte Herausforderung für die Adressstandardisierung und -überprüfung

- Eine Fallstudie – E-Ideas Limited

- Geschäftsstrategien zur Verbesserung Ihrer Adressdaten

Tauchen wir gleich ein!

Die Kosten für schlechte Adressdaten

Jedes Jahr werden Millionen von Dollars aufgrund schlechter Adressdaten verschwendet. Der USPS berichtet, dass allein im Jahr 2016 fast 6,6 Milliarden Sendungen unzustellbar waren. Die Versender geben über 20 Milliarden Dollar für UAA-Sendungen aus, während die direkten Kosten für den USPS über 1,5 Milliarden Dollar pro Jahr betragen. All diese unnötigen Kosten sind einfach darauf zurückzuführen, dass die Unternehmen keinen Zugang zu den richtigen Adressdaten haben.

Wenn Sie allein diese vorläufigen Kosten ausrechnen, geben Sie wahrscheinlich $$$$ allein für die Verwaltung der Rücksendekosten aus – ganz zu schweigen von den Betriebskosten für die Überprüfung der Kundeninformationen und den erneuten Versand des Pakets.

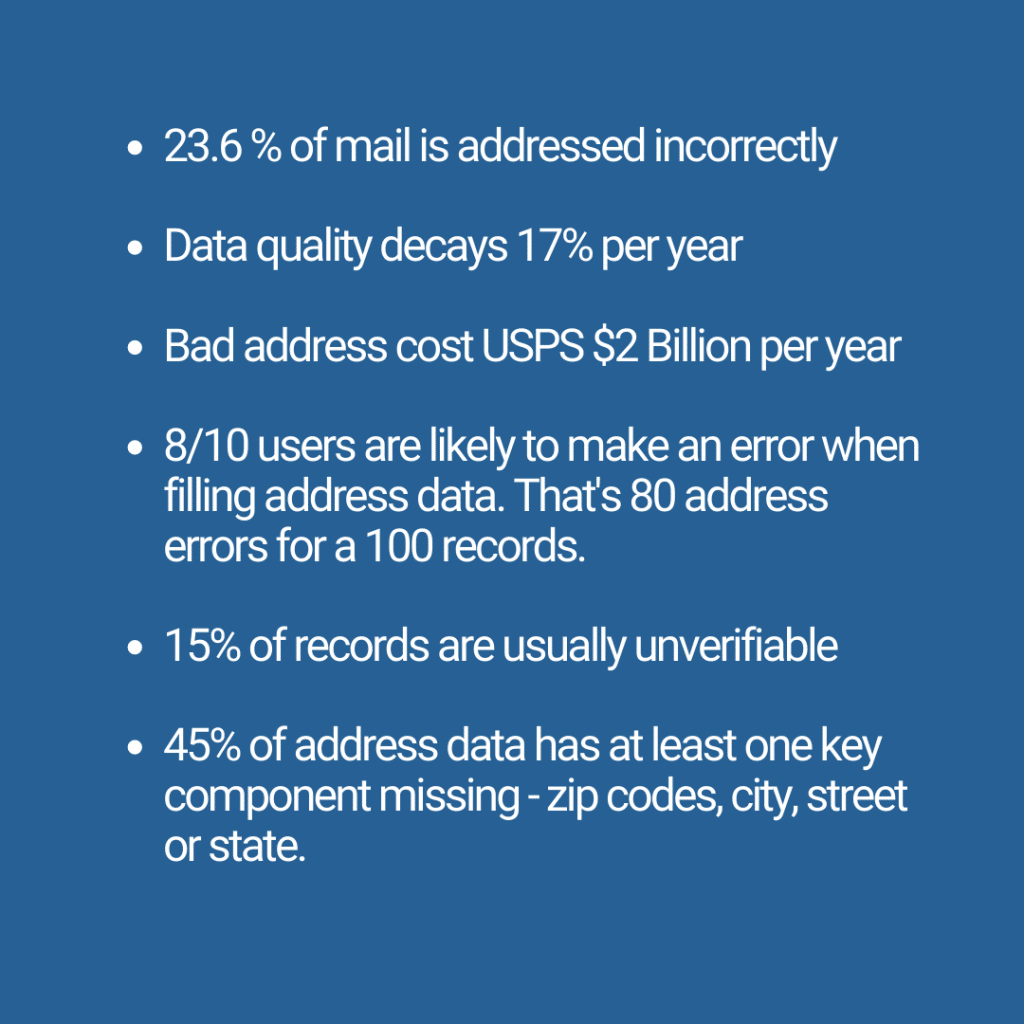

Einige Zahlen zum Nachdenken:

Die Probleme mit Adressdaten

Es liegt in der menschlichen Natur, Fehler zu machen. Meistens sind die Verbraucher nachlässig, wenn es darum geht, ihre Adressdaten in physischen oder Webformularen anzugeben. Sie können den Namen eines Bundeslandes falsch schreiben, Abkürzungen verwenden, eine Hausnummer vergessen oder ihre Postleitzahl vergessen. Es ist unvermeidlich, dass einige Fehler gemacht werden und falsche Daten eingegeben werden.

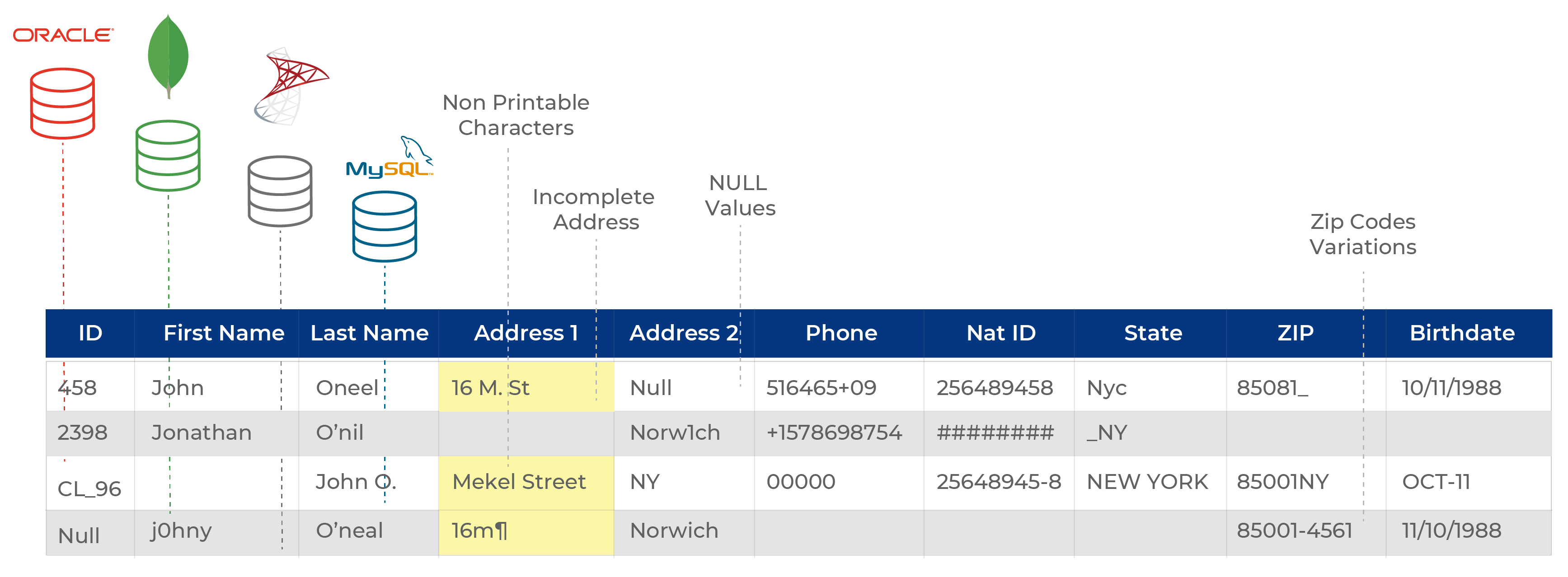

Das folgende Bild zeigt, wie typische unstrukturierte Adressrohdaten aussehen. Unzureichende Adressdaten sind eine Herausforderung, die für Unternehmen und deren Mitarbeiter eine große Belastung darstellt. Stellen Sie sich vor, Sie müssten diese grundlegenden Probleme für jede Mailing-Kampagne, jede Werbeaktion und jeden Kundenbericht, den Sie erstellen müssen, lösen. Es ist nicht nur wahnsinnig frustrierend, sondern auch kontraproduktiv, wenn man versucht, jede Adresse abzugleichen und zu überprüfen, um sicherzustellen, dass sie korrekt und vollständig ist. Datenwissenschaftler und Analysten oder Geschäftsanwender, die diese Daten benötigen, müssen Tage und Monate damit verbringen, diese Probleme zu beheben.

Bei Adressdaten werden häufig Probleme festgestellt:

- Unvollständige Informationen (fehlender Straßenname, Blocknummer, Postleitzahl)

- Ungültige Informationen (gefälschte Adressen und Postleitzahlen)

- Falsche Informationen (Tippfehler, falsch geschriebene Namen, schlechtes Format wie die Verwendung von Abkürzungen)

- ungenaue Informationen (ungenaue Wohnungs- oder Hausnummern)

All diese Probleme machen die Adressdaten zu einer der am schwierigsten zu bearbeitenden Datenquellen. Außerdem werden dadurch die Kosten für die Rücksendung von Postsendungen erheblich erhöht, und die Unternehmen können sich nicht mehr auf die Adressdaten verlassen, um wichtige Geschäftsentscheidungen zu treffen.

Die meisten dieser Probleme sind auf Eingabefehler der Benutzer und das Fehlen einer angemessenen Datenkontrolle zurückzuführen.

Manche Leute schreiben zum Beispiel nur die Postleitzahl, aber nicht die vollständige Adresse, manche vergessen einfach die Postleitzahl oder schreiben eine unvollständige Adresse. Manche geben eine gefälschte Adresse an. Was auch immer die Gründe für Datenfehler sind, eines ist sicher: Damit ein Unternehmen seine Daten nutzen kann, müssen diese sauber und gültig sein.

Strukturelle Fehler sind jedoch nur ein Teil des Problems mit schlechten Adressdaten. Andere Themen könnten sein:

- Adressdaten, die zwar gültig sind, aber nicht mehr existieren.

- Adresse, die zwar strukturell richtig ist, aber nicht dem Kunden gehört.

- Adresse, die nicht in der USPS-Datenbank vorhanden ist.

Wenn diese Informationen in der Eingangsphase nicht überprüft werden, wirkt sich dies auf die gesamte künftige Korrespondenz sowie auf die Beziehung zu diesem Kunden aus. Um dies zu korrigieren, müssen die Unternehmen jeden einzelnen Kunden anrufen, um die Daten zu aktualisieren oder die richtigen Informationen erneut einzuholen. Das Problem ist, dass die Unternehmen in der Regel nicht über genügend Ressourcen verfügen und diese Arbeitsweise nicht sehr praktikabel ist.

Letztendlich läuft es auf eines hinaus: Schlechte Daten sind unvermeidlich, aber sie können behoben werden. Es gibt zahlreiche Tools zur Adressstandardisierung, die Unternehmen dabei helfen, schlechte Daten zu korrigieren, indem sie Formatprobleme beheben und unordentliche Daten bereinigen. Der Prozess ist weniger zeitaufwändig, erfordert jedoch eine gewisse Lernkurve und ein grundlegendes Verständnis von Datenabgleich, Parsing und Deduplizierung.

Ursachen für fehlerhafte Adressdaten

Menschliche Fehler sind die Haupt-, aber nicht die einzige Ursache für schlechte Adressqualität. Abgesehen von den Herausforderungen, die eine genaue Datenerfassung mit sich bringt, gibt es noch viele weitere Ursachen, wie zum Beispiel:

Datenbank-Verfall:

Nach Angaben des Census Bureau wird ein typischer Amerikaner im Laufe seines Lebens 11,7 Mal umziehen. Da Wohnraum immer teurer wird und die Amerikaner versuchen, geeignete Wohngegenden zu finden, wird diese Zahl weiter steigen. Davon informieren nur 60 % der Umzugsunternehmen den USPS tatsächlich rechtzeitig über ihren Umzug.

Die Unternehmen sitzen also auf Adressdaten fest, die nicht aktualisiert werden. Wenn sie monatlich eine Million Rechnungen oder Werbebriefe verschicken, erhalten sie im selben Monat vielleicht 90.000 Umzugsmitteilungen. Schlimmer noch, nach diesem Prozentsatz werden 60.000 dieser Millionen Kunden dem USPS nicht rechtzeitig die richtigen Informationen zur Verfügung gestellt haben.

Unter der Annahme, dass dieselben Kunden immer noch bei der Organisation sind, muss das Unternehmen seine Datenbank ständig aktualisieren und sicherstellen, dass es die aktuellste Adresse verwendet.

Schlechte Datenkultur:

Erst in jüngster Zeit beginnen Unternehmen, sich mit dem Thema Datenorientierung zu befassen – aber das beschränkt sich auf die Führungsebene. Der Mitarbeiter an seinem Schreibtisch ist sich nicht bewusst, mit welchen Datenqualitätsproblemen er es zu tun hat. Außerdem gibt es keine Geschäftsregeln, die bei der Datenqualität einzuhalten sind. Es gibt keine Schulung oder Ausbildung für Mitarbeiter, um datenorientiert zu arbeiten, und es gibt absolut keine Investitionen in Datenmanagement-Tools wie DataMatch Enterprise, die die Lücke zwischen IT-Anwendungen und Geschäftsmanagement von Daten schließen können.

Fusionen und Übernahmen:

Wenn Unternehmen im Zuge von Fusionen und Übernahmen Daten migrieren, steigt die Wahrscheinlichkeit von Fehlern in der Datenqualität. Diese Fusionen gehen schnell vonstatten und die Probleme sind manchmal unvorhersehbar. Der Druck zur Konsolidierung nimmt zu, aber es gibt keine Kontrolle und kein Gleichgewicht in Bezug auf die Qualität – tatsächlich gibt es nur selten einen Rahmen für das Qualitätsmanagement.

Wie führen Sie die Adressstandardisierung durch?

Also, Definition hin oder her, wie kann man eigentlich Daten standardisieren?

Nun, es gibt zwei Möglichkeiten – die einfache und die harte Variante.

Auf die harte Tour müssen Sie diese Daten nach Excel übertragen und Formeln und Filter anwenden, um die Daten zu korrigieren. Glauben Sie nicht den Anleitungen, die Ihnen sagen, dass es „super-einfach“ ist, denn das ist es nie.

In diesem Artikel erfahren Sie, wie Sie Fehler in Excel beheben können. Sehen Sie, wie viel Zeit, Mühe und technisches Wissen Sie aufbringen müssen, um grundlegende Datenkorrekturen durchzuführen? Je komplexer die Probleme werden, desto länger dauert es. Wenn Sie mit Millionen von Datenzeilen zu tun haben, könnte die Datenbereinigung zu Ihrer ständigen Aufgabe werden.

Der einfache Weg?

Verwenden Sie eine Adressstandardisierungssoftware. Bevor Sie die Idee verwerfen, hier die Gründe dafür.

Die Software spart natürlich viel Zeit und Mühe, aber sie kann noch mehr.

Adressdatensätze sind keine einfachen Fehler. Wie im obigen Beispiel haben Sie Tausende von Zeilen, die Probleme aufweisen. Sie brauchen eine Lösung, mit der Sie all diese Probleme auf einen Schlag lösen können.

Wenn Sie eine Best-in-Class-Lösung verwenden, können Sie Daten standardisieren:

Bewertung von Fehlern durch Datenprofilierung: Stellen Sie sich vor, Sie könnten sich einen konsolidierten Überblick über alle Fehler in Ihren Adressdaten verschaffen. Sie können Spalten mit nicht druckbaren Zeichen oder Spalten mit negativen Leerzeichen oder sogar Spalten mit Buchstaben in Zahlenfeldern sehen. Mit der Datenprofilerstellung können Sie fundierte Korrekturen vornehmen . Wenn Sie nicht wissen, was falsch ist, tappen Sie bei den Korrekturen im Dunkeln.

Parsing von Adressen zur Lösung spezifischer Probleme: Ein Teil der Adressbereinigung erfordert, dass Sie verschiedene Teile von Adressen (Stadt, Bundesland, Postleitzahl usw.) analysieren oder aufschlüsseln und sie auf verschiedenen Ebenen fixieren. Mit DataMatch Enterprise können Sie zum Beispiel Postleitzahlen gezielt korrigieren und sicherstellen, dass sie den Postleitzahlen ZIP+4 oder ZIP+6 entsprechen.

Bereinigung von unordentlichen Daten: Bereinigen Sie Formatierungsprobleme, entfernen Sie negative Leerzeichen und nicht druckbare Zeichen in einem Durchgang. Sie müssen Ihre Adressdaten unbedingt bereinigen und gemäß den USPS-Richtlinien (siehe unten) standardisieren, bevor Sie sie überprüfen können.

Entfernen von Duplikaten mit Datenabgleich : Das Bereinigen unordentlicher Daten ist nur ein Teil der Aufgabe – der anstrengende Teil ist das Aussortieren von Duplikaten. Wenn Sie Tausende von Kundendaten haben, die seit langem nicht mehr sortiert wurden, ist die Wahrscheinlichkeit groß, dass es Duplikate gibt, und diese sind nicht immer exakt.

Werfen Sie einen Blick auf diese Tabelle:

Sehen Sie, dass für einen Kunden fünf verschiedene Adressen auf unterschiedliche Weise eingegeben wurden? Das lässt sich nicht so einfach sortieren, es sei denn, Sie verwenden ein leistungsfähiges Datenqualitätstool.

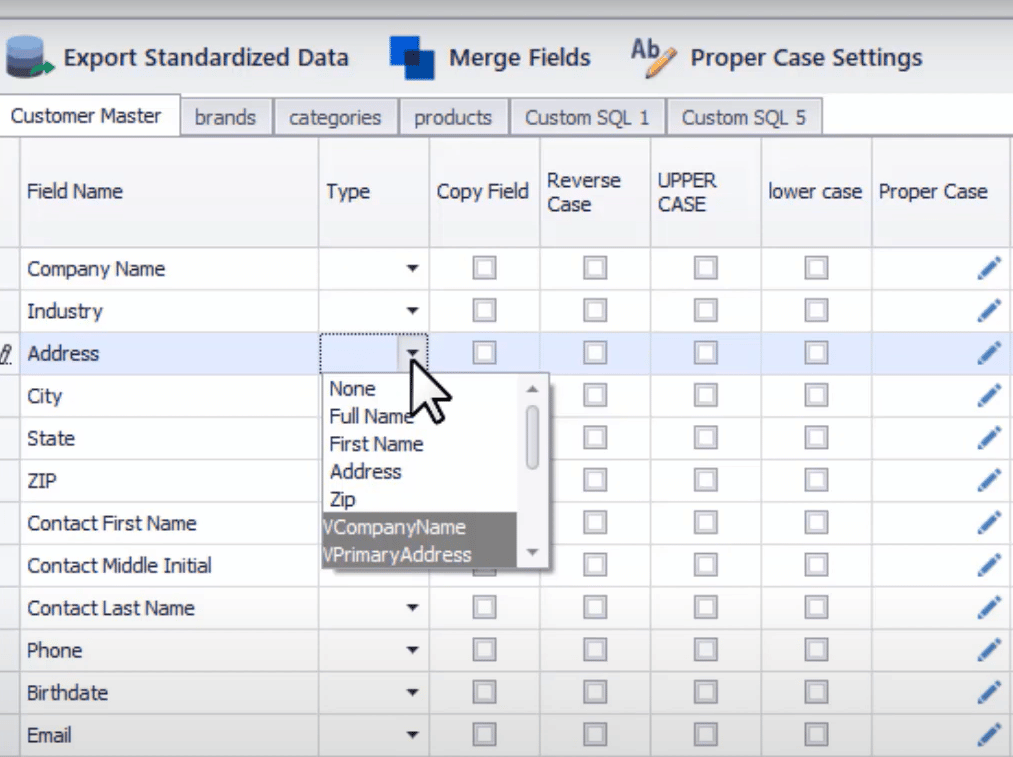

Datenübernahme und -export: Sie sollten in der Lage sein, einen Stammdatensatz zu erstellen und ihn als endgültige Liste an Ihr Team zu exportieren, ohne ihn kopieren/einfügen oder manuell in ein akzeptables Format laden zu müssen.

Datenübernahme und -export: Sie sollten in der Lage sein, einen Stammdatensatz zu erstellen und ihn als endgültige Liste an Ihr Team zu exportieren, ohne ihn kopieren/einfügen oder manuell in ein akzeptables Format laden zu müssen.

CASS-Adressstandardisierung: Jede Adressstandardisierungssoftware muss über die CASS-Adressstandardisierung verfügen. DataMatch Enterprise zum Beispiel ist eine CASS-zertifizierte Adressstandardisierungslösung mit einer CASS-Datenbank, die jeden Monat aktualisiert wird.

Was ist die CASS-Adressstandardisierung?

Software, die Adressen korrigiert oder abgleicht, muss vom USPS zertifiziert werden. Dies geschieht über das Coding Accuracy Support System (CASS), das der USPS zur Überprüfung der Genauigkeit der Software einsetzt. Eine CASS-Zertifizierung ist eine Lizenz für alle Software-Anbieter, die den USPS nutzen, um die Qualität ihrer Adressdaten zu bewerten und die Genauigkeit der ZIP+4- und fünfstelligen Kodierung zu verbessern.

Da der USPS seine Adressdaten regelmäßig aktualisiert, müssen Anbieter von CASS-zertifizierter Software ihre Zertifizierung jährlich beim USPS erneuern. Alle zertifizierten CASS-Produkte sind auf der Website des USPS aufgeführt.

Was ist die USPS-Standardisierungsrichtlinie?

Die Anbieter von Software zur Standardisierung von Adressdaten folgen der USPS-Standardisierungsrichtlinie, die vorschreibt, dass Adressen in einem Format wie folgt vorliegen müssen:

Hier sind die Regeln:

- Bringen Sie die Adresse und das Porto immer auf der gleichen Seite Ihres Poststücks an.

- Bei einem Brief sollte die Adresse parallel zur längsten Seite verlaufen.

- Alle Großbuchstaben.

- Keine Interpunktion.

- Mindestens 10-Punkt-Schrift.

- Ein Leerzeichen zwischen Stadt und Staat.

- Zwei Leerzeichen zwischen Staat und Postleitzahl.

- Einfache Schriftarten.

- Linksbündig.

- Schwarze Tinte auf weißem oder hellem Papier.

- Kein Rückseitendruck (weißer Druck auf schwarzem Hintergrund).

- Wenn Ihre Adresse innerhalb eines Fensters erscheint, stellen Sie sicher, dass um die Adresse herum mindestens 1/8-Zoll Platz ist. Manchmal verschwinden Teile der Adresse hinter dem Fenster und die Postbearbeitungsmaschinen können die Adresse nicht lesen.

- Wenn Sie Adressetiketten verwenden, achten Sie darauf, dass Sie keine wichtigen Informationen abschneiden. Achten Sie auch darauf, dass die Etiketten gerade angebracht sind. Postbearbeitungsmaschinen haben Schwierigkeiten, schiefe oder schräg stehende Informationen zu lesen.

Die Standardisierung von Adressen ist die Voraussetzung für eine effektive Adressprüfung. Sie müssen sicherstellen, dass Ihre Adresse den USPS-Richtlinien entspricht, bevor Ihre Daten mit dem USPS abgeglichen werden können.

Adressüberprüfung oder -validierung – Was ist der Unterschied?

Häufig werden die Begriffe „Validierung und Verifizierung“ vermischt, wenn es um Adressdaten geht. Der Unterschied ist eher kontextueller als lexikalischer Natur. Data Ladder verwendet den Begriff Adressverifizierung, um Adressen mit der USPS-Datenbank abzugleichen. Andere Organisationen überprüfen die Adressen anhand von Rechnungsunterlagen, Führerscheinen, Kontoauszügen usw. Das ist eine völlig andere Dienstleistung, die die meisten Unternehmen nicht brauchen.

Andere Anbieter verwenden die„Adressvalidierung“, um den gleichen Abgleich mit dem USPS vorzunehmen und die Kundendaten zu validieren. Im Rahmen dieses Leitfadens beschränken wir uns auf die Adressüberprüfung.

Adressstandardisierung und -überprüfung – Wie man Adressdaten mit dem USPS überprüft

Der Prozess der Adressüberprüfung ist einfach. Sie gleichen Ihre nun standardisierten Daten mit der staatlichen Datenbank oder einem anderen Behördenstandard ab. Wenn Sie in den USA leben, ist der USPS die einzige Datenbank, mit der Sie Ihre Daten abgleichen sollten.

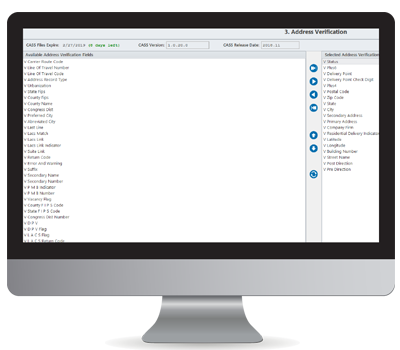

Wenn Ihre Adressdaten sauber und standardisiert sind, dauert dieser Vorgang nur wenige Minuten. Wenn Sie DataMatch Enterprise verwenden, können Sie die gesamte Adresse oder nur Teile der Adresse abgleichen, die auf 50 aktiven Elementen einschließlich geocodierter Orte basiert, was bedeutet, dass Sie Adressen bis ins Detail überprüfen können!

Zu den beliebtesten Feldern, für die unsere Kunden häufig eine Überprüfung verlangen, gehören:

-

V Status – Wird der Datensatz überprüft (Ja/Nein)

-

V Zustellungsindikator für Privatpersonen – Legt fest, ob die Privatadresse direkte Lieferungen an die Haustür erhalten kann.

-

V Unternehmen Firma

-

V Primäre Adresse

-

V Sekundäradresse

-

V Stadt

-

V Staat

-

V Postleitzahl – 5-stellig (USA)

-

V Postleitzahl (Kanada)

-

V Plus4 – Zusätzliche 4 Ziffern in Verbindung mit der 5-stelligen Postleitzahl

Es gibt 54 Felder, die Sie für die Überprüfung Ihrer Adressdaten verwenden können.

Sobald Sie die Adressliste mit diesen Komponenten abgeglichen haben, erhalten Sie einen Rückgabewert, der angibt:

- 10 = Invald Adresse

- 11 = Ungültige Postleitzahl

- 12 = Ungültiger Zustandscode

- 13 = Ungültige Stadt

- 21 = Adresse nicht gefunden

Sie werden auch mit Warnungen wie:

-

-

A# ZIP

-

B# Stadt/Staat Korrigiert

-

C# Ungültige Stadt/Staat/Zip

-

D# Keine Postleitzahl zugewiesen

-

E# ZIP zugewiesen für Mehrfachantwort

-

F# Kein ZIP verfügbar

-

G# Ein Teil der Firma ist an eine andere Adresse umgezogen

-

H# Sekundärnummer fehlt

-

I# Unzureichende/falsche Daten

-

J# Doppeleingang

-

Wenn Sie mehr darüber erfahren möchten, können Sie uns gerne für eine kurze Demo anrufen !

Okay, weiter geht’s:

Datenabgleich – die größte Herausforderung für die Adressstandardisierung und -überprüfung

Die Kunden, die sich an uns wenden, beschweren sich immer nur über eines – dass sie nie eine gute Trefferquote bekommen. Und wir sind einverstanden!

DerDatenabgleich muss noch verbessert werden. Es gibt nur sehr wenige Anbieter, die eine 100%ige Trefferquote angeben können. Sie brauchen diese Zahl wirklich, wenn nicht, dann zumindest 95 %. Der Grund dafür ist, dass Ihr Adressfeld eine Übereinstimmung mit dem USPS finden muss, damit die Überprüfung funktioniert. Wenn die meisten Ihrer Übereinstimmungen fehlen, weil die Software auf exakte oder deterministische Übereinstimmungen angewiesen ist, wird sie nicht zu Ihren Gunsten arbeiten.

Daher müssen Sie bei der Auswahl einer Software zur Adressennormung und -überprüfung in der Lage sein, deren Datenabgleichsrate zu beurteilen. Wie viele von hundert Zeilen hat das Tool übersehen, und warum? Wahrscheinlich werden Sie feststellen, dass die Software keine nahen oder ähnlichen Übereinstimmungen erkennt und sich ausschließlich auf exakte Zeichen verlässt, um eine Übereinstimmung zu identifizieren.

DataMatch Enterprise von Data Ladder ist in erster Linie eine Datenabgleichslösung, die von staatlichen Institutionen und Fortune-500-Unternehmen wie HP, Coca Cola, Deloitte und vielen anderen eingesetzt wird. Wir sind dafür bekannt, dass wir Daten mit einer Trefferquote von bis zu 100 % abgleichen. Das liegt daran, dass Data Ladder eine Kombination aus Fuzzy-Matching-Algorithmen und seinen bewährten proprietären Algorithmen verwendet, um selbst die entferntesten wahrscheinlichen Übereinstimmungen zu identifizieren.

P.S. – Der Datenabgleich ist ressourcenintensiv. Sparen Sie Ihrem Team Zeit und manuellen Aufwand. In diesem ausführlichen Blogbeitrag erfahren Sie, wie das geht.

Die folgende Fallstudie zeigt, wie schwierig es selbst für einen Datenlieferanten ist, einen genauen Datenabgleich zu gewährleisten.

Eine Fallstudie – E-Ideas Limited

Wir sprachen mit Artem Axenov, Operations Manager bei E-Ideas Limited, einer Boutique-Agentur für B2B-Marketing mit Sitz in Wellington. Die Agentur verwaltet eine große Datenbank von Unternehmen für Marketingzwecke, was bedeutet, dass sie sich besonders um die Adressdaten kümmern muss – eine große Herausforderung, die viel manuelle Arbeit mit Excel erfordert.

1. Wie geht Ihre Agentur mit dem Problem der schlechten Daten um?

Wir haben oft mit Kunden zu tun, die bereits eine Kundenliste haben, aber die Daten sind schlecht formatiert. Es gibt einige automatische Aufgaben, die Sie durchführen können, um das Problem zu lösen, aber letztendlich ist es eine manuelle Aufgabe. Zunächst müssen Sie entscheiden, welches Format Sie verwenden wollen. Der einfachste Weg, schlecht formatierte Daten zu korrigieren, besteht darin, sie spaltenweise zu sortieren und dann die erforderlichen Änderungen vorzunehmen, um sie auf den neuesten Stand zu bringen. In Excel gibt es einige Formeln, die dabei helfen, Daten aufzuteilen oder zu kombinieren – zum Aufteilen können Sie MID und LEFT zusammen verwenden. Und um Daten zu kombinieren, können Sie CONCATENATE verwenden.

Indem Sie die Daten zunächst sortieren, fassen Sie Adressensätze zusammen, die die gleichen Formatierungsprobleme aufweisen, was die gleichzeitige Bearbeitung wesentlich erleichtert.

2. Welche Erfahrungen haben Sie mit Tools zur Adressüberprüfung und -validierung gemacht?

Unsere Erfahrungen mit allen Arten von Adressvalidierungs- oder Verifizierungstools waren stets gemischt. Letzten Endes ist es keinem der von uns verwendeten Tools gelungen, eine hohe Übereinstimmung zu erzielen. Das liegt vor allem daran, dass die Adressen sehr unterschiedlich gespeichert werden. Sie sind nützlich, um sich einen Vorsprung zu verschaffen, aber am Ende ist immer ein erheblicher Anteil an manueller Arbeit erforderlich, um die Arbeit abzuschließen.

3. Welches ist das problematischste Problem beim Datenabgleich?

Das Hauptproblem besteht darin, dass der automatische Abgleich nicht funktioniert, wenn die Daten nicht genau so formatiert sind, wie das Programm sie erkennen soll. Das kann so klein sein, dass eine Straße als St, eine Avenue als Ave usw. erfasst wird.

4. Welche manuellen Aufgaben müssen Sie nach der Verwendung einer Adressvalidierungssoftware erledigen?

In der Regel genügt es, die Daten mit einem menschlichen Auge zu prüfen, um Unstimmigkeiten zu erkennen und zu korrigieren. In Neuseeland zum Beispiel hat die Post ein ganz bestimmtes Format, in dem die Adressen gehalten werden müssen, um den Rabatt für Massensendungen zu erhalten. Nichts ist kompliziert, aber auch hier gilt: Kleinigkeiten wie die Eintragung der Straße als St werden gegen Sie verwendet. Ein anderes Beispiel ist wenn Sie Ihr Postfach als Postfach registriert haben – es erkennt dies nicht als korrekt formatiert. Sogar Dinge wie führende oder nachfolgende Leerzeichen können gegen Sie zählen – und einige davon sind schwer zu erkennen, weil Sie, wenn Sie die Adresse betrachten, nicht sehen können, was falsch ist!

5. Wie haben sich schlechte Adressdaten auf Ihr Unternehmen ausgewirkt?

Wir sind nur insofern auf Probleme gestoßen, als wir zusätzliche Arbeitsstunden aufwenden mussten, um die Daten auf den neuesten Stand zu bringen, damit wir den Postrabatt in Anspruch nehmen konnten. Es gibt einen Test, den so genannten „Statement of Accuracy“, bei dem die Daten automatisch überprüft werden, um sicherzustellen, dass 80 % der Daten korrekt formatiert sind. Wir hatten eine Reihe von Fällen, in denen wir Tage länger mit der manuellen Formatierung von Daten verbracht haben, um sicherzustellen, dass sie korrekt formatiert sind.

Die Praxis, die wir jetzt eingeführt haben, besteht darin, alle unsere Daten im richtigen Format zu speichern. Es hat uns viel Zeit gekostet, alles auf diesen Standard zu bringen, aber jetzt bedeutet es, dass die Daten, die wir an unsere Kunden liefern, NZ Post-fertig sind und keine weitere Arbeit mehr erforderlich ist.

Die Probleme dieser Behörde mit fehlerhaften Adressdaten führen zu zusätzlichen Arbeitsstunden, die die operative Effizienz beeinträchtigen. Trotz des Einsatzes von Tools für den Adressabgleich und die Adressvalidierung ist es sehr schwierig, Adressdaten zu validieren, da keine hohe Übereinstimmung erzielt werden kann. Daher ist es notwendig, ein Tool zu wählen, das dem Benutzer umfassende Möglichkeiten der Datenaufbereitung und -standardisierung bietet und gleichzeitig eine hohe Trefferquote aufweist. Dies ist nur mit einer erstklassigen Datenaufbereitungs- und Abgleichsoftware wie DataMatch Enterprise möglich, die es dem Benutzer ermöglicht, Adressdaten aufzubereiten und zu bereinigen und dabei auch bei fehlerhaftem Text ein hohes Abgleichsergebnis zu erzielen.

Geschäftsstrategien für das Adressdatenmanagement

Schlechte Adressdaten sind ein Problem der Datenqualität. Auch wenn Sie mit Hilfe von Tools Korrekturen vornehmen können, müssen Sie dennoch Geschäftsstrategien implementieren, um zu verhindern, dass schlechte Daten die betrieblichen Abläufe beeinträchtigen. Einige dieser Strategien können sein:

Schulungen:

Der erste Schritt auf dem Weg zur Qualität ist die Schulung – stellen Sie sicher, dass die Personen, die Daten bearbeiten, mit ihnen interagieren, sie verwenden und eingeben, wissen, welchen Einfluss sie auf den Prozess und die nachgeschalteten Anwendungen haben. Sie müssen verstehen, welche Folgen schlechte Daten für das gesamte Unternehmen haben und nicht nur für ein Mitglied oder einen Kunden. Mitarbeiter, die sich an die Regeln der Datenqualität halten, sollten belohnt und gewürdigt werden.

Werkzeugliste für das Datenmanagement:

Die Verfügbarkeit von Tools, die sowohl Geschäftsanwendern als auch IT-Fachleuten bei der Verwaltung der Daten helfen können, ist von entscheidender Bedeutung. Ermitteln Sie die Tools, die Sie für die Datenbereinigung und das Datenmanagement benötigen, damit sowohl IT- als auch Geschäftsanwender einen reibungslosen Umgang mit Daten haben.

Einbindung der Geschäftsanwender in den Qualitätsprozess:

Daten sind nicht nur ein IT-Problem. Die Geschäftsanwender sind gleichermaßen für die Verwaltung der Daten verantwortlich. Sie sind nämlich die alleinigen Eigentümer der Kundendaten, die häufig für Marketing- und Vertriebszwecke verwendet werden. Deshalb müssen sie in den Prozess einbezogen und auch für die Verwendung von Datenmanagement-Tools geschult werden.

Datenverwaltung:

Stellen Sie ein Data-Governance-Team zusammen, das einen Datenverwaltungsplan erstellt und sicherstellt, dass das Unternehmen den Plan befolgt und jeder Mitarbeiter diesen Plan versteht. Ihre Rolle innerhalb des Plans und die Erwartungen, die mit der Rolle einhergehen.

Sperren von Daten und Benutzerrollen:

Wenn jeder in Ihrem Team das CRM oder die Datenquelle öffnen kann, mit den Daten herumhantiert und keine Spuren hinterlässt, haben Sie ernsthafte Probleme. Es ist notwendig, Stammdateninhaber zu schaffen, die die Rechte haben, auf kritische Daten zuzugreifen, sie einzugeben oder zu verarbeiten. Dies sollte in den Datenverwaltungsplan aufgenommen werden.

Sie sind kein Opfer von schlechten Daten. Akzeptieren Sie den Ernst der Lage, kultivieren Sie eine datengesteuerte Kultur und bemühen Sie sich, die mit der Datenverwaltung verbundenen Herausforderungen zu bewältigen. Es ist durchaus möglich, dass Sie Daten erhalten, die nur einer grundlegenden Bereinigung bedürfen, um sie nutzen zu können.

Wie kann DataMatch Enterprise helfen?

Unser Produkt ist CASS-zertifiziert, d. h. wir erfüllen und übertreffen die Anforderungen des USPS an die Qualität und Genauigkeit der Adressen. Wir helfen Ihnen auch beim Massenabgleich und der Validierung von Adressen und stellen sicher, dass Elemente wie Postleitzahlen, Orts- und Stadtnamen überprüft und validiert werden. Der größte Vorteil der Verwendung von DataMatch Enterprise von Data Ladder? Die Software findet und gleicht Daten ab, auch wenn sie unvollständig sind, und das mit einer Trefferquote von 96 %. Darüber hinaus können Sie mit der Software eine Adressüberprüfung in Echtzeit durchführen, um sicherzustellen, dass Sie korrekte Adressen in Ihrer Datenbank haben.

Mithilfe von Algorithmen, die eine Übereinstimmung auf der Grundlage von Ähnlichkeitsbereichen ermitteln, macht unsere Plattform aus unbrauchbaren Daten einen Sinn und leitet Verbindungen zwischen Datensätzen ab. Ob es sich um Rechtschreibfehler oder unvollständige Postleitzahlen, Abkürzungen oder Tippfehler handelt. Wir sortieren große Datenmengen, um Ihnen zu helfen, Ihre Daten sinnvoll zu nutzen.

Mithilfe von Algorithmen, die eine Übereinstimmung auf der Grundlage von Ähnlichkeitsbereichen ermitteln, macht unsere Plattform aus unbrauchbaren Daten einen Sinn und leitet Verbindungen zwischen Datensätzen ab. Ob es sich um Rechtschreibfehler oder unvollständige Postleitzahlen, Abkürzungen oder Tippfehler handelt. Wir sortieren große Datenmengen, um Ihnen zu helfen, Ihre Daten sinnvoll zu nutzen.

Zum Abschluss

Schlechte Adressdaten sind unvermeidlich, aber das bedeutet nicht, dass Sie sich davon in Ihrer Unternehmensleistung beeinträchtigen lassen sollten. Die manuelle Korrektur von Adressdaten kostet Sie mehr Zeit und Mühe, und Sie können sie nicht standardisieren oder überprüfen, es sei denn, Sie verwenden eine CASS-zertifizierte Lösung.

Ertrinken Sie nicht in schlechten Daten. Wir sind hier, um zu helfen.

Wenn Sie wissen möchten, wie wir Sie bei der Adressstandardisierung und -überprüfung unterstützen können, nehmen Sie noch heute Kontakt mit einem unserer Lösungsexperten auf und erfahren Sie, wie wir Ihnen helfen können, Adressdaten zu erhalten, die Sie für den vorgesehenen Zweck verwenden können.

The post Eine Kurzanleitung zur Adressstandardisierung und -überprüfung appeared first on Data Ladder.

]]>The post 8 bewährte Verfahren zur Gewährleistung der Datenqualität auf Unternehmensebene appeared first on Data Ladder.

]]>Am 20. September 2021 räumte Facebook gegenüber drei Dutzend Forschern ein, dass der Datensatz schwerwiegende Fehler aufwies, und entschuldigte sich für die negativen Auswirkungen auf ihre Forschung. Es stellte sich heraus, dass Facebook es versäumt hatte, die Daten der Hälfte seiner US-Nutzer einzubeziehen, da diese im Vergleich zu den Nutzern insgesamt weniger politisch polarisiert waren. Eine Facebook-Sprecherin erklärte, dass dieser Vorfall auf einen technischen Fehler in ihrem URL-Shares-Datensatz zurückzuführen sei.

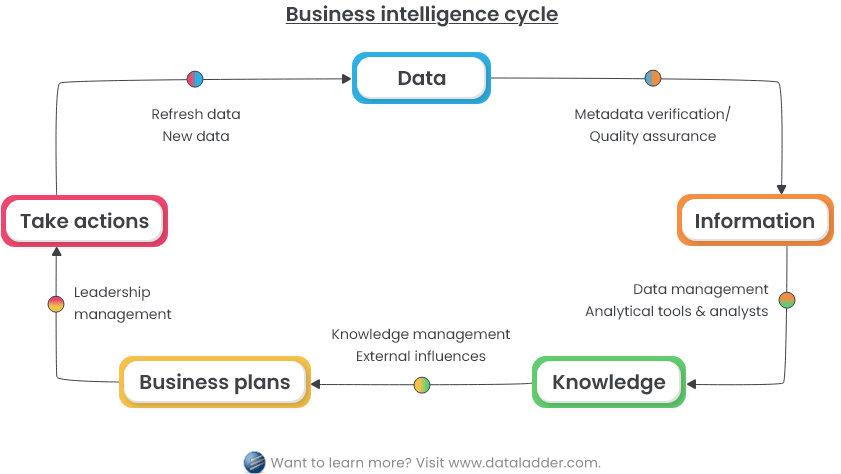

Heutzutage sind Daten zweifellos einer der größten Vermögenswerte eines Unternehmens. Sie wird überall eingesetzt – vom Tagesgeschäft eines Unternehmens bis hin zu Business-Intelligence-Initiativen – oder, wie im Fall von Facebook, zur Unterstützung von mehr als 100 Recherchen. Wenn jedoch Techniken und bewährte Verfahren für die Datenqualität fehlen (mit denen Datenqualitätsprobleme rechtzeitig erkannt und behoben werden), kann ein Unternehmen viel Geld verlieren und Gefahr laufen, ins Hintertreffen zu geraten.

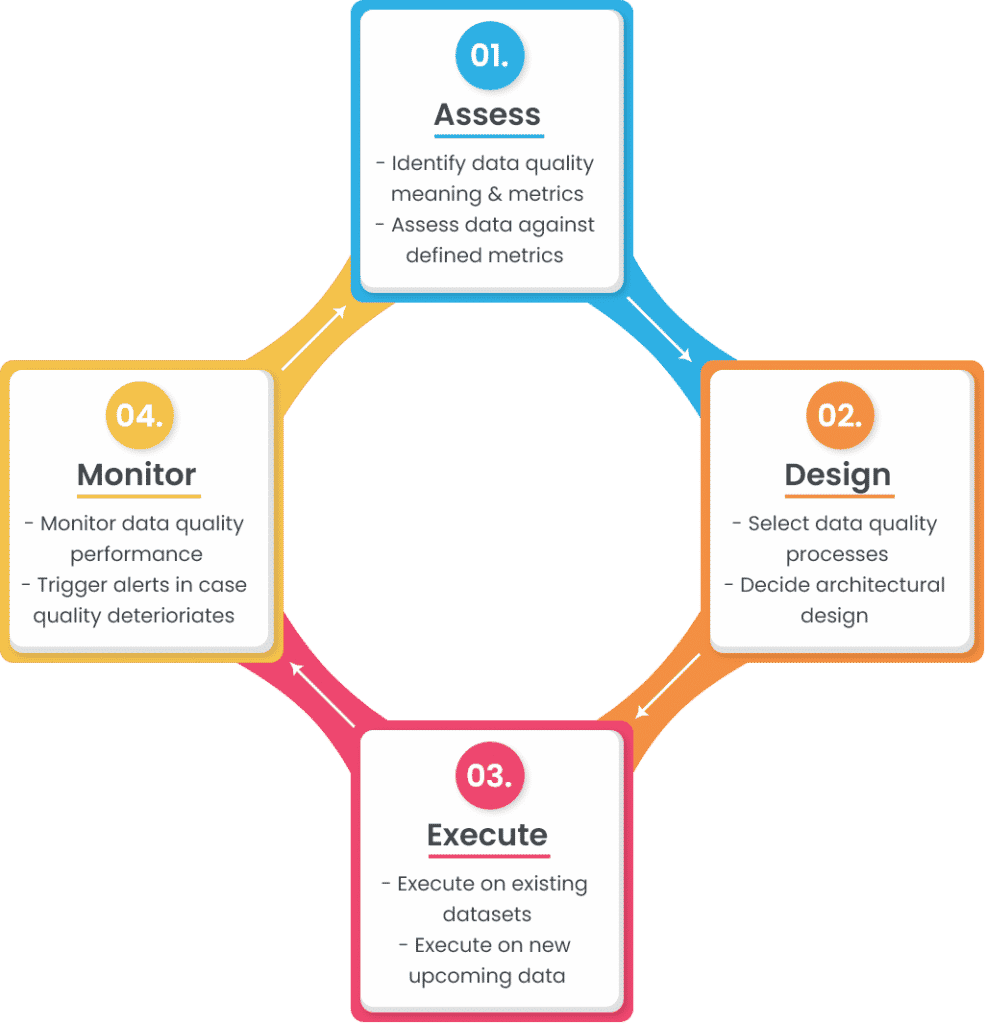

In diesem Blog befassen wir uns mit einer Reihe von Best Practices und Prozessen zur Datenqualität, die eine hohe Datenqualität auf Unternehmensebene ermöglichen können. Ich werde nicht nur aufzeigen, was benötigt wird, sondern auch die Maßnahmen nennen, die Ihnen helfen können, diesen Zustand zu erreichen.

Darüber hinaus führen die unten genannten Praktiken zu den besten Ergebnissen, wenn sie in regelmäßigen Abständen in einem Unternehmen durchgeführt werden. Daten (in ihrer Definition und Verwendung) sind dem Wandel unterworfen. Wenn Ihr Unternehmen also diese Praktiken ständig überprüft, können Sie definitiv bessere und dauerhafte Ergebnisse erzielen.

Fangen wir an.

1. Ermitteln Sie den Zusammenhang zwischen Daten und Unternehmensleistung

Wir beginnen mit dieser Praxis, da sie der wichtigste und grundlegendste Teil einer ordnungsgemäßen Datenverwaltung, -übernahme und -nutzung in jedem Unternehmen ist. Zuallererst müssen Sie verstehen, wie Daten zu Ihren Unternehmenszielen beitragen.

Wie sieht sie aus?

Dies kann sowohl eine Analyse der Rolle von Daten auf hoher Ebene (z. B. Hervorhebung von Bereichen, in denen Daten genutzt werden) als auch eine detaillierte Analyse von Einzelheiten (z. B. der Rolle von Daten im Tagesgeschäft, in Geschäftsprozessen, beim Informationsaustausch zwischen Abteilungen usw.) umfassen.

Wenn Sie das erkannt haben, ist es an der Zeit, folgende Frage zu stellen: Wenn diese Prozesse oder Bereiche nicht durch Qualitätsdaten unterstützt wurden, welche Auswirkungen kann das auf die daraus resultierenden KPIs haben?

Ein Beispiel für eine solche Situation ist, wenn die Geschäftsleitung das Umsatzziel für das nächste Quartal auf der Grundlage der Verkaufsdaten des letzten Quartals festlegt, aber dann feststellt, dass der Datensatz, der für die Prognose des künftigen Ziels verwendet wurde, schwerwiegende Probleme mit der Datenqualität aufweist, was dazu führt, dass Ihre Verkaufsabteilung einem willkürlichen Wert nachjagt, der keine konkrete Bedeutung hat. Die daraus resultierende Situation hat massive negative Auswirkungen auf die Geschäftstätigkeit und den Ruf des Unternehmens, z. B. indem unrealistische Erwartungen an die Vertriebsmitarbeiter gestellt werden, ungenaue Umsatzzahlen versprochen werden und so weiter.

Wie hilft es?

Wenn Sie verstehen, welche Rolle Daten in allen laufenden Prozessen eines Unternehmens spielen, haben Sie immer ein Argument zur Hand, um Daten und ihrer Qualität Priorität einzuräumen. Dies wird Ihnen auch dabei helfen, die notwendige Zustimmung und Aufmerksamkeit der Beteiligten zu erhalten – etwas, das für die Durchführung und das Vorschlagen von Änderungen an bestehenden Prozessen entscheidend ist.

2. Messung und Pflege der Definition der Datenqualität

Sobald Sie wissen, welche Auswirkungen Daten auf Ihr Unternehmen haben, besteht der nächste Schritt darin, Datenqualität für alle Datensätze in Ihrem Unternehmen zu erreichen. Doch bevor wir das tun können, ist es wichtig, die Definition von Datenqualität zu verstehen, da sie für jedes Unternehmen etwas anderes bedeutet.

Die Datenqualität ist definiert als der Grad, in dem die Daten den beabsichtigten Zweck erfüllen. Um die Bedeutung der Datenqualität in Ihrem Fall zu verstehen, müssen Sie also wissen, was der beabsichtigte Zweck ist.

Wie sieht sie aus?

Um die Datenqualität für Ihr Unternehmen zu definieren, müssen Sie damit beginnen, die Daten zu identifizieren:

- Quellen, die Daten erzeugen, speichern oder manipulieren,

- Von jeder Quelle gespeicherte Attribute,

- Metadaten-Glossar, das jedes Attribut definiert,

- Akzeptanzkriterien für die in den Attributen gespeicherten Datenwerte, und

- Datenqualitätsmetriken, die die Qualität der gespeicherten Daten messen.

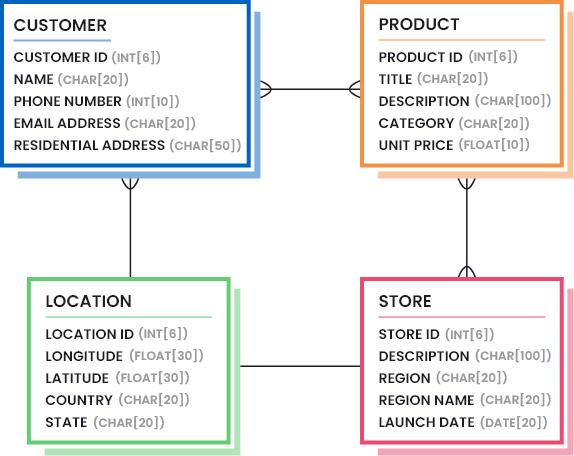

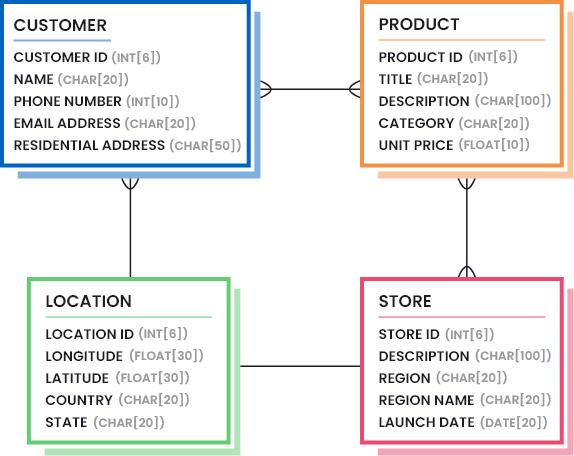

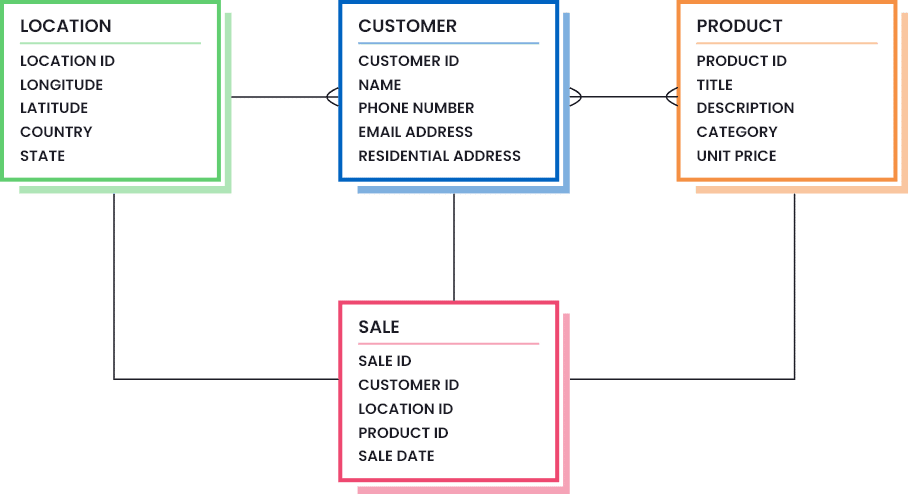

Ein Beispiel für die Definition der Datenqualität in Ihrem Unternehmen ist die Erstellung von Datenmodellen, in denen die notwendigen Datenbestandteile hervorgehoben werden (die Menge und Qualität der Daten, die als gut genug angesehen werden). Die folgende Abbildung zeigt, wie ein Datenmodell für ein Einzelhandelsunternehmen aussehen kann:

Außerdem müssen Sie nicht nur Datenmodelle entwerfen, sondern auch Datenqualitätsmetriken ermitteln, die das Vorhandensein eines akzeptablen Qualitätsniveaus in Ihren Datensätzen bestätigen. So können Sie beispielsweise verlangen, dass Ihr Datensatz genauer und zuverlässiger als vollständig ist.

Wie hilft es?

Eine standardisierte Definition von Datenqualität hilft dabei, alle Beteiligten auf den gleichen Stand zu bringen, damit sie verstehen, was Datenqualität bedeutet, wie sie aussieht und wie sie gemessen werden kann. Dies ermöglicht es jedem Einzelnen, die Anforderungen an die Datenqualität zu verstehen und zu erfüllen.

3. Festlegung von Rollen und Zuständigkeiten für Daten in der gesamten Organisation

Es wird allgemein davon ausgegangen, dass die Sicherstellung der Datenqualität auf Unternehmensebene die Beteiligung oder Zustimmungder obersten Führungsebene erfordert. Die Wahrheit ist, dass Sie nicht nur bestimmte Personen in Silo-Umgebungen einbeziehen, sondern Mitarbeiter in die bestehenden Prozesse einbinden und ihnen die Verantwortung für die Erreichung und Aufrechterhaltung der Datenqualität übertragen müssen – von der obersten Führungsebene bis hin zum Betriebspersonal.

Wie sieht sie aus?

Einige häufige, aber wichtige Datenrollen und ihre Zuständigkeiten sind:

- Chief Data Officer (CDO): Ein Datenbeauftragter der obersten Führungsebene, der für die Entwicklung von Strategien zur Gewährleistung eines effektiven Datenmanagements, der Verfolgung der Datenqualität und der Datenübernahme im gesamten Unternehmen verantwortlich ist.

- Datenverwalter: ein für die Datenqualität Verantwortlicher, der die Eignung der Daten für den vorgesehenen Zweck sicherstellt und die Metadaten verwaltet.

- Data and Analytics (D&A) Leader: ein Data Player, der für die Sicherstellung der Datenkompetenz im gesamten Unternehmen verantwortlich ist und dafür sorgt, dass Daten einen Mehrwert schaffen.

Wie hilft es?

Wenn Daten als Hauptquelle für zentrale Geschäftsprozesse behandelt werden, kommt es zu einem unternehmensweiten Wandel. Die Zuweisung von Rollen und Zuständigkeiten im Bereich der Daten und die Erteilung von Befugnissen an die Mitarbeiter, um Einfluss auf wichtige Datenfragen zu nehmen und sich zu diesen zu äußern, können eine wichtige Rolle bei der Gewährleistung einer erfolgreichen Datenkultur in jedem Unternehmen spielen.

4. Schulung und Aufklärung der Teams über Daten

In einer Umfrage unter 9000 Mitarbeitern, die verschiedene Funktionen in einem Unternehmen ausüben, waren nur 21 % von ihren Datenkenntnissen überzeugt.

Die Einführung von Datenrollen und -verantwortlichkeiten kann sich sehr positiv auf Ihr Unternehmen auswirken. Dennoch ist es wichtig zu bedenken, dass an einem modernen Arbeitsplatz jeder Einzelne im Rahmen seiner täglichen Arbeit Daten generiert, manipuliert oder mit ihnen umgeht. Aus diesem Grund ist es zwar wichtig, bestimmten Personen die Verantwortung für die Durchführung von Korrekturmaßnahmen zu übertragen, aber ebenso wichtig ist es, alle Teams im Umgang mit Unternehmensdaten zu schulen und zu schulen.

Wie sieht sie aus?

Dies kann die Erstellung von Plänen zur Datenkompetenz und die Entwicklung von Kursen beinhalten, die die Teams in die Unternehmensdaten einführen und erklären:

- Was es enthält,

- Was die einzelnen Datenattribute bedeuten,

- Welches sind die Akzeptanzkriterien für seine Qualität?

- Was ist der falsche und was der richtige Weg für die Eingabe/Manipulation von Daten?

- Welche Daten sind zu verwenden, um ein bestimmtes Ergebnis zu erzielen?

Außerdem können diese Kurse je nach Häufigkeit der Datennutzung durch bestimmte Rollen (täglich, wöchentlich oder jährlich) erstellt werden.

Wie hilft es?

Die Fähigkeit, Daten auf allen Ebenen korrekt und genau zu lesen, zu verstehen und zu analysieren, versetzt jeden Mitarbeiter in die Lage, die richtigen Fragen zu stellen – und zwar auf die bestmögliche Weise. Es gewährleistet auch die operative Effizienz Ihrer Mitarbeiter und reduziert Fehler bei der Kommunikation von Daten.

5. Kontinuierliche Überwachung des Datenzustands durch Datenprofiling

Datenqualität zu erreichen und sie über einen längeren Zeitraum aufrechtzuerhalten sind zwei verschiedene Dinge. Aus diesem Grund müssen Sie einen systematischen Prozess einführen, der den Zustand der Daten kontinuierlich überwacht und Profile erstellt, um verborgene Details über ihre Struktur und ihren Inhalt aufzudecken.

Der Umfang und der Prozess der Datenprofilerstellung können je nach der Definition der Datenqualität in Ihrem Unternehmen und der Art und Weise, wie sie gemessen wird, festgelegt werden.

Wie sieht sie aus?

Dies kann durch die Konfiguration und Planung von täglichen/wöchentlichen Datenprofilberichten erreicht werden. Darüber hinaus können Sie benutzerdefinierte Workflows entwerfen, um die Datenverantwortlichen in Ihrem Unternehmen zu alarmieren, wenn die Datenqualität unter einen akzeptablen Schwellenwert sinkt.

Ein Datenprofilbericht hebt in der Regel eine Reihe von Dingen über die untersuchten Datensätze hervor, zum Beispiel:

- Der Prozentsatz der fehlenden und unvollständigen Datenwerte,

- Die Anzahl der Datensätze, die möglicherweise Duplikate voneinander sind,

- Auswertung von Datentypen, -größen und -formaten zur Aufdeckung ungültiger Datenwerte,

- Statistische Analyse von numerischen Datenspalten zur Bewertung von Verteilungen.

Wie hilft es?

Auf diese Weise können Sie Datenfehler frühzeitig erkennen und verhindern, dass diese bis zum Kunden durchdringen. Darüber hinaus kann es den Chief Data Officers helfen, den Überblick über das Datenqualitätsmanagement zu behalten und die richtigen Entscheidungen zu treffen, z. B. wann und wie die in den Datenprofilen hervorgehobenen Probleme behoben werden sollen.

Lesen Sie mehr über Data Profiling: Umfang, Techniken und Herausforderungen.

6. Entwicklung und Pflege von Datenpipelines, um eine einzige Quelle der Wahrheit zu erhalten

Eine Datenpipeline bezieht sich auf einen systematischen Prozess, der Daten aus einer Quelle aufnimmt, die notwendigen Verarbeitungs- und Umwandlungstechniken an den Daten durchführt und sie dann in einen Zielspeicher lädt.

Es ist wichtig, dass Rohdaten eine Reihe von Validierungsprüfungen durchlaufen, bevor sie als brauchbar eingestuft und allen Benutzern im Unternehmen zur Verfügung gestellt werden können.

Wie sieht sie aus?

Um eine Datenpipeline zu erstellen, müssen Sie auf die in diesem Blog erwähnte Praxis Nr. 02 zurückgreifen: Definieren und pflegen Sie die Definition von Datenqualität. Entsprechend dieser Definition müssen Sie eine Liste von Operationen festlegen, die an den eingehenden Daten durchgeführt werden müssen, um das definierte Qualitätsniveau zu erreichen.

Eine Beispielliste von Vorgängen, die innerhalb Ihrer Datenpipeline durchgeführt werden können, umfasst

- Ersetzen von Null- oder Leerwerten durch einen Standardbegriff, z. B. „Nicht verfügbar“.

- Umwandlung von Datenwerten nach dem festgelegten Muster und Format.

- Parsing von Feldern in zwei oder mehr Spalten.

- Ersetzen von Abkürzungen durch richtige Wörter.

- Ersetzen von Spitznamen durch Eigennamen.

- Falls der eingehende Datensatz als potenzielles Duplikat vermutet wird, wird er mit dem bestehenden Datensatz zusammengeführt, anstatt als neuer Datensatz angelegt zu werden.

Wie hilft es?

Eine Datenpipeline fungiert als Firewall für die Datenqualität Ihrer Unternehmensdatenbestände. Die Entwicklung einer Datenpipeline trägt dazu bei, die Datenkonsistenz über alle Quellen hinweg zu gewährleisten und eventuelle Diskrepanzen zu beseitigen – noch bevor die Daten in die Zielquelle geladen werden.

7. Durchführung einer Ursachenanalyse von Datenqualitätsfehlern

Bisher haben wir uns vor allem darauf konzentriert, wie wir die Datenqualität nachverfolgen und vermeiden können, dass Fehler in die Datensätze gelangen, aber die Wahrheit ist: Trotz all dieser Bemühungen werden wahrscheinlich einige Fehler in das System gelangen. Sie müssen sie nicht nur beheben, sondern vor allem verstehen, wie diese Fehler entstanden sind, damit solche Szenarien verhindert werden können.

Wie sieht sie aus?

Eine Ursachenanalyse für Datenqualitätsfehler kann beinhalten, dass Sie sich den neuesten Datenprofilbericht besorgen und mit Ihrem Team zusammenarbeiten, um Antworten auf Fragen wie diese zu finden:

- Welche Datenqualitätsfehler sind aufgetreten?

- Woher stammen sie?

- Wann sind sie entstanden?

- Warum sind sie trotz aller Prüfungen der Datenqualität im System gelandet? Haben wir etwas verpasst?

- Wie können wir verhindern, dass solche Fehler erneut im System auftauchen?

Wie hilft es?

Wenn man den Problemen der Datenqualität auf den Grund geht, lassen sich Fehler langfristig vermeiden. Sie müssen nicht immer reaktiv arbeiten und Fehler beheben, sobald sie auftreten. Mit einem proaktiven Ansatz können Sie es Ihren Teams ermöglichen, ihren Aufwand für die Behebung von Datenqualitätsfehlern zu minimieren – und 99 % der Probleme im Zusammenhang mit Daten durch die verfeinerten Datenqualitätsprozesse beheben zu lassen.

8. Einsatz von Technologie zur Erreichung und Erhaltung der Datenqualität

Dies bringt uns zu unserer letzten Best Practice: die Nutzung von Technologie zur Erreichung eines nachhaltigen Datenqualitätsmanagement-Lebenszyklus. Kein Prozess verspricht eine gute Leistung und den besten ROI, wenn er nicht mit Hilfe von Technologie automatisiert und optimiert wird.

Wie sieht sie aus?

Investieren Sie in ein technologisches System, das über alle Funktionen verfügt, die Sie benötigen, um die Datenqualität in allen Datenbeständen zu gewährleisten. Zu diesen Funktionen gehört die Möglichkeit,:

- Datenimport: Importieren Sie Daten aus verschiedenen Quellen,

- Datenprofil: Bewerten Sie Daten, um Berichte zur Datenqualität zu erstellen,

- Datenbereinigung: Markieren Sie mögliche Bereiche, die eine Datenbereinigung, -standardisierung und -umwandlung erfordern, und implementieren Sie entsprechende Maßnahmen,

- Datenabgleich: Sie können Daten mit exakten und unscharfen Abgleichsalgorithmen mit hoher Genauigkeit abgleichen und die Algorithmen auf die Art Ihrer Daten abstimmen,

- Datendeduplizierung: Verknüpfen Sie Datensätze und finden Sie die einzige Quelle der Wahrheit,

- Daten exportieren: Ergebnisse exportieren/laden.

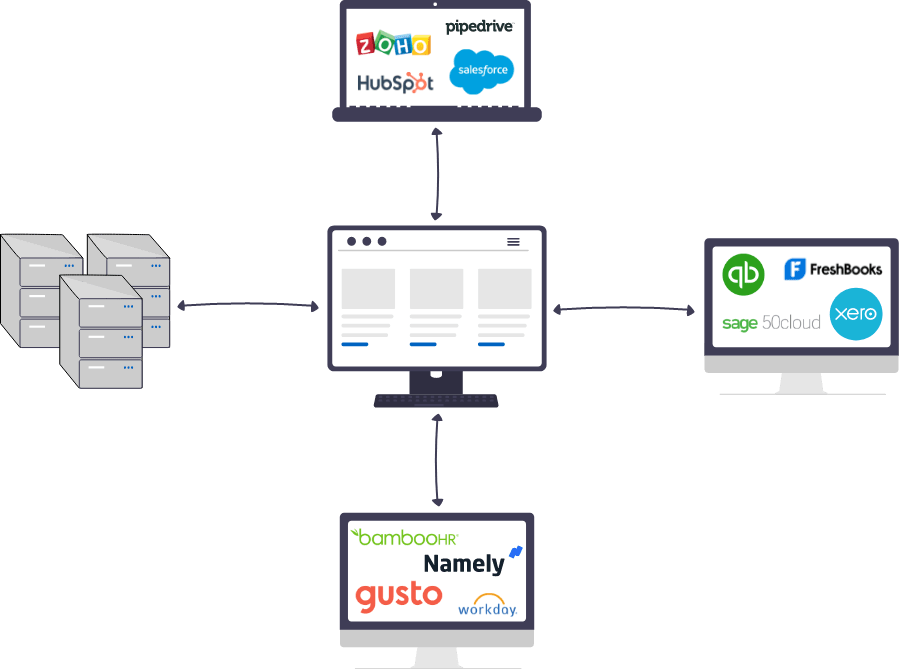

Zusätzlich zu den oben erwähnten Funktionen für das Datenqualitätsmanagement investieren einige Unternehmen in Technologien, die auch zentralisierte Datenverwaltungsfunktionen bieten. Ein Beispiel für ein solches System ist die Stammdatenverwaltung (MDM). Obwohl es sich bei einem MDM um eine vollständige Datenverwaltungslösung mit Datenqualitätsfunktionen handelt, benötigen nicht alle Unternehmen die umfangreiche Liste von Funktionen, die ein solches System bietet.

Um zu beurteilen, welche Art von Technologie für Sie die richtige Entscheidung ist, müssen Sie Ihre geschäftlichen Anforderungen kennen. Lesen Sie diesen Blog, um die wichtigsten Unterschiede zwischen einer MDM- und einer DQM-Lösung zu erfahren.

Wie hilft es?

Der Einsatz von Technologie bei der Umsetzung von Prozessen, die konsequent wiederholt werden müssen, um dauerhafte Ergebnisse zu erzielen, bietet zahlreiche Vorteile. Wenn Sie Ihrem Team Self-Service-Tools für das Datenqualitätsmanagement zur Verfügung stellen, können Sie die betriebliche Effizienz steigern, Doppelarbeit vermeiden, die Kundenerfahrung verbessern und zuverlässige Geschäftseinblicke gewinnen.

Schlussfolgerung

Die Implementierung konsistenter, automatisierter und wiederholbarer Datenqualitätsmaßnahmen kann Ihrem Unternehmen dabei helfen, Datenqualität über alle Datensätze hinweg zu erreichen und zu erhalten.

Data Ladder bietet seinen Kunden seit über einem Jahrzehnt Datenqualitätslösungen an. DataMatch Enterprise ist eines der führenden Datenqualitätsprodukte des Unternehmens, das sowohl als eigenständige Anwendung als auch als integrierbare API verfügbar ist und ein durchgängiges Datenqualitätsmanagement ermöglicht, einschließlich Datenprofilierung, -bereinigung, -abgleich, -deduplizierung und -bereinigung.

Sie können die kostenlose Testversion noch heute herunterladen oder eine persönliche Sitzung mit unseren Experten vereinbaren, um zu erfahren, wie unser Produkt bei der Implementierung der besten Verfahren zur Erreichung und Aufrechterhaltung der Datenqualität auf Unternehmensebene helfen kann.

The post 8 bewährte Verfahren zur Gewährleistung der Datenqualität auf Unternehmensebene appeared first on Data Ladder.

]]>The post Leitfaden zum Musterabgleich: Was bedeutet er und wie geht er? appeared first on Data Ladder.

]]>In jeder Art von datenreicher Umgebung ist es einfach, Muster zu finden; das ist es, was mittelmäßige Spieler tun. Der Schlüssel liegt in der Feststellung, ob die Muster ein Signal oder Rauschen darstellen.

Nate Silver

Jeder, der mit Daten arbeitet, weiß um die Bedeutung von Mustern. Ganz gleich, ob Sie große Datensätze ganzheitlich analysieren oder bis auf den kleinsten Wert herunterbrechen – Muster sind überall zu finden. Sie können allgemeingültig sein – wie das Muster einer Kreditkartennummer – oder sie können einzigartig für Ihr Unternehmen sein, z. B. das Muster, das für die Anzeige von Produktinformationen auf Ihrer Website verwendet wird.

Wenn Daten erfasst werden, folgen sie nicht immer dem richtigen Muster. Unternehmen müssen verschiedene Methoden für den Abgleich, die Validierung und die Umwandlung von Mustern implementieren, um die Daten in der gewünschten Form und dem gewünschten Format zu erhalten.

In diesem Blog werden wir einige wichtige Konzepte im Zusammenhang mit dem Musterabgleich und der Validierung kennenlernen, z. B:

- Was bedeutet der Musterabgleich?

- Wie unterscheidet sich der Musterabgleich vom Zeichenfolgenabgleich?

- Wie funktioniert der Musterabgleich?

- Was sind die häufigsten Gründe für den Abgleich und die Validierung von Mustern?

- Wie können Sie Ihre Daten in das von Ihnen benötigte Muster umwandeln?

Lassen Sie uns eintauchen.

Was ist ein Mustervergleich?

Ein Muster wird als etwas wahrgenommen, das das Gegenteil von Unordnung oder Chaos ist. Es handelt sich um ein sich wiederholendes Modell, das in einer großen Menge von Datenwerten, die zum selben Bereich gehören, identifiziert werden kann. Daher kann der Mustervergleich wie folgt definiert werden:

Der Prozess der Suche nach einer bestimmten Folge oder Platzierung von Zeichen in einem gegebenen Datensatz.

Der Musterabgleich liefert eindeutige Ergebnisse: Die Eingabezeichenfolge enthält entweder das Muster (ist gültig) oder nicht (ist ungültig). Für den Fall, dass die Zeichenkette nicht das erforderliche Muster enthält, wird der Abgleichprozess häufig um eine Mustertransformation erweitert, bei der Teildatenelemente aus dem Eingabewert extrahiert und dann neu formatiert werden, um das erforderliche Muster zu erstellen.

Musterabgleich versus Zeichenfolgenabgleich

Bevor wir die Funktionsweise von Algorithmen zum Musterabgleich erörtern, ist es wichtig, ihre Beziehung zu Algorithmen zum Abgleich von Zeichenfolgen zu verstehen. Diese beiden Begriffe werden oft als ein und dasselbe behandelt, aber sie sind in ihrem Zweck und ihrer Verwendung recht unterschiedlich. In der nachstehenden Tabelle sind einige der wichtigsten Unterschiede aufgeführt:

| Abgleich von Mustern | String-Abgleich | |

| Vergleich | Er vergleicht eine Zeichenkette mit einem Standardmuster, das Blöcke oder Token von Zeichen darstellt. | Er vergleicht zwei Zeichenketten Zeichen für Zeichen. |

| Beispiel | Vergleich von [email protected] mit [name]@[domain].[domain-extension]. | Vergleich von Elizabeth mit Alizabeth. |

| Ergebnisse | Berechnet endgültige Ergebnisse – entweder wird das Muster gefunden oder es ist nicht vorhanden. | Berechnet exakte Übereinstimmungen (Staub mit Staub) oder unscharfe Übereinstimmungen (Staub mit Rost). |

| Verwendet | Dient zum Parsen und Extrahieren von Werten oder zum Umwandeln von Werten in Standardmuster. | Dient der Korrektur von Rechtschreibfehlern, der Erkennung von Plagiaten und der Identifizierung von Werten mit ähnlicher Bedeutung oder Zeichenzusammensetzung. |

Wie funktioniert der Musterabgleich?

Einfach ausgedrückt, arbeiten Algorithmen für den Mustervergleich mit regulären Ausdrücken (oder regex). Um zu verstehen, was ein regulärer Ausdruck ist, stellen Sie sich vor, dass es sich um eine Sprache handelt, die Ihnen hilft, ein Muster zu definieren und es mit jemandem zu teilen – oder in unserem Fall mit einem Computerprogramm.

Reguläre Ausdrücke teilen Computerprogrammen mit, nach welchem Muster sie in Testdaten suchen sollen. Manchmal ist das Programm intelligent genug, um Muster aus einer Reihe von Datenwerten zu erkennen und automatisch eine Regex zu generieren. Einige Programme oder Tools verfügen über eine integrierte Regex-Bibliothek, die häufig verwendete Muster enthält, z. B. Kreditkartennummern, US-Telefonnummern, Datumsformate, E-Mail-Adressen usw.

Beispiel für ein passendes E-Mail-Adressmuster

Um herauszufinden, was ein Algorithmus zum Musterabgleich ist, nehmen wir das Beispiel der Validierung des Musters von E-Mail-Adressen. Der erste Schritt besteht darin, die Regex zu definieren, die das Muster einer gültigen E-Mail-Adresse angibt. Ein Beispiel für eine gültige E-Mail-Adresse könnte wie folgt aussehen:

[name]@[domain].[domain-extension]

In der Regex-Sprache wird dieses Muster wie folgt übersetzt:

^[\w-.]+@([\w-]+.)+[\w-]{2,3}$

Wo,

- ^ steht für den Anfang eines Satzes und $ für das Ende.

- [\w-.] bedeutet ein Wort, das alphanumerische Zeichen, einen Unterstrich, einen Bindestrich oder einen Punkt enthält.

- +@ bedeutet die Hinzufügung eines @-Symbols.

- ([\w-]+.) bezeichnet ein Wort, das alphanumerische Zeichen, Unterstriche oder Bindestriche enthält und mit einem Punkt endet.

- +[\w-]{2,3} bedeutet ein Wort, das alphanumerische Zeichen oder einen Bindestrich enthält, und dieses Wort darf nur mindestens zwei und höchstens drei Zeichen haben.

Unten sehen Sie eine Reihe von Test-E-Mail-Adressen, die durch dieses Regex-Muster laufen, und die Ergebnisse.

| Nein. | Test | Ergebnis | Grund für das Scheitern |

| 1. | [email protected] | Gültig | |

| 2. | pam.beesly_gmail.com | Ungültig | Fehlendes @-Symbol. |

| 3. | [email protected] | Ungültig | Die Domain hat einen unerwarteten Punkt. |

| 4. | [email protected] | Ungültig | Die Domainendung hat mehr als 3 Zeichen (z. B. com4). |

Es liegt auf der Hand, dass die manuelle Definition von Regexen mühsam ist und einiges an Fachwissen erfordert. Sie können sich auch für Datenstandardisierungstools entscheiden, die visuelle Regex-Designer anbieten (mehr dazu in einem späteren Abschnitt).

Anwendungsfälle für den Musterabgleich

Nachdem wir nun wissen, was der Musterabgleich ist und wie der Algorithmus funktioniert, fragen Sie sich vielleicht, wo genau er eingesetzt wird. Der Musterabgleich ist eines der grundlegendsten Konzepte in verschiedenen Bereichen wie der Computerprogrammierung, der Datenwissenschaft und -analyse, der Verarbeitung natürlicher Sprache und vielen mehr.

Wenn wir speziell über den Musterabgleich und die Validierung im Datenbereich sprechen, finden sich hier einige der häufigsten Anwendungen:

1. Validierung von Formularübermittlungen

Da der Datenmusterabgleich zwischen gültigen und ungültigen Informationen unterscheidet, wird er meist zur Überprüfung von Formularen verwendet, die auf Websites oder in anderen Softwareanwendungen eingereicht werden. Der Regex wird je nach Bedarf auf die Formularfelder angewendet; einige Beispiele für Validierungen sind unten aufgeführt:

- Der Name einer Person enthält nur Alphabete oder Symbole,

- Die E-Mail-Adresse entspricht dem richtigen Muster,

- Die Rufnummer enthält nur Ziffern,

- Die Kreditkartennummer darf nicht mehr als 16 Ziffern haben und so weiter.

2. Durchführen von Such- und Ersetzungsoperationen

Der Musterabgleich ist auch in Anwendungen nützlich, die über Funktionen zum Suchen und Ersetzen von Textinformationen verfügen. Einige Basisanwendungen bieten nur den Abgleich von Zeichen für Zeichen (oder den Abgleich von Zeichenketten), während andere auch Regex-Such- und Ersetzungsfunktionen bieten, mit denen Sie Muster in Textdokumenten suchen können und nicht nur exakte Übereinstimmungen mit Zeichenketten.

3. Bereinigung und Standardisierung von Datensätzen

Sie können versuchen, die Informationen bei der Dateneingabe zu validieren, z. B. bei der Übermittlung von Formularen, aber aufgrund der verschiedenen Beschränkungen und Einschränkungen, die in den verschiedenen Systemen auftreten, können Ihre Unternehmensdatensätze immer noch mehrere Darstellungen derselben Informationen enthalten. An dieser Stelle ist es unerlässlich, Datensätze zu bereinigen und zu standardisieren, bevor sie für Routinevorgänge oder BI verwendet werden können.

4. Parsing und Extraktion von Werten

Da der Musterabgleich nach einer bestimmten Zeichenfolge in einem bestimmten Wert sucht, ist dieses Verfahren auch für den Abgleich und die Extraktion von Wert-Tokens nützlich, die sich in erweiterten Informationsformen befinden. Sie können zum Beispiel die Domänen aus einer Liste von geschäftlichen E-Mail-Adressen extrahieren, um herauszufinden, bei welchem Unternehmen die Person arbeitet, oder Sie können die Stadt und das Land des Wohnsitzes aus Adressfeldern extrahieren, die 3-4 Zeilen an Informationen enthalten.

Wie lassen sich Muster abgleichen?

Beim Abgleich und bei der Validierung von Mustern verfolgen die Unternehmen in der Regel zwei Ansätze: Zum einen schreiben sie eigene Code-Skripte, zum anderen verwenden sie Software-Tools von Drittanbietern. Lassen Sie uns die Umsetzung beider Ansätze diskutieren.

1. Mustervergleich mit Code

Wenn es um die Bereinigung und Standardisierung von Daten geht, besteht die Standardlösung für viele Unternehmen darin, benutzerdefinierte interne Anwendungen und Codierungsskripte für verschiedene Standardisierungsvorgänge, einschließlich Musterabgleich und Transformation, zu erstellen. So interessant das auch klingen mag, es kann eine ziemliche Herausforderung sein.

Why in-house data quality projects fail

Read this whitepaper to understand the consequences of ignoring poor data quality, gain insight on why in-house data quality solutions fail and at what costs.

DownloadWerfen wir einen Blick auf einen JavaScript-Codeausschnitt, der E-Mail-Adressen validiert.

| function emailValidation(input) { var regex = /^\w+([.-]?\w+)@\w+([.-]?\w+)(.\w{2,3})+$/; if(input.value.match(regex)) { alert("Valid"); return true;} sonst { alert("Invalid"); return false;} } |

Beachten Sie, dass dieses Codeschnipsel nur die E-Mail-Adressen validiert und sie nicht in ein standardisiertes Muster umwandelt, falls sie ungültig sind. Außerdem wird nur das E-Mail-Adressfeld überprüft, so dass Sie für verschiedene Muster jeweils eine ähnliche Code-Implementierung benötigen. Schließlich ist die Regex zur Überprüfung von E-Mail-Adressen noch etwas einfacher zu entschlüsseln. Wenn es sich um Datenfelder mit komplexen Mustern handelt, können sich Regexe über mehrere Zeilen erstrecken. Der folgende Codeschnipsel findet beispielsweise Musterübereinstimmungen für URLs.

| function URLValidation(input) { var regex = /[-a-zA-Z0-9@:%.+~#=] {1,256}.[a-zA-Z0-9()]{1,6}\b ([-a-zA-Z0-9()@:%+.~#?&//=]*) ?/gi; if(input.value.match(regex)) { alert("Valid"); return true;} sonst { alert("Invalid"); return false;} } |

2. Musterabgleich mit Software-Tools

Aus den oben genannten Gründen kann die Pflege benutzerdefinierter Anwendungen sehr ressourcenintensiv sein. Sie müssen ein Team von internen Entwicklern einstellen, die ständig von Geschäftsanwendern um Fehlerbehebung und Aktualisierung von Codefunktionen gebeten werden.

Aus diesem Grund tendieren viele Manager und leitende Dateningenieure dazu, einfache Tools für die Erstellung, den Abgleich und die Umwandlung von Mustern zu verwenden, die sowohl von IT- als auch von Nicht-IT-Mitarbeitern leicht genutzt werden können.

Solche Mustervergleiche sind mit verschiedenen Funktionen ausgestattet. Die häufigsten Merkmale werden im Folgenden erläutert.

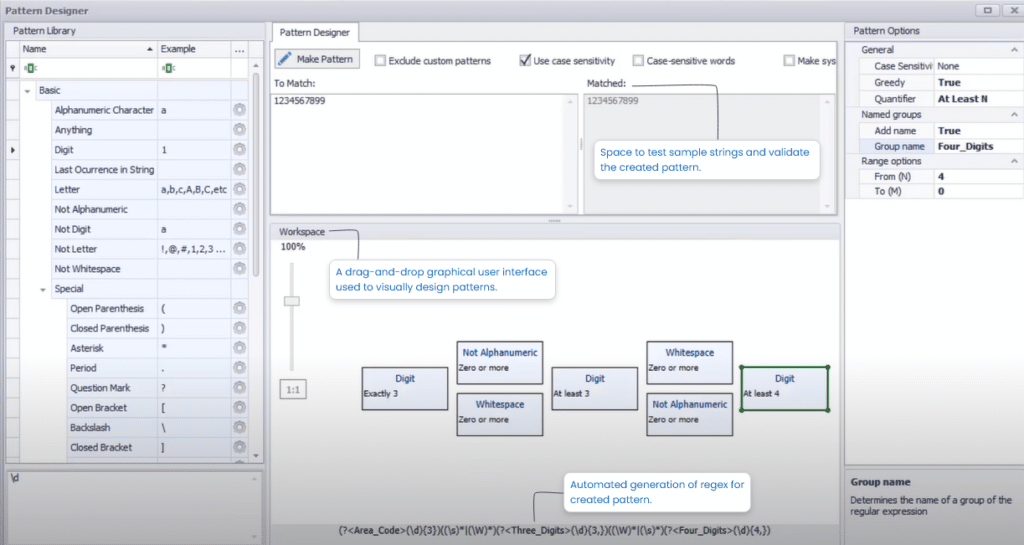

1. Visuelle Musterersteller

Eine visuelle Mustererstellungsfunktion bietet eine grafische Drag-and-Drop-Benutzeroberfläche, die für die Erstellung von Mustern verwendet werden kann. Während ein Benutzer Pattern-Blöcke oder Token im Arbeitsbereich ablegt, wird eine entsprechende Regex im Backend generiert. Diese Funktion macht technische Fachkenntnisse überflüssig und ermutigt auch unbedarfte Benutzer, Muster zu erstellen.

Ein Screenshot des visuellen Musterdesigners in DataMatch Enterprise ist unten abgebildet:

2. Mustervergleich nach Datentyp

Ein weiteres interessantes Merkmal von Tools für den Musterabgleich ist die Möglichkeit, ganze Spalten nach ihren Datentypmustern zu profilieren. So können Sie z. B. die Telefonnummernspalte nach dem ganzzahligen Datentyp profilieren, und der Anteil der Werte, die neben Ziffern auch andere Symbole und Zeichen enthalten, kann als ungültig gekennzeichnet werden. Auf diese Weise lässt sich schnell abschätzen, welcher Standardisierungsaufwand zur Behebung der ungültigen Muster erforderlich ist.

Nachfolgend sehen Sie einen Screenshot der Musterübereinstimmung nach Datentyp in DataMatch Enterprise:

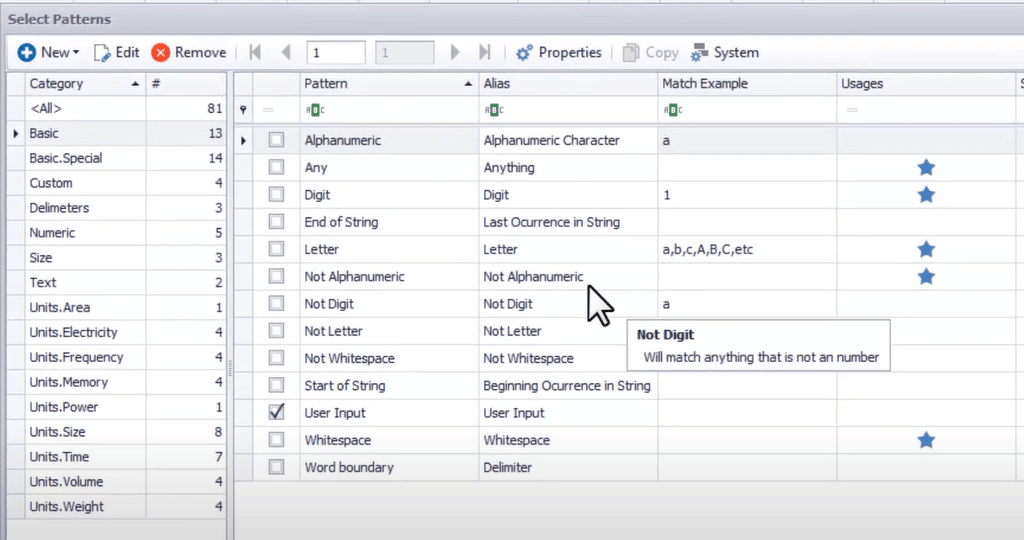

3. Mustervergleich mit der Regex-Bibliothek

Viele Tools verfügen über integrierte Regex-Bibliotheken mit häufig verwendeten Mustern, z. B. Kreditkartennummern, US-Telefonnummern, Datumsformate, E-Mail-Adressen usw. Darüber hinaus können Sie auch benutzerdefinierte Muster (speziell für Ihre geschäftlichen Zwecke) erstellen und in der Bibliothek zur Wiederverwendung speichern.

Ein Bildschirmfoto der Regex-Bibliothek in DataMatch Enterprise ist unten abgebildet:

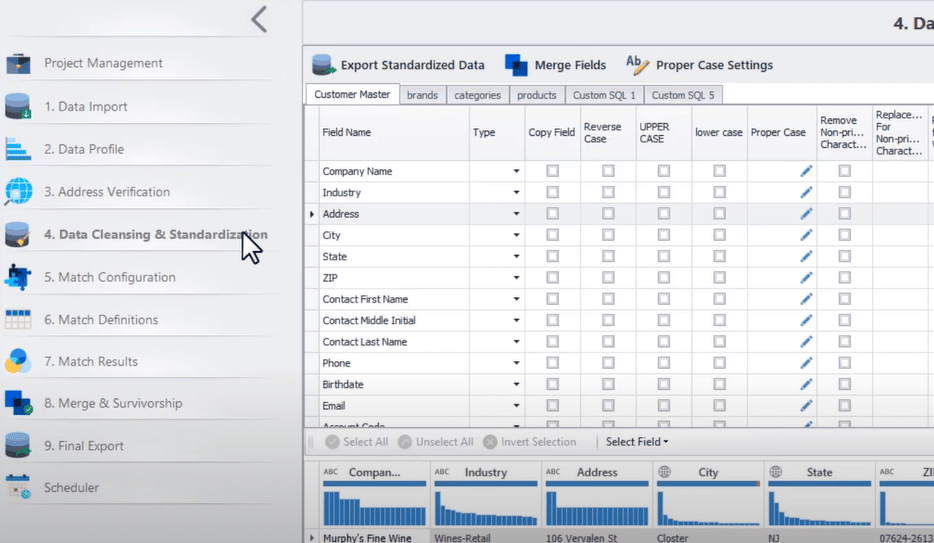

4. Komplettes Datenbereinigungs- und Standardisierungspaket

Einer der größten Vorteile solcher Tools ist, dass sie meist mit anderen Datenbereinigungs- und Standardisierungsfunktionen geliefert werden, die für die Umwandlung Ihrer Daten in eine akzeptable Form und ein akzeptables Format entscheidend sind. Sobald Sie den Bericht zum Musterabgleich haben, der zeigt, welche Datenwerte gültig sind und welche nicht, ist der nächste wichtige Schritt, auch die Muster zu korrigieren.

Aus diesem Grund kann die Einführung eines End-to-End-Systems, das die verschiedenen Disziplinen des Datenqualitätsmanagements – einschließlich Datenprofilierung, -bereinigung, -standardisierung, -abgleich und -zusammenführung – übernimmt, von großem Nutzen sein.

Nachfolgend sehen Sie einen Screenshot der verschiedenen Datenqualitätsfunktionen von DataMatch Enterprise :

Entscheidung für eine codefreie Lösung, die Muster erstellt, abgleicht und umwandelt

Obwohl wir uns in diesem Blog hauptsächlich auf den Musterabgleich konzentriert haben, ist die Kunst der Mustertransformation ebenso interessant – und eine Herausforderung. Aus diesem Grund stellen viele Unternehmen ihren Teams gerne Self-Service-Tools für die Datenbereinigung und -standardisierung zur Verfügung, die über Funktionen für den Entwurf, den Abgleich und die Umwandlung von Mustern verfügen. Mit solchen Tools kann Ihr Team komplexe Datenbereinigungs- und Standardisierungstechniken für Millionen von Datensätzen innerhalb weniger Minuten durchführen.

DataMatch Enterprise ist ein solches Tool, das es den Datenteams erleichtert, Musterfehler schnell und präzise zu korrigieren und sich auf wichtigere Aufgaben konzentrieren zu können. Um mehr darüber zu erfahren, wie DataMatch Enterprise helfen kann, können Sie noch heute eine kostenlose Testversion herunterladen oder eine Demo mit einem Experten buchen.

The post Leitfaden zum Musterabgleich: Was bedeutet er und wie geht er? appeared first on Data Ladder.

]]>The post Leitfaden zur Datenstandardisierung: Arten, Vorteile und Verfahren appeared first on Data Ladder.

]]>Wenn Sie Daten aus verschiedenen Anwendungen im gesamten Unternehmen abrufen, erwarten Sie eine einheitliche Definition und ein einheitliches Format der gleichen Informationen. In der Realität ist dies jedoch selten der Fall. Die Unterschiede in den Datensätzen – über verschiedene Anwendungen hinweg und sogar innerhalb derselben Anwendung – machen es fast unmöglich, Daten für jeden Zweck zu nutzen – von Routinevorgängen bis hin zu Business Intelligence.

Ein durchschnittliches Unternehmen nutzt heute mehrere SaaS- und interne Anwendungen. Jedes System hat seine eigenen Anforderungen, Einschränkungen und Begrenzungen. Aus diesem Grund sind bei Daten, die in verschiedenen Anwendungen gehostet werden, Diskrepanzen vorprogrammiert. Und wenn wir Rechtschreibfehler, Abkürzungen, Spitznamen und Tippfehler in Betracht ziehen, stellen wir fest, dass ein und derselbe Wert Hunderte von verschiedenen Darstellungen haben kann. An dieser Stelle ist es zwingend erforderlich, Daten zu standardisieren, um sie für jeden beabsichtigten Zweck nutzbar zu machen.

In diesem Blog erfahren Sie alles über die Datenstandardisierung: was sie ist, warum und wann Sie sie brauchen und wie Sie sie durchführen können. Fangen wir an.

Was ist Datenstandardisierung?

In der Datenwelt bezieht sich ein Standard auf ein Format oder eine Darstellung, der jeder Wert eines bestimmten Bereichs entsprechen muss. Standardisierung von Daten bedeutet also:

Der Prozess der Umwandlung einer falschen oder inakzeptablen Darstellung von Daten in eine akzeptable Form.

Der einfachste Weg, um herauszufinden, was „akzeptabel“ ist, besteht darin, Ihre geschäftlichen Anforderungen zu verstehen. Im Idealfall müssen Unternehmen sicherstellen, dass das Datenmodell, das von den meisten – wenn nicht sogar allen – Anwendungen verwendet wird, ihren Geschäftsanforderungen entspricht. Der beste Weg zur Standardisierung von Daten ist die Anpassung der Datendarstellung, -struktur und -definition an die organisatorischen Anforderungen.

Arten und Beispiele von Datenstandardisierungsfehlern

Im Folgenden werden einige Beispiele dafür angeführt, wie nicht standardisierte Daten in das System gelangen können:

- Die Telefonnummer des Kunden wird in einem System als Zeichenkette gespeichert, während sie in einem anderen System nur als 8-stellige Zahl zulässig ist, was zu Inkonsistenzen beim Datentyp führt.

- Der Kundenname wird in einem System als ein einziges Feld gespeichert, während er in einem anderen System in drei separaten Feldern für Vor-, Mittel- und Nachnamen erfasst wird, was zu struktureller Inkonsistenz führt.

- Das Geburtsdatum des Kunden hat in einem System das Format MM/TT/JJJ, während es in einem anderen System das Format Monat-Tag-Jahr hat, was zu Formatinkonsistenz führt.

- Das Geschlecht des Kunden wird in einem System als „weiblich“ oder „männlich“ gespeichert, während es in einem anderen System als „F“ oder „M“ gespeichert wird, was zu einer Inkonsistenz der Domänenwerte führt.

Abgesehen von diesen häufigen Szenarien können Rechtschreibfehler, Transkriptionsfehler und fehlende Validierungsbeschränkungen die Datenstandardisierungsfehler in Ihren Datensätzen erhöhen.

Warum müssen Sie Daten standardisieren?

Jedes System hat seine eigenen Beschränkungen und Einschränkungen, die zu einzigartigen Datenmodellen und deren Definitionen führen. Aus diesem Grund müssen Sie die Daten möglicherweise umwandeln, bevor sie von einem Geschäftsprozess korrekt verarbeitet werden können.

Normalerweise wissen Sie, dass es an der Zeit ist, Daten zu standardisieren, wenn Sie dies wollen:

1. Konformität eingehender oder ausgehender Daten

Ein Unternehmen hat viele Schnittstellen, über die Datenpunkte von externen Akteuren, wie z. B. Lieferanten oder Partnern, ausgetauscht werden. Wann immer Daten in ein Unternehmen gelangen oder aus einem Unternehmen exportiert werden, ist es notwendig, die Daten an den erforderlichen Standard anzupassen, da sonst das nicht standardisierte Datenchaos immer größer wird.

2. Daten für BI oder Analytik vorbereiten

Dieselben Daten können auf verschiedene Weise dargestellt werden, aber die meisten BI-Tools sind nicht darauf spezialisiert, alle möglichen Darstellungen von Datenwerten zu verarbeiten, und es kann vorkommen, dass Daten mit derselben Bedeutung unterschiedlich behandelt werden. Dies kann zu verzerrten oder ungenauen BI-Ergebnissen führen. Bevor Sie also Daten in Ihre BI-Systeme einspeisen können, müssen diese bereinigt, standardisiert und dedupliziert werden, damit Sie korrekte, wertvolle Erkenntnisse gewinnen können.

3. Konsolidierung von Einheiten zur Beseitigung von Doppelspurigkeiten

Die Duplizierung von Daten ist eine der größten Gefahren für die Datenqualität, mit der Unternehmen zu kämpfen haben. Für einen effizienten und fehlerfreien Geschäftsbetrieb müssen Sie doppelte Datensätze, die zur selben Entität gehören, eliminieren (sei es für einen Kunden, ein Produkt, einen Standort oder einen Mitarbeiter), und ein effektiver Datendeduplizierungsprozess erfordert die Einhaltung von Datenqualitätsstandards.

4. Datenaustausch zwischen Abteilungen

Damit die Daten zwischen den Abteilungen interoperabel sind, müssen sie in einem Format vorliegen, das für alle verständlich ist. Meistens haben Unternehmen Kundeninformationen in CRMs, die von den Vertriebs- und Marketingmitarbeitern verstanden werden. Dies kann zu Verzögerungen bei der Erledigung von Aufgaben und zu Produktivitätseinbußen im Team führen.

Datenbereinigung versus Datenstandardisierung

Die Begriffe “ Datenbereinigung“ und “ Datenstandardisierung “ werden in der Regel synonym verwendet. Es gibt jedoch einen kleinen Unterschied zwischen den beiden.

Bei der Datenbereinigung werden fehlerhafte oder unsaubere Daten identifiziert und durch korrekte Werte ersetzt, während bei der Datenstandardisierung die Datenwerte von einem inakzeptablen Format in ein akzeptables Format umgewandelt werden.

Zweck und Ergebnis dieser beiden Prozesse sind ähnlich: Sie wollen Ungenauigkeiten und Inkonsistenzen in Ihren Datensätzen beseitigen. Beide Prozesse sind für Ihre Initiative zum Datenqualitätsmanagement unerlässlich und müssen Hand in Hand gehen.

Wie können Daten standardisiert werden?

Ein Datenstandardisierungsprozess besteht aus vier einfachen Schritten: definieren, testen, transformieren und erneut testen. Gehen wir die einzelnen Schritte etwas ausführlicher durch.

1. Definieren Sie eine Norm

In einem ersten Schritt müssen Sie herausfinden, welcher Standard den Anforderungen Ihres Unternehmens entspricht. Der beste Weg, einen Standard zu definieren, ist der Entwurf eines Datenmodells für Ihr Unternehmen. Dieses Datenmodell stellt den idealsten Zustand dar, dem die Datenwerte für eine bestimmte Entität entsprechen müssen. Ein Datenmodell kann wie folgt gestaltet werden:

- Identifizieren Sie die für Ihren Geschäftsbetrieb wichtigen Datenbestände . Die meisten Unternehmen erfassen und verwalten zum Beispiel Daten über Kunden, Produkte, Mitarbeiter, Standorte usw.

- Definieren Sie die Datenfelder jedes identifizierten Vermögenswerts und entscheiden Sie auch über die strukturellen Details. Sie möchten beispielsweise den Namen, die Adresse, die E-Mail-Adresse und die Telefonnummer eines Kunden speichern, wobei sich das Feld „Name“ über drei Felder und das Feld „Adresse“ über zwei Felder erstreckt.

- Weisen Sie jedem im Asset identifizierten Feld einen Datentyp zu. Das Feld „Name“ ist beispielsweise eine Zeichenkette, „Telefonnummer“ ist eine ganze Zahl usw.

- Definieren Sie Zeichengrenzen (Minimum und Maximum) für jedes Feld. Zum Beispiel darf ein Name nicht länger als 15 Zeichen und eine Telefonnummer nicht länger als 8 Ziffern sein, usw.

- Definieren Sie das Muster, dem die Felder entsprechen müssen – dies gilt möglicherweise nicht für alle Felder. Zum Beispiel sollte die E-Mail-Adresse eines jeden Kunden der Regex entsprechen: [chars]@[chars].[chars].

- Definieren Sie das Format, in dem bestimmte Datenelemente in ein Feld eingefügt werden müssen. Das Geburtsdatum eines Kunden sollte zum Beispiel als MM/TD/JJJJ angegeben werden.

- Definieren Sie die Messeinheit für numerische Werte (falls zutreffend). Zum Beispiel wird das Alter des Kunden in Jahren gemessen.

- Definieren Sie den Wertebereich für Felder, die aus einer bestimmten Menge von Werten abgeleitet werden müssen. Zum Beispiel muss das Alter des Kunden eine Zahl zwischen 18 und 50 sein, das Geschlecht muss männlich oder weiblich sein, und so weiter.

Ein entworfenes Datenmodell kann dann in ein ERD-Klassendiagramm eingefügt werden, um den definierten Standard für jeden Datenbestand und dessen Beziehung zueinander zu veranschaulichen. Ein Beispiel für ein Datenmodell für ein Einzelhandelsunternehmen ist unten dargestellt:

2. Test für Standard

Datenstandardisierungstechniken beginnen mit dem zweiten Schritt, da sich der erste Schritt auf die Definition dessen konzentriert, was sein soll – etwas, das einmalig gemacht oder inkrementell überprüft und von Zeit zu Zeit aktualisiert wird.

Sie haben den Standard definiert, und nun ist es an der Zeit zu prüfen, inwieweit die aktuellen Daten mit diesem übereinstimmen. Im Folgenden werden einige Techniken erläutert, mit denen Datenwerte auf Standardisierungsfehler geprüft und ein Standardisierungsbericht erstellt werden kann, der zur Behebung der Probleme verwendet werden kann.

a. Parsing von Datensätzen und Attributen

Der Entwurf eines Datenmodells ist der wichtigste Teil der Datenverwaltung. Doch leider entwerfen viele Unternehmen nicht rechtzeitig Datenmodelle und legen gemeinsame Datenstandards fest, oder die von ihnen verwendeten Anwendungen verfügen nicht über anpassbare Datenmodelle, was dazu führt, dass sie Daten mit unterschiedlichen Feldnamen und Strukturen erfassen.

Wenn Sie Informationen aus verschiedenen Systemen abfragen, stellen Sie vielleicht fest, dass einige Datensätze den Namen eines Kunden als ein einziges Feld zurückgeben, während andere drei oder sogar vier Felder für den Namen eines Kunden zurückgeben. Aus diesem Grund müssen Sie, bevor ein Datensatz auf Fehler geprüft werden kann, zunächst die Datensätze und Felder analysieren, um die Komponenten zu ermitteln, die auf Standardisierung geprüft werden müssen.

b. Bericht zum Gebäudedatenprofil

Der nächste Schritt besteht darin, die geparsten Komponenten durch ein Profiling-System laufen zu lassen. Ein Datenprofilierungstool liefert verschiedene Statistiken über Datenattribute, wie z. B.

- Wie viele Werte in einer Spalte entsprechen dem erforderlichen Datentyp, Format und Muster?

- Wie hoch ist die durchschnittliche Anzahl der Zeichen in einer Spalte?

- Welches sind die meisten Mindest- und Höchstwerte in einer numerischen Spalte?

- Welches sind die häufigsten Werte in einer Spalte und wie oft kommen sie vor?

c. Abgleich und Validierung von Mustern

Obwohl Datenprofilierungstools über Musterübereinstimmungen berichten, werden wir sie etwas ausführlicher besprechen, da sie ein wichtiger Bestandteil der Datenstandardisierungstests sind. Um Muster abzugleichen, müssen Sie zunächst einen regulären Ausdruck für ein Feld definieren, z. B. kann ein regulärer Ausdruck für E-Mail-Adressen lauten: ^[a-zA-Z0-9+_ .-]+@[a-zA-Z0-9 .-]+$. Alle E-Mail-Adressen, die nicht dem vorgegebenen Muster entsprechen, müssen bei der Prüfung markiert werden.

d. Verwendung von Wörterbüchern

Bestimmte Datenfelder können auf Standardisierung geprüft werden, indem die Werte mit Wörterbüchern oder Wissensdatenbanken verglichen werden. Sie können sie auch mit selbst erstellten Wörterbüchern abgleichen. Dies wird oft gemacht, um Rechtschreibfehler, Abkürzungen oder verkürzte Namen zu finden. So enthalten Firmennamen in der Regel Begriffe wie LLC, Inc, Ltd. und Corp. usw. Ein Abgleich mit einem Wörterbuch, das solche Standardbegriffe enthält, kann dabei helfen, festzustellen, welche Begriffe nicht der geforderten Norm entsprechen oder falsch geschrieben sind.

Lesen Sie mehr über die Verwendung von Wordsmith zur Entfernung von Störungen und zur Standardisierung von Daten in großen Mengen.

e. Prüfadressen für die Normung

Beim Testen von Daten für die Standardisierung müssen Sie möglicherweise auch spezielle Felder testen, z. B. Orte oder Adressen. Bei der Adressstandardisierung wird das Format der Adressen mit einer maßgeblichen Datenbank – z. B. dem USPS in den USA – abgeglichen und die Adressdaten in ein akzeptables, standardisiertes Format umgewandelt.

Eine standardisierte Adresse sollte korrekt geschrieben, formatiert, abgekürzt, geokodiert und mit genauen ZIP+4-Werten versehen sein. Alle Adressen, die nicht dem geforderten Standard entsprechen (insbesondere Adressen, die Lieferungen und Sendungen erhalten sollen), müssen gekennzeichnet werden, damit sie bei Bedarf umgestaltet werden können.

Lesen Sie weiter: Eine Kurzanleitung zur Adressennormung und -überprüfung.

Enterprise Content Solutions uses DataMatch Enterprise

Enterprise Content Solutions found 24% higher matches than other vendors for inconsistent address records.

Read case study3. Transformieren

Im dritten Schritt des Datenstandardisierungsprozesses ist es schließlich an der Zeit, die nicht konformen Werte in ein standardisiertes Format umzuwandeln. Dies kann Folgendes beinhalten:

- Umwandlung der Felddatentypen, z. B. Konvertierung der Telefonnummer von einer Zeichenkette in einen Ganzzahldatentyp und Eliminierung von Zeichen oder Symbolen in Telefonnummern, um eine 8-stellige Nummer zu erhalten.

- Umwandlung von Mustern und Formaten, wie z. B. die Konvertierung von Datumsangaben im Datensatz in das Format MM/TT/JJJJ.

- Umwandlung von Maßeinheiten, z. B. Umrechnung von Produktpreisen in USD.

- Erweitern von abgekürzten Werten zu vollständigen Formularen, z. B. Ersetzen der abgekürzten US-Bundesstaaten: NY zu New York, NJ zu New Jersey usw.

- Entfernen von Rauschen in Datenwerten, um aussagekräftigere Informationen zu erhalten, z. B. Entfernen von LLC, Inc. und Corp. aus Firmennamen, um die tatsächlichen Namen ohne Rauschen zu erhalten.

- Rekonstruktion der Werte in einem standardisierten Format für den Fall, dass sie in eine neue Anwendung oder eine Datendrehscheibe, z. B. ein Stammdatenverwaltungssystem, übertragen werden müssen.

Alle diese Transformationen können manuell durchgeführt werden – was zeitaufwändig und unproduktiv sein kann – oder Sie können automatisierte Tools verwenden, die Ihnen bei der Datenbereinigung helfen, indem sie die Standardtest- und Transformationsphasen für Sie automatisieren.

4. Wiederholungsprüfung für Standard

Nach Abschluss des Transformationsprozesses ist es ratsam, den Datensatz erneut auf Standardisierungsfehler zu prüfen. Die Berichte vor und nach der Standardisierung können verglichen werden, um zu verstehen, inwieweit Datenfehler durch die konfigurierten Prozesse behoben wurden und wie sie verbessert werden können, um bessere Ergebnisse zu erzielen.

Verwendung von Self-Service-Tools zur Datenstandardisierung

Heutzutage werden die Daten sowohl manuell eingegeben als auch automatisch erfasst und generiert. Bei der Verarbeitung großer Datenmengen haben Unternehmen mit Millionen von Datensätzen zu kämpfen, die inkonsistente Muster, Datentypen und Formate enthalten. Und wann immer sie diese Daten nutzen wollen, werden die Teams mit stundenlangen manuellen Formatprüfungen und der Korrektur jedes noch so kleinen Details bombardiert, bevor die Informationen als nützlich eingestuft werden können.

Viele Unternehmen haben erkannt, wie wichtig es ist, ihren Teams Self-Service-Tools zur Datenstandardisierung zur Verfügung zu stellen, die auch über integrierte Datenbereinigungsfunktionen verfügen. Mit solchen Tools kann Ihr Team komplexe Datenbereinigungs- und Standardisierungstechniken für Millionen von Datensätzen innerhalb weniger Minuten durchführen.