The post Guía rápida para la normalización y verificación de direcciones appeared first on Data Ladder.

]]>La estandarización de las direcciones es el proceso de actualización e implementación de un estándar o formato en sus datos de direcciones.

Los datos de direcciones deficientes constituyen un complejo reto de calidad de datos que afecta a los clientes, a las empresas e incluso al servicio de correo. La asombrosa cantidad de datos de direcciones deficientes ha obligado a las empresas a invertir en sólidas herramientas de normalización y verificación de direcciones que les ayuden a obtener direcciones validadas por USPS de forma fácil y sin esfuerzo.

Lea mientras le ayudamos a entenderlo:

- El coste de los datos erróneos

- Los problemas con los datos de las direcciones

- Causas de la mala calidad de los datos

- ¿Cómo se estandariza la dirección?

- ¿Qué es la normalización de direcciones CASS?

- ¿Cómo validar una dirección?

- ¿Cómo verificar una dirección con USPS?

- Coincidencia de datos: el reto más importante para la normalización y verificación de direcciones

- Un estudio de caso – E-Ideas Limited

- Estrategias empresariales para mejorar sus datos de dirección

Vamos a sumergirnos de lleno.

El coste de los datos de direcciones erróneas

Cada año se desperdician millones de dólares por culpa de unos datos de direcciones deficientes. El USPS informa de que casi 6.600 millones de piezas de correo no se pudieron entregar solo en 2016. Los carteros gastan más de 20.000 millones de dólares en correo del SAU, mientras que los costes directos para el USPS son de más de 1.500 millones de dólares al año. Todo este coste innecesario se debe simplemente al hecho de que las empresas no tienen acceso a los datos de dirección correctos.

Si hace los cálculos basándose sólo en este coste preliminar, probablemente esté gastando $$$$ sólo en la gestión de los costes del correo de retorno, por no mencionar el coste operativo de verificar la información de los clientes y volver a enviar el paquete.

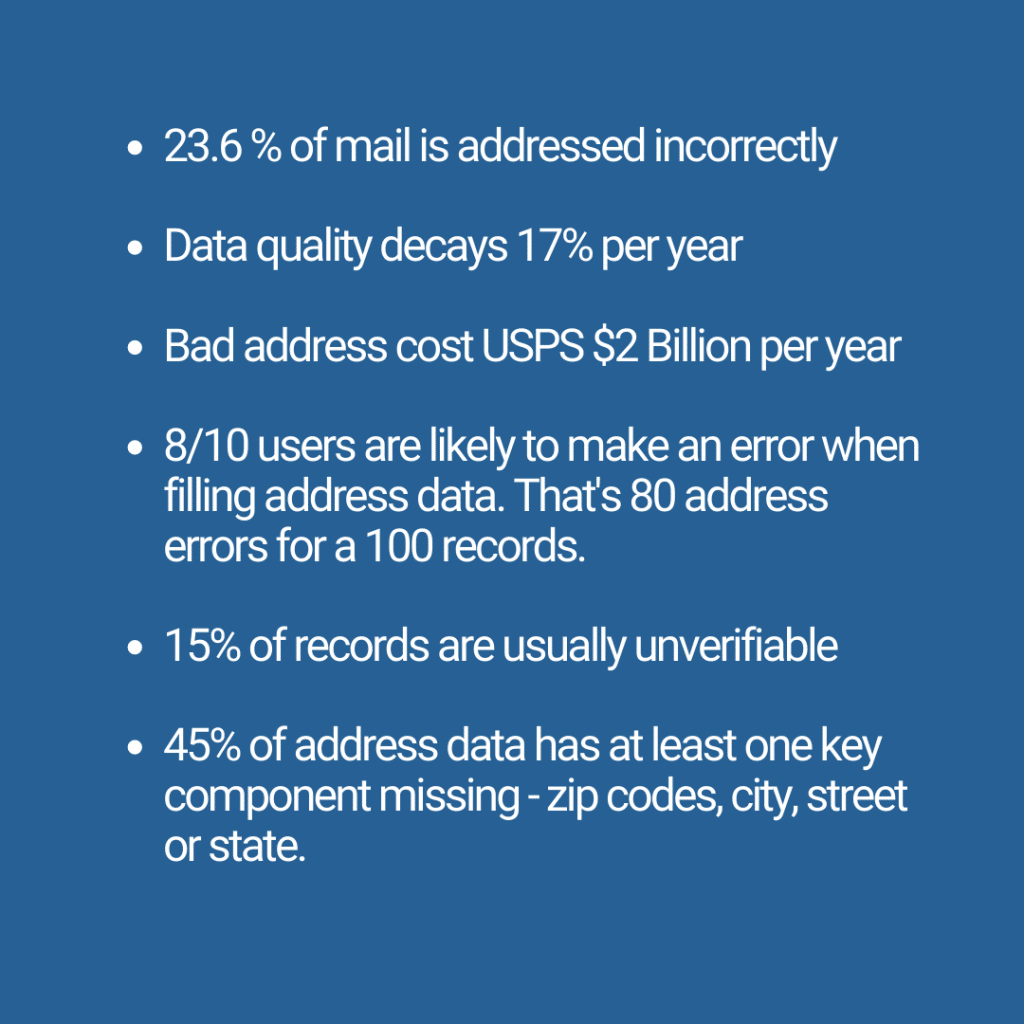

Algunas cifras a tener en cuenta:

Los problemas con los datos de las direcciones

Es de naturaleza humana cometer errores. La mayoría de las veces, los consumidores son poco rigurosos a la hora de facilitar sus datos de dirección en formularios físicos o web. Pueden escribir mal el nombre de un estado, escribir abreviaturas, omitir un número de calle u olvidar su código postal. Es inevitable que se cometan algunos errores y se introduzcan datos incorrectos.

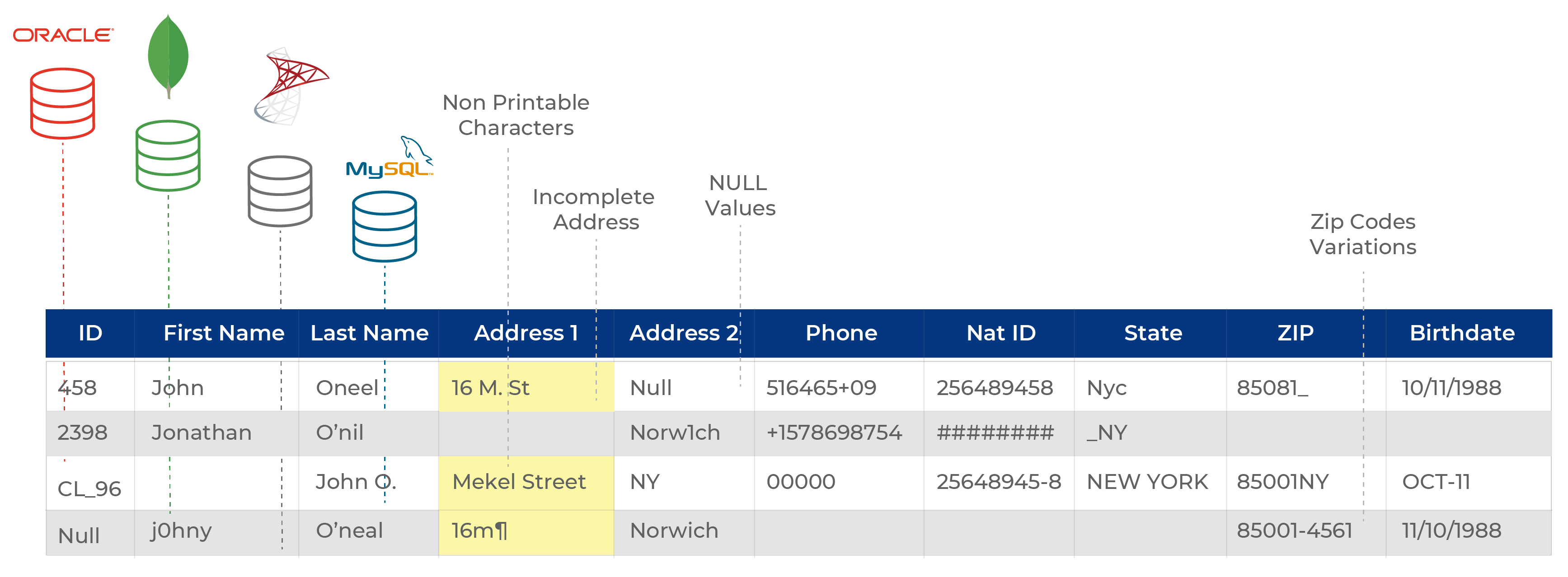

Esta es una imagen de cómo son los típicos datos de direcciones sin estructurar y sin procesar. La falta de datos sobre las direcciones es un reto que provoca una gran tensión en las empresas y sus empleados. Imagínese tener que arreglar estos problemas tan básicos para cada campaña de correo, actividad promocional y cada informe de clientes que tenga que ejecutar. No sólo es alucinantemente frustrante, sino también contraproducente, ya que intentas cotejar y verificar cada dirección para asegurarte de que es exacta y completa. Los científicos de datos y los analistas o usuarios empresariales que necesitan estos datos deben pasar días y meses solucionando estos problemas.

Los datos de las direcciones suelen adolecer de:

- Información incompleta (falta el nombre de la calle, el número de manzana o el código postal)

- Información no válida (direcciones y códigos postales falsos)

- Información incorrecta (errores tipográficos, nombres mal escritos, mal formato como el uso de abreviaturas)

- Información inexacta (números de apartamento o casa inexactos)

Todos estos problemas hacen que los datos de direcciones sean uno de los más difíciles de abordar en una fuente de datos. Además, también aumenta significativamente el coste de las devoluciones de correo, a la vez que dificulta la confianza de una empresa en los datos de las direcciones para tomar decisiones comerciales cruciales.

La mayoría de estos problemas se deben a errores de introducción de datos por parte de los usuarios y a la falta de controles de datos adecuados.

Por ejemplo, algunas personas optarán por escribir sólo el código postal pero no la dirección completa, otras simplemente se olvidarán de escribir el código postal, o algunas escribirán una dirección incompleta. Algunos dan una dirección falsa. Sean cuales sean las razones de los errores de datos, una cosa es cierta: para que una empresa pueda utilizar sus datos, es necesario que éstos estén limpios y sean válidos.

Pero los errores estructurales son sólo una parte del problema de los datos de direcciones erróneas. Otras cuestiones podrían ser:

- Datos de la dirección que son válidos, pero que ya no existen.

- Dirección estructuralmente correcta pero que no pertenece al cliente.

- Dirección que no existe en la base de datos de USPS.

Cuando esta información no se comprueba en la fase de entrada, afecta a toda la correspondencia futura, así como a la relación con ese cliente. Para rectificar esto, las empresas tendrán que dedicar tiempo a llamar a cada cliente para actualizar los datos o hacer que proporcionen de nuevo la información correcta. El problema es que las empresas suelen tener pocos recursos y no es un modo de funcionamiento muy viable.

Al final, todo se reduce a una cosa: los datos deficientes son inevitables, pero se pueden arreglar. Existen muchas herramientas de estandarización de direcciones que ayudan a las empresas a corregir los datos deficientes, corrigiendo los problemas de formato y limpiando los datos desordenados. El proceso lleva menos tiempo, pero puede requerir una curva de aprendizaje y una comprensión básica de la concordancia, el análisis sintáctico y la deduplicación de datos.

Causas de los datos de direcciones erróneas

Los errores humanos son la causa principal, pero no la única, de la mala calidad de las direcciones. Aparte de los retos que plantea la captura de datos precisos, hay muchas más causas de fondo, como:

Decaimiento de la base de datos:

Según la Oficina del Censo, un estadounidense típico se mudará 11,7 veces en su vida. A medida que la vivienda se encarezca y los estadounidenses traten de encontrar zonas adecuadas para vivir, esta cifra aumentará. De ellos, sólo el 60% de los que hacen la mudanza informan al USPS de su traslado a tiempo.

Por lo tanto, las empresas se quedan con datos de direcciones que no están actualizados. Si envían un millón de facturas o folletos promocionales al mes, pueden recibir 90.000 avisos de mudanza en el mismo mes. Y lo que es peor, según este porcentaje, 60.000 de esos millones de clientes no habrán proporcionado la información correcta a USPS a tiempo.

Suponiendo que los mismos clientes sigan con la organización, la empresa tendrá que seguir actualizando su base de datos y asegurarse de que tiene la dirección más reciente para utilizarla.

Mala cultura de los datos:

Hace poco que las empresas están empezando a hablar sobre el uso de los datos, pero esto se limita a la dirección ejecutiva. El empleado en su mesa no es consciente del nivel de problemas de calidad de los datos al que se enfrenta. Además, no hay reglas de negocio a las que atenerse cuando se trata de la calidad de los datos. No hay formación ni educación para que los empleados se orienten hacia los datos y no hay absolutamente ninguna inversión en herramientas de gestión de datos como DataMatch Enterprise, que puede salvar la brecha entre las aplicaciones de TI y la gestión empresarial de los datos.

Fusiones y adquisiciones:

Cuando las empresas migran los datos durante una fusión y adquisición, aumenta la probabilidad de que se produzcan errores en la calidad de los datos. Estas fusiones se producen rápidamente y los problemas son a veces imprevistos. La presión por la consolidación es cada vez mayor, pero no hay control de la calidad; de hecho, rara vez existe un marco de gestión de la calidad.

¿Cómo se hace la normalización de direcciones?

Bien, entonces la definición, ¿cómo se estandarizan los datos?

Pues bien, hay dos maneras de hacerlo: la fácil y la difícil.

El camino difícil incluirá que transportes esos datos a Excel, aplicando fórmulas y filtros para arreglar los datos. No te creas los tutoriales que te dicen que es «superfácil», porque nunca lo es.

Echa un vistazo a este artículo, ya que te enseña cómo corregir errores en Excel. ¿Ves la cantidad de tiempo, esfuerzo y conocimientos técnicos que tendrás que poseer para hacer correcciones básicas de datos? Cuanto más complejos son los problemas, más tiempo se necesita. Si tiene que tratar con millones de filas de datos, la limpieza de datos puede convertirse en su trabajo permanente.

¿La manera fácil?

Utilice un programa de normalización de direcciones. Antes de que descartes la idea, te explicamos por qué.

Obviamente, el software ahorrará mucho tiempo y esfuerzo, pero hace más que eso.

Los registros de datos de direcciones no son simples errores. Como en el ejemplo anterior, tienes miles de filas que tienen problemas. Necesitas una solución que te permita arreglar todos esos problemas de una sola vez.

Si utiliza una solución de las mejores, puede estandarizar los datos:

Evaluación de los errores mediante la elaboración de perfiles de datos: Imagine que puede obtener una visión general consolidada de todo lo que está mal en sus datos de direcciones. Puede ver columnas con caracteres no imprimibles, o columnas con espacios negativos o incluso columnas con letras en campos numéricos. La elaboración de perfiles de datos le permite realizar correcciones con conocimiento de causa. A menos que no sepas qué es lo que está mal, estarás haciendo correcciones en la oscuridad.

Análisis de direcciones para resolver problemas específicos: Parte de la limpieza de direcciones requiere que se analicen o desglosen diferentes partes de las direcciones (ciudad, estado, código postal, etc.) y se fijen en diferentes niveles. Por ejemplo, con DataMatch Enterprise, puede fijar específicamente los códigos postales y asegurarse de que cumple con los códigos postales ZIP+4 o ZIP+6.

Limpieza de datos desordenados: Limpie los problemas de formato, elimine los espacios negativos y los caracteres no imprimibles de una sola vez. Es imperativo limpiar los datos de su dirección y estandarizarlos de acuerdo con las directrices de USPS (ver más abajo) antes de poder verificarlos.

Eliminación de duplicados con coincidencia de datos: La limpieza de datos desordenados es sólo una parte del proceso; la parte más estresante es eliminar los duplicados. Si tiene miles de filas de datos de clientes que no se han ordenado en mucho tiempo, lo más probable es que tenga duplicados y que éstos no siempre sean exactos.

Echa un vistazo a esta tabla:

¿Ves cómo un cliente tiene cinco direcciones diferentes introducidas de múltiples maneras? Ahora bien, esto no es algo que se pueda clasificar fácilmente a menos que se utilice una potente herramienta de calidad de datos.

Supervisión y exportación de datos: Debería poder crear fácilmente un registro maestro y exportarlo como una lista final a su equipo sin tener que copiar/pegar o cargarlo manualmente en un formato aceptable.

Supervisión y exportación de datos: Debería poder crear fácilmente un registro maestro y exportarlo como una lista final a su equipo sin tener que copiar/pegar o cargarlo manualmente en un formato aceptable.

Normalización de direcciones CASS: Cualquier software de normalización de direcciones debe contar con la normalización de direcciones CASS. DataMatch Enterprise, por ejemplo, es una solución de normalización de direcciones certificada por CASS con una base de datos CASS que se actualiza cada mes.

¿Qué es la normalización de direcciones CASS?

Los programas informáticos que corrigen o hacen coincidir las direcciones deben estar certificados por el USPS. Esto se hace a través del sistema de apoyo a la exactitud de la codificación (CASS) que el USPS utiliza para verificar la exactitud del software. La certificación CASS es una licencia para todos los proveedores de software que utilizan el USPS para evaluar la calidad de sus datos de direcciones y mejorar la precisión de la codificación ZIP+4 y de cinco dígitos.

Dado que el USPS actualiza sus datos de direcciones con regularidad, los proveedores de software con certificación CASS deben renovar anualmente su certificación con el USPS. Todos los productos CASS certificados aparecen en el sitio web de USPS.

¿Qué es la directriz de normalización de USPS?

Los proveedores de software de estandarización de datos de direcciones siguen la directriz de estandarización de USPS que requiere que las direcciones tengan un formato como:

Estas son las reglas:

- Ponga siempre la dirección y el franqueo en el mismo lado de su pieza postal.

- En una carta, la dirección debe ser paralela al lado más largo.

- Todo en mayúsculas.

- No hay puntuación.

- Al menos con letra de 10 puntos.

- Un espacio entre la ciudad y el estado.

- Dos espacios entre el estado y el código postal.

- Fuentes tipográficas simples.

- Justificado a la izquierda.

- Tinta negra sobre papel blanco o claro.

- No hay tipo inverso (impresión blanca sobre fondo negro).

- Si su dirección aparece dentro de una ventana, asegúrese de que hay un espacio libre de al menos 1/8 de pulgada alrededor de la dirección. A veces, partes de la dirección se pierden de vista detrás de la ventana y las máquinas de procesamiento de correo no pueden leer la dirección.

- Si utiliza etiquetas de dirección, asegúrese de no cortar ninguna información importante. Asegúrate también de que las etiquetas están bien puestas. Las máquinas de procesamiento de correo tienen problemas para leer la información torcida o inclinada.

La normalización de las direcciones es el requisito previo para una validación eficaz de las mismas. Tiene que asegurarse de que su dirección cumple con la directriz de USPS antes de que sus datos puedan ser verificados con el USPS.

Verificación o validación de la dirección: ¿cuál es la diferencia?

A menudo verá el término «validación y verificación» entremezclado cuando se trata de datos de direcciones. La diferencia es más contextual que léxica. Data Ladder utiliza el término Verificación de Direcciones para verificar las direcciones con la base de datos de USPS. Otras organizaciones verifican las direcciones con los registros de facturación, los permisos de conducir, los extractos bancarios, etc. Ese es un servicio completamente diferente y que la mayoría de las empresas no necesitan.

Otros proveedores utilizanla «Validación de Direcciones», para hacer el mismo cotejo con el USPS para validar los datos del cliente. En el contexto de esta guía, lo mantendremos para la verificación de direcciones.

Normalización y verificación de direcciones – Cómo verificar los datos de las direcciones con el USPS

El proceso de verificación de la dirección es sencillo. Usted coteja sus datos, ahora estandarizados, con la base de datos del gobierno o con cualquier otra norma de la autoridad. Si está en Estados Unidos, el USPS es la única base de datos con la que debería cotejar sus datos.

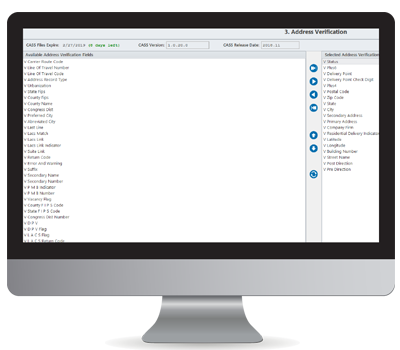

Si sus datos de dirección están limpios y estandarizados, este proceso dura unos minutos. Si utiliza DataMatch Enterprise, puede cotejar toda la dirección o sólo partes de la misma, basándose en 50 elementos activos, incluidas las ubicaciones geocodificadas, lo que significa que puede verificar las direcciones al pie de la letra.

Algunos de los campos más populares contra los que nuestros clientes suelen requerir una verificación incluyen:

-

V Estado – El registro está verificado (Sí/No)

-

V Indicador de entrega residencial – Define si la dirección residencial puede recibir entregas directas en la puerta

-

V Empresa Empresa

-

V Dirección principal

-

V Dirección secundaria

-

V Ciudad

-

V Estado

-

V Código postal – 5 dígitos (USA)

-

V Código postal (Canadá)

-

V Plus4 – 4 dígitos adicionales asociados al código postal de 5 dígitos

Hay 54 campos que puede utilizar para validar sus datos de dirección.

Una vez que coincida con la lista de direcciones con estos componentes, se le dará un valor de retorno que indicará:

- 10 = Dirección Invald

- 11 = Código postal no válido

- 12 = Código de Estado inválido

- 13 = Ciudad inválida

- 21 = Dirección no encontrada

También te aparecerán advertencias como:

-

-

A# ZIP

-

B# Ciudad/Estado Corregido

-

C# Ciudad/estado/código postal no válidos

-

D# Sin ZIP asignado

-

E# ZIP asignado para respuesta múltiple

-

F# No hay ZIP disponible

-

G# Parte de la empresa trasladada a la dirección

-

H# Falta el número secundario

-

I# Datos insuficientes/incorrectos

-

J# Entrada doble

-

Si quieres saber más sobre esto, no dudes en pedirnos una demostración rápida.

Vale, pues a seguir adelante:

Coincidencia de datos: el reto más importante para la normalización y verificación de direcciones

Los clientes que acuden a nosotros siempre tienen una queja: nunca consiguen una buena tasa de coincidencia. Y estamos de acuerdo.

Elcotejo de datos sigue siendo un área de mejora. Hay muy pocos vendedores que puedan dar una tasa de coincidencia del 100%. Realmente necesitas esa cifra, si no, al menos el 95%. La razón es que para que la verificación funcione, su campo de dirección debe encontrar una coincidencia con el USPS. Si la mayoría de las coincidencias no se dan porque el software se basa en coincidencias exactas o deterministas, entonces no va a funcionar a su favor.

Por lo tanto, a la hora de elegir un software de normalización y verificación de direcciones, debe ser capaz de evaluar su tasa de coincidencia de datos. De un centenar de filas, ¿cuántas filas ha pasado por alto la herramienta y por qué? Lo más probable es que vea que el software no detecta las coincidencias cercanas o próximas y se basa únicamente en los caracteres exactos para identificar una coincidencia.

Data Ladder’s DataMatch Enterprise es principalmente una solución de cotejo de datos que ha sido utilizada por instituciones gubernamentales y empresas de Fortune 500 como HP, Coca Cola, Deloitte y muchas otras. Somos conocidos por hacer coincidir los datos con una tasa de precisión del 100%. Esto se debe a que Data Ladder utiliza una combinación de algoritmos de coincidencia difusa y sus algoritmos patentados establecidos para identificar incluso las coincidencias probables más distantes.

P.D. – La comparación de datos requiere muchos recursos. Ahorre tiempo y esfuerzo manual a su equipo. Aprenda a hacerlo en esta detallada entrada del blog.

Este es un estudio de caso que revela lo difícil que es, incluso para un proveedor de datos, garantizar una correspondencia de datos precisa.

Un estudio de caso – E-Ideas Limited

Hablamos con Artem Axenov, director de operaciones de E-Ideas Limited, una agencia de marketing B2B con sede en Wellington. La agencia gestiona una gran base de datos de empresas con fines de marketing, lo que significa que tienen que cuidar mucho los datos de las direcciones, un reto importante que implica mucho trabajo manual en Excel.

1. ¿Cómo afronta su agencia el problema de los datos erróneos?

A menudo tratamos con clientes que ya tienen una lista de clientes, pero los datos están mal formateados. Hay algunas tareas automáticas que puedes hacer para resolverlo pero al final, es un trabajo manual. En primer lugar, tienes que decidir qué formato vas a utilizar. Entonces, la forma más sencilla de arreglar los datos mal formateados es ordenarlos columna por columna y luego hacer los cambios necesarios para que queden bien. Hay algunas fórmulas en Excel que ayudan a dividir o combinar datos – para dividir puedes usar MID y LEFT juntos. Y para combinar datos se puede utilizar CONCATENAR.

Al clasificar los datos en primer lugar, se agrupan los conjuntos de direcciones que tienen los mismos problemas de formato, lo que facilita enormemente su tratamiento de una sola vez.

2. ¿Cómo ha sido su experiencia con las herramientas de verificación y validación de direcciones?

Nuestra experiencia con cualquier tipo de herramienta de validación o verificación de direcciones siempre ha sido desigual. A fin de cuentas, ninguna de las herramientas que hemos utilizado ha logrado producir una alta coincidencia. Y esto se debe a que las formas de almacenar las direcciones son muy diferentes. Son útiles para adelantarse al proceso, pero al final siempre hay una cantidad importante de trabajo manual para terminar el trabajo.

3. ¿Cuál es el problema de concordancia de datos más preocupante?

El principal problema es que, sea cual sea el cotejo automático, si los datos no tienen el formato exacto que la herramienta está programada para identificar, el cotejo no se produce. Esto puede ser tan pequeño como que la calle se registre como St, la avenida como Ave, etc.

4. ¿Qué tipo de tareas manuales tiene que hacer después de utilizar un software de validación de direcciones?

Por lo general, sólo es cuestión de revisar los datos con un ojo humano para detectar cualquier incoherencia y corregirla. En Nueva Zelanda, por ejemplo, el servicio postal tiene un formato muy específico en el que deben mantenerse las direcciones para obtener el descuento por correo masivo. Nada es complicado pero, de nuevo, pequeñas cosas como que la calle se registre como St se contarán en tu contra. Otro ejemplo es si tiene su apartado de correos registrado como P.O. Box – no reconoce esto como correctamente formateado. Incluso los espacios iniciales o finales pueden contar en tu contra, y algunos de ellos son difíciles de detectar porque cuando miras la dirección no puedes ver lo que está mal.

5. ¿Cómo han afectado los datos de direcciones erróneas a su negocio?

Sólo hemos tenido problemas en cuanto a tener que dedicar horas extra para conseguir que los datos estén al día para poder optar al descuento postal. Hay una prueba que tiene que pasar, llamada Declaración de Exactitud, que verifica los datos automáticamente para garantizar que el 80% de ellos están correctamente formateados. Hemos tenido varios casos en los que hemos acabado pasando días más tiempo formateando manualmente los datos para asegurarnos de que están correctamente formateados.

La práctica que hemos implementado ahora es almacenar todos nuestros datos en el formato correcto. Nos ha llevado mucho tiempo conseguir que todo se ajuste a esta norma, pero ahora significa que cuando entregamos los datos a nuestros clientes ya están listos para NZ Post y no hay que hacer más trabajo.

Los problemas de esta agencia con los datos erróneos de las direcciones se traducen en horas de trabajo adicionales que afectan a la eficacia operativa. A pesar del uso de herramientas de cotejo y validación de direcciones, la incapacidad de producir una alta coincidencia hace que sea muy difícil validar los datos de las direcciones. Por lo tanto, es necesario elegir una herramienta que permita al usuario una completa capacidad de preparación y estandarización de los datos y que, al mismo tiempo, devuelva una alta coincidencia. Esto sólo es posible con el mejor software de preparación y cotejo de datos de su clase, como DataMatch Enterprise, que permite al usuario preparar y limpiar los datos de las direcciones al tiempo que devuelve un resultado de alta coincidencia incluso con texto erróneo.

Estrategias empresariales para la gestión de datos de direcciones

Los datos de direcciones erróneas son un problema de calidad de datos. Aunque puede utilizar herramientas para realizar correcciones, tendrá que aplicar estrategias empresariales para frenar los datos erróneos que afectan a los procesos operativos. Algunas de estas estrategias pueden ser:

Formaciones:

El primer paso hacia la calidad es la formación: asegúrese de que las personas que manipulan, interactúan, utilizan e introducen datos conocen el impacto que tienen en el proceso y en las aplicaciones posteriores. Deben comprender las consecuencias de los datos erróneos en toda la organización y no sólo en un miembro o cliente. Los empleados que practican las normas de calidad de datos deben ser recompensados y apreciados.

Lista de herramientas para la gestión de datos:

Es fundamental disponer de herramientas que ayuden a los usuarios de la empresa y a los profesionales de TI a gestionar los datos. Identifique las herramientas que necesita para la limpieza y la gestión de datos para ayudar tanto a los usuarios de TI como a los de la empresa a tener una relación no intimidatoria con los datos.

Implicar a los usuarios de la empresa en el proceso de calidad:

Los datos no son sólo un problema informático. Los usuarios empresariales son igualmente responsables de la gestión de los datos. De hecho, son los únicos propietarios de los datos de los clientes que a menudo se utilizan con fines de marketing y ventas. Por eso es necesario que participen en el proceso y que reciban formación para utilizar las herramientas de gestión de datos.

Gobernanza de los datos:

Establezca un equipo de gobernanza de datos para crear un plan de gestión de datos y asegúrese de que la organización sigue el plan en el que cada empleado entiende el plan. Su regla dentro del plan y las expectativas que vienen junto con el papel.

Bloqueo de datos y roles de usuario:

Si cualquier persona de su equipo puede abrir el CRM o la fuente de datos, trastear con los datos y no dejar ninguna huella, está usted en serios problemas. Es necesario crear titulares de datos maestros que tengan derechos para acceder, introducir o procesar datos críticos. Esto debería venir en el plan de gestión de datos.

No eres una víctima de los malos datos. Sólo hay que aceptar la gravedad de la situación, cultivar una cultura orientada a los datos y esforzarse por gestionar los retos que conlleva la gestión de los mismos. Es muy posible que se obtengan datos que sólo requieran una limpieza básica para ser utilizados.

¿Cómo ayuda DataMatch Enterprise?

Nuestro producto está certificado por CASS, lo que significa que cumplimos y superamos los requisitos de USPS en cuanto a calidad y precisión de las direcciones. También le ayudamos con la coincidencia y validación masiva de direcciones, asegurando que elementos como los códigos postales, los nombres de las ciudades y los pueblos sean verificados y validados. ¿La mejor ventaja de utilizar DataMatch Enterprise de Data Ladder? El programa encuentra y coteja los datos aunque estén incompletos con un índice de precisión del 96%. Además, puede utilizar el software para obtener una verificación de direcciones en tiempo real que garantice que tiene las direcciones correctas en su base de datos.

Mediante algoritmos que determinan una coincidencia basada en áreas de similitud, nuestra plataforma da sentido a los datos inutilizables y deriva conexiones entre conjuntos de datos. Ya sean errores ortográficos o códigos postales incompletos, abreviaturas o erratas. Clasificamos grandes cantidades de datos para ayudarle a darles sentido.

Mediante algoritmos que determinan una coincidencia basada en áreas de similitud, nuestra plataforma da sentido a los datos inutilizables y deriva conexiones entre conjuntos de datos. Ya sean errores ortográficos o códigos postales incompletos, abreviaturas o erratas. Clasificamos grandes cantidades de datos para ayudarle a darles sentido.

Para concluir

Los datos de direcciones erróneas son inevitables, pero eso no significa que deba dejar que afecten al rendimiento de su empresa. Arreglar manualmente los datos de las direcciones le costará más tiempo y esfuerzo, y además no podrá estandarizarlos ni verificarlos a menos que utilice una solución con certificación CASS.

No te ahogues en los datos malos. Estamos aquí para ayudar.

Para ver cómo podemos ayudarle con la estandarización y verificación de direcciones, póngase en contacto con uno de nuestros expertos en soluciones hoy mismo y vea cómo podemos ayudarle a obtener datos de direcciones que pueda utilizar para el fin previsto.

The post Guía rápida para la normalización y verificación de direcciones appeared first on Data Ladder.

]]>The post 8 mejores prácticas para garantizar la calidad de los datos en la empresa appeared first on Data Ladder.

]]>El 2021 de septiembre, Facebook reconoció a tres docenas de investigadores que el conjunto de datos tenía graves errores y se disculpó por el impacto negativo que tuvo en sus investigaciones. Resulta que Facebook no incluyó los datos de la mitad de sus usuarios de EE.UU., ya que estaban menos polarizados políticamente en comparación con los usuarios en general. La portavoz de Facebook explicó que este incidente se debió a un error técnico que había surgido en su conjunto de datos de URLs compartidas.

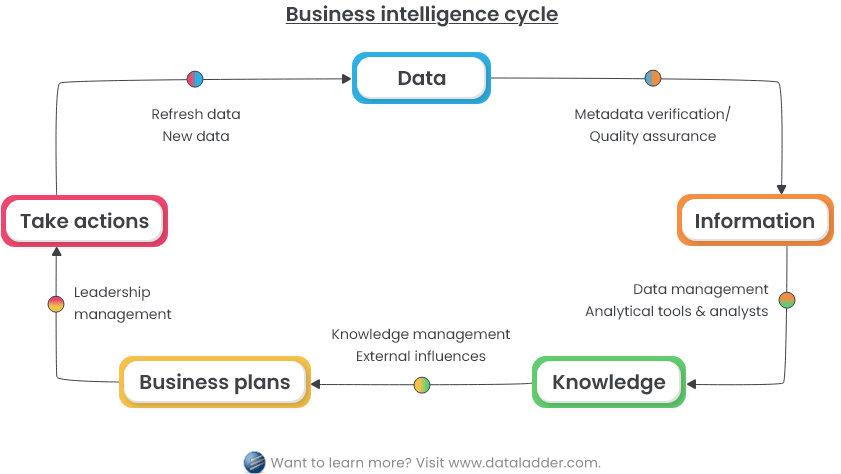

Hoy en día, los datos son sin duda uno de los mayores activos de una organización. Se utiliza en todas partes, desde las operaciones cotidianas de una empresa hasta el impulso de sus iniciativas de inteligencia empresarial, o en el caso de Facebook, facilitando más de 100 investigaciones. Pero la ausencia de técnicas de calidad de datos y de mejores prácticas (que rastreen y solucionen a tiempo los problemas de calidad de datos) puede hacer que una empresa pierda mucho dinero y se arriesgue a quedarse atrás.

En este blog, examinaremos una serie de mejores prácticas y procesos de calidad de datos que pueden ayudar a conseguir una alta calidad de datos a nivel empresarial. Además de destacar lo que se necesita, también mencionaré los elementos procesables que pueden ayudarle a alcanzar ese estado.

Además, las prácticas que se mencionan a continuación darán los mejores resultados si se llevan a cabo de forma sistemática a intervalos regulares en una empresa. Los datos (en su definición y uso) son propensos a cambiar. Por lo tanto, si su empresa revisa constantemente estas prácticas, sin duda podrá conseguir resultados mejores y más duraderos.

Empecemos.

1. Averiguar la relación entre los datos y el rendimiento empresarial

Empezamos con esta práctica porque es la parte más importante y fundamental para permitir la gestión, adopción y uso adecuados de los datos en cualquier organización. En primer lugar, debe comprender cómo los datos contribuyen a sus metas y objetivos empresariales.

¿Qué aspecto tiene?

Esto puede implicar el análisis de la función de los datos a alto nivel (por ejemplo, destacando las áreas en las que se utilizan los datos), así como profundizar en detalles específicos (como el papel de los datos en las operaciones diarias, los procesos empresariales, el intercambio de información entre departamentos, etc.).

Una vez identificado esto, es el momento de plantear esta pregunta: si estos procesos o áreas no fueron facilitados por datos de calidad, ¿qué impacto puede tener en los KPIs resultantes?

Un ejemplo de esta situación es cuando los ejecutivos de nivel C establecen el objetivo de ingresos para el siguiente trimestre basándose en los datos de ventas del último trimestre, pero sólo para descubrir que el conjunto de datos utilizado para predecir el objetivo futuro tenía graves problemas de calidad de datos, lo que hace que su departamento de ventas persiga un valor arbitrario que no tiene ningún significado concreto. La situación resultante tiene un enorme impacto negativo en las operaciones y la reputación de la empresa, como el establecimiento de expectativas poco realistas de los representantes de ventas, la promesa de cifras de ingresos inexactas, etc.

¿Cómo ayuda?

Comprender el papel de los datos en todos los procesos que se llevan a cabo en una empresa permite tener siempre a mano un caso para priorizar los datos y su calidad. De hecho, esto también le ayudará a conseguir la aceptación y la atención necesarias de las partes interesadas, algo que es crucial para realizar y proponer cambios en los procesos existentes.

2. Medir y mantener la definición de la calidad de los datos

Una vez que conozca el impacto de los datos en su negocio, el siguiente paso es lograr la calidad de los datos en todos los conjuntos de datos de su organización. Pero antes de hacerlo, es importante entender la definición de calidad de datos, ya que significa algo diferente para cada empresa.

La calidad de los datos se define como el grado en que los datos cumplen con su propósito. Por lo tanto, para entender el significado de la calidad de los datos en su caso, es necesario saber cuál es el objetivo que se persigue.

¿Qué aspecto tiene?

Para definir la calidad de los datos de su empresa, debe empezar por identificar los:

- Fuentes que generan, almacenan o manipulan datos,

- Atributos almacenados por cada fuente,

- Glosario de metadatos que define cada atributo,

- Criterios de aceptabilidad de los valores de los datos almacenados en los atributos, y

- Métricas de calidad de datos que miden la calidad de los datos almacenados.

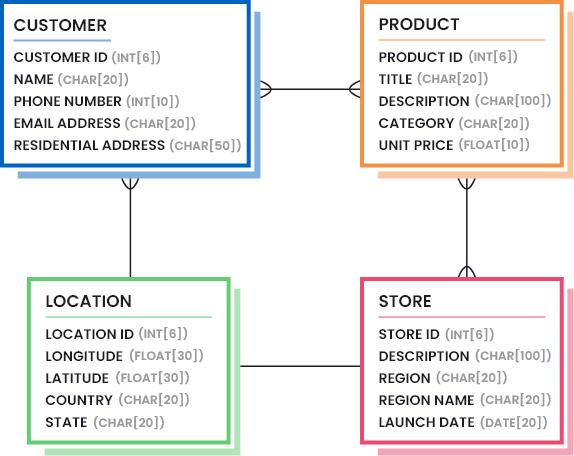

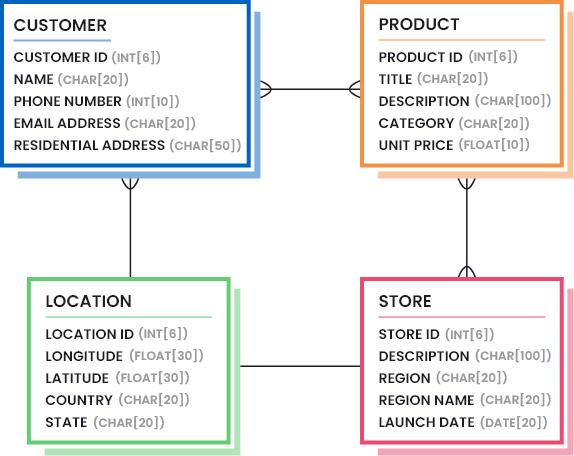

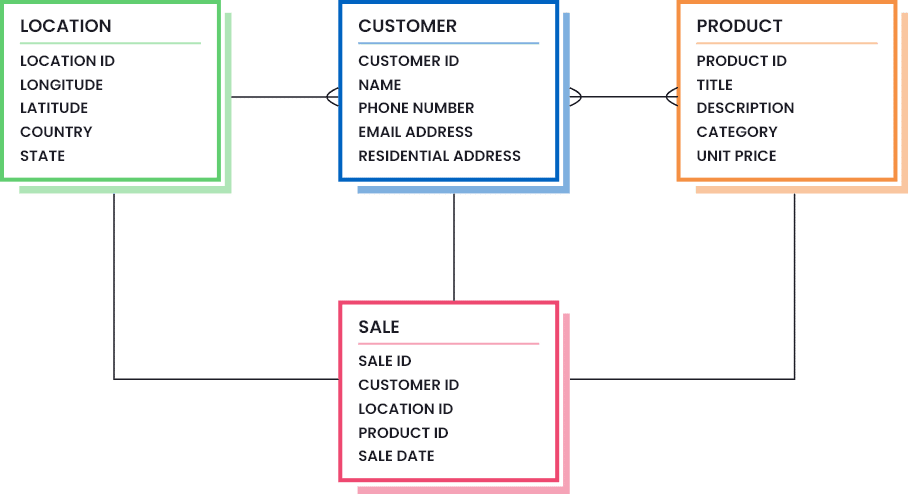

Un ejemplo de definición de la calidad de los datos en su empresa es la elaboración de modelos de datos que destaquen las partes necesarias de los mismos (la cantidad y la calidad de los datos que se consideran suficientemente buenos). Considere la siguiente imagen para entender cómo puede ser un modelo de datos para una empresa minorista:

Por otra parte, además de diseñar modelos de datos, también es necesario identificar métricas de calidad de datos que confirmen la presencia de un nivel de calidad aceptable en sus conjuntos de datos. Por ejemplo, puede exigir que su conjunto de datos sea más preciso y fiable, en lugar de completo.

¿Cómo ayuda?

Una definición estandarizada de la calidad de los datos ayuda a que todas las personas se pongan de acuerdo, de modo que puedan entender qué significa la calidad de los datos, qué aspecto tiene y cómo puede medirse. Esto permite que cada persona entienda y cumpla los requisitos de calidad de los datos.

3. Establecer las funciones y responsabilidades de los datos en toda la organización

Se suele considerar que para garantizar la calidad de los datos a nivel empresarial es necesario que la alta dirección se implique o participe. La verdad es que, más que implicar a determinadas personas en entornos aislados, hay que contratar a personas en los procesos existentes y hacerlas responsables de alcanzar y mantener la calidad de los datos, desde la alta dirección hasta el personal operativo.

¿Qué aspecto tiene?

Algunas de las funciones de datos más comunes e importantes y sus responsabilidades son:

- Chief Data Officer (CDO): representante de los datos en la alta dirección, responsable de diseñar estrategias para garantizar la gestión eficaz de los datos, el seguimiento de la calidad de los datos y su adopción en toda la organización.

- Administrador de datos: controlador de la calidad de los datos, responsable de garantizar la adecuación de los datos a su finalidad y de gestionar los metadatos.

- Líder de datos y análisis (D&A): un jugador de datos, responsable de garantizar la alfabetización de datos en toda la organización, y de permitir que los datos produzcan valor.

¿Cómo ayuda?

Cuando los datos se tratan como la fuente principal que alimenta los procesos empresariales básicos, se produce un cambio en toda la empresa. Aquí es donde la asignación de funciones y responsabilidades en el ámbito de los datos y el hecho de dar a las personas el poder de influir y hablar sobre cuestiones de datos cruciales puede desempeñar un papel importante para garantizar el éxito de la cultura de datos en cualquier organización.

4. Formar y educar a los equipos sobre los datos

En una encuesta realizada a 9.000 empleados que desempeñaban diversas funciones en una organización, sólo el 21% confiaba en sus conocimientos sobre datos.

La introducción de funciones y responsabilidades en materia de datos puede tener un gran impacto positivo en su empresa, pero aún así, es crucial tener en cuenta que en un lugar de trabajo moderno, cada individuo genera, manipula o trata con datos en sus operaciones diarias. Por ello, tan importante como responsabilizar a determinadas personas de la aplicación de medidas correctoras, es igualmente necesario formar y educar a todos los equipos en el manejo de los datos de la organización.

¿Qué aspecto tiene?

Esto puede implicar la creación de planes de alfabetización de datos y el diseño de cursos que introduzcan a los equipos en los datos de la organización y los expliquen:

- Lo que contiene,

- Qué significa cada atributo de los datos,

- Cuáles son los criterios de aceptabilidad de su calidad,

- ¿Cuál es la forma correcta e incorrecta de introducir/manipular datos?

- ¿Qué datos utilizar para conseguir un determinado resultado?

Además, estos cursos pueden crearse en función de la frecuencia con la que determinados roles utilizan los datos (diaria, semanal o anualmente).

¿Cómo ayuda?

La capacidad de leer, comprender y analizar los datos de forma correcta y precisa en todos los niveles permite a cada empleado formular las preguntas adecuadas, y de la forma más optimizada. También garantiza la eficacia operativa de su personal y reduce los errores al comunicar asuntos relacionados con los datos.

5. Supervisar continuamente el estado de los datos mediante la elaboración de perfiles de datos

Lograr la calidad de los datos y mantenerla en el tiempo son dos cosas diferentes. Por eso es necesario aplicar un proceso sistemático que supervise continuamente el estado de los datos y los perfile para descubrir detalles ocultos sobre su estructura y contenido.

El alcance y el proceso de la actividad de elaboración de perfiles de datos pueden establecerse en función de la definición de la calidad de los datos en su empresa y de cómo se mide.

¿Qué aspecto tiene?

Esto puede lograrse configurando y programando informes de perfil de datos diarios/semanales. Además, puede diseñar flujos de trabajo personalizados para alertar a los administradores de datos de su empresa en caso de que la calidad de los datos caiga por debajo de un umbral aceptable.

Un informe sobre el perfil de los datos suele poner de relieve una serie de aspectos sobre los conjuntos de datos examinados, por ejemplo:

- El porcentaje de valores de datos faltantes e incompletos,

- El número de registros que son posibles duplicados entre sí,

- Evaluación de los tipos, tamaños y formatos de los datos para descubrir valores de datos no válidos,

- Análisis estadístico de columnas de datos numéricos para evaluar las distribuciones.

¿Cómo ayuda?

Esta práctica le ayuda a detectar los errores de datos en una fase temprana del proceso y evita que lleguen a los clientes. Además, puede ayudar a los responsables de datos a estar al tanto de la gestión de la calidad de los datos y a tomar las decisiones correctas, como por ejemplo cuándo y cómo solucionar los problemas que se destacan en los perfiles de datos.

Más información sobre la elaboración de perfiles de datos: Alcance, técnicas y retos.

6. Diseñar y mantener canales de datos para lograr una única fuente de verdad

Una canalización de datos se refiere a un proceso sistemático que ingiere datos desde una fuente, realiza las técnicas de procesamiento y transformación necesarias en los datos y luego los carga en un repositorio de destino.

Es fundamental que los datos brutos pasen por una serie de comprobaciones de validación antes de que puedan considerarse utilizables y ponerse a disposición de todos los usuarios de la organización.

¿Qué aspecto tiene?

Para construir un pipeline de datos, hay que volver a la práctica#02 que mencionamos en este blog: Definir y mantener la definición de la calidad de los datos. Y de acuerdo con esa definición, hay que decidir la lista numerada de operaciones que deben realizarse con los datos entrantes para alcanzar el nivel de calidad definido.

Una lista de ejemplos de operaciones que se pueden realizar dentro de su canalización de datos incluye:

- Sustituir los valores nulos o vacíos por un término estándar, como «No disponible».

- Transformar los valores de los datos según el patrón y el formato definidos.

- Parsear campos en dos o más columnas.

- Sustituir las abreviaturas por palabras adecuadas.

- Sustituir los apodos por nombres propios.

- En caso de que se sospeche que el registro entrante es un posible duplicado, se fusiona con el registro existente, en lugar de crearlo como uno nuevo.

¿Cómo ayuda?

Una canalización de datos actúa como un cortafuegos de calidad de datos para sus conjuntos de datos organizativos. El diseño de una canalización de datos ayuda a garantizar la coherencia de los datos en todas las fuentes y elimina cualquier discrepancia que pueda existir, incluso antes de que los datos se carguen en la fuente de destino.

7. Realizar un análisis de la causa raíz de los errores de calidad de los datos

Hasta ahora, nos hemos centrado sobre todo en cómo hacer un seguimiento de la calidad de los datos y evitar que los errores de calidad de los datos se introduzcan en los conjuntos de datos, pero la verdad es que, a pesar de todos estos esfuerzos, es probable que algunos errores acaben en el sistema. No sólo tendrá que solucionarlos, sino que lo más importante es entender cómo se produjeron esos errores para poder prevenirlos.

¿Qué aspecto tiene?

Un análisis de la causa raíz de los errores de calidad de los datos puede implicar la obtención del último informe sobre el perfil de los datos y la colaboración con su equipo para encontrar respuestas a preguntas como:

- ¿Qué errores de calidad de datos se han encontrado?

- ¿De dónde proceden?

- ¿Cuándo se originaron?

- ¿Por qué han acabado en el sistema a pesar de todos los controles de validación de la calidad de los datos? ¿Nos hemos perdido algo?

- ¿Cómo podemos evitar que estos errores vuelvan a aparecer en el sistema?

¿Cómo ayuda?

Llegar al núcleo de los problemas de calidad de los datos puede ayudar a eliminar los errores a largo plazo. No hay que trabajar siempre con un enfoque reactivo y seguir corrigiendo los errores a medida que surgen. Con un enfoque proactivo, puede permitir a sus equipos minimizar sus esfuerzos en la corrección de errores de calidad de datos, y dejar que los procesos refinados de calidad de datos se encarguen del 99% de los problemas asociados a los datos.

8. Utilizar la tecnología para conseguir y mantener la calidad de los datos

Esto nos lleva a nuestra última mejor práctica: utilizar la tecnología para lograr un ciclo de vida de gestión de calidad de datos sostenible. No se promete que ningún proceso funcione bien, ni que ofrezca el mejor rendimiento de la inversión, si no se automatiza y optimiza mediante la tecnología.

¿Qué aspecto tiene?

Invierta en la adopción de un sistema tecnológico que cuente con todas las funcionalidades que necesita para garantizar la calidad de los datos en todos los conjuntos de datos. Estas características incluyen la capacidad de:

- Importación de datos: Ingesta de datos de múltiples fuentes,

- Perfil de los datos: Evaluar los datos para generar informes de calidad de datos,

- Limpieza de datos: Destaca las posibles áreas que requieren limpieza, estandarización y transformación de datos, e implementa correcciones,

- Cotejo de datos: Haga coincidir los datos utilizando algoritmos de cotejo exactos y difusos con un alto nivel de precisión, así como ajustando los algoritmos según la naturaleza de sus datos,

- Deduplicación de datos: Vincule los registros y encuentre la única fuente de verdad,

- Exportación de datos: Exportación/carga de resultados.

Además de las funciones de gestión de la calidad de los datos mencionadas anteriormente, algunas organizaciones invierten en tecnologías que ofrecen también capacidades de gestión centralizada de datos. Un ejemplo de este sistema es la gestión de datos maestros (MDM). Aunque un MDM es una solución completa de gestión de datos que incluye funciones de calidad de datos, no todas las organizaciones necesitan la extensa lista de funciones que conlleva un sistema de este tipo.

Tiene que entender los requisitos de su negocio para evaluar qué tipo de tecnología es la decisión correcta para usted. Puede leer este blog para conocer las principales diferencias entre una solución MDM y DQM.

¿Cómo ayuda?

Son numerosas las ventajas de utilizar la tecnología para la aplicación de procesos que deben repetirse constantemente para lograr resultados duraderos. Proporcionar a su equipo herramientas de gestión de la calidad de los datos de autoservicio puede aumentar la eficiencia operativa, eliminar la duplicación de esfuerzos, mejorar la experiencia del cliente y obtener información empresarial fiable.

Conclusión:

La aplicación de medidas de calidad de datos coherentes, automatizadas y repetibles puede ayudar a su organización a alcanzar y mantener la calidad de los datos en todos los conjuntos de datos.

Data Ladder lleva más de una década ofreciendo soluciones de calidad de datos a sus clientes. DataMatch Enterprise es uno de sus principales productos de calidad de datos -disponible como aplicación independiente y como API integrable- que permite la gestión de la calidad de los datos de principio a fin, incluida la elaboración de perfiles de datos, la limpieza, la correspondencia, la deduplicación y la purga de fusiones.

Puede descargar la versión de prueba gratuita hoy mismo o programar una sesión personalizada con nuestros expertos para entender cómo nuestro producto puede ayudar a implementar las mejores prácticas para alcanzar y mantener la calidad de los datos a nivel empresarial.

The post 8 mejores prácticas para garantizar la calidad de los datos en la empresa appeared first on Data Ladder.

]]>The post Guía de concordancia de patrones: ¿Qué significa y cómo hacerlo? appeared first on Data Ladder.

]]>Encontrar patrones es fácil en cualquier tipo de entorno rico en datos; eso es lo que hacen los jugadores mediocres. La clave está en determinar si los patrones representan señal o ruido.

Nate Silver

Cualquiera que trabaje con datos entiende la importancia de los patrones. Tanto si se analizan grandes conjuntos de datos de forma holística como si se profundiza en el valor más granular, los patrones están en todas partes. Pueden ser universales -como el patrón de un número de tarjeta de crédito- o pueden ser exclusivos de su empresa, por ejemplo el patrón utilizado para mostrar la información de los productos en su sitio web.

Cuando se capturan los datos, no siempre siguen el patrón correcto. Las empresas tienen que aplicar diferentes métodos de cotejo, validación y transformación de patrones para obtener los datos en la forma y el formato requeridos.

En este blog, aprenderemos algunos conceptos importantes relacionados con la coincidencia de patrones y la validación, como por ejemplo

- ¿Qué significa la concordancia de patrones?

- ¿En qué se diferencia la concordancia de patrones de la concordancia de cadenas?

- ¿Cómo funciona la concordancia de patrones?

- ¿Cuáles son las razones más comunes para cotejar y validar patrones?

- ¿Cómo puede transformar sus datos en el patrón que necesita?

Vamos a sumergirnos.

¿Qué es la concordancia de patrones?

Un patrón se percibe como algo opuesto al desorden o al caos. Se trata de un modelo repetitivo que puede ser identificado a través de un gran conjunto de valores de datos pertenecientes al mismo dominio. Por lo tanto, la coincidencia de patrones puede definirse como:

Proceso de búsqueda de una secuencia o colocación específica de caracteres en un conjunto de datos determinado.

La concordancia de patrones produce resultados definitivos: la cadena de entrada contiene el patrón (es válida) o no lo contiene (es inválida). En caso de que la cadena no contenga el patrón requerido, el proceso de coincidencia suele ampliarse a la transformación de patrones, en la que se extraen subelementos de datos del valor de entrada y se reformulan para construir el patrón requerido.

Coincidencia de patrones frente a coincidencia de cadenas

Antes de hablar de cómo funcionan los algoritmos de concordancia de patrones, es importante entender su relación con los algoritmos de concordancia de cadenas. Ambos conceptos se tratan a menudo como la misma cosa, pero son bastante diferentes en su propósito y uso. El siguiente cuadro destaca algunas de las principales diferencias:

| Coincidencia de patrones | Coincidencia de cadenas | |

| Comparación | Compara una cadena con un patrón estándar que representa bloques o fichas de caracteres. | Compara dos cadenas carácter por carácter. |

| Ejemplo | Comparando [email protected] con [name]@[domain].[domain-extension]. | Comparando a Elizabeth con Alizabeth. |

| Resultados | Calcula los resultados definitivos: o se encuentra el patrón o está ausente. | Calcula las coincidencias exactas (coincidencia de polvo con polvo) o difusas (coincidencia de polvo con óxido). |

| Utiliza | Se utiliza para analizar y extraer valores o transformar valores para que sigan patrones estándar. | Se utiliza para corregir las faltas de ortografía, detectar el plagio e identificar los valores que tienen un significado o una composición de caracteres similar. |

¿Cómo funciona la concordancia de patrones?

En pocas palabras, los algoritmos de concordancia de patrones funcionan con expresiones regulares (o regex). Para entender lo que es una expresión regular, piense en ella como un lenguaje que le ayuda a definir un patrón y a compartirlo con alguien, o en nuestro caso, con un programa informático.

Las expresiones regulares indican a los programas informáticos qué patrón deben buscar en los datos de las pruebas. A veces, el programa es lo suficientemente inteligente como para recoger patrones de un conjunto de valores de datos y generar automáticamente una regex. Algunos programas o herramientas tienen una biblioteca regex incorporada que contiene patrones de uso común, como número de tarjeta de crédito, números de teléfono de Estados Unidos, formatos de fecha, direcciones de correo electrónico, etc.

Ejemplo de patrón de dirección de correo electrónico coincidente

Para saber qué es un algoritmo de concordancia de patrones, tomemos el ejemplo de la validación del patrón de las direcciones de correo electrónico. El primer paso es definir la regex que comunica el patrón de una dirección de correo electrónico válida. Un patrón de muestra de una dirección de correo electrónico válida puede ser el siguiente:

[name]@[domain].[domain-extension]

En el lenguaje regex, este patrón se traducirá como

^[\w-.]+@([\w-]+.)+[\w-]{2,3}$

Dónde,

- ^ significa el comienzo de una frase y $ el final.

- [Se trata de una palabra que contiene caracteres alfanuméricos, un guión bajo, un guión o un punto.

- +@ implica la adición de un símbolo @.

- ([\w-]+.) significa una palabra que contiene caracteres alfanuméricos, guiones bajos o guiones, y termina con un punto.

- +[\w-]{2,3} significa una palabra que contiene caracteres alfanuméricos o un guión, y esa palabra sólo puede tener al menos dos y como máximo 3 caracteres.

A continuación, puede ver una serie de direcciones de correo electrónico de prueba que se ejecutan a través de este patrón regex y los resultados producidos.

| No. | Prueba | Resultado | Motivo del fracaso |

| 1. | [email protected] | Válido | |

| 2. | pam.beesly_gmail.com | Inválido | Falta el símbolo @. |

| 3. | [email protected] | Inválido | El dominio tiene un punto final inesperado. |

| 4. | [email protected] | Inválido | La extensión del dominio tiene más de 3 caracteres (por ejemplo, com4). |

Es obvio que definir manualmente las expresiones regulares es tedioso y requiere cierta experiencia. También puede optar por herramientas de normalización de datos que ofrezcan diseñadores de regex visuales (más sobre esto en una sección posterior).

Casos de uso de la concordancia de patrones

Ahora que sabemos qué es la concordancia de patrones y cómo funciona el algoritmo, puede que se pregunte dónde se utiliza exactamente. La concordancia de patrones es uno de los conceptos más fundamentales en diferentes campos, como la programación informática, la ciencia y el análisis de datos, el procesamiento del lenguaje natural, etc.

Si hablamos específicamente de la concordancia de patrones y de la validación en el campo de los datos, he aquí algunas de sus aplicaciones más comunes:

1. Validación de los envíos de formularios

Como la concordancia de patrones de datos distingue entre información válida y no válida, se utiliza sobre todo para validar los formularios enviados en sitios web u otras aplicaciones de software. La regex se aplica en los campos del formulario según sea necesario; a continuación se ofrecen algunos ejemplos de validaciones:

- El nombre de una persona sólo contiene alfabetos o símbolos,

- La dirección de correo electrónico sigue el patrón correcto,

- El número de teléfono sólo contiene dígitos,

- El número de la tarjeta de crédito no tiene más de 16 dígitos, etc.

2. Realización de operaciones de búsqueda y sustitución

La concordancia de patrones también es útil en aplicaciones que tienen funciones de búsqueda y sustitución de información textual. Algunas aplicaciones básicas sólo ofrecen la coincidencia carácter por carácter (o coincidencia de cadenas), mientras que otras también ofrecen la función de búsqueda y sustitución regex, que permite buscar patrones en documentos de texto y no sólo coincidencias exactas de cadenas.

3. Limpieza y normalización de los conjuntos de datos

Se puede intentar validar la información en el momento de la entrada de datos, como el envío de formularios, pero debido a las diversas limitaciones y restricciones que se encuentran en los sistemas, los conjuntos de datos de la organización pueden acabar con múltiples representaciones de la misma información. Aquí es donde se hace imperativo limpiar y estandarizar los conjuntos de datos antes de que puedan ser utilizados para operaciones rutinarias o de BI.

4. Análisis y extracción de valores

Dado que la concordancia de patrones busca una secuencia específica de caracteres en un valor determinado, este proceso también es útil para emparejar y extraer tokens de valores que residen en formas extendidas de información. Por ejemplo, puede querer extraer los dominios de una lista de direcciones de correo electrónico de empresas para averiguar en qué compañía trabaja la persona, o puede extraer la ciudad y el país de residencia de los campos de dirección que contienen 3-4 líneas de información.

¿Cómo hacer coincidir los patrones?

Las empresas suelen adoptar dos enfoques a la hora de cotejar y validar patrones: uno es escribir scripts de código interno y el otro es utilizar herramientas de software de terceros. Analicemos la aplicación de ambos enfoques.

1. Comparación de patrones mediante código

Cuando se trata de limpiar y estandarizar datos, la solución por defecto de muchas organizaciones es crear aplicaciones internas personalizadas y codificar scripts para diversas operaciones de estandarización, incluyendo la coincidencia de patrones y la transformación. Aunque parezca interesante, puede ser todo un reto.

Why in-house data quality projects fail

Read this whitepaper to understand the consequences of ignoring poor data quality, gain insight on why in-house data quality solutions fail and at what costs.

DownloadVeamos un fragmento de código JavaScript que valida las direcciones de correo electrónico.

| function emailValidation(input) { var regex = /^\w+([.-]?\w+)@\w+([.-]?\w+)(.\w{2,3})+$/; if(input.value.match(regex)) { alert("Valid"); return true;} si no { alert("Invalid"); return false;} } |

Tenga en cuenta que este fragmento de código sólo valida las direcciones de correo electrónico y no las transforma en un patrón estandarizado en caso de que no sean válidas. Además, sólo valida el campo de la dirección de correo electrónico, por lo que para hacer coincidir diferentes patrones, se necesita una implementación de código similar para cada uno. Por último, la regex que valida las direcciones de correo electrónico sigue siendo un poco más fácil de descifrar. Si consideramos los campos de datos que tienen patrones complejos, las expresiones regulares pueden abarcar varias líneas. Por ejemplo, el siguiente fragmento de código busca coincidencias de patrones para las URL.

| function URLValidation(input) { var regex = /[-a-zA-Z0-9@:%.+~#=] {1,256}.[a-zA-Z0-9()]{1,6}\b ([-a-zA-Z0-9()@:%+.~#?&//=]*) …/gi; if(input.value.match(regex)) { alert("Valid"); return true;} si no { alert("Invalid"); return false;} } |

2. Comparación de patrones mediante herramientas informáticas

Por las razones mencionadas anteriormente, el mantenimiento de las aplicaciones personalizadas puede consumir muchos recursos. Requiere la contratación de un equipo de desarrolladores internos a los que los usuarios de la empresa se dirigen constantemente con peticiones de depuración y actualización de la funcionalidad del código.

Por ello, muchos directivos e ingenieros de datos de alto nivel se inclinan por la idea de adoptar herramientas sencillas para construir, cotejar y transformar patrones que puedan ser utilizadas fácilmente tanto por el personal de TI como por el que no lo es.

Dichos comparadores de patrones están empaquetados con diferentes características. A continuación se comentan las características más comunes.

1. Creadores de patrones visuales

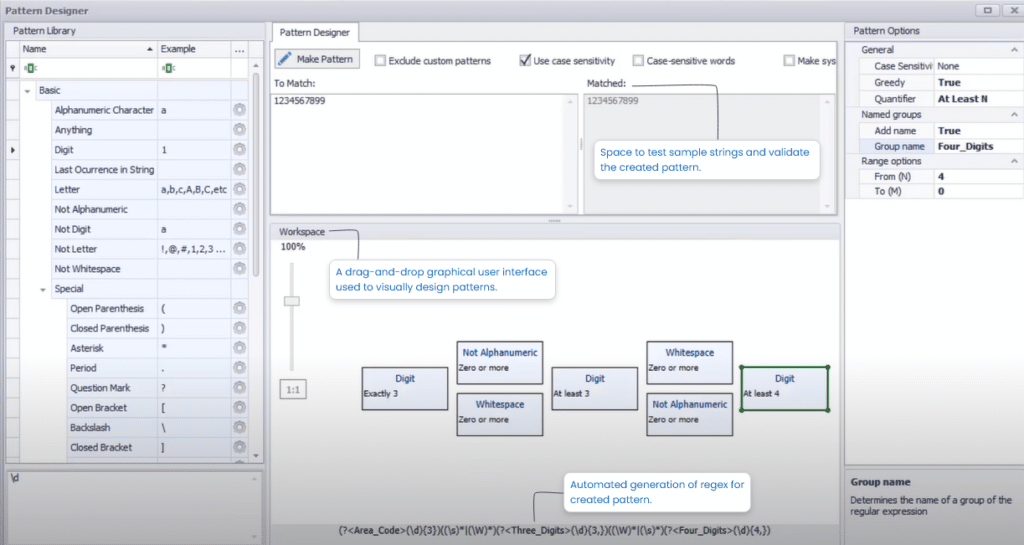

La función de creación de patrones visuales ofrece una interfaz gráfica de usuario de arrastrar y soltar que puede utilizarse para crear patrones. Mientras un usuario suelta bloques de patrones o tokens en el espacio de trabajo, se genera una regex equivalente en el backend. Esta característica elimina la necesidad de conocimientos técnicos y anima a los usuarios ingenuos a construir también patrones.

A continuación se muestra una captura de pantalla del diseñador de patrones visuales en DataMatch Enterprise:

2. Coincidencia de patrones por tipo de datos

Otra característica interesante de las herramientas de concordancia de patrones es la capacidad de perfilar columnas enteras por sus patrones de tipos de datos. Por ejemplo, puede perfilar la columna del número de teléfono por el tipo de datos entero, y la fracción de valores que contienen otros símbolos y caracteres además de los dígitos puede marcarse como no válida. Esto puede hacerse para obtener una evaluación rápida sobre el esfuerzo de normalización necesario para arreglar los patrones no válidos.

A continuación se muestra una captura de pantalla de los patrones de coincidencia por tipo de datos en DataMatch Enterprise:

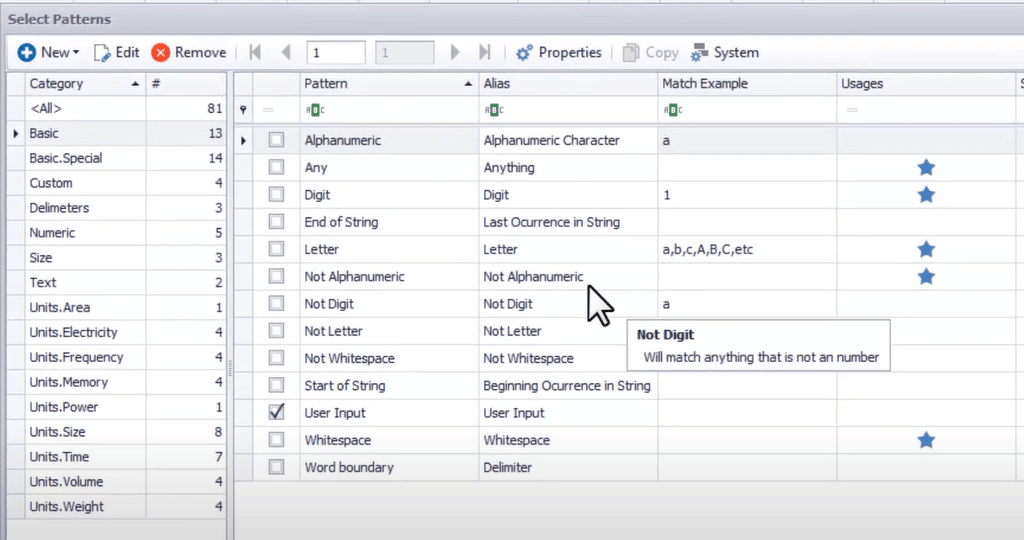

3. Coincidencia de patrones mediante la biblioteca regex

Muchas herramientas vienen con bibliotecas regex incorporadas llenas de patrones de uso común, como números de tarjetas de crédito, números de teléfono de Estados Unidos, formatos de fecha, direcciones de correo electrónico, etc. Además, también puede crear patrones personalizados (especializados para su uso empresarial) y guardarlos en la biblioteca para reutilizarlos.

A continuación se muestra una captura de pantalla de la biblioteca regex en DataMatch Enterprise:

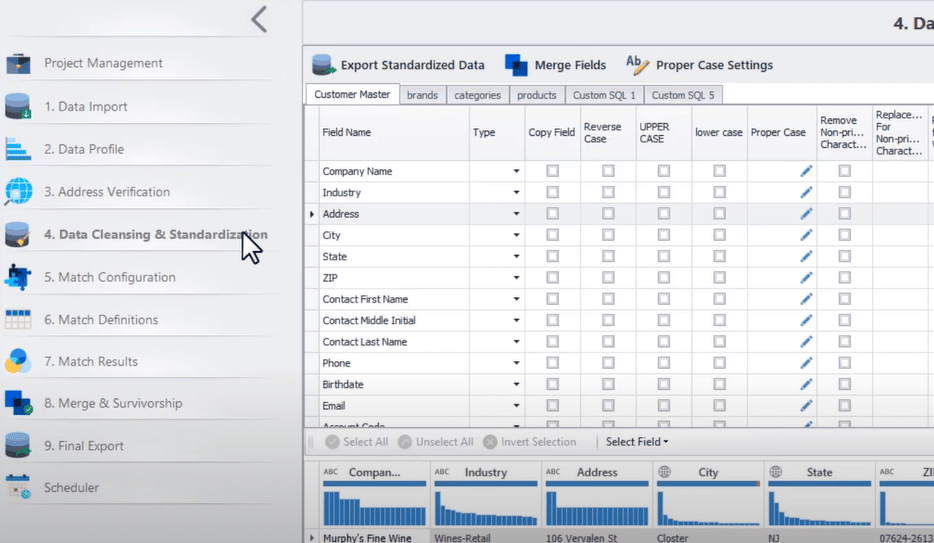

4. Paquete completo de limpieza y normalización de datos

Una de las mayores ventajas de este tipo de herramientas es que, en la mayoría de los casos, vienen acompañadas de otras funciones de limpieza y normalización de datos que son fundamentales para transformar los datos en una forma y un formato aceptables. Porque una vez que se tiene el informe de concordancia de patrones que muestra qué valores de datos son válidos y cuáles no, el siguiente paso importante es fijar los patrones también.

Por eso, adoptar un sistema integral que se encargue de varias disciplinas de gestión de la calidad de los datos -incluyendo la elaboración de perfiles de datos, la limpieza, la normalización, el cotejo y la fusión- puede ser una gran ventaja.

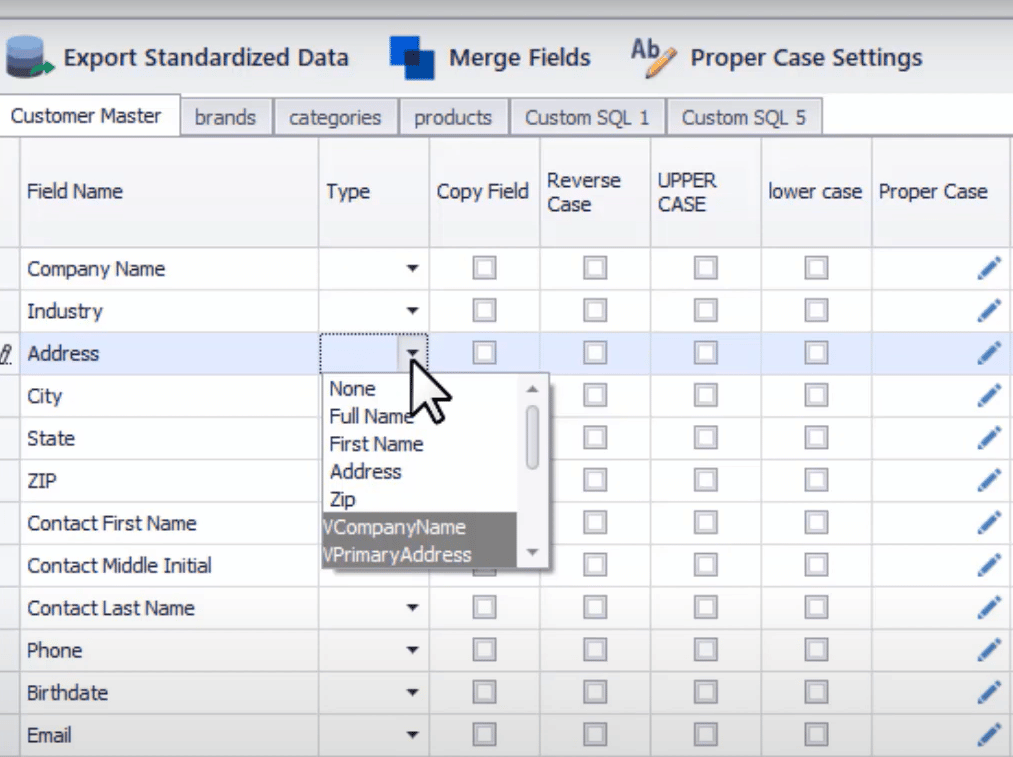

A continuación se muestra una captura de pantalla de varias funciones de calidad de datos que ofrece DataMatch Enterprise :

Optar por una solución sin código que construya, haga coincidir y transforme patrones

Aunque en este blog nos hemos centrado sobre todo en la coincidencia de patrones, el arte de la transformación de patrones es igual de interesante, aunque también supone un reto. Por esta razón, muchas organizaciones prefieren proporcionar a sus equipos herramientas de limpieza y estandarización de datos de autoservicio que están diseñadas con funciones de diseño, correspondencia y transformación de patrones. La adopción de este tipo de herramientas puede ayudar a su equipo a ejecutar complejas técnicas de limpieza y normalización de datos en millones de registros en cuestión de minutos.

DataMatch Enterprise es una de esas herramientas que facilita a los equipos de datos la rectificación de errores de patrón con rapidez y precisión, y les permite centrarse en tareas más importantes. Para saber más sobre cómo puede ayudar DataMatch Enterprise, puede descargar una prueba gratuita hoy mismo o reservar una demostración con un experto.

The post Guía de concordancia de patrones: ¿Qué significa y cómo hacerlo? appeared first on Data Ladder.

]]>The post Guía de normalización de datos: Tipos, beneficios y proceso appeared first on Data Ladder.

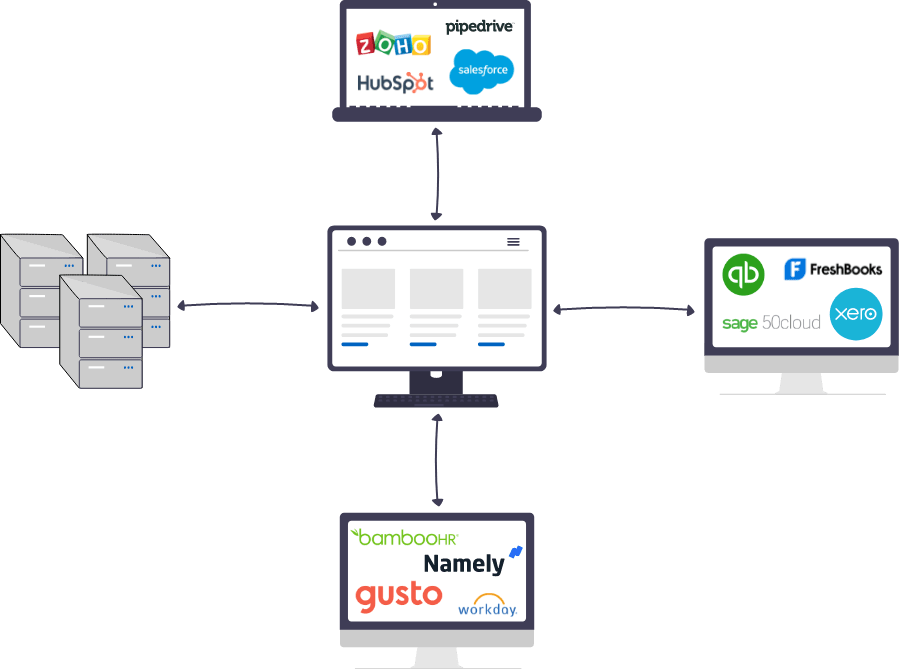

]]>Cuando se extraen datos de varias aplicaciones instaladas en la empresa, se espera recibir una definición y un formato coherentes de la misma información. Pero en la realidad, esto no suele ser así. Las variaciones presentes en los conjuntos de datos -entre aplicaciones e incluso dentro de la misma aplicación- hacen casi imposible utilizar los datos para cualquier propósito, desde las operaciones rutinarias hasta la inteligencia empresarial.

Hoy en día, una empresa media utiliza múltiples aplicaciones SaaS e internas. Cada sistema tiene sus propios requisitos, restricciones y limitaciones. Por ello, los datos alojados en las distintas aplicaciones están condenados a contener discrepancias. Y si tenemos en cuenta las faltas de ortografía, las abreviaturas, los apodos y los errores de escritura, nos damos cuenta de que los mismos valores pueden tener cientos de representaciones diferentes. Aquí es donde se hace imperativo estandarizar los datos para que sean utilizables para cualquier propósito.

En este blog, aprenderemos todo sobre la normalización de datos: qué es, por qué y cuándo se necesita, y cómo se puede hacer. Empecemos.

¿Qué es la estandarización de datos?

En el mundo de los datos, un estándar se refiere a un formato o representación al que debe ajustarse todo valor de un determinado dominio. Por lo tanto, normalizar los datos significa:

Proceso de transformación de una representación incorrecta o inaceptable de datos en una forma aceptable.

La forma más fácil de saber qué es «aceptable» es entender los requisitos de su empresa. Lo ideal es que las organizaciones se aseguren de que el modelo de datos utilizado por la mayoría de las aplicaciones -si no todas- se ajuste a sus necesidades empresariales. La mejor manera de lograr la estandarización de los datos es alinear su representación, estructura y definición con los requisitos de la organización.

Tipos y ejemplos de errores de normalización de datos

A continuación se ofrecen algunos ejemplos de cómo pueden acabar los datos no normalizados en el sistema:

- El número de teléfono del cliente se guarda como una cadena en un sistema, mientras que en otro sólo se permite que sea un número que contenga 8 dígitos, lo que provoca una incoherencia en el tipo de datos.

- El nombre del cliente se guarda como un solo campo en un sistema, mientras que el mismo se cubre como tres campos separados en otro sistema para el nombre, el segundo nombre y los apellidos, lo que lleva a una incoherencia estructural.

- La fecha de nacimiento del cliente tiene el formato MM/DD/AAAA en un sistema, mientras que la misma tiene el formato Mes Día, Año en otro sistema – lo que lleva a la inconsistencia del formato.

- El género del cliente se guarda como Mujer o Hombre en un sistema, mientras que el mismo se guarda como F o M en otro sistema, lo que lleva a la inconsistencia del valor del dominio.

Aparte de estas situaciones comunes, las faltas de ortografía, los errores de transcripción y la falta de restricciones de validación pueden aumentar los errores de normalización de datos en sus conjuntos de datos.

¿Por qué hay que normalizar los datos?

Cada sistema tiene su propio conjunto de limitaciones y restricciones, lo que da lugar a modelos de datos únicos y a sus definiciones. Por esta razón, puede ser necesario transformar los datos antes de que puedan ser consumidos correctamente por cualquier proceso de negocio.

Normalmente, se sabe que ha llegado el momento de normalizar los datos cuando se quiere:

1. Conformar los datos entrantes o salientes

Una organización tiene muchas interfaces que intercambian puntos de datos de partes interesadas externas, como proveedores o socios. Cada vez que los datos entran en una empresa o se exportan, es necesario ajustarlos a la norma requerida, pues de lo contrario el desorden de datos no estandarizados no hace más que crecer.

2. Preparar los datos para el BI o la analítica

Los mismos datos pueden representarse de múltiples maneras, pero la mayoría de las herramientas de BI no están especializadas para procesar todas las posibles representaciones de los valores de los datos y pueden acabar tratando los mismos datos con un significado diferente. Esto puede llevar a resultados de BI sesgados o inexactos. Por lo tanto, antes de alimentar los datos en sus sistemas de BI, deben ser limpiados, estandarizados y deduplicados, para que pueda obtener información correcta y valiosa.

3. Consolidar entidades para eliminar duplicidades

La duplicación de datos es uno de los mayores peligros para la calidad de los datos que afrontan las empresas. Para que las operaciones empresariales sean eficientes y sin errores, debe eliminar los registros duplicados que pertenezcan a la misma entidad (ya sea para un cliente, un producto, una ubicación o un empleado), y un proceso de deduplicación de datos eficaz requiere que se cumplan las normas de calidad de los datos.

4. Compartir datos entre departamentos

Para que los datos sean interoperables entre departamentos, tienen que estar en un formato comprensible para todos. Por lo general, las organizaciones tienen información de los clientes en los CRM que es entendida por la gente de ventas y marketing. Esto puede introducir retrasos en la finalización de las tareas y bloqueos en la productividad del equipo.

Limpieza de datos frente a estandarización de datos

Los términos limpieza de datos y normalización de datos suelen utilizarse indistintamente. Pero hay una pequeña diferencia entre ambos.

La limpieza de datos es el proceso de identificar datos incorrectos o sucios y sustituirlos por valores correctos, mientras que la normalización de datos es el proceso de transformar los valores de los datos de un formato inaceptable a un formato aceptable.

El objetivo y el resultado de ambos procesos es similar: se quiere eliminar la inexactitud y la incoherencia de los conjuntos de datos. Ambos procesos son vitales para su iniciativa de gestión de la calidad de los datos y deben ir de la mano.

¿Cómo normalizar los datos?

Un proceso de normalización de datos consta de cuatro sencillos pasos: definir, probar, transformar y volver a probar. Repasemos cada paso con un poco más de detalle.

1. Definir una norma

En el primer paso, debe identificar qué norma satisface las necesidades de su organización. La mejor manera de definir una norma es diseñar un modelo de datos para su empresa. Este modelo de datos representará el estado más ideal al que deben ajustarse los valores de los datos de una determinada entidad. Un modelo de datos puede ser diseñado como:

- Identifique los activos de datos cruciales para el funcionamiento de su empresa. Por ejemplo, la mayoría de las empresas capturan y gestionan datos de clientes, productos, empleados, ubicaciones, etc.

- Defina los campos de datos de cada activo identificado y decida también los detalles estructurales. Por ejemplo, puede querer almacenar el nombre, la dirección, el correo electrónico y el número de teléfono de un cliente, donde el campo nombre abarca tres campos y el campo dirección abarca dos.

- Asigne un tipo de datos a cada campo identificado en el activo. Por ejemplo, el campo Nombre es un valor de cadena, Número de teléfono es un valor entero, etc.

- Defina los límites de caracteres (mínimo y máximo) para cada campo. Por ejemplo, un nombre no puede tener más de 15 caracteres y el número de teléfono no puede tener más de 8 dígitos, etc.

- Defina el patrón al que deben atenerse los campos – puede que no sea aplicable a todos los campos. Por ejemplo, la dirección de correo electrónico de cada cliente debe ajustarse a la regex [chars]@[chars].[chars].

- Definir el formato en el que deben colocarse determinados elementos de datos dentro de un campo. Por ejemplo, la fecha de nacimiento de un cliente debe especificarse como MM/DD/AAAA.

- Defina la unidad de medida para los valores numéricos (si procede). Por ejemplo, la edad del cliente se mide por años.

- Definir el dominio de valores para los campos que deben derivarse de un determinado conjunto de valores. Por ejemplo, la edad del cliente debe ser un dígito entre 18 y 50, el sexo debe ser masculino o femenino, etc.

Un modelo de datos diseñado puede colocarse en un diagrama de clases ERD para ayudar a visualizar el estándar definido para cada activo de datos y cómo se relacionan entre sí. A continuación se muestra un ejemplo de modelo de datos para una empresa minorista:

2. Prueba de la norma

Las técnicas de estandarización de datos comienzan en el segundo paso, ya que el primero se centra en la definición de lo que debe ser, algo que se hace una vez o se revisa y actualiza de vez en cuando.

Ha definido la norma y ahora es el momento de ver si los datos actuales se ajustan a ella. A continuación, repasamos una serie de técnicas que comprueban los valores de los datos en busca de errores de estandarización y construyen un informe de estandarización que puede utilizarse para solucionar los problemas.

a. Análisis de registros y atributos

El diseño de un modelo de datos es la parte más crucial de la gestión de datos. Pero, por desgracia, muchas organizaciones no diseñan modelos de datos ni establecen estándares de datos comunes a tiempo, o las aplicaciones que utilizan no tienen modelos de datos personalizables, lo que les lleva a capturar datos con nombres de campos y estructuras diferentes.

Al consultar la información de diferentes sistemas, puede observar que algunos registros devuelven el nombre de un cliente como un solo campo, mientras que otros devuelven tres o incluso cuatro campos que cubren el nombre de un cliente. Por esta razón, antes de que cualquier conjunto de datos pueda ser examinado en busca de errores, hay que empezar por analizar los registros y los campos para obtener los componentes que deben ser probados para la normalización.

b. Informe sobre el perfil de los datos del edificio

El siguiente paso es pasar los componentes analizados por un sistema de perfiles. Una herramienta de perfilado de datos informa de diferentes estadísticas sobre los atributos de los datos, como

- ¿Cuántos valores de una columna siguen el tipo de datos, el formato y el patrón requeridos?

- ¿Cuál es el número medio de caracteres presentes en una columna?

- ¿Cuáles son los valores máximos y mínimos presentes en una columna numérica?

- ¿Cuáles son los valores más comunes presentes en una columna y cuántas veces aparecen?

c. Comparación y validación de patrones

Aunque las herramientas de perfilado de datos informan sobre las coincidencias de patrones, dado que es una parte importante de las pruebas de normalización de datos, lo discutiremos con un poco más de profundidad. Para hacer coincidir los patrones, es necesario definir primero una expresión regular estándar para un campo, por ejemplo, una expresión regular para las direcciones de correo electrónico puede ser ^[a-zA-Z0-9+_ .-]+@[a-zA-Z0-9 .-]+$. Todas las direcciones de correo electrónico que no sigan el patrón dado deben ser marcadas durante la prueba.

d. Uso de diccionarios

Se puede comprobar la normalización de determinados campos de datos cotejando los valores con diccionarios o bases de conocimientos. También puede ejecutarlas con diccionarios creados por el usuario. Esto se hace a menudo para coincidir con errores ortográficos, abreviaturas o nombres acortados. Por ejemplo, los nombres de empresas suelen incluir términos como LLC, Inc, Ltd. y Corp. Cotejarlos con un diccionario lleno de esos términos estándar puede ayudar a identificar cuáles no siguen la norma requerida o están mal escritos.

Más información sobre el uso de wordsmith para eliminar el ruido y normalizar los datos en masa.

e. Direcciones de prueba para la normalización

Mientras se prueban los datos para su estandarización, es posible que tenga que probar campos especializados, como ubicaciones o direcciones. La estandarización de direcciones es el proceso de cotejar el formato de las direcciones con una base de datos autorizada -como la de USPS en Estados Unidos- y convertir la información de las direcciones en un formato aceptable y estandarizado.

Una dirección estandarizada debe estar correctamente escrita, formateada, abreviada, geocodificada, así como adjuntada con valores ZIP+4 precisos. Todas las direcciones que no se ajustan a la norma requerida (especialmente las direcciones que se supone que reciben entregas y envíos) deben ser marcadas para que puedan ser transformadas según sea necesario.

Más información: Guía rápida para la normalización y verificación de direcciones.

Enterprise Content Solutions uses DataMatch Enterprise

Enterprise Content Solutions found 24% higher matches than other vendors for inconsistent address records.

Read case study3. Transformar

En el tercer paso del proceso de normalización de datos, llega finalmente el momento de convertir los valores no conformes en un formato normalizado. Esto puede incluir:

- Transformación de los tipos de datos de los campos, como la conversión de Número de teléfono de cadena a un tipo de datos entero y la eliminación de cualquier carácter o símbolo presente en los números de teléfono para obtener el número de 8 dígitos.

- Transformar patrones y formatos, como convertir las fechas presentes en el conjunto de datos al formato MM/DD/AAAA.

- Transformación de unidades de medida, como la conversión de los precios de los productos a USD.

- Ampliar los valores abreviados para completar las formas, como sustituir los estados de EE: NY a Nueva York, NJ a Nueva Jersey, etc.

- Eliminar el ruido presente en los valores de los datos para obtener una información más significativa, como eliminar LLC, Inc. y Corp. de los nombres de las empresas para obtener los nombres reales sin ningún ruido.

- Reconstruir los valores en un formato estandarizado en caso de que sea necesario asignarlos a una nueva aplicación o a un centro de datos, como un sistema de gestión de datos maestros.

Todas estas transformaciones se pueden hacer manualmente -lo que puede llevar mucho tiempo y ser improductivo- o se pueden utilizar herramientas automatizadas que pueden ayudar a limpiar los datos automatizando las fases de prueba y transformación estándar por usted.

4. Volver a probar la norma

Una vez finalizado el proceso de transformación, es una buena práctica volver a probar el conjunto de datos para detectar errores de estandarización. Los informes previos y posteriores a la estandarización pueden compararse para comprender en qué medida los errores de datos fueron corregidos por los procesos configurados y cómo pueden mejorarse para alcanzar mejores resultados.

Uso de herramientas de estandarización de datos de autoservicio

Hoy en día, los datos se introducen manualmente, así como se capturan y generan automáticamente. En medio del manejo de grandes volúmenes de datos, las organizaciones se encuentran con millones de registros que contienen patrones, tipos de datos y formatos incoherentes. Y cuando quieren utilizar estos datos, los equipos se ven bombardeados con horas de comprobación manual del formato y de corrección de cada pequeño detalle antes de que la información pueda considerarse útil.

Muchas empresas se están dando cuenta de la importancia de proporcionar a sus equipos herramientas de estandarización de datos de autoservicio que también vienen con funciones de limpieza de datos incorporadas. La adopción de este tipo de herramientas puede ayudar a su equipo a ejecutar complejas técnicas de limpieza y normalización de datos en millones de registros en cuestión de minutos.

DataMatch Enterprise es una de esas herramientas que facilita a los equipos de datos la rectificación de los errores de normalización de datos con rapidez y precisión, y les permite centrarse en tareas más importantes. Para saber más sobre cómo puede ayudar DataMatch Enterprise, puede descargar una prueba gratuita hoy mismo o reservar una demostración con un experto.

The post Guía de normalización de datos: Tipos, beneficios y proceso appeared first on Data Ladder.

]]>The post La integración de datos explicada: Definición, tipos, proceso y herramientas appeared first on Data Ladder.