The post Un guide rapide pour la normalisation et la vérification des adresses appeared first on Data Ladder.

]]>La normalisation des adresses est le processus qui consiste à mettre à jour et à appliquer une norme ou un format à l’ensemble de vos données d’adresses.

Les mauvaises données d’adresses constituent un problème complexe de qualité des données qui affecte les clients, les entreprises et même le service postal. La quantité stupéfiante de données d’adresses médiocres a obligé les entreprises à investir dans des outils robustes de normalisation et de vérification des adresses qui les aideront à obtenir des adresses validées par USPS facilement et sans effort.

Nous vous aidons à comprendre :

- Le coût des mauvaises données

- Les problèmes liés aux données d’adresses

- Causes profondes de la mauvaise qualité des données

- Comment standardiser l’adresse

- Qu’est-ce que la normalisation des adresses CASS ?

- Comment valider une adresse ?

- Comment vérifier une adresse auprès d’USPS ?

- Correspondance des données – Le défi le plus important pour la normalisation et la vérification des adresses

- Une étude de cas – E-Ideas Limited

- Stratégies commerciales pour améliorer vos données d’adresses

Plongeons dans le vif du sujet !

Le coût des mauvaises données d’adresses

Chaque année, des millions de dollars sont gaspillés à cause de mauvaises données d’adresses. L’USPS rapporte que près de 6,6 milliards de pièces de courrier n’ont pas pu être distribuées au cours de la seule année 2016. Les expéditeurs dépensent plus de 20 milliards de dollars en courrier UAA, tandis que les coûts directs pour l’USPS s’élèvent à plus de 1,5 milliard de dollars par an. Tous ces coûts inutiles sont simplement dus au fait que les entreprises n’ont pas accès aux bonnes données d’adresse.

Si vous faites le calcul sur la base de ce seul coût préliminaire, vous dépensez probablement $$$$ rien qu’en gestion des frais de retour de courrier – sans parler du coût opérationnel de la vérification des informations fournies par les clients et du renvoi du colis.

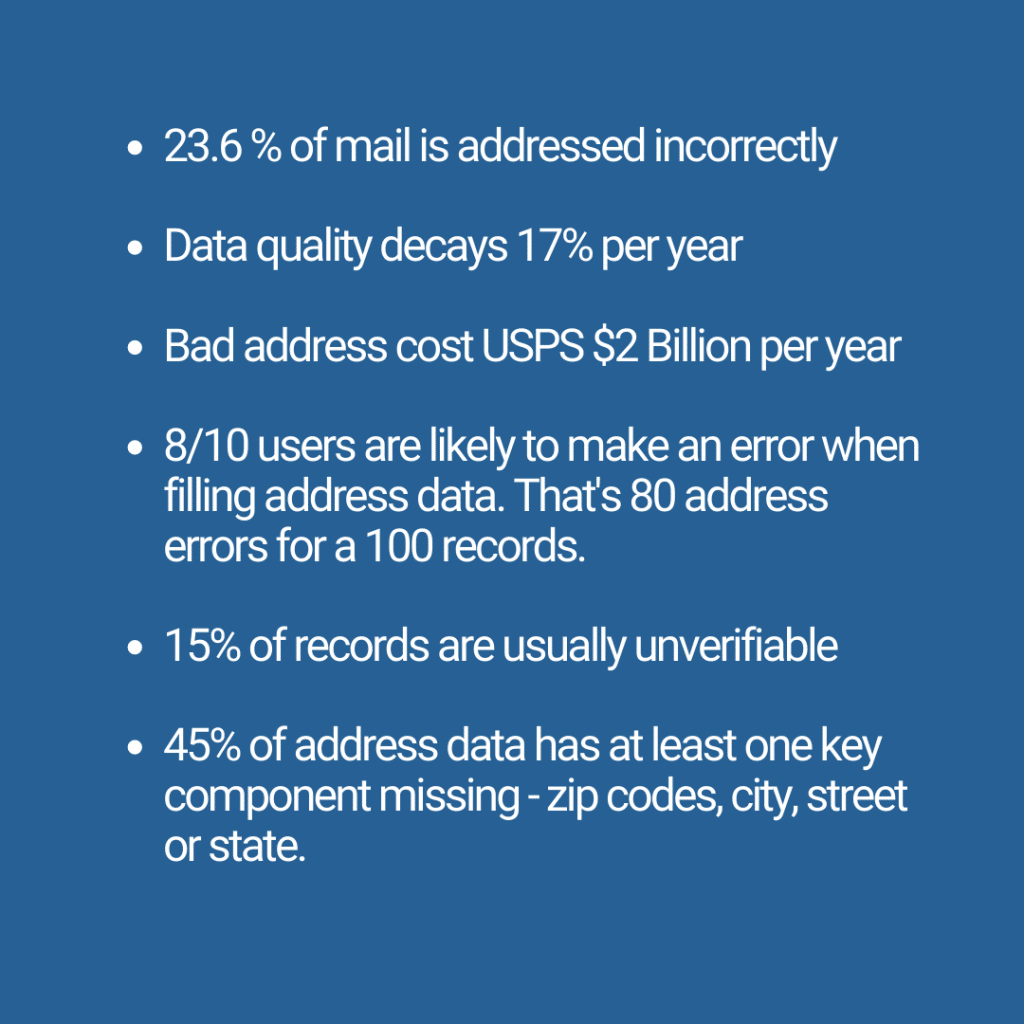

Quelques chiffres à prendre en compte :

Les problèmes liés aux données d’adresses

C’est la nature humaine de faire des erreurs. La plupart du temps, les consommateurs sont laxistes lorsqu’il s’agit de fournir leurs coordonnées sur des formulaires physiques ou en ligne. Ils peuvent mal orthographier le nom d’un État, écrire des abréviations, omettre un numéro de rue ou oublier leur code postal. Il est inévitable que des erreurs soient commises et que des données incorrectes soient saisies.

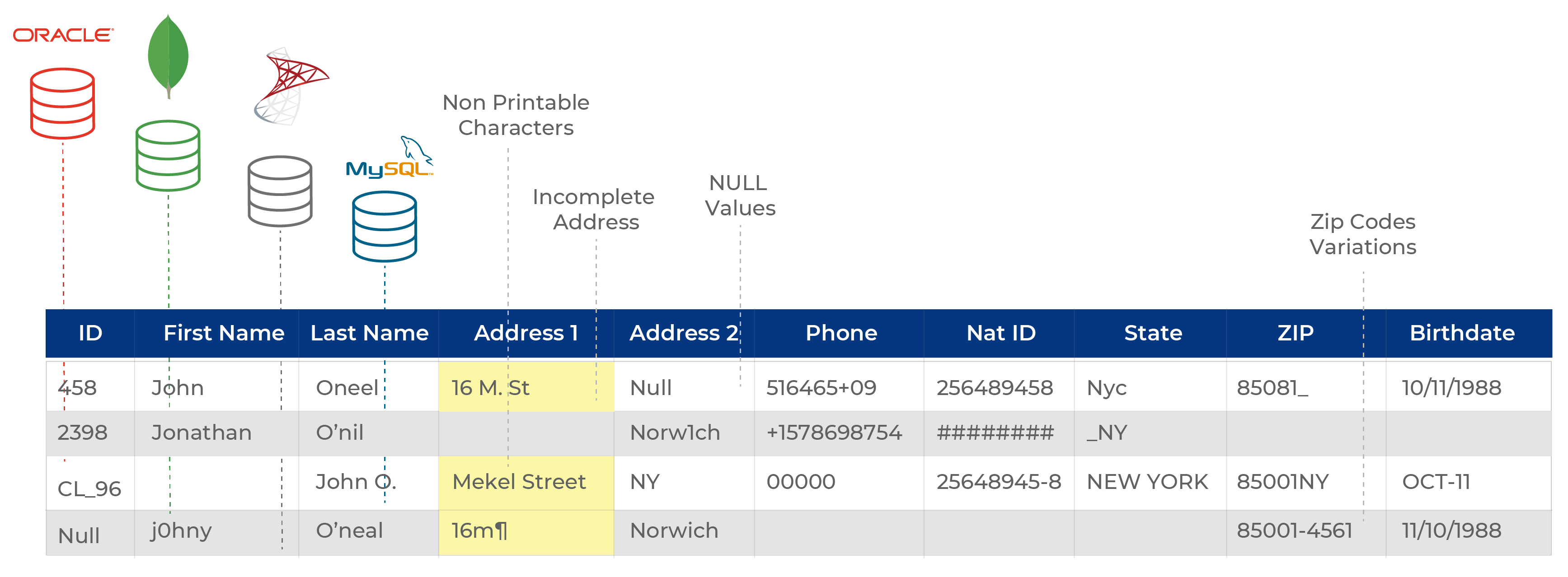

Voici une image de ce à quoi ressemblent des données d’adresse brutes et non structurées. Les mauvaises données d’adresses sont un défi qui met à rude épreuve les entreprises et leurs employés. Imaginez devoir résoudre ces problèmes de base pour chaque campagne d’envoi, chaque activité promotionnelle et chaque rapport sur les clients que vous devez exécuter. C’est non seulement extrêmement frustrant, mais aussi contre-productif, car vous essayez de faire correspondre et de vérifier chaque adresse pour vous assurer qu’elle est exacte et complète. Les scientifiques et les analystes de données ou les utilisateurs professionnels qui ont besoin de ces données doivent passer des jours et des mois à résoudre ces problèmes.

On constate souvent que les données d’adresses souffrent de :

- Informations incomplètes (nom de la rue, numéro de l’îlot, code postal).

- Informations non valides (fausses adresses et codes postaux)

- Informations incorrectes (fautes de frappe, noms mal orthographiés, format médiocre tel que l’utilisation d’abréviations)

- Informations inexactes (numéros d’appartement ou de maison inexacts)

Tous ces problèmes font des données d’adresses l’une des plus difficiles à traiter dans une source de données. En outre, cela augmente considérablement le coût des courriers de retour, tout en empêchant une entreprise de s’appuyer sur les données d’adresses pour prendre des décisions commerciales cruciales.

La plupart de ces problèmes sont dus à des erreurs de saisie de l’utilisateur et à l’absence de contrôles appropriés des données.

Par exemple, certaines personnes choisiront d’écrire seulement le code postal mais pas l’adresse complète, d’autres oublieront simplement d’écrire le code postal, ou d’autres encore écriront une adresse incomplète. Certains donnent une fausse adresse. Quelles que soient les raisons des erreurs de données, une chose est sûre : pour qu’une entreprise puisse utiliser ses données, il faut que celles-ci soient propres et valides.

Mais les erreurs structurelles ne sont qu’une partie du problème que posent les mauvaises données d’adresse. D’autres questions pourraient être :

- Adresser les données qui sont valides, mais qui n’existent plus.

- Adresse qui est structurellement correcte mais qui n’appartient pas au client.

- Adresse qui n’existe pas dans la base de données de l’USPS.

Lorsque ces informations ne sont pas vérifiées à l’entrée, cela affecte toute la correspondance future, ainsi que la relation avec ce client. Pour y remédier, les entreprises devront passer du temps à appeler chaque client pour mettre à jour les données ou leur demander de fournir à nouveau les bonnes informations. Le problème est que les entreprises sont généralement à court de ressources et que ce mode de fonctionnement n’est pas très viable.

En fin de compte, tout se résume à une seule chose : les mauvaises données sont inévitables, mais elles peuvent être corrigées. Il existe de nombreux outils de normalisation d’adresses qui aident les entreprises à corriger les données de mauvaise qualité en corrigeant les problèmes de format et en nettoyant les données désordonnées. Le processus est moins long mais peut nécessiter une courbe d’apprentissage et une compréhension de base de la correspondance, de l’analyse et de la déduplication des données.

Causes profondes des mauvaises données d’adresse

Les erreurs humaines sont la principale, mais pas la seule, cause de la mauvaise qualité des adresses. Mis à part les difficultés liées à la saisie de données précises, les causes profondes sont bien plus nombreuses :

Décroissance de la base de données :

Selon le Bureau du recensement, un Américain type déménagera 11,7 fois dans sa vie. Comme le logement devient de plus en plus cher et que les Américains essaient de trouver des zones convenables pour vivre, ce chiffre va augmenter. Parmi ceux-ci, seuls 60% des déménageurs informent effectivement l’USPS de leur déménagement en temps voulu.

Les entreprises sont donc coincées avec des données d’adresses qui ne sont pas mises à jour. S’ils envoient un million de factures ou de courriers promotionnels par mois, ils peuvent recevoir 90 000 avis de déménagement au cours du même mois. Pire, selon ce pourcentage, 60 000 de ces millions de clients n’auront pas fourni les bonnes informations à l’USPS à temps.

En supposant que les mêmes clients soient toujours présents dans l’organisation, l’entreprise devra continuer à mettre à jour sa base de données et s’assurer qu’elle dispose de l’adresse la plus récente à utiliser.

Une mauvaise culture des données :

Ce n’est que récemment que les entreprises ont commencé à discuter de l’importance de l’exploitation des données, mais cela ne concerne que les dirigeants. L’employé à son bureau n’est pas conscient du niveau des problèmes de qualité des données auxquels il est confronté. En outre, il n’y a pas de règles commerciales à respecter en matière de qualité des données. Il n’y a pas de formation ou d’éducation pour que les employés soient orientés vers les données et il n’y a absolument aucun investissement dans les outils de gestion des données comme DataMatch Enterprise qui peut combler le fossé entre les applications informatiques et la gestion des données par les entreprises.

Fusions et acquisitions :

Lorsque les entreprises migrent des données lors d’une fusion ou d’une acquisition, la probabilité d’erreurs dans la qualité des données augmente. Ces fusions sont rapides et les problèmes sont parfois imprévus. La pression en faveur de la consolidation est de plus en plus forte, mais il n’y a pas de contrôle de la qualité – en fait, il y a rarement un cadre de gestion de la qualité en place.

Comment faire pour normaliser les adresses ?

Ok, donc définition, comment standardiser réellement les données ?

Il y a deux façons de faire : la plus facile et la plus difficile.

La méthode dure consiste à transporter ces données vers Excel, à appliquer des formules et des filtres pour corriger les données. Ne croyez pas les tutoriels qui vous disent que c’est « super facile », car ça ne l’est jamais.

Jetez un coup d’œil à cet article qui vous apprendra à corriger les erreurs dans Excel. Vous voyez la quantité de temps, d’efforts et de connaissances techniques que vous devez posséder pour effectuer des corrections de données de base ? Plus les problèmes sont complexes, plus cela prend du temps. Si vous devez traiter des millions de lignes de données, le nettoyage des données pourrait devenir votre emploi permanent.

La solution de facilité ?

Utilisez un logiciel de normalisation des adresses. Avant de rejeter cette idée, voici pourquoi.

Le logiciel permet évidemment de gagner un temps et des efforts considérables, mais il fait plus que cela.

Les enregistrements de données d’adresses ne sont pas de simples erreurs. Comme dans l’exemple ci-dessus, vous avez des milliers de lignes qui ont des problèmes. Vous avez besoin d’une solution qui vous permette de résoudre tous ces problèmes en une seule fois.

Si vous utilisez une solution de premier ordre, vous pouvez normaliser les données :

Évaluation des erreurs via le profilage des données : Imaginez que vous puissiez obtenir un aperçu consolidé de tout ce qui ne va pas dans vos données d’adresses. Vous pouvez voir des colonnes avec des caractères non imprimables, ou des colonnes avec des espaces négatifs ou même des colonnes avec des lettres dans des champs numériques. Le profilage des données vous permet d’effectuer des corrections en connaissance de cause. Si vous ne savez pas ce qui ne va pas, vous corrigez les problèmes à l’aveuglette.

Analyser les adresses pour résoudre des problèmes spécifiques : Une partie du nettoyage des adresses exige que vous analysiez ou décomposiez les différentes parties des adresses (ville, état, code postal, etc.) et que vous les fixiez à différents niveaux. Par exemple, avec DataMatch Enterprise, vous pouvez fixer spécifiquement les codes ZIP et vous assurer qu’ils correspondent aux codes postaux ZIP+4 ou ZIP+6.

Nettoyage des données désordonnées : Nettoyez les problèmes de formatage, supprimez les espaces négatifs et les caractères non imprimables en un seul coup de balai. Il est impératif de nettoyer vos données d’adresse et de les normaliser conformément aux directives de l’USPS (voir ci-dessous) avant de pouvoir les vérifier.

Suppression des doublons grâce à la mise en correspondance des données : le nettoyage des données désordonnées n’est qu’une partie de l’opération – la partie la plus stressante consiste à éliminer les doublons. Si vous avez des milliers de lignes de données clients qui n’ont pas été triées depuis longtemps, il y a de fortes chances que vous ayez des doublons et ils ne sont pas toujours de nature exacte.

Jetez un coup d’œil à ce tableau :

Vous voyez comment un client a cinq adresses différentes saisies de plusieurs façons ? Ce n’est pas quelque chose que vous pouvez trier facilement, à moins d’utiliser un puissant outil de qualité des données.

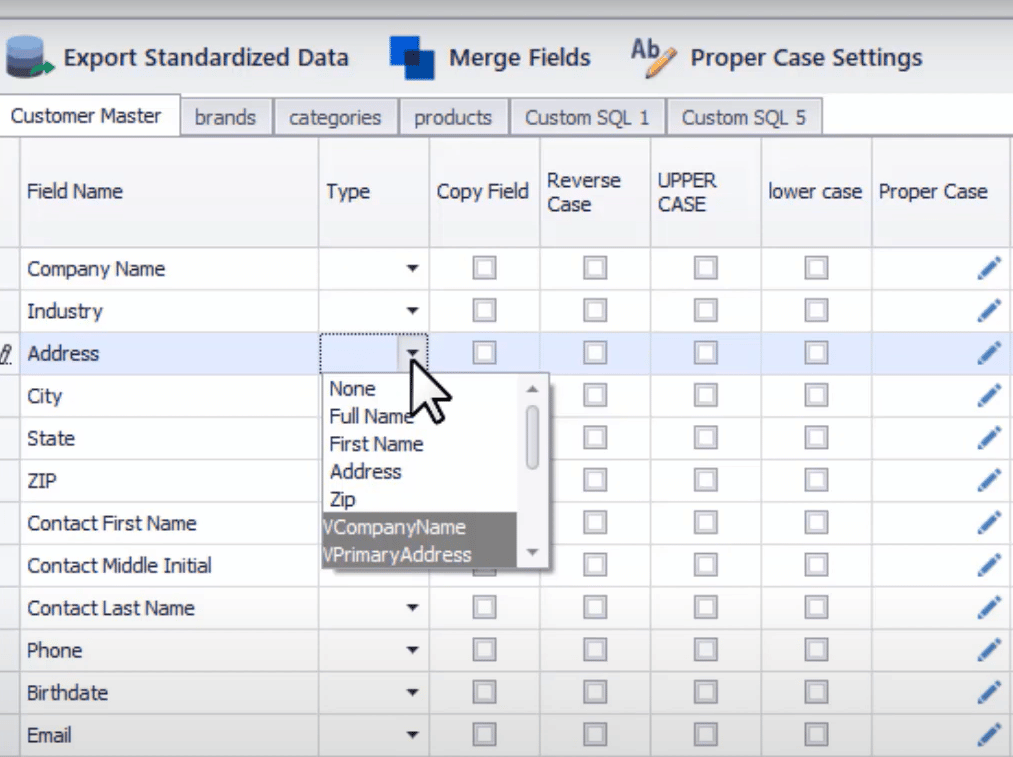

Survivance et exportation des données : Vous devez être en mesure de créer facilement une fiche et de l’exporter sous forme de liste finale à votre équipe sans avoir à la copier/coller ou à la charger manuellement dans un format acceptable.

Survivance et exportation des données : Vous devez être en mesure de créer facilement une fiche et de l’exporter sous forme de liste finale à votre équipe sans avoir à la copier/coller ou à la charger manuellement dans un format acceptable.

Normalisation d’adresses CASS : Tout logiciel de normalisation d’adresses doit avoir la normalisation d’adresses CASS. DataMatch Enterprise, par exemple, est une solution de normalisation d’adresses certifiée CASS dont la base de données est mise à jour tous les mois.

Qu’est-ce que la normalisation des adresses CASS ?

Les logiciels qui corrigent ou font correspondre les adresses doivent être certifiés par l’USPS. Cela se fait par le biais du Coding Accuracy Support System (CASS) que l’USPS utilise pour vérifier l’exactitude du logiciel. Une certification CASS est une licence pour tous les fournisseurs de logiciels qui utilisent l’USPS pour évaluer la qualité de leurs données d’adresses et pour améliorer la précision du codage ZIP+4 et à cinq chiffres.

Comme l’USPS met régulièrement à jour ses données d’adresses, les fournisseurs de logiciels certifiés CASS sont tenus de renouveler chaque année leur certification auprès de l’USPS. Tous les produits certifiés CASS sont listés sur le site web de l’USPS.

Qu’est-ce que la directive de normalisation d’USPS ?

Les fournisseurs de logiciels de normalisation des données d’ adresses suivent la directive de normalisation de l’USPS qui exige que les adresses soient dans un format comme :

Voici les règles :

- Placez toujours l’adresse et l’affranchissement sur le même côté de votre envoi.

- Sur une lettre, l’adresse doit être parallèle au côté le plus long.

- Toutes les lettres majuscules.

- Pas de ponctuation.

- Au moins un caractère de 10 points.

- Un espace entre la ville et l’État.

- Deux espaces entre l’état et le code postal.

- Polices de caractères simples.

- justifié à gauche.

- Encre noire sur papier blanc ou clair.

- Pas de caractères inversés (impression blanche sur un fond noir).

- Si votre adresse apparaît à l’intérieur d’une fenêtre, assurez-vous qu’il y a au moins 1/8 de pouce d’espace libre autour de l’adresse. Parfois, des parties de l’adresse échappent à la vue derrière la fenêtre et les machines de traitement du courrier ne peuvent pas lire l’adresse.

- Si vous utilisez des étiquettes d’adresse, veillez à ne pas couper les informations importantes. Assurez-vous également que vos étiquettes sont bien droites. Les machines de traitement du courrier ont du mal à lire les informations tordues ou inclinées.

La normalisation des adresses est la condition préalable à une validation efficace des adresses. Vous devez vous assurer que votre adresse répond aux directives de l’USPS avant que vos données puissent être vérifiées auprès de l’USPS.

Vérification ou validation d’adresse – Quelle est la différence ?

Vous verrez souvent les termes « validation et vérification » mélangés lorsqu’il s’agit de données d’adresse. La différence est plus contextuelle que lexicale. Data Ladder utilise le terme » vérification d’adresse » pour vérifier les adresses par rapport à la base de données de l’USPS. D’autres organismes vérifient les adresses par rapport aux relevés de facturation, aux permis de conduire, aux relevés bancaires, etc. Il s’agit d’un service complètement différent, dont la plupart des entreprises n’ont pas besoin.

D’autres fournisseurs utilisent« Address Validation » pour effectuer le même rapprochement avec l’USPS afin de valider les données des clients. Dans le contexte de ce guide, nous nous en tiendrons à la vérification des adresses.

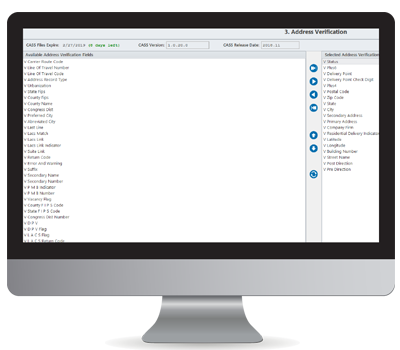

Normalisation et vérification des adresses – Comment vérifier les données d’adresse avec l’USPS

Le processus de vérification de l’adresse est simple. Vous comparez vos données désormais normalisées à la base de données gouvernementale ou à toute autre norme d’autorité. Si vous êtes aux États-Unis, l’USPS est la seule base de données à laquelle vous devez comparer vos données.

Si vos données d’adresse sont propres et normalisées, ce processus prend quelques minutes. Si vous utilisez DataMatch Enterprise, vous pouvez faire correspondre l’adresse entière ou seulement certaines parties de l’adresse qui est basée sur 50 éléments actifs, y compris les emplacements géocodés, ce qui signifie que vous pouvez vérifier les adresses jusqu’au T !

Parmi les domaines les plus populaires pour lesquels nos clients demandent souvent des vérifications, citons les suivants

-

V Statut – L’enregistrement est-il vérifié (oui/non) ?

-

V Indicateur de livraison résidentielle – Définit si l’adresse résidentielle peut recevoir des livraisons directes à la porte.

-

Société V Firm

-

V Adresse principale

-

V Adresse secondaire

-

Ville de V

-

V État

-

V Code postal – 5 chiffres (USA)

-

V Code postal (Canada)

-

V Plus4 – 4 chiffres supplémentaires associés au code postal à 5 chiffres.

Il existe 54 champs que vous pouvez utiliser pour valider vos données d’adresse.

Une fois que vous aurez fait correspondre la liste d’adresses avec ces composants, vous obtiendrez une valeur de retour qui indiquera :

- 10 = Adresse Invald

- 11 = Code ZIP invalide

- 12 = Code d’État non valide

- 13 = In invalid Ville

- 21 = l’adresse n’a pas été trouvée

Des avertissements vous seront également proposés :

-

-

A# ZIP

-

B# Ville/État corrigé

-

C# Ville/État/Zip non valide

-

D# Pas de ZIP attribué

-

E# ZIP attribué pour réponse multiple

-

F# Pas de ZIP disponible

-

G# Partie de l’entreprise déplacée à l’adresse

-

H# Numéro secondaire manquant

-

I# Données insuffisantes/incorrectes

-

J# Double entrée

-

Si vous souhaitez en savoir plus, n’hésitez pas à nous contacter pour une démonstration rapide !

Ok, alors on avance :

Correspondance des données – Le défi le plus important pour la normalisation et la vérification des adresses

Les clients qui s’adressent à nous n’ont qu’une seule plainte : ils ne parviennent jamais à obtenir un bon taux de correspondance. Et nous sommes d’accord !

Lerapprochement des données est encore un domaine à améliorer. Il y a très peu de vendeurs qui peuvent donner un taux de correspondance précis à 100%. Il vous faut vraiment ce chiffre, sinon, au moins 95%. La raison en est que pour que la vérification fonctionne, votre champ d’adresse doit trouver une correspondance avec l’USPS. Si la plupart de vos correspondances sont manquantes parce que le logiciel s’appuie sur des correspondances exactes ou déterministes, il ne jouera pas en votre faveur.

Par conséquent, lorsque vous choisissez un logiciel de normalisation et de vérification des adresses, vous devez être en mesure d’évaluer son taux de correspondance des données. Sur une centaine de rangs, combien de rangs l’outil a-t-il manqué, et pourquoi ? Il y a de fortes chances que vous constatiez que le logiciel ne parvient pas à détecter les correspondances proches ou étroites et qu’il se fie uniquement aux caractères exacts pour identifier une correspondance.

DataMatch Enterprise de Data Ladder est avant tout une solution de rapprochement de données qui a été utilisée par des institutions gouvernementales et des entreprises Fortune 500 comme HP, Coca Cola, Deloitte et bien d’autres. Nous sommes connus pour notre capacité à faire correspondre les données avec un taux de précision de 100 %. C’est parce que Data Ladder utilise une combinaison d’algorithmes de correspondance floue et ses algorithmes propriétaires établis pour identifier même les correspondances probables les plus éloignées.

P.S. – Le rapprochement des données demande beaucoup de ressources. Économisez le temps et les efforts manuels de votre équipe. Découvrez comment dans cet article de blog détaillé.

Voici une étude de cas qui révèle à quel point il est difficile, même pour un fournisseur de données, de garantir une correspondance précise des données.

Une étude de cas – E-Ideas Limited

Nous nous sommes entretenus avec Artem Axenov, directeur des opérations chez E-Ideas Limited, une agence de marketing B2B basée à Wellington. L’agence gère une importante base de données d’entreprises à des fins de marketing, ce qui signifie qu’elle doit accorder une attention particulière aux données d’adresses – un défi de taille qui implique beaucoup de travail manuel sur Excel.

1. Comment votre agence gère-t-elle le problème des mauvaises données ?

Nous avons souvent affaire à des clients qui disposent déjà d’une liste de clients, mais dont les données sont mal formatées. Il existe quelques tâches automatiques que vous pouvez effectuer pour résoudre ce problème, mais au final, c’est un travail manuel. Tout d’abord, vous devez décider du format que vous allez utiliser. La façon la plus simple de corriger des données mal formatées est de les trier une colonne à la fois, puis d’apporter les modifications nécessaires pour les remettre à niveau. Il existe certaines formules dans Excel qui permettent de diviser ou de combiner des données – pour diviser, vous pouvez utiliser MID et LEFT ensemble. Et pour combiner des données, vous pouvez utiliser CONCATENATE.

En triant d’abord les données, vous regroupez les ensembles d’adresses qui présentent les mêmes problèmes de formatage, ce qui facilite grandement leur traitement en une seule fois.

2. Quelle a été votre expérience des outils de vérification et de validation des adresses ?

Notre expérience avec tout type d’outil de validation ou de vérification d’adresse a toujours été mitigée. En fin de compte, aucun des outils que nous avons utilisés n’a réussi à produire une correspondance élevée. Et cela est dû à des méthodes très différentes de stockage des adresses. Ils sont utiles pour prendre une longueur d’avance sur le processus, mais en fin de compte, il faut toujours une quantité importante de travail manuel pour terminer le travail.

3. Quel est le problème de rapprochement de données le plus troublant ?

Le problème principal est que, quelle que soit la correspondance automatique effectuée, si les données ne sont pas formatées de la manière exacte dont l’outil est programmé pour les identifier, la correspondance ne se fait pas. Il peut s’agir par exemple d’une rue enregistrée comme St, d’une avenue comme Ave, etc.

4. Quel type de tâches manuelles devez-vous effectuer après avoir utilisé un logiciel de validation d’adresses ?

En général, il suffit d’examiner les données avec un œil humain pour repérer les éventuelles incohérences et les corriger. En Nouvelle-Zélande, par exemple, le service postal a un format très spécifique dans lequel les adresses doivent être conservées pour bénéficier de la remise sur les envois en nombre. Rien n’est compliqué mais, là encore, de petites choses comme le fait que la rue soit enregistrée comme St seront comptabilisées contre vous. Ou un autre exemple si votre boîte postale est enregistrée comme boîte postale – il ne le reconnaît pas comme correctement formaté. Même des éléments tels que les espaces avant ou arrière peuvent compter contre vous – et certains de ces éléments sont difficiles à repérer car, lorsque vous regardez l’adresse, vous ne voyez pas ce qui ne va pas !

5. Comment les mauvaises données d’adresses ont-elles affecté votre entreprise ?

Nous n’avons rencontré que des problèmes liés à la nécessité de consacrer des heures de travail supplémentaires à la mise à niveau des données pour bénéficier de la remise postale. Il existe un test à passer, appelé « déclaration d’exactitude », qui vérifie automatiquement les données pour s’assurer que 80 % d’entre elles sont correctement formatées. Dans un certain nombre de cas, nous avons fini par passer des jours de plus à formater manuellement les données pour nous assurer qu’elles sont correctement mises en forme.

La pratique que nous avons mise en place consiste à stocker toutes nos données dans le bon format. Il nous a fallu beaucoup de temps pour tout mettre en conformité avec cette norme, mais cela signifie maintenant que lorsque nous livrons des données à nos clients, elles sont prêtes pour la poste NZ et qu’il n’y a plus de travail à faire.

Les difficultés rencontrées par cette agence en raison de données d’adresses erronées entraînent des heures de travail supplémentaires qui affectent l’efficacité opérationnelle. Malgré l’utilisation d’outils de correspondance et de validation des adresses, l’incapacité à produire une correspondance élevée rend très difficile la validation des données d’adresses. Il est donc nécessaire de choisir un outil qui offre à l’utilisateur des capacités complètes de préparation et de normalisation des données tout en fournissant une correspondance élevée. Cela n’est possible qu’avec le meilleur logiciel de préparation et de rapprochement des données, tel que DataMatch Enterprise, qui permet à l’utilisateur de préparer et de nettoyer les données d’adresse tout en retournant un résultat de correspondance élevé, même avec du texte erroné.

Stratégies commerciales pour la gestion des données d’adresses

Les mauvaises données d’adresse sont un problème de qualité des données. Si vous pouvez utiliser des outils pour apporter des correctifs, vous devrez néanmoins mettre en œuvre des stratégies commerciales pour empêcher les mauvaises données d’affecter les processus opérationnels. Certaines de ces stratégies peuvent inclure :

Formations :

La première étape vers la qualité est la formation – il faut s’assurer que les personnes qui manipulent, interagissent, utilisent et saisissent les données connaissent l’impact qu’elles ont sur le processus et sur les applications en aval. Ils doivent comprendre les conséquences de mauvaises données sur l’ensemble de l’organisation et pas seulement sur un membre ou un client. Les employés qui appliquent les règles de qualité des données doivent être récompensés et appréciés.

Liste d’outils pour la gestion des données :

Il est essentiel de disposer d’outils qui peuvent aider les utilisateurs professionnels et les professionnels de l’informatique à gérer les données. Identifiez les outils dont vous avez besoin pour le nettoyage et la gestion des données afin d’aider les utilisateurs informatiques et commerciaux à avoir une relation non intimidante avec les données.

Impliquer les utilisateurs professionnels dans le processus de qualité :

Les données ne sont pas seulement un problème informatique. Les utilisateurs professionnels sont également responsables de la gestion des données. En effet, ils sont les seuls propriétaires des données clients qui sont souvent utilisées à des fins de marketing et de vente. C’est pourquoi ils doivent être impliqués dans le processus et doivent également être formés à l’utilisation des outils de gestion des données.

Gouvernance des données :

Mettez en place une équipe de gouvernance des données pour créer un plan de gestion des données et veillez à ce que l’organisation suive ce plan et que chaque employé le comprenne. Leur règle au sein du plan et les attentes qui accompagnent ce rôle.

Verrouiller les données et les rôles des utilisateurs :

Si n’importe qui dans votre équipe peut ouvrir le CRM ou la source de données, manipuler les données sans laisser d’empreintes, vous allez avoir de sérieux problèmes. Il est nécessaire de créer des détenteurs de données de base qui ont le droit d’accéder aux données critiques, de les saisir ou de les traiter. Cela devrait figurer dans le plan de gestion des données.

Vous n’êtes pas victime de mauvaises données. Il suffit d’accepter la gravité de la situation, de cultiver une culture axée sur les données et de s’efforcer de gérer les défis qui accompagnent la gestion des données. Vous pouvez très bien obtenir des données qui ne nécessitent qu’un nettoyage de base pour être mises à profit.

Comment DataMatch Enterprise peut-il vous aider ?

Notre produit est certifié CASS, ce qui signifie que nous respectons et dépassons les exigences de l’USPS en matière de qualité et de précision des adresses. Nous vous aidons également à faire correspondre et à valider les adresses en vrac, en veillant à ce que les éléments tels que les codes postaux, les noms des villes et des villages soient vérifiés et validés. Le meilleur avantage d’utiliser DataMatch Enterprise de Data Ladder? Le logiciel trouve et rapproche les données, même si elles sont incomplètes, avec un taux de précision de 96 %. En outre, vous pouvez utiliser le logiciel pour obtenir une vérification des adresses en temps réel, afin de vous assurer que votre base de données contient des adresses correctes.

À l’aide d’algorithmes qui déterminent une correspondance sur la base de zones de similitude, notre plateforme donne un sens aux données inutilisables et établit des liens entre les ensembles de données. Qu’il s’agisse de fautes d’orthographe, de codes postaux incomplets, d’abréviations ou de fautes de frappe. Nous trions de grandes quantités de données pour vous aider à donner du sens à vos données.

À l’aide d’algorithmes qui déterminent une correspondance sur la base de zones de similitude, notre plateforme donne un sens aux données inutilisables et établit des liens entre les ensembles de données. Qu’il s’agisse de fautes d’orthographe, de codes postaux incomplets, d’abréviations ou de fautes de frappe. Nous trions de grandes quantités de données pour vous aider à donner du sens à vos données.

En conclusion

Les mauvaises données d’adresses sont inévitables, mais cela ne signifie pas que vous devez les laisser affecter les performances de votre entreprise. La correction manuelle des données d’adresses vous coûtera plus de temps et d’efforts, et vous ne pourrez pas non plus les normaliser ou les vérifier si vous n’utilisez pas une solution certifiée CASS.

Ne vous noyez pas dans les mauvaises données. Nous sommes là pour vous aider.

Pour savoir comment nous pouvons vous aider à normaliser et à vérifier les adresses, contactez dès aujourd’hui l’un de nos experts en solutions et voyez comment nous pouvons vous aider à obtenir des données d’adresses que vous pouvez utiliser aux fins prévues.

The post Un guide rapide pour la normalisation et la vérification des adresses appeared first on Data Ladder.

]]>The post 8 meilleures pratiques pour assurer la qualité des données au niveau de l’entreprise appeared first on Data Ladder.

]]>Le 20 septembre 21, Facebook a reconnu auprès de trois douzaines de chercheurs que l’ensemble de données comportait de graves erreurs et s’est excusé pour l’impact négatif qu’il a eu sur leurs recherches. Il s’avère que Facebook a omis d’inclure les données de la moitié de ses utilisateurs américains – car ils étaient moins polarisés politiquement par rapport à l’ensemble des utilisateurs. La porte-parole de Facebook a précisé que cet incident était dû à une erreur technique survenue dans son ensemble de données URL Shares.

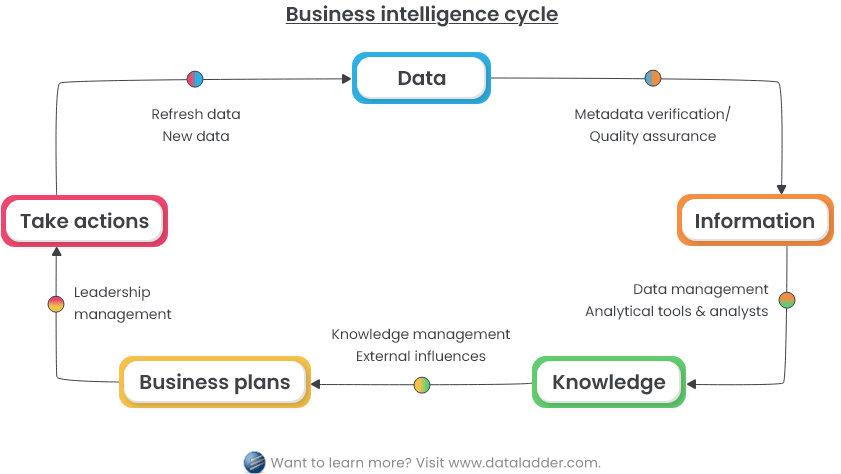

Aujourd’hui, les données constituent sans aucun doute l’un des principaux atouts d’une organisation. Il est utilisé partout, qu’il s’agisse des opérations quotidiennes d’une entreprise, du renforcement de ses initiatives de veille stratégique ou, dans le cas de Facebook, de la facilitation de plus de 100 recherches. Mais en l’absence de techniques et de meilleures pratiques en matière de qualité des données (qui permettent de suivre et de résoudre les problèmes de qualité des données à temps), une entreprise peut perdre beaucoup d’argent et risquer de se retrouver à la traîne.

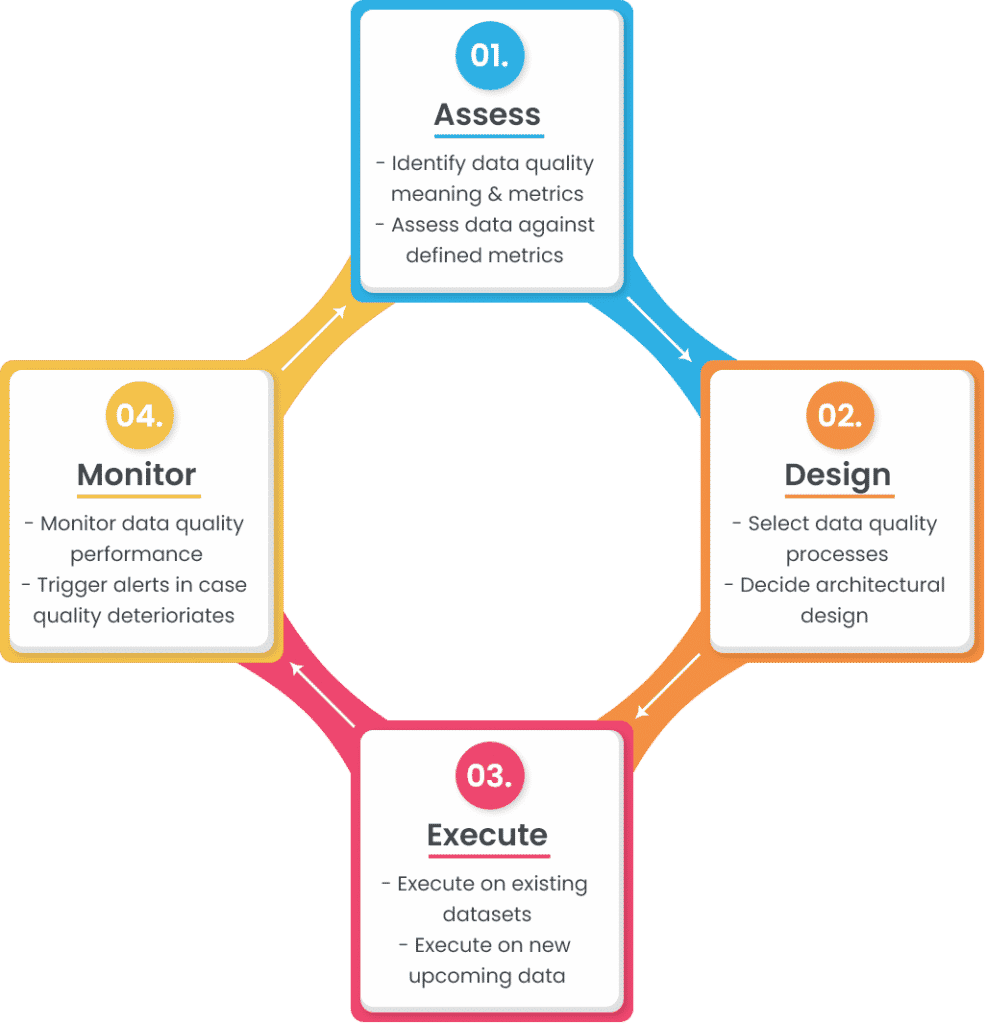

Dans ce blog, nous examinerons un certain nombre de bonnes pratiques et de processus de qualité des données qui peuvent contribuer à une qualité élevée des données au niveau de l’entreprise. En plus de souligner ce qui est nécessaire, je mentionnerai également les éléments réalisables qui peuvent vous aider à atteindre cet état.

En outre, les pratiques mentionnées ci-dessous donneront les meilleurs résultats si elles sont effectuées de manière cohérente à intervalles réguliers dans une entreprise. Les données (dans leur définition et leur utilisation) sont susceptibles de changer. Ainsi, si votre entreprise revoit constamment ces pratiques, vous pouvez certainement obtenir des résultats meilleurs et durables.

Commençons.

1. Déterminer la relation entre les données et les performances de l’entreprise

Nous commençons par cette pratique car il s’agit de l’élément le plus important et le plus fondamental pour permettre une gestion, une adoption et une utilisation appropriées des données dans toute organisation. Tout d’abord, vous devez comprendre comment les données contribuent à vos buts et objectifs commerciaux.

A quoi cela ressemble-t-il ?

Il peut s’agir d’analyser le rôle des données à un niveau élevé (par exemple, en mettant en évidence les domaines dans lesquels les données sont utilisées) ou d’aller plus loin dans les détails (comme le rôle des données dans les opérations quotidiennes, les processus commerciaux, l’échange d’informations entre les départements, etc.)

Une fois que vous avez identifié cela, il est temps de poser cette question : si ces processus ou domaines n’ont pas été facilités par des données de qualité, quel impact cela peut-il avoir sur les indicateurs clés de performance qui en résultent ?

Un exemple d’une telle situation est lorsque les cadres dirigeants fixent l’objectif de revenu pour le trimestre suivant en se basant sur les données de vente du trimestre précédent, mais qu’ils découvrent que l’ensemble de données utilisé pour prévoir l’objectif futur présente de sérieux problèmes de qualité des données, ce qui oblige votre département des ventes à poursuivre une valeur arbitraire qui n’a aucune signification concrète. La situation qui en résulte a un impact négatif massif sur les opérations et la réputation de l’entreprise, comme le fait de fixer des attentes irréalistes aux représentants commerciaux, de promettre des chiffres de revenus inexacts, etc.

Comment cela aide-t-il ?

Comprendre le rôle des données dans chaque processus de fonctionnement d’une entreprise vous permet d’avoir toujours sous la main un argumentaire pour hiérarchiser les données et leur qualité. En fait, cela vous aidera également à obtenir l’adhésion et l’attention nécessaires des parties prenantes, ce qui est crucial pour apporter et proposer des changements aux processus existants.

2. Mesurer et maintenir la définition de la qualité des données

Une fois que vous connaissez l’impact des données sur votre entreprise, l’étape suivante consiste à assurer la qualité des données dans tous les ensembles de données de votre organisation. Mais avant cela, il est important de comprendre la définition de la qualité des données, car elle a une signification différente pour chaque entreprise.

La qualité des données est définie comme le degré auquel les données remplissent l’objectif prévu. Ainsi, pour comprendre la signification de la qualité des données dans votre cas, vous devez savoir quel est l’objectif visé.

A quoi cela ressemble-t-il ?

Pour définir la qualité des données pour votre entreprise, vous devez commencer par identifier les :

- Sources qui génèrent, stockent ou manipulent des données,

- Attributs stockés par chaque source,

- Glossaire des métadonnées qui définit chaque attribut,

- les critères d’acceptabilité des valeurs de données stockées dans les attributs, et

- Les métriques de qualité des données qui mesurent la qualité des données stockées.

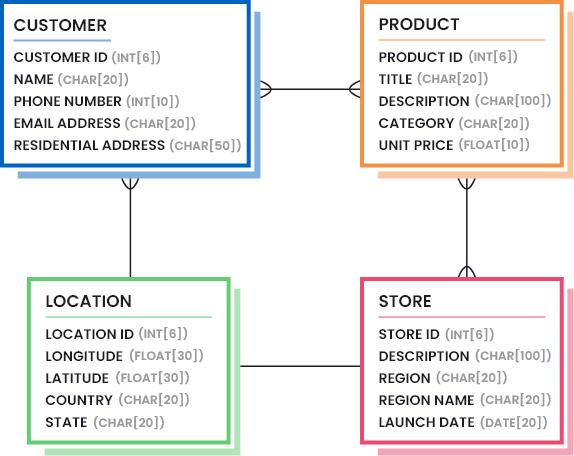

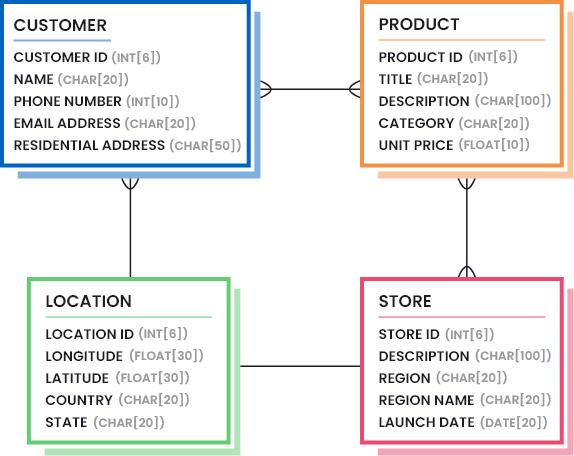

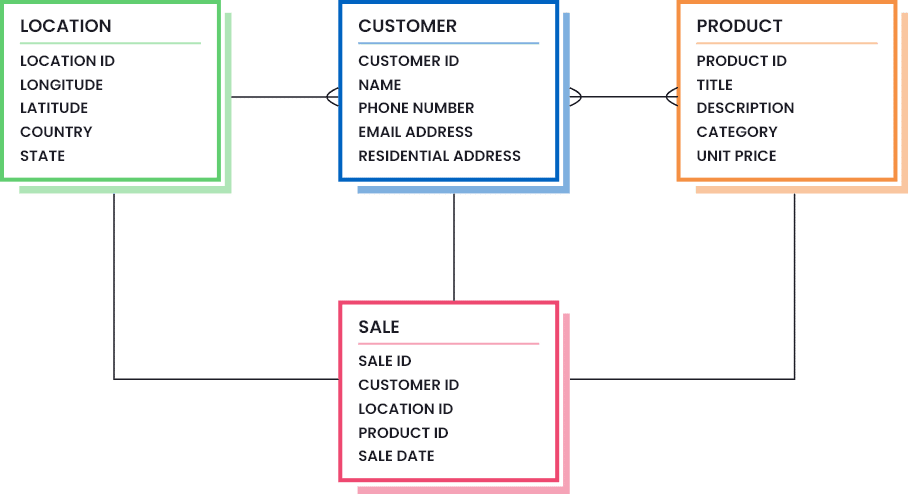

Un exemple de définition de la qualité des données dans votre entreprise consiste à dessiner des modèles de données qui mettent en évidence les parties nécessaires des données (la quantité et la qualité des données qui sont considérées comme suffisantes). Considérez l’image suivante pour comprendre à quoi peut ressembler un modèle de données pour une entreprise de vente au détail :

En outre, outre la conception de modèles de données, vous devez également identifier des mesures de qualité des données qui confirment la présence d’un niveau de qualité acceptable dans vos ensembles de données. Par exemple, vous pouvez exiger que votre ensemble de données soit plus précis et plus fiable que complet.

Comment cela aide-t-il ?

Une définition normalisée de la qualité des données permet de mettre tout le monde sur la même longueur d’onde, afin qu’ils puissent comprendre ce que signifie la qualité des données, à quoi elle ressemble et comment elle peut être mesurée. Cela permet à chaque personne de comprendre et de satisfaire les exigences en matière de qualité des données.

3. Définir les rôles et les responsabilités en matière de données dans l’ensemble de l’organisation

Il est communément admis que la garantie de la qualité des données au niveau de l’entreprise nécessite l’implication ou l’adhésionde la direction générale. En réalité, plus que d’impliquer certaines personnes dans des environnements cloisonnés, vous devez engager des personnes dans les processus existants, et rendre les gens responsables de l’obtention et du maintien de la qualité des données – de la direction de haut niveau au personnel opérationnel.

A quoi cela ressemble-t-il ?

Parmi les rôles courants mais importants en matière de données et leurs responsabilités, citons les suivants :

- Chief Data Officer (CDO) : un représentant des données au sein de la direction de haut niveau, chargé de concevoir des stratégies pour assurer une gestion efficace des données, un suivi de la qualité des données et l’adoption des données dans toute l’organisation.

- Intendant des données : contrôleur de la qualité des données, chargé de garantir l’adéquation des données à l’usage auquel elles sont destinées et de gérer les métadonnées.

- Responsable des données et de l’analyse (D&A) : un acteur des données, chargé d’assurer la maîtrise des données dans l’ensemble de l’organisation et de permettre aux données de produire de la valeur.

Comment cela aide-t-il ?

Lorsque les données sont traitées comme la source principale alimentant les processus commerciaux fondamentaux, un changement se produit à l’échelle de l’entreprise. C’est là que l’attribution de rôles et de responsabilités dans le domaine des données et le fait de donner aux gens le pouvoir d’avoir un impact et de s’exprimer sur les questions cruciales relatives aux données peuvent jouer un rôle important pour assurer une culture des données réussie dans toute organisation.

4. Former et éduquer les équipes sur les données

Dans une enquête menée auprès de 9000 employés jouant différents rôles dans une organisation, seuls 21 % d’entre eux avaient confiance dans leurs compétences en matière de données.

L’introduction de rôles et de responsabilités en matière de données peut avoir un impact positif énorme sur votre entreprise, mais il est néanmoins crucial de considérer que dans un lieu de travail moderne, chaque individu génère, manipule ou traite des données dans ses opérations quotidiennes. C’est pourquoi, s’il est important de confier à certaines personnes la responsabilité de mettre en œuvre des mesures correctives, il est tout aussi nécessaire de former et d’éduquer toutes les équipes sur la manière de traiter les données organisationnelles.

A quoi cela ressemble-t-il ?

Cela peut impliquer la création de plans de maîtrise des données et la conception de cours qui initient les équipes aux données et aux explications de l’organisation :

- Ce qu’il contient,

- La signification de chaque attribut de données,

- Quels sont les critères d’acceptabilité de sa qualité,

- Quelle est la bonne et la mauvaise manière de saisir/manipuler les données ?

- Quelles données utiliser pour atteindre un résultat donné ?

En outre, ces cours peuvent être créés en fonction de la fréquence d’utilisation des données par certains rôles (quotidienne, hebdomadaire ou annuelle).

Comment cela aide-t-il ?

La capacité de lire, de comprendre et d’analyser correctement et précisément les données à tous les niveaux permet à chaque employé de poser les bonnes questions, et ce de la manière la plus optimisée possible. Il garantit également l’efficacité opérationnelle de votre personnel et réduit les erreurs lors de la communication de questions impliquant des données.

5. Contrôler en permanence l’état des données grâce au profilage des données.

Obtenir la qualité des données et la maintenir dans le temps sont deux choses différentes. C’est pourquoi vous devez mettre en œuvre un processus systématique qui surveille en permanence l’état des données et les profile pour découvrir des détails cachés sur leur structure et leur contenu.

La portée et le processus de l’activité de profilage des données peuvent être définis en fonction de la définition de la qualité des données dans votre entreprise et de la manière dont elle est mesurée.

A quoi cela ressemble-t-il ?

Cela peut être réalisé en configurant et en programmant des rapports quotidiens/hebdomadaires sur le profil des données. En outre, vous pouvez concevoir des flux de travail personnalisés pour alerter les responsables des données de votre entreprise si la qualité des données passe en dessous d’un seuil acceptable.

Un rapport sur le profil des données met généralement en évidence un certain nombre d’éléments concernant les ensembles de données examinés, par exemple :

- Le pourcentage de valeurs de données manquantes et incomplètes,

- Le nombre d’enregistrements qui sont des doublons possibles les uns des autres,

- Évaluation des types, des tailles et des formats de données afin de découvrir des valeurs de données invalides,

- Analyse statistique de colonnes de données numériques pour évaluer les distributions.

Comment cela aide-t-il ?

Cette pratique vous permet de détecter les erreurs de données à un stade précoce du processus et d’éviter qu’elles ne se répercutent sur les clients. En outre, il peut aider les Chief Data Officers à rester au fait de la gestion de la qualité des données et à prendre les bonnes décisions, notamment quand et comment résoudre les problèmes mis en évidence dans les profils de données.

En savoir plus sur le profilage des données : Portée, techniques et défis.

6. Concevoir et maintenir des pipelines de données pour obtenir une source unique de vérité.

Un pipeline de données est un processus systématique qui ingère des données d’une source, exécute les techniques de traitement et de transformation nécessaires sur les données, puis les charge dans un référentiel de destination.

Il est essentiel que les données brutes passent par un certain nombre de contrôles de validation avant d’être jugées utilisables et mises à la disposition de tous les utilisateurs de l’organisation.

A quoi cela ressemble-t-il ?

Pour construire un pipeline de données, vous devez revenir à la pratique#02 que nous avons mentionnée dans ce blog : Définir et maintenir la définition de la qualité des données. Et selon cette définition, vous devez décider de la liste numérotée des opérations qui doivent être effectuées sur les données entrantes pour atteindre le niveau de qualité défini.

Voici une liste d’exemples d’opérations qui peuvent être effectuées dans votre pipeline de données :

- Remplacer les valeurs nulles ou vides par un terme standard, tel que « Non disponible ».

- Transformer les valeurs des données selon le modèle et le format définis.

- Analyse syntaxique des champs en deux colonnes ou plus.

- Remplacer les abréviations par des mots appropriés.

- Remplacer les surnoms par des noms propres.

- Si l’enregistrement entrant est suspecté d’être un doublon potentiel, il est fusionné avec l’enregistrement existant, plutôt que d’être créé comme un nouveau.

Comment cela aide-t-il ?

Un pipeline de données agit comme un pare-feu de qualité des données pour vos ensembles de données organisationnelles. La conception d’un pipeline de données permet de garantir la cohérence des données entre toutes les sources et d’éliminer toute divergence éventuelle, avant même que les données ne soient chargées dans la source de destination.

7. Effectuer une analyse des causes profondes des erreurs de qualité des données

Jusqu’à présent, nous nous sommes surtout concentrés sur la manière de suivre la qualité des données et d’éviter que des erreurs de qualité des données n’entrent dans les ensembles de données, mais la vérité est que, malgré tous ces efforts, certaines erreurs finiront probablement par se retrouver dans le système. Non seulement vous devrez les réparer, mais le plus important est de comprendre comment ces erreurs se sont produites afin d’éviter de tels scénarios.

A quoi cela ressemble-t-il ?

Une analyse des causes profondes des erreurs de qualité des données peut impliquer l’obtention du dernier rapport sur le profil des données et la collaboration avec votre équipe pour trouver des réponses à des questions telles que :

- Quelles erreurs de qualité des données ont été rencontrées ?

- D’où viennent-ils ?

- Quand ont-ils vu le jour ?

- Pourquoi se sont-ils retrouvés dans le système malgré tous les contrôles de validation de la qualité des données? On a raté quelque chose ?

- Comment éviter que de telles erreurs ne se reproduisent dans le système ?

Comment cela aide-t-il ?

Aller au cœur des problèmes de qualité des données peut contribuer à éliminer les erreurs à long terme. Vous ne devez pas toujours travailler selon une approche réactive et continuer à corriger les erreurs au fur et à mesure qu’elles se présentent. Grâce à une approche proactive, vous pouvez permettre à vos équipes de réduire au minimum les efforts qu’elles consacrent à la correction des erreurs de qualité des données – et laisser les processus affinés de qualité des données s’occuper de 99 % des problèmes associés aux données.

8. Utiliser la technologie pour atteindre et maintenir la qualité des données.

Ceci nous amène à notre dernière meilleure pratique : l’utilisation de la technologie pour atteindre un cycle de vie durable de la gestion de la qualité des données. Aucun processus n’est censé être performant et offrir le meilleur retour sur investissement s’il n’est pas automatisé et optimisé par la technologie.

A quoi cela ressemble-t-il ?

Investissez dans l’adoption d’un système technologique doté de toutes les fonctionnalités dont vous avez besoin pour garantir la qualité des données dans tous les ensembles de données. Ces caractéristiques comprennent la possibilité de :

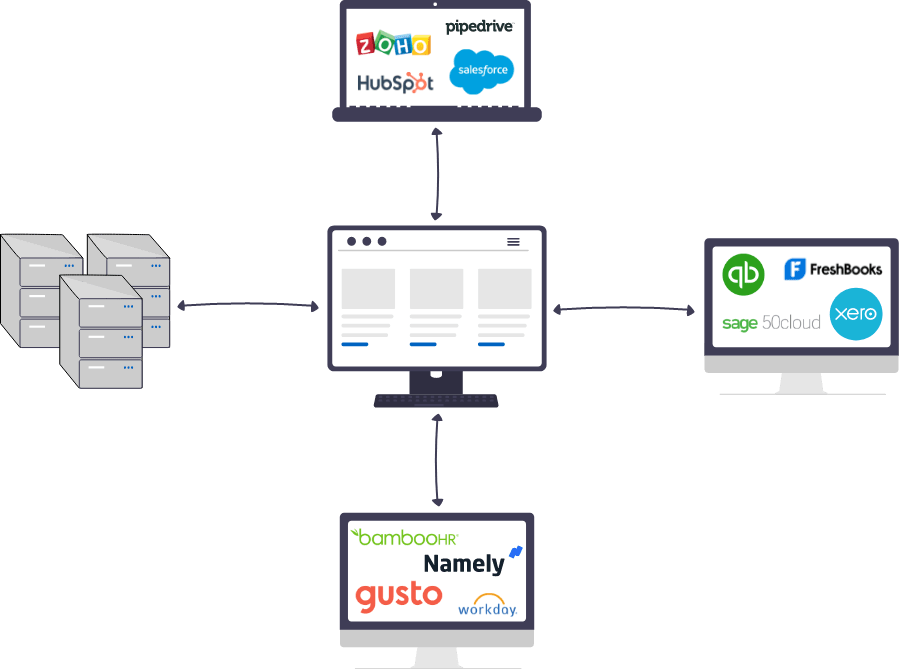

- Importation de données: Intégrez des données provenant de plusieurs sources,

- Profil des données: Évaluer les données pour générer des rapports sur la qualité des données,

- Nettoyage des données: Mettez en évidence les domaines qui pourraient nécessiter un nettoyage, une normalisation et une transformation des données, et mettez en place des solutions,

- Correspondance des données: faites correspondre les données à l’aide d’algorithmes de correspondance exacte et floue avec un haut niveau de précision, et adaptez les algorithmes en fonction de la nature de vos données,

- Déduplication des données: Reliez les enregistrements et trouvez la source unique de vérité,

- Exportation de données : Exportation/chargement des résultats.

En plus des fonctions de gestion de la qualité des données mentionnées ci-dessus, certaines organisations investissent dans des technologies qui offrent également des capacités de gestion centralisée des données. Un exemple d’un tel système est la gestion des données de référence (MDM). Bien qu’un MDM soit une solution complète de gestion des données intégrant des fonctionnalités de qualité des données, toutes les organisations n’ont pas besoin de la liste exhaustive des fonctionnalités d’un tel système.

Vous devez comprendre les besoins de votre entreprise pour évaluer quel type de technologie est la bonne décision pour vous. Vous pouvez lire ce blog pour découvrir les différences fondamentales entre une solution MDM et DQM.

Comment cela aide-t-il ?

L’utilisation de la technologie pour la mise en œuvre de processus qui doivent être répétés régulièrement pour obtenir des résultats durables présente de nombreux avantages. En fournissant à votre équipe des outils de gestion de la qualité des données en libre-service, vous pouvez accroître l’efficacité opérationnelle, éliminer les efforts redondants, améliorer l’expérience client et obtenir des informations commerciales fiables.

Conclusion

La mise en œuvre de mesures de qualité des données cohérentes, automatisées et reproductibles peut aider votre organisation à atteindre et maintenir la qualité des données dans tous les ensembles de données.

Data Ladder offre des solutions de qualité des données à ses clients depuis plus d’une décennie maintenant. DataMatch Enterprise est l’un de ses principaux produits de qualité des données – disponible sous forme d’application autonome ou d’API intégrable – qui permet une gestion de la qualité des données de bout en bout, y compris le profilage, le nettoyage, la mise en correspondance, la déduplication et la purge par fusion des données.

Vous pouvez télécharger l’essai gratuit dès aujourd’hui ou programmer une session personnalisée avec nos experts pour comprendre comment notre produit peut aider à mettre en œuvre les meilleures pratiques pour atteindre et maintenir la qualité des données au niveau de l’entreprise.

The post 8 meilleures pratiques pour assurer la qualité des données au niveau de l’entreprise appeared first on Data Ladder.

]]>The post Guide du filtrage : ce que cela signifie et comment le faire ? appeared first on Data Ladder.

]]>Il est facile de trouver des modèles dans tout type d’environnement riche en données ; c’est ce que font les joueurs médiocres. La clé est de déterminer si les modèles représentent un signal ou du bruit.

Nate Silver

Toute personne qui travaille avec des données comprend l’importance des modèles. Qu’il s’agisse d’une analyse globale de grands ensembles de données ou de l’analyse la plus détaillée possible, les modèles sont partout. Ils peuvent être universels – comme le motif d’un numéro de carte de crédit – ou propres à votre entreprise, par exemple le motif utilisé pour afficher les informations sur les produits sur votre site web.

Lorsque les données sont saisies, elles ne suivent pas toujours le bon modèle. Les entreprises doivent mettre en œuvre différentes méthodes pour faire correspondre, valider et transformer les modèles afin d’obtenir les données dans la forme et le format requis.

Dans ce blog, nous allons apprendre quelques concepts importants liés au filtrage et à la validation, tels que :

- Que signifie la correspondance des modèles ?

- En quoi la correspondance de motifs diffère-t-elle de la correspondance de chaînes de caractères ?

- Comment fonctionne le filtrage ?

- Quelles sont les raisons les plus courantes de faire correspondre et de valider les modèles ?

- Comment pouvez-vous transformer vos données pour obtenir le modèle dont vous avez besoin ?

Plongeons dans le vif du sujet.

Qu’est-ce que le filtrage ?

Un modèle est perçu comme quelque chose qui est à l’opposé du désordre ou du chaos. Il s’agit d’un modèle répétitif qui peut être identifié dans un grand ensemble de valeurs de données appartenant au même domaine. Par conséquent, la correspondance des motifs peut être définie comme suit :

Le processus de recherche d’une séquence ou d’un placement spécifique de caractères dans un ensemble donné de données.

La correspondance de motifs produit des résultats définitifs: la chaîne en entrée contient le motif (elle est valide) ou ne le contient pas (elle est invalide). Si la chaîne de caractères ne contient pas le motif requis, le processus de mise en correspondance est souvent étendu à la transformation du motif, où les sous-éléments de données sont extraits de la valeur d’entrée, puis reformatés pour construire le motif requis.

Correspondance de motifs et correspondance de chaînes de caractères

Avant d’aborder le fonctionnement des algorithmes de filtrage, il est important de comprendre leur relation avec les algorithmes de filtrage de chaînes de caractères. Ces deux concepts sont souvent traités comme une seule et même chose, mais ils sont très différents dans leur objectif et leur utilisation. Le tableau ci-dessous met en évidence certaines des principales différences :

| Correspondance de motifs | Correspondance des chaînes de caractères | |

| Comparaison | Il compare une chaîne de caractères avec un modèle standard qui représente des blocs ou des tokens de caractères. | Il compare deux chaînes de caractères caractère par caractère. |

| Exemple | Comparaison de [email protected] avec [name]@[domain].[domain-extension]. | Comparaison entre Elizabeth et Alizabeth. |

| Résultats | Calcule les résultats définitifs – soit le motif est trouvé, soit il est absent. | Calcule les correspondances exactes (faire correspondre la poussière avec la poussière) ou les correspondances floues (faire correspondre la poussière avec la rouille). |

| Utilisations | Utilisé pour analyser et extraire des valeurs ou transformer des valeurs pour qu’elles suivent des modèles standard. | Utilisé pour corriger les fautes d’orthographe, détecter le plagiat et identifier les valeurs ayant une signification ou une composition de caractère similaire. |

Comment fonctionne le filtrage ?

En termes simples, les algorithmes de filtrage fonctionnent avec des expressions régulières (ou regex). Pour comprendre ce qu’est une expression régulière, pensez-y comme à un langage qui vous aide à définir un motif et à le partager avec quelqu’un – ou dans notre cas, un programme informatique.

Les expressions régulières indiquent aux programmes informatiques le modèle à rechercher dans les données à tester. Parfois, le programme est suffisamment intelligent pour sélectionner des modèles à partir d’un ensemble de valeurs de données et générer automatiquement une regex. Certains programmes ou outils disposent d’une bibliothèque d’expressions rationnelles intégrée qui contient des modèles couramment utilisés, tels que les numéros de carte de crédit, les numéros de téléphone américains, les formats de date, les adresses électroniques, etc.

Exemple de correspondance d’un modèle d’adresse électronique

Pour comprendre ce qu’est un algorithme de comparaison de motifs, prenons l’exemple de la validation du motif des adresses électroniques. La première étape consiste à définir l’expression rationnelle qui communique le modèle d’une adresse électronique valide. Un exemple de modèle d’adresse électronique valide peut ressembler à ceci :

[name]@[domain].[domain-extension]

Dans le langage regex, ce motif sera traduit par :

^[\w-.]+@([\w-]+.)+[\w-]{2,3}$

Où,

- ^ signifie le début d’une phrase et $ la fin.

- [\w-.] désigne un mot qui contient des caractères alphanumériques, un trait de soulignement, un trait d’union ou un point.

- +@ implique l’ajout d’un symbole @.

- ([\w-]+.) désigne un mot qui contient des caractères alphanumériques, un trait de soulignement ou un trait d’union, et qui se termine par un point.

- +[\w-]{2,3} signifie un mot qui contient des caractères alphanumériques ou un trait d’union, et ce mot ne peut avoir que deux caractères au minimum et trois au maximum.

Ci-dessous, vous pouvez voir un certain nombre d’adresses électroniques de test qui ont été soumises à ce modèle regex et les résultats obtenus.

| Non. | Test | Résultat | Raison de l’échec |

| 1. | [email protected] | Valable | |

| 2. | pam.beesly_gmail.com | Invalide | Symbole @ manquant. |

| 3. | [email protected] | Invalide | Le domaine a un point d’arrêt inattendu. |

| 4. | [email protected] | Invalide | L’extension du domaine comporte plus de 3 caractères (par exemple, com4). |

Il est évident que la définition manuelle des regex est fastidieuse et nécessite une certaine expertise. Vous pouvez également opter pour des outils de normalisation des données qui proposent des concepteurs visuels de regex (nous y reviendrons dans une section ultérieure).

Cas d’utilisation du filtrage

Maintenant que nous savons ce qu’est le filtrage et comment fonctionne l’algorithme, vous vous demandez peut-être à quoi il sert exactement. La correspondance des motifs est l’un des concepts les plus fondamentaux dans différents domaines, tels que la programmation informatique, la science et l’analyse des données, le traitement du langage naturel, etc.

Si nous parlons spécifiquement du filtrage et de la validation dans le domaine des données, voici quelques-unes de ses applications les plus courantes :

1. Validation des soumissions de formulaires

Comme la comparaison de modèles de données permet de distinguer les informations valides des informations non valides, elle est surtout utilisée pour valider les formulaires soumis sur des sites Web ou d’autres applications logicielles. L’expression rationnelle est appliquée aux champs du formulaire selon les besoins ; quelques exemples de validations sont donnés ci-dessous :

- Le nom d’une personne ne contient que des alphabets ou des symboles,

- L’adresse électronique suit le modèle correct,

- Le numéro de téléphone ne contient que des chiffres,

- Le numéro de la carte de crédit ne doit pas comporter plus de 16 chiffres, etc.

2. Effectuer des opérations de recherche et de remplacement

Le filtrage est également utile dans les applications qui disposent de fonctions de recherche et de remplacement d’informations textuelles. Certaines applications de base ne proposent que la correspondance caractère par caractère (ou correspondance de chaînes de caractères), tandis que d’autres offrent également la fonctionnalité de recherche et de remplacement regex, qui vous permet de rechercher des modèles dans les documents texte et pas seulement des correspondances exactes de chaînes de caractères.

3. Nettoyage et normalisation des ensembles de données

Vous pouvez essayer de valider les informations au moment de la saisie des données – comme les soumissions de formulaires, mais en raison des diverses limitations et restrictions rencontrées dans les systèmes, vos ensembles de données organisationnelles peuvent toujours se retrouver avec des représentations multiples des mêmes informations. C’est là qu’il devient impératif de nettoyer et de normaliser les ensembles de données avant de les utiliser pour les opérations de routine ou la BI.

4. Analyse syntaxique et extraction des valeurs

Étant donné que le filtrage par motif recherche une séquence spécifique de caractères dans une valeur donnée, ce processus est également utile pour faire correspondre et extraire des éléments de valeur qui se trouvent dans des formes d’information étendues. Par exemple, vous pouvez extraire les domaines d’une liste d’adresses électroniques professionnelles pour savoir dans quelle entreprise la personne travaille, ou vous pouvez extraire la ville et le pays de résidence des champs d’adresse qui contiennent 3-4 lignes d’informations.

Comment faire correspondre des modèles ?

Deux approches sont généralement adoptées par les entreprises lors de la comparaison et de la validation des modèles : l’une consiste à écrire des scripts de code internes et l’autre à utiliser des outils logiciels tiers. Discutons de la mise en œuvre de ces deux approches.

1. Correspondance de motifs à l’aide d’un code

Lorsqu’il s’agit de nettoyer et de normaliser des données, la solution par défaut pour de nombreuses organisations consiste à créer des applications internes personnalisées et des scripts de codage pour diverses opérations de normalisation, notamment le rapprochement et la transformation des modèles. Aussi intéressant que cela puisse paraître, cela peut être un véritable défi.

Why in-house data quality projects fail

Read this whitepaper to understand the consequences of ignoring poor data quality, gain insight on why in-house data quality solutions fail and at what costs.

DownloadJetons un coup d’œil à un extrait de code JavaScript qui valide les adresses électroniques.

| fonction emailValidation(input) { var regex = /^\w+([.-]?\w+)@\w+([.-]?\w+)(.\w{2,3})+$/ ; if(input.value.match(regex)) { alert("Valid"); return true;} sinon { alert("Invalid"); return false;} } |

Notez que cet extrait de code ne fait que valider les adresses électroniques et ne les transforme pas en un modèle standardisé au cas où elles ne seraient pas valides. En outre, il ne valide que le champ de l’adresse électronique, de sorte que pour faire correspondre différents modèles, vous devez mettre en œuvre un code similaire pour chacun d’eux. Enfin, la regex qui valide les adresses électroniques est encore un peu plus facile à décoder. Si nous considérons les champs de données qui ont des motifs complexes, les regex peuvent s’étendre sur un certain nombre de lignes. Par exemple, l’extrait de code suivant recherche des correspondances de motifs pour les URL.

| fonction URLValidation(input) { var regex = /[-a-zA-Z0-9@:%.+~#=] {1,256}.[a-zA-Z0-9()]{1,6}\b ([-a-zA-Z0-9()@:%+.~#?&//=]*) ?/gi ; if(input.value.match(regex)) { alert("Valid"); return true;} sinon { alert("Invalid"); return false;} } |

2. Correspondance de motifs à l’aide d’outils logiciels

Pour les raisons mentionnées ci-dessus, la maintenance des applications personnalisées peut être très gourmande en ressources. Il vous faut engager une équipe de développeurs internes qui sont constamment sollicités par les utilisateurs professionnels pour déboguer et mettre à jour les fonctionnalités du code.

C’est pourquoi de nombreux responsables et ingénieurs de données chevronnés penchent pour l’idée d’adopter des outils simples de création, de mise en correspondance et de transformation des modèles, qui peuvent être facilement utilisés par le personnel informatique et non informatique.

Ces apparieurs de motifs sont dotés de différentes caractéristiques. Les caractéristiques les plus courantes sont présentées ci-dessous.

1. Constructeurs de modèles visuels

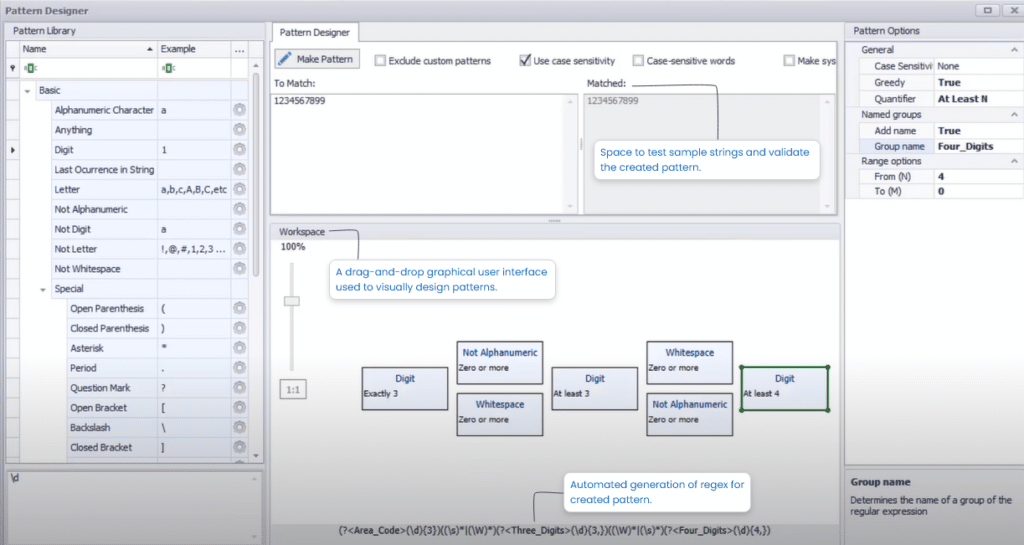

Une fonction de création de modèles visuels offre une interface utilisateur graphique de type glisser-déposer qui peut être utilisée pour créer des modèles. Lorsqu’un utilisateur dépose des blocs de motifs ou des jetons dans l’espace de travail, une expression rationnelle équivalente est générée en arrière-plan. Cette fonctionnalité élimine le besoin d’expertise technique et encourage les utilisateurs naïfs à construire eux aussi des modèles.

Une capture d’écran du concepteur de modèles visuels dans DataMatch Enterprise est présentée ci-dessous :

2. Correspondance de motifs par type de données

Une autre caractéristique intéressante des outils de comparaison de motifs est la possibilité de profiler des colonnes entières en fonction de leurs types de données. Par exemple, vous pouvez profiler la colonne des numéros de téléphone par le type de données entières, et la fraction des valeurs qui contiennent d’autres symboles et caractères en plus des chiffres peut être signalée comme non valide. Cela peut être fait pour obtenir une évaluation rapide de l’effort de normalisation nécessaire pour corriger les modèles invalides.

Une capture d’écran des modèles de correspondance par type de données dans DataMatch Enterprise est présentée ci-dessous :

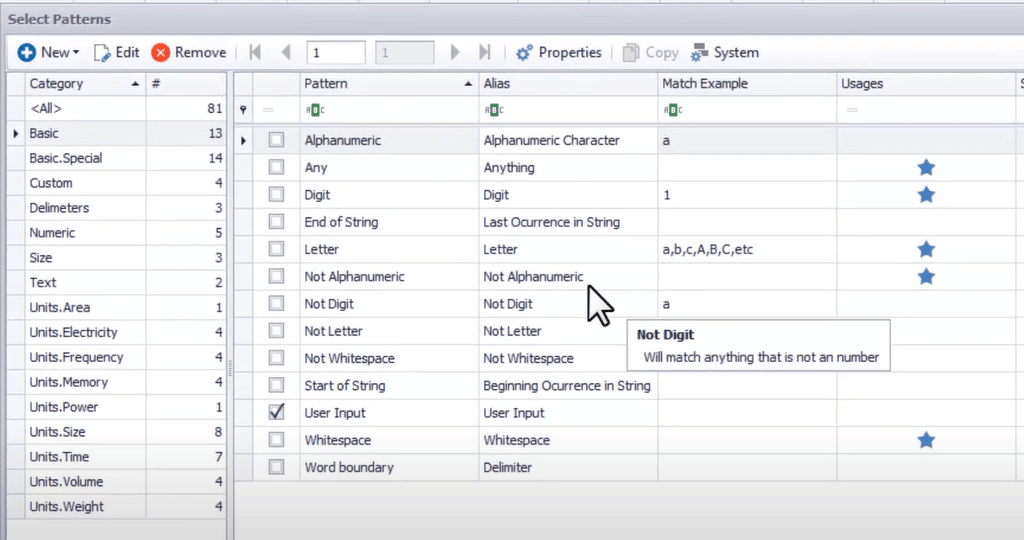

3. Correspondance de motifs à l’aide de la bibliothèque regex

De nombreux outils sont dotés de bibliothèques d’expressions rationnelles intégrées contenant des modèles couramment utilisés, tels que les numéros de carte de crédit, les numéros de téléphone américains, les formats de date, les adresses électroniques, etc. En outre, vous pouvez également créer des modèles personnalisés (spécialisés pour votre usage professionnel) et les enregistrer dans la bibliothèque pour les réutiliser.

Une capture d’écran de la bibliothèque regex dans DataMatch Enterprise est présentée ci-dessous :

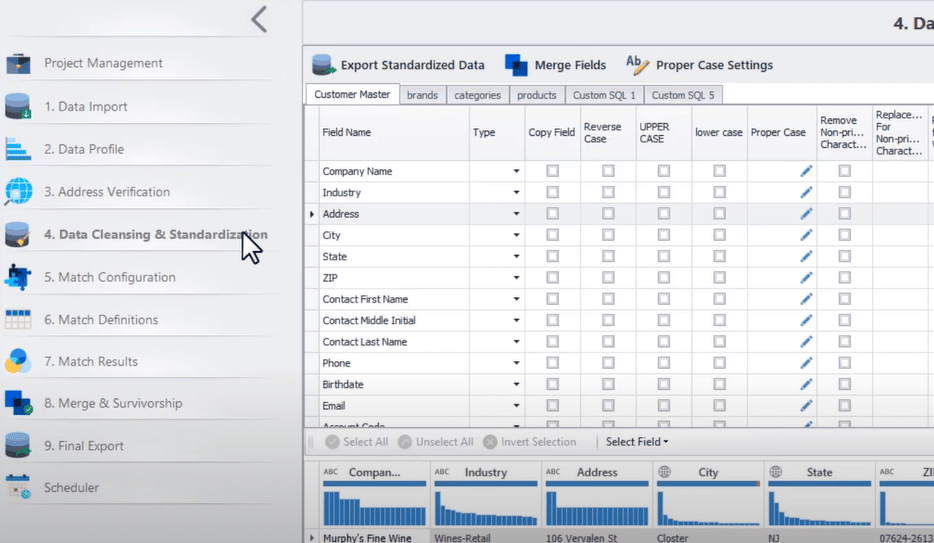

4. Ensemble complet de nettoyage et de normalisation des données

L’un des principaux avantages de ces outils est qu’ils sont généralement fournis avec d’autres fonctions de nettoyage et de normalisation des données, qui sont essentielles pour transformer vos données en une forme et un format acceptables. En effet, une fois que vous disposez d’un rapport sur le filtrage qui indique les valeurs de données valides et celles qui ne le sont pas, l’étape suivante consiste à corriger les modèles.

C’est pourquoi l’adoption d’un système de bout en bout qui prend en charge les diverses disciplines de la gestion de la qualité des données – y compris le profilage, le nettoyage, la normalisation, la mise en correspondance et la fusion des données – peut constituer un énorme avantage.

Une capture d’écran des diverses fonctions de qualité des données offertes par DataMatch Enterprise est présentée ci-dessous :

Opter pour une solution sans code qui construit, fait correspondre et transforme les modèles.

Bien que nous nous soyons surtout concentrés sur la correspondance des motifs dans ce blog, l’art de la transformation des motifs est tout aussi intéressant – et pourtant difficile. C’est pourquoi de nombreuses entreprises souhaitent fournir à leurs équipes des outils de nettoyage et de normalisation des données en libre-service, conçus avec des fonctions de conception, de mise en correspondance et de transformation de modèles. L’adoption de tels outils peut aider votre équipe à exécuter des techniques complexes de nettoyage et de normalisation des données sur des millions d’enregistrements en quelques minutes.

DataMatch Enterprise est l’un de ces outils qui permet aux équipes chargées des données de rectifier les erreurs de modèle avec rapidité et précision, et de se concentrer sur des tâches plus importantes. Pour en savoir plus sur la façon dont DataMatch Enterprise peut vous aider, vous pouvez télécharger un essai gratuit aujourd’hui ou réserver une démonstration avec un expert.

The post Guide du filtrage : ce que cela signifie et comment le faire ? appeared first on Data Ladder.

]]>The post Guide de la normalisation des données : Types, avantages et processus appeared first on Data Ladder.

]]>Lorsque vous extrayez des données de diverses applications installées dans toute l’entreprise, vous vous attendez à recevoir une définition et un format cohérents de ces mêmes informations. Mais en réalité, c’est rarement le cas. Les variations présentes dans les ensembles de données – entre les applications et même au sein d’une même application – rendent presque impossible l’utilisation des données à toutes fins – des opérations de routine à la veille économique.

Aujourd’hui, une entreprise moyenne utilise plusieurs applications SaaS et internes. Chaque système est assorti de son propre ensemble d’exigences, de restrictions et de limitations. C’est la raison pour laquelle les données hébergées dans différentes applications contiennent forcément des divergences. Et si l’on tient compte des fautes d’orthographe, des abréviations, des surnoms et des erreurs de frappe, on se rend compte que les mêmes valeurs peuvent avoir des centaines de représentations différentes. C’est là qu’il devient impératif de normaliser les données afin de les rendre utilisables à toutes fins utiles.

Dans ce blog, nous allons tout apprendre sur la normalisation des données : ce qu’elle est, pourquoi et quand vous en avez besoin, et comment vous pouvez la faire. Commençons.

Qu’est-ce que la normalisation des données ?

Dans le monde des données, une norme désigne un format ou une représentation auquel chaque valeur d’un certain domaine doit se conformer. Par conséquent, normaliser les données signifie :

Le processus de transformation d’une représentation incorrecte ou inacceptable de données en une forme acceptable.

Le moyen le plus simple de savoir ce qui est « acceptable » est de comprendre les exigences de votre entreprise. Idéalement, les organisations doivent veiller à ce que le modèle de données utilisé par la plupart – sinon toutes – les applications soit conforme à leurs besoins commerciaux. La meilleure façon de parvenir à la normalisation des données est d’aligner la représentation, la structure et la définition de vos données sur les exigences de l’organisation.

Types et exemples d’erreurs de normalisation des données

Voici quelques exemples de la façon dont des données non normalisées peuvent se retrouver dans le système :

- Le numéro de téléphone du client est enregistré sous forme de chaîne de caractères dans un système alors qu’il ne peut être qu’un numéro à 8 chiffres dans un autre système – ce qui entraîne une incohérence dans le type de données.

- Le nom du client est enregistré dans un seul champ dans un système alors qu’il est couvert par trois champs distincts dans un autre système pour le prénom, le second prénom et le nom de famille, ce qui entraîne une incohérence structurelle.

- La date de naissance du client a le format MM/JJ/AAAA dans un système, alors qu’elle a le format Mois Jour, Année dans un autre système – ce qui entraîne une incohérence de format.

- Le sexe du client est enregistré en tant que Female ou Male dans un système, alors qu’il est enregistré en tant que F ou M dans un autre système – ce qui entraîne une incohérence des valeurs du domaine.

Outre ces scénarios courants, les fautes d’orthographe, les erreurs de transcription et l’absence de contraintes de validation peuvent accroître les erreurs de normalisation des données dans vos ensembles de données.

Pourquoi devez-vous normaliser les données ?

Chaque système a son propre ensemble de limitations et de restrictions, ce qui conduit à des modèles de données uniques et à leurs définitions. C’est pourquoi il peut être nécessaire de transformer les données avant qu’elles ne puissent être consommées correctement par un processus métier.

En général, on sait qu’il est temps de normaliser les données quand on le souhaite :

1. Conformer les données entrantes ou sortantes

Une organisation possède de nombreuses interfaces qui permettent d’échanger des points de données provenant de parties prenantes externes, telles que des fournisseurs ou des partenaires. Chaque fois que des données entrent dans une entreprise ou sont exportées, il devient nécessaire de les conformer à la norme requise, sinon le fouillis de données non normalisées ne fait que s’amplifier.

2. Préparer les données pour la BI ou l’analytique

Les mêmes données peuvent être représentées de plusieurs façons, mais la plupart des outils de BI ne sont pas spécialisés pour traiter toutes les représentations possibles des valeurs de données et peuvent finir par traiter différemment des données de même signification. Cela peut conduire à des résultats BI biaisés ou inexacts. Par conséquent, avant de pouvoir alimenter vos systèmes de BI en données, celles-ci doivent être nettoyées, normalisées et dédupliquées, afin que vous puissiez obtenir des informations correctes et utiles.

3. Consolider les entités pour éliminer les doublons

La duplication des données est l’un des plus grands risques pour la qualité des données auxquels les entreprises sont confrontées. Pour des opérations commerciales efficaces et sans erreur, vous devez éliminer les enregistrements en double qui appartiennent à la même entité (qu’il s’agisse d’un client, d’un produit, d’un emplacement ou d’un employé). Un processus efficace de déduplication des données exige que vous vous conformiez aux normes de qualité des données.

4. Partager les données entre les départements

Pour que les données soient interopérables entre les départements, elles doivent être dans un format compréhensible par tous. Dans la plupart des cas, les organisations disposent d’informations sur les clients dans les systèmes de gestion de la relation client, qui sont comprises par les responsables des ventes et du marketing. Cela peut entraîner des retards dans l’accomplissement des tâches et bloquer la productivité de l’équipe.

Nettoyage des données ou normalisation des données

Les terminologies de nettoyage des données et de normalisation des données sont généralement utilisées de manière interchangeable. Mais il y a une légère différence entre les deux.

Le nettoyage des données est le processus qui consiste à identifier les données incorrectes ou sales et à les remplacer par des valeurs correctes, tandis que la normalisation des données est le processus qui consiste à transformer les valeurs des données d’un format inacceptable en un format acceptable.

L’objectif et le résultat de ces deux processus sont similaires : vous voulez éliminer les inexactitudes et les incohérences de vos ensembles de données. Ces deux processus sont essentiels à votre initiative de gestion de la qualité des données et doivent aller de pair.

Comment normaliser les données ?

Un processus de normalisation des données comporte quatre étapes simples : définir, tester, transformer et retester. Examinons chaque étape un peu plus en détail.

1. Définir une norme

Dans un premier temps, vous devez identifier la norme qui répond aux besoins de votre organisation. La meilleure façon de définir une norme est de concevoir un modèle de données pour votre entreprise. Ce modèle de données représente l’état le plus idéal auquel les valeurs des données d’une certaine entité doivent se conformer. Un modèle de données peut être conçu comme :

- Identifiez les données essentielles au fonctionnement de votre entreprise. Par exemple, la plupart des entreprises saisissent et gèrent des données relatives aux clients, aux produits, aux employés, aux sites, etc.

- Définissez les champs de données de chaque actif identifié et décidez également des détails structurels. Par exemple, vous pouvez souhaiter stocker le nom, l’adresse, l’adresse électronique et le numéro de téléphone d’un client, le champ Nom couvrant trois champs et le champ Adresse deux champs.

- Attribuez un type de données à chaque champ identifié dans le poste. Par exemple, le champ Nom est une valeur de type chaîne de caractères, le champ Numéro de téléphone est une valeur entière, et ainsi de suite.

- Définissez des limites de caractères (minimum et maximum) pour chaque champ. Par exemple, un nom ne peut pas comporter plus de 15 caractères et un numéro de téléphone ne peut pas comporter plus de 8 chiffres, etc.

- Définissez le modèle auquel les champs doivent se conformer – ce modèle peut ne pas être applicable à tous les champs. Par exemple, l’adresse électronique de chaque client doit respecter le regex : [chars]@[chars].[chars].

- Définir le format dans lequel certains éléments de données doivent être placés dans un champ. Par exemple, la date de naissance d’un client doit être spécifiée sous la forme MM/JJ/AAAA.

- Définissez l’unité de mesure des valeurs numériques (le cas échéant). Par exemple, l’âge du client est mesuré en années.

- Définissez le domaine de valeurs pour les champs qui doivent être dérivés d’un certain ensemble de valeurs. Par exemple, l’âge du client doit être un chiffre compris entre 18 et 50, le sexe doit être Masculin ou Féminin, et ainsi de suite.

Un modèle de données conçu peut ensuite être placé dans un diagramme de classe ERD pour aider à visualiser la norme définie pour chaque actif de données et comment ils sont liés les uns aux autres. Un exemple de modèle de données pour une entreprise de vente au détail est présenté ci-dessous :

2. Test de la norme

Les techniques de normalisation des données commencent à la deuxième étape, puisque la première étape se concentre sur la définition de ce qui devrait être – quelque chose qui est fait une fois ou revu et mis à jour de façon incrémentielle de temps en temps.

Vous avez défini la norme et il est maintenant temps de voir dans quelle mesure les données actuelles s’y conforment. Nous examinons ci-dessous un certain nombre de techniques qui permettent de tester les valeurs de données pour détecter les erreurs de normalisation et de créer un rapport de normalisation qui peut être utilisé pour résoudre les problèmes.

a. Analyse syntaxique des enregistrements et des attributs

La conception d’un modèle de données est la partie la plus cruciale de la gestion des données. Mais malheureusement, de nombreuses organisations ne conçoivent pas de modèles de données et ne définissent pas de normes de données communes à temps, ou encore les applications qu’elles utilisent ne disposent pas de modèles de données personnalisables – ce qui les conduit à capturer des données sous des noms de champs et des structures variables.

Lorsque vous interrogez des informations provenant de différents systèmes, vous pouvez remarquer que certains enregistrements renvoient le nom d’un client sous la forme d’un champ unique, tandis que d’autres renvoient trois, voire quatre champs couvrant le nom du client. C’est pourquoi, avant de pouvoir rechercher les erreurs dans un ensemble de données, vous devez commencer par analyser les enregistrements et les champs pour obtenir les composants qui doivent être testés pour la normalisation.

b. Rapport sur le profil des données du bâtiment

L’étape suivante consiste à faire passer les composants analysés par un système de profilage. Un outil de profilage des données présente différentes statistiques sur les attributs des données, telles que

- Combien de valeurs dans une colonne respectent le type, le format et le modèle de données requis ?

- Quel est le nombre moyen de caractères présents dans une colonne ?

- Quelles sont les valeurs minimales et maximales présentes dans une colonne numérique ?

- Quelles sont les valeurs les plus courantes présentes dans une colonne et combien de fois apparaissent-elles ?

c. Correspondance et validation des modèles

Bien que les outils de profilage des données fassent état des correspondances de motifs, étant donné qu’il s’agit d’une partie importante des tests de normalisation des données, nous allons en parler un peu plus en profondeur. Pour faire correspondre des motifs, vous devez d’abord définir une expression régulière standard pour un champ. Par exemple, une expression régulière pour les adresses électroniques peut être : ^[a-zA-Z0-9+_ .-]+@[a-zA-Z0-9 .-]+$. Toutes les adresses électroniques qui ne suivent pas le modèle donné doivent être signalées pendant le test.

d. Utilisation des dictionnaires