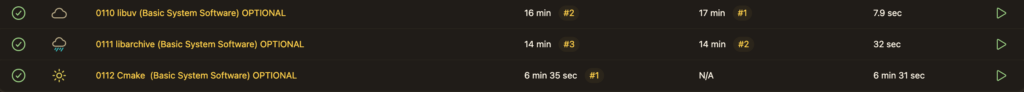

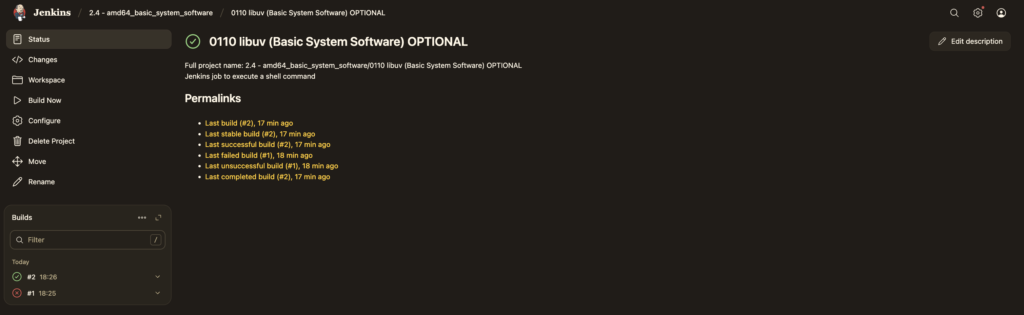

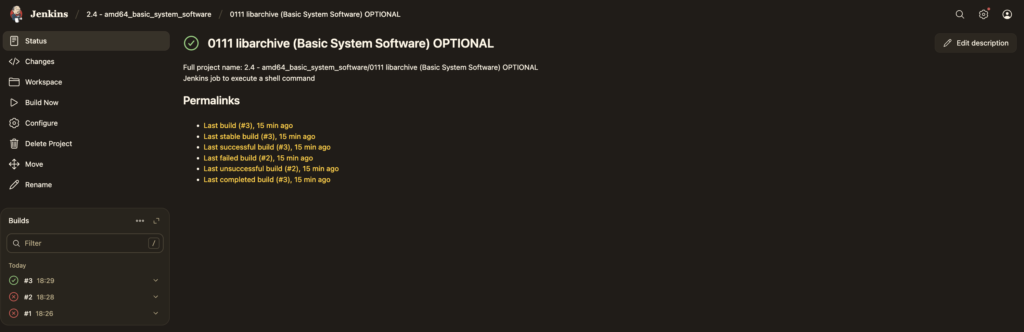

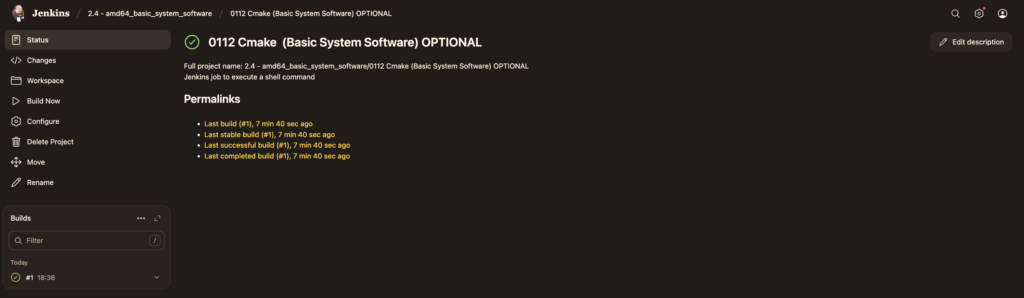

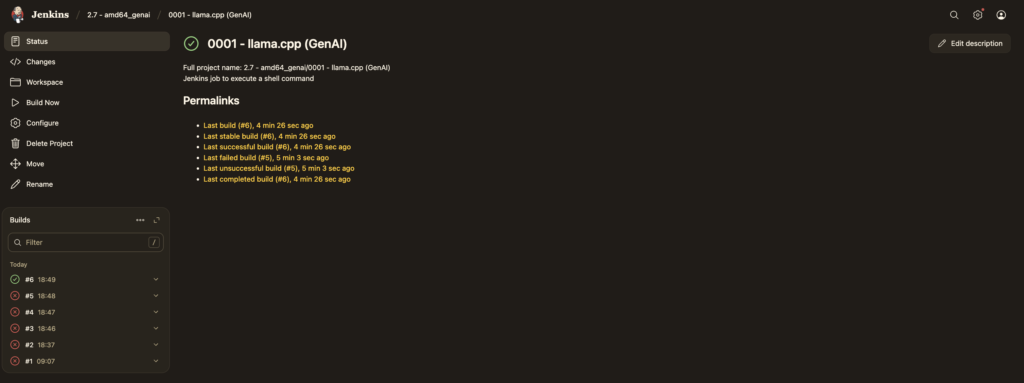

llama.cpp, which seems more practical than vLLM for CPU-only setups. First, I need to compile a few dependencies (libuv, libarchive, and CMake). As described in the llama.cpp documentation, CMake is required to build the project.

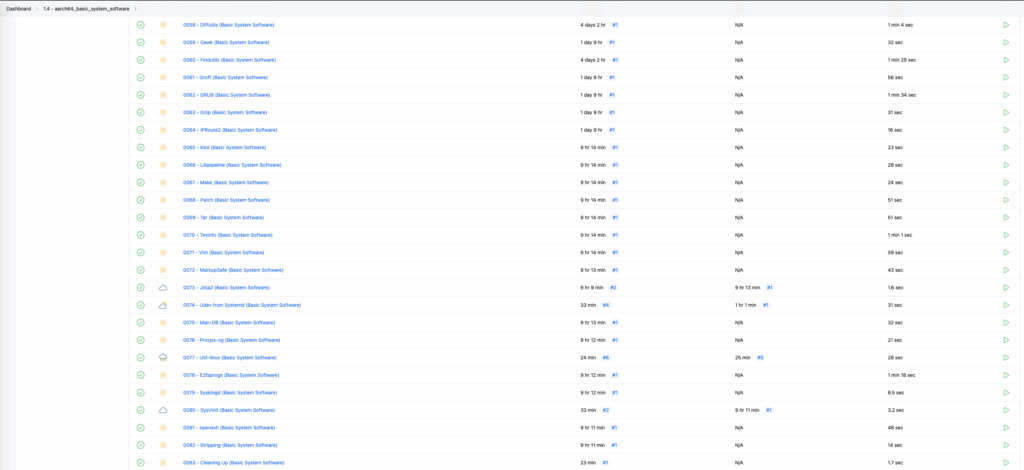

I have prepare several Jenkins jobs via Ansible…

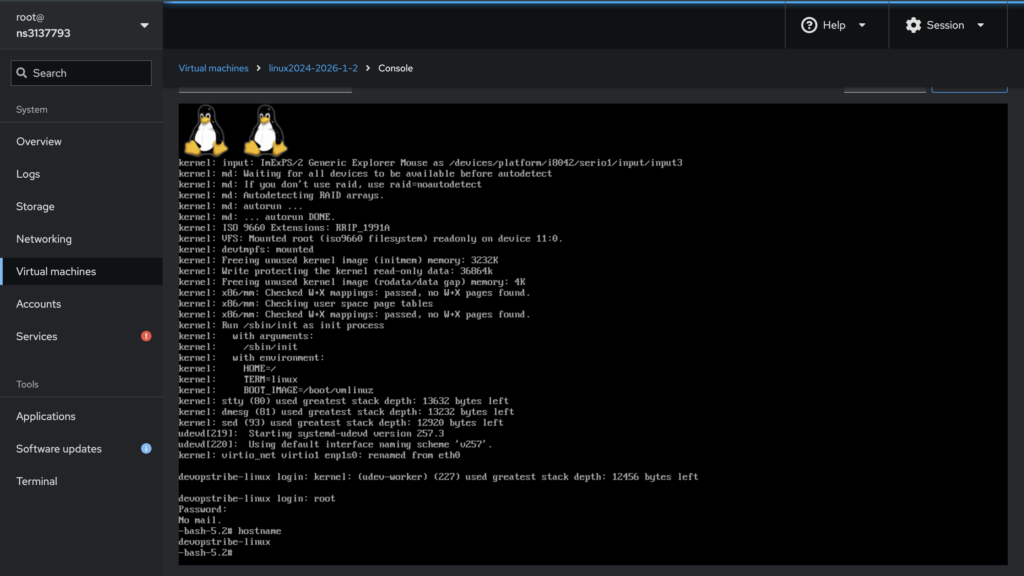

Chroot into the system to ensure the CMake binary is available

ubuntu@ns3137793:~/gdt$ sudo bash ./jenkins-lfs/chroot_in.sh

(lfs chroot) root:/# find / -name "cmake" -type f

/sources/cmake-4.2.1/Bootstrap.cmk/cmake

/sources/cmake-4.2.1/bin/cmakeBuild llama.cpp

I’m now ready to load a lightweight model and launch llama-server. To conserve resources, I’ve bypassed systemd and written a custom init script to handle the startup process.

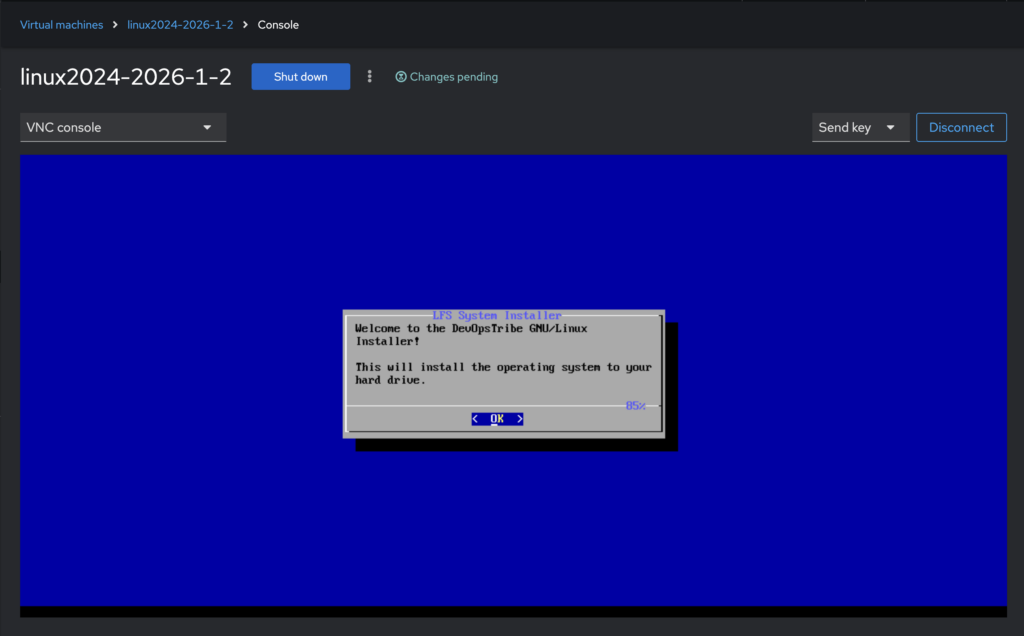

This is a video of an example of how to build an ISO, boot it, and test local AI inference.

I’m working on this repo: https://github.com/lucky-sideburn/generic-distro-toolkit. Anyone who wants to join is more than welcome!

]]>

My latest update was creating a .img file, which I run through Cockpit (using https://github.com/cockpit-project/cockpit-machines). Now, I would like to create a bootable operating system by generating an ISO image.

This process takes the previously created root filesystem, which contains a minimal structure to be executed.

root@ns3137793:/mnt/lfs# du -chs *

0 bin

28M boot

8.0K build

0 dev

4.0K dist

17M etc

4.0K home

0 lib

4.0K lib64

12K media

4.0K mnt

4.0K opt

4.0K proc

1.5M root

44K run

0 sbin

4.0K srv

4.0K sys

148K tmp

2.2G usr

84K var

Instead of using prepare_image.sh (https://github.com/lucky-sideburn/generic-distro-toolkit/blob/main/jenkins-lfs/playbooks/roles/ansible-gdt/files/prepare_image.sh), I need to create a prepare_iso.sh shell script. The initial concept is to maintain the entire root filesystem structure while creating custom grub.cfg, inittab, and fstab files.

# This is a temporary folder. I want to avoid corrupting my original /mnt/lfs

ISO_WORKSPACE="/tmp/lfs_iso_ws"

sudo mkdir -p $ISO_WORKSPACE

# I copy everything from /mnt/lfs but excluding sources directory

# Use -a to preserve permissions/symlinks which are critical for LFS

sudo rsync -a --progress --exclude='/mnt/lfs/sources' --exclude='/mnt/lfs/build' /mnt/lfs/ $ISO_WORKSPACE/

# Copy the Kernel

sudo cp /mnt/lfs/boot/vmlinuz-6.13.4-lfs-12.3 $ISO_WORKSPACE/boot/vmlinuz

# Create the GRUB config inside the workspace

# This is a live iso so my root is /dev/sr0

# I want to have tty console and serial console so I define both console=ttyS0,115200 console=tty1

# Use InitramFS

sudo mkdir -p $ISO_WORKSPACE/boot/grub

sudo tee $ISO_WORKSPACE/boot/grub/grub.cfg << EOF

set default=0

set timeout=10

menuentry "DevOpstribe Linux" {

linux /boot/vmlinuz root=/dev/sr0 ro rootfstype=iso9660 init=/sbin/init console=ttyS0,115200 console=tty1

initrd /boot/initrd.img-6.13.4

}

EOF

# I create an inittab file to define 3 as default runlevel (for production system use SystemD :D)

# Please pay attention to 1:2345:respawn:/sbin/agetty --autologin root --noclear -n tty1 9600, I do not want login with username and password but I want to start the installer script directly after the boot process

sudo tee $ISO_WORKSPACE/etc/inittab << 'EOF'

# Default Runlevel

id:3:initdefault:

# System initialization

si::sysinit:/etc/rc.d/init.d/rc S

# What to do in single-user mode

~:S:wait:/sbin/sulogin

# What to do when CTRL-ALT-DEL is pressed

ca::ctrlaltdel:/sbin/shutdown -t1 -a -r now

# Runlevels

l0:0:wait:/etc/rc.d/init.d/rc 0

l1:1:wait:/etc/rc.d/init.d/rc 1

l2:2:wait:/etc/rc.d/init.d/rc 2

l3:3:wait:/etc/rc.d/init.d/rc 3

l4:4:wait:/etc/rc.d/init.d/rc 4

l5:5:wait:/etc/rc.d/init.d/rc 5

l6:6:wait:/etc/rc.d/init.d/rc 6

# Consoles

1:2345:respawn:/sbin/agetty --autologin root --noclear -n tty1 9600

2:2345:respawn:/sbin/agetty tty2 9600

3:2345:respawn:/sbin/agetty tty3 9600

# End of /etc/inittab

EOF

sudo tee $ISO_WORKSPACE/etc/fstab << 'EOF'

# Begin /etc/fstab for Live ISO

# file system mount-point type options dump fsck

proc /proc proc nosuid,noexec,nodev 0 0

sysfs /sys sysfs nosuid,noexec,nodev 0 0

devpts /dev/pts devpts gid=5,mode=620 0 0

tmpfs /run tmpfs defaults 0 0

devtmpfs /dev devtmpfs mode=0755,nosuid 0 0

tmpfs /dev/shm tmpfs nosuid,nodev 0 0

cgroup2 /sys/fs/cgroup cgroup2 nosuid,noexec,nodev 0 0

# CD-ROM is already mounted as root, no need to mount it again

# /dev/sr0 / iso9660 ro 0 0

# End /etc/fstab

EOF

sudo rm $ISO_WORKSPACE/etc/rc.d/rcS.d/S45cleanfs

sudo rm $ISO_WORKSPACE/etc/rc.d/rcS.d/S40mountfs

echo "devopstribe-linux" | sudo tee $ISO_WORKSPACE/etc/hostname

# Also update /etc/hosts

sudo tee $ISO_WORKSPACE/etc/hosts << 'EOF'

# Begin /etc/hosts

127.0.0.1 localhost.localdomain localhost

127.0.1.1 lfs-live.localdomain lfs-live

::1 localhost ip6-localhost ip6-loopback

ff02::1 ip6-allnodes

ff02::2 ip6-allrouters

# End /etc/hosts

EOF

# Make sure hostname is set at boot

# Check if you have a hostname init script

ls -l $ISO_WORKSPACE/etc/rc.d/init.d/hostname

# If it doesn't exist, create one

sudo tee $ISO_WORKSPACE/etc/rc.d/init.d/hostname << 'EOF'

#!/bin/sh

########################################################################

# Begin hostname

#

# Description : Set hostname

#

########################################################################

. /lib/lsb/init-functions

case "${1}" in

start)

log_info_msg "Setting hostname..."

hostname -F /etc/hostname

evaluate_retval

;;

*)

echo "Usage: ${0} {start}"

exit 1

;;

esac

# End hostname

EOF

sudo cp /mnt/lfs/sources/system-installer.sh $ISO_WORKSPACE/usr/local/bin/system-installer.sh

sudo chmod +x $ISO_WORKSPACE/usr/local/bin/system-installer.sh

> $ISO_WORKSPACE/root/.bashrc

> $ISO_WORKSPACE/root/.bash_profile

sudo tee -a $ISO_WORKSPACE/root/.bashrc << 'EOF'

#!/bin/bash

# 1. Stop kernel messages

dmesg -n 1

# Restore terminal settings

stty sane

# 2. Clear the screen completely

clear

# 4. Optional: Restore kernel logging on exit

dmesg -n 7

# Auto-start installer on first login

# It is important to use "exec" because we don't want that the user exit from the installer script

if [ -f /usr/local/bin/system-installer.sh ]; then

exec /usr/local/bin/system-installer.sh

fi

EOF

sudo tee -a $ISO_WORKSPACE/root/.bash_profile << 'EOF'

# Carica il bashrc se esiste

if [ -f ~/.bashrc ]; then

. ~/.bashrc

fi

EOF

cat $ISO_WORKSPACE/root/.bash_profile

sudo chmod +x $ISO_WORKSPACE/etc/rc.d/init.d/hostname

# Link it to run early in boot

sudo ln -sf ../init.d/hostname $ISO_WORKSPACE/etc/rc.d/rcS.d/S02hostname

# 5. Generate the ISO

# WARNING: This ISO will be the size of your entire LFS install

sudo grub-mkrescue -o /var/lib/libvirt/images/lfs-system.iso $ISO_WORKSPACE -- -hfsplus off

sudo chown libvirt-qemu:kvm /var/lib/libvirt/images/lfs-system.iso

Now the system can boot from the lfs-system.iso image.

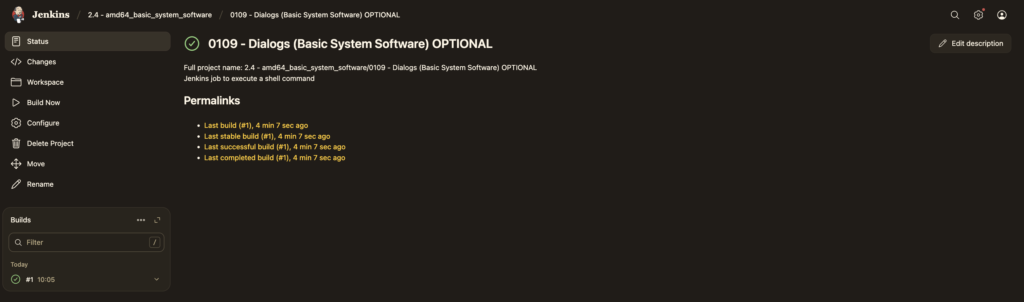

I want to provide a minimal graphical interface for my users, so I have chosen Dialog. It is very lightweight and is already used by several popular Linux distributions.

I will now add the Dialog compilation tasks to Jenkins by creating the job via Ansible. This is part of https://github.com/lucky-sideburn/generic-distro-toolkit that I use to automate some tasks.

- name: 0109 - Dialogs (Basic System Software) OPTIONAL

version: 2.15

archive_file: /sources/dialog.tar.gz

source_dir: /sources/dialog-1.3-20251223

description: |

Dialog is a tool for creating text-based user interfaces. This job builds Dialog, which is essential for managing file archives in the LFS environment.

category:

This job is part of the system configuration setup, specifically for building Dialog.

jenkins_job_url: http://localhost:8080/job/system_configuration/Dialogs-1.3-20251223

exec_command: echo

build_tool: true

build_command: |

{{ chroot_start_command }} -c '

cd /sources/dialog-1.3-20251223

./configure --prefix=/usr \

--with-ncursesw \

--enable-nls \

--with-libtool

make

make install

'

Once Dialogs is installed, you can use it at login configuring .bash_profile and .bashrc

sudo tee -a $ISO_WORKSPACE/root/.bashrc << 'EOF'

#!/bin/bash

# 1. Stop kernel messages

dmesg -n 1

# Restore terminal settings

stty sane

# 2. Clear the screen completely

clear

# 3. Run your dialog

dialog --msgbox "System Ready" 10 30

# 4. Optional: Restore kernel logging on exit

dmesg -n 7

# Auto-start installer on first login

if [ -f /usr/local/bin/system-installer.sh ]; then

#exec /usr/local/bin/system-installer.sh

/usr/local/bin/system-installer.sh

fi

EOF

sudo tee -a $ISO_WORKSPACE/root/.bash_profile << 'EOF'

# Carica il bashrc se esiste

if [ -f ~/.bashrc ]; then

. ~/.bashrc

fi

EOF

Version with initramfs made with Dracut

# 1. Create workspace

ISO_WORKSPACE="/tmp/lfs_iso_ws"

sudo mkdir -p $ISO_WORKSPACE

# 2. Copy EVERYTHING from your LFS root (except /proc, /sys, /dev)

# Use -a to preserve permissions/symlinks which are critical for LFS

sudo rsync -a --progress --exclude='/sources' --exclude='/build' /mnt/lfs/ $ISO_WORKSPACE/

# 3. Ensure the kernel is in the right place inside the workspace

sudo cp /mnt/lfs/boot/vmlinuz-6.13.4-lfs-12.3 $ISO_WORKSPACE/boot/vmlinuz

sudo mkdir dir -p $ISO_WORKSPACE/live

LFS_KERNEL_VERSION="6.13.4" # Change to your exact version

LFS_ROOT="/mnt/lfs" # Your LFS mount point

sudo dracut --force \

--kver $LFS_KERNEL_VERSION \

--kmoddir $LFS_ROOT/lib/modules/$LFS_KERNEL_VERSION \

--add "dmsquash-live bash kernel-modules rootfs-block base" \

--omit "systemd" \

--filesystems "iso9660 squashfs overlay" \

--drivers "sr_mod sd_mod usb_storage uas cdrom" \

/tmp/initrd

sudo cp /tmp/initrd $ISO_WORKSPACE/live/initrd

sudo cp /mnt/lfs/boot/vmlinuz-6.13.4-lfs-12.3 $ISO_WORKSPACE/live/vmlinuz

# 4. Create the GRUB config INSIDE the workspace

sudo mkdir -p $ISO_WORKSPACE/boot/grub

sudo tee $ISO_WORKSPACE/boot/grub/grub.cfg << EOF

insmod part_gpt

insmod part_msdos

insmod iso9660

insmod all_video

set default=0

set timeout=5

# GRUB cerca la partizione per caricare Kernel e Initrd

search --no-floppy --set=root --label DEVOPS_ISO

menuentry "DevOpsTribe GNU/Linux Live" {

set gfxpayload=keep

linux /live/vmlinuz boot=live root=LABEL=DEVOPS_ISO rootwait quiet splash

initrd /live/initrd

}

EOF

sudo tee $ISO_WORKSPACE/etc/inittab << 'EOF'

# Default Runlevel

id:3:initdefault:

# System initialization

si::sysinit:/etc/rc.d/init.d/rc S

# What to do in single-user mode

~:S:wait:/sbin/sulogin

# What to do when CTRL-ALT-DEL is pressed

ca::ctrlaltdel:/sbin/shutdown -t1 -a -r now

# Runlevels

l0:0:wait:/etc/rc.d/init.d/rc 0

l1:1:wait:/etc/rc.d/init.d/rc 1

l2:2:wait:/etc/rc.d/init.d/rc 2

l3:3:wait:/etc/rc.d/init.d/rc 3

l4:4:wait:/etc/rc.d/init.d/rc 4

l5:5:wait:/etc/rc.d/init.d/rc 5

l6:6:wait:/etc/rc.d/init.d/rc 6

# Consoles

1:2345:respawn:/sbin/agetty --autologin root --noclear -n tty1 9600

2:2345:respawn:/sbin/agetty tty2 9600

3:2345:respawn:/sbin/agetty tty3 9600

# End of /etc/inittab

EOF

sudo tee $ISO_WORKSPACE/etc/fstab << 'EOF'

# Begin /etc/fstab for Live ISO

# file system mount-point type options dump fsck

proc /proc proc nosuid,noexec,nodev 0 0

sysfs /sys sysfs nosuid,noexec,nodev 0 0

devpts /dev/pts devpts gid=5,mode=620 0 0

tmpfs /run tmpfs defaults 0 0

devtmpfs /dev devtmpfs mode=0755,nosuid 0 0

tmpfs /dev/shm tmpfs nosuid,nodev 0 0

cgroup2 /sys/fs/cgroup cgroup2 nosuid,noexec,nodev 0 0

# CD-ROM is already mounted as root, no need to mount it again

# /dev/sr0 / iso9660 ro 0 0

# End /etc/fstab

EOF

sudo rm $ISO_WORKSPACE/etc/rc.d/rcS.d/S45cleanfs

sudo rm $ISO_WORKSPACE/etc/rc.d/rcS.d/S40mountfs

sudo rm $ISO_WORKSPACE/etc/rc.d/rc3.d/S92kubelet

sudo rm $ISO_WORKSPACE/etc/rc.d/rc3.d/S91crio

sudo rm $ISO_WORKSPACE/etc/rc.d/rc3.d/S30sshd

echo "devopstribe-linux" | sudo tee $ISO_WORKSPACE/etc/hostname

# Also update /etc/hosts

sudo tee $ISO_WORKSPACE/etc/hosts << 'EOF'

# Begin /etc/hosts

127.0.0.1 localhost.localdomain localhost

127.0.1.1 lfs-live.localdomain lfs-live

::1 localhost ip6-localhost ip6-loopback

ff02::1 ip6-allnodes

ff02::2 ip6-allrouters

# End /etc/hosts

EOF

# Make sure hostname is set at boot

# Check if you have a hostname init script

ls -l $ISO_WORKSPACE/etc/rc.d/init.d/hostname

# If it doesn't exist, create one

sudo tee $ISO_WORKSPACE/etc/rc.d/init.d/hostname << 'EOF'

#!/bin/sh

########################################################################

# Begin hostname

#

# Description : Set hostname

#

########################################################################

. /lib/lsb/init-functions

case "${1}" in

start)

log_info_msg "Setting hostname..."

hostname -F /etc/hostname

evaluate_retval

;;

*)

echo "Usage: ${0} {start}"

exit 1

;;

esac

# End hostname

EOF

sudo cp /mnt/lfs/sources/system-installer.sh $ISO_WORKSPACE/usr/local/bin/system-installer.sh

sudo chmod +x $ISO_WORKSPACE/usr/local/bin/system-installer.sh

> $ISO_WORKSPACE/root/.bashrc

> $ISO_WORKSPACE/root/.bash_profile

sudo tee -a $ISO_WORKSPACE/root/.bashrc << 'EOF'

#!/bin/bash

# 1. Stop kernel messages

dmesg -n 1

# Restore terminal settings

stty sane

# 2. Clear the screen completely

clear

# 3. Run your dialog

dialog --msgbox "System Ready" 10 30

# 4. Optional: Restore kernel logging on exit

dmesg -n 7

# Auto-start installer on first login

if [ -f /usr/local/bin/system-installer.sh ]; then

exec /usr/local/bin/system-installer.sh

fi

EOF

sudo tee -a $ISO_WORKSPACE/root/.bash_profile << 'EOF'

# Carica il bashrc se esiste

if [ -f ~/.bashrc ]; then

. ~/.bashrc

fi

EOF

cat $ISO_WORKSPACE/root/.bash_profile

sudo chmod +x $ISO_WORKSPACE/etc/rc.d/init.d/hostname

sudo ln -sf ../init.d/hostname $ISO_WORKSPACE/etc/rc.d/rcS.d/S02hostname

sudo mksquashfs /mnt/lfs/ $ISO_WORKSPACE/live/filesystem.squashfs \

-e boot \

-e sources \

-e dev/* \

-e proc/* \

-e sys/* \

-e run/* \

-e tmp/* \

-comp xz

sudo grub-mkrescue --iso-level 3 \

-o /var/lib/libvirt/images/lfs-system.iso $ISO_WORKSPACE -- -volid "DEVOPS_ISO" \

-publisher "DevOpsTribe" \

-hfsplus off

sudo chown libvirt-qemu:kvm /var/lib/libvirt/images/lfs-system.iso

After preparing the iso you can burn to USB with different methods, my preferred are dd

root@datastore01:/home/eugenio/Downloads# sudo dd if=/home/eugenio/Downloads/lfs-system.iso of=/dev/sdc bs=4M status=progress conv=fsync

1035993088 bytes (1.0 GB, 988 MiB) copied, 79 s, 13.0 MB/sor Raspberry PI Imager

Of course, LFS is for manually setting up Linux and learning in depth how things work, but my focus is on the DevOps side, using tools like Jenkins and Ansible.

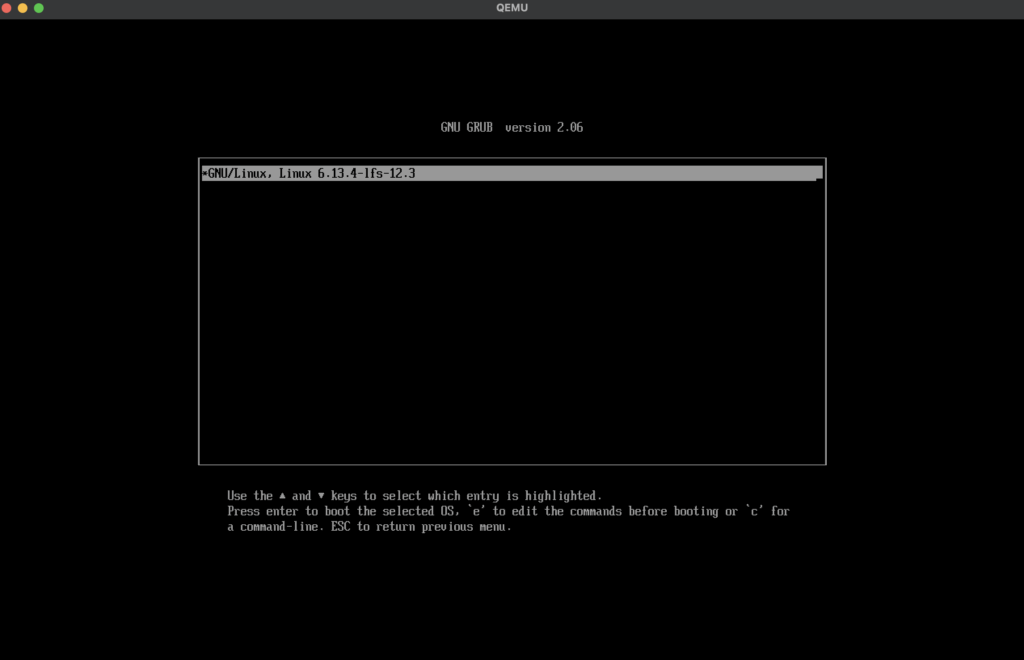

This is an example of a distribution for the x86_64 architecture that I started through virt-install by running the job “0004 – Prepare System Image (System Configuration).”

This post shows the journal of another experiment, where I created an aarch64 system. For this, I started directly on my MacBook Pro M3 using QEMU. The *.img file was passed through the synced folder of the LFS aarch64 build node, which was provisioned with Vagrant.

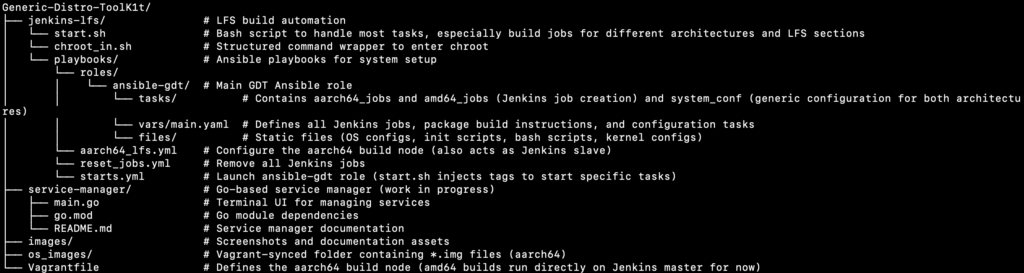

Project Structure

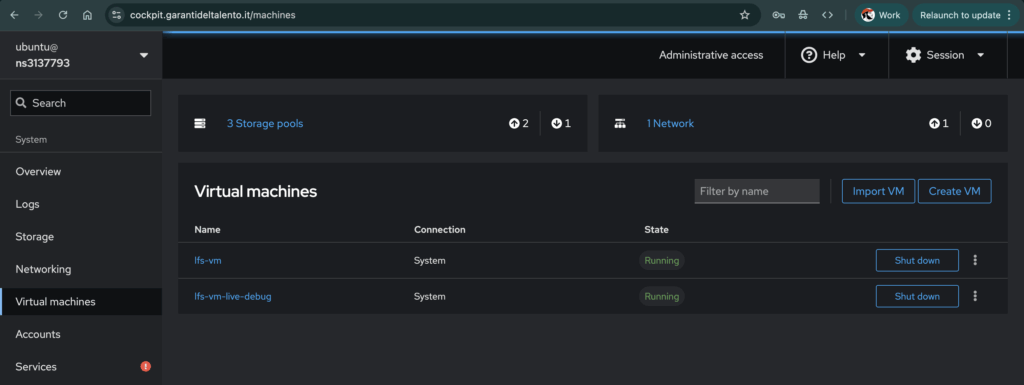

This is the start of VMs on AARCH64, the first one is an Alpine that I use for debugging, the second one is my (A)LFS

Prequisites

Before starting the operating system build, ensure you have a Jenkins server to coordinate the agent.

For building AMD64 or AARCH64, enable KVM and install libvirt, QEMU, and Cockpit.

For AMD64, I used a physical server with both the Jenkins Master and Agent running on the same node.

For AARCH64 (related to this article), I used my laptop with a VM acting as the Jenkins Agent, connected to a Jenkins Master (you can provision the master wherever you prefer)

Build AARCH64 – GNU/Linux Operating System

Clone https://github.com/lucky-sideburn/generic-distro-toolkit repo

Run start.sh and select “16) Provision an AARCH64 build node using Vagrant”

Run start.sh and create Jenkins folders:

0) Create Jenkins Folders

8) Build AARCH64 all Jenkins Jobs

9) Build AARCH64 cross_toolchain Jenkins Jobs

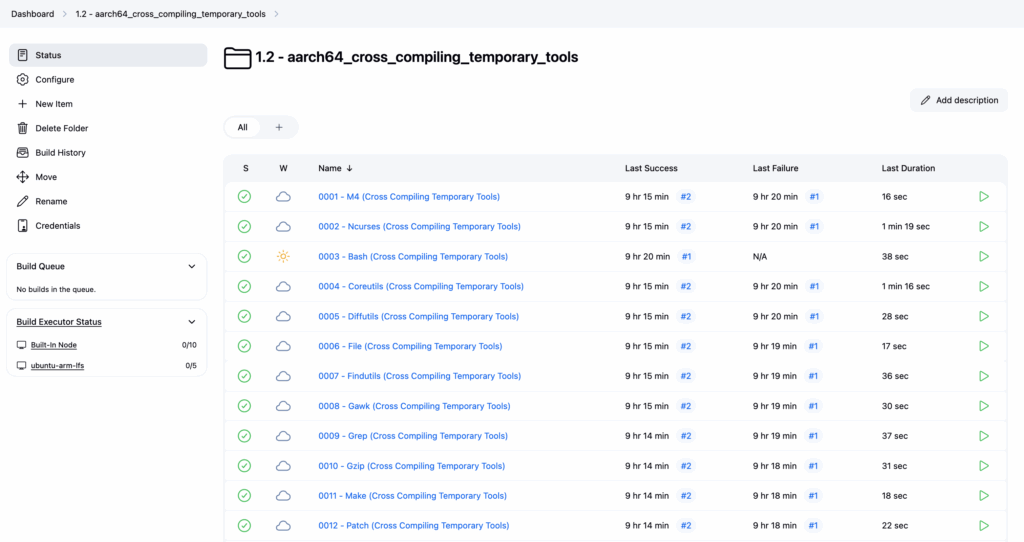

10) Build AARCH64 cross_compiling_temporary_tools Jenkins Jobs

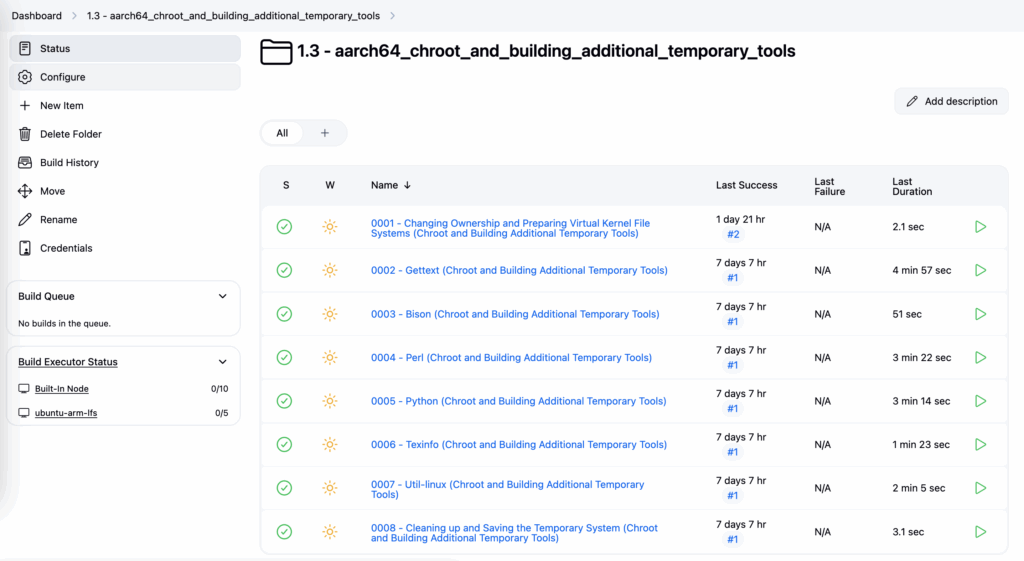

11) Build AARCH64 chroot_and_building_additional_temporary_tools Jenkins Jobs

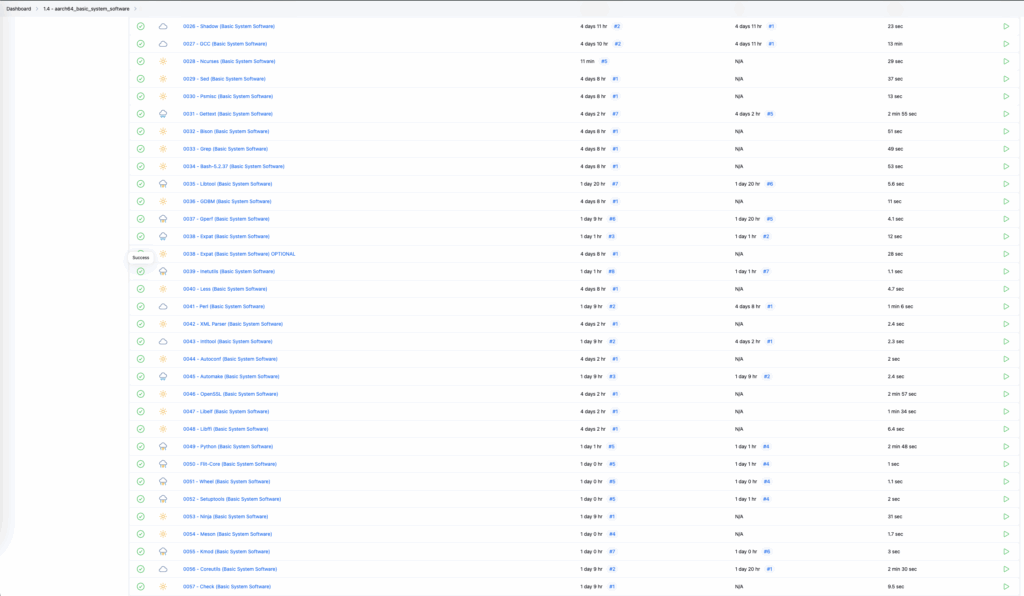

12) Build AARCH64 basic_system_software Jenkins Jobs

13) Build AARCH64 system_configuration Jenkins Jobs

14) Build AARCH64 containers Jenkins Jobs

Run Jenkins jobs in the order of the numbered folders and jobs.

Run start.sh and select 15) Start AARCH64 VM on QEMU to work on your GNU/Linux system.

Build AMD64 – GNU/Linux Operating System

Clone https://github.com/lucky-sideburn/generic-distro-toolkit repo

Run start.sh and select “17) Provision an AMD64 build node directly with Ansible”

Run start.sh and create Jenkins folders

0) Create Jenkins Folders

1) Build AMD64 all Jenkins Jobs

2) Build AMD64 cross_toolchain Jenkins Jobs

3) Build AMD64 cross_compiling_temporary_tools Jenkins Jobs

4) Build AMD64 chroot_and_building_additional_temporary_tools Jenkins Jobs

5) Build AMD64 basic_system_software Jenkins Jobs

6) Build AMD64 system_configuration Jenkins Jobs

7) Build AMD64 containers Jenkins Jobs

Run Jenkins jobs in the order of the numbered folders and jobs.

The job 0004 – Prepare System Image (System Configuration) will start the VMs, which can be monitored using Cockpit.

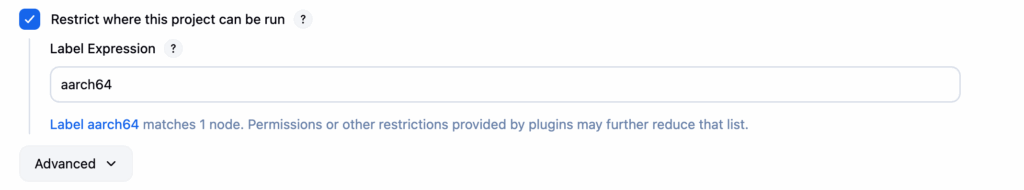

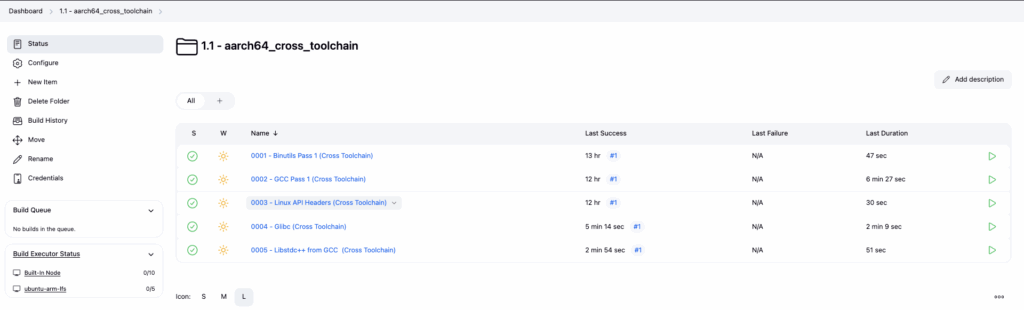

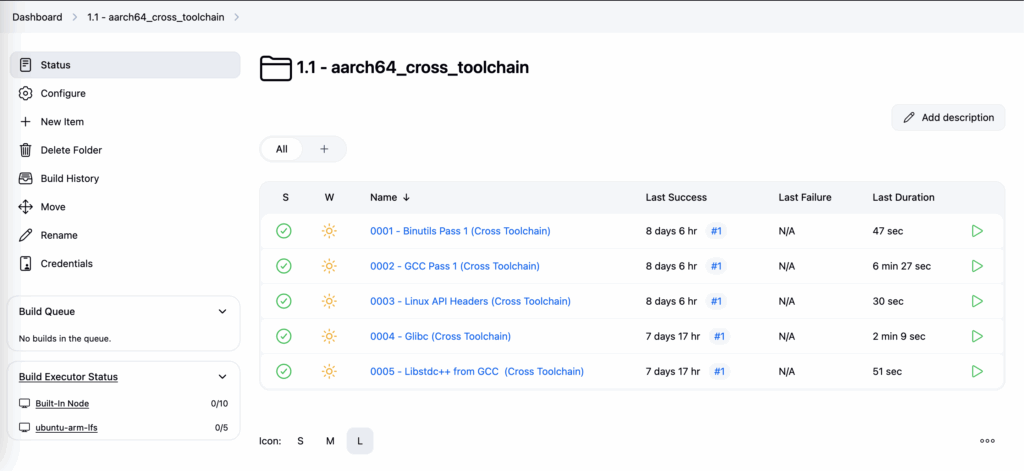

Wishing to build an ARM system, specifically AARCH64, I labeled a Jenkins slave as aarch64

In the definition of the jobs I will create automatically, I will therefore have an assignedNode set with the name of the chosen executor.

- name: "Create Jenkins Jobs - Cross Compiling Temporary Tools (aarch64)"

ansible.builtin.uri:

url: "{{ jenkins_url }}/job/aarch64_cross_compiling_temporary_tools/createItem?name={{ item.name | urlencode }}"

method: POST

user: "{{ jenkins_user }}"

password: "{{ jenkins_token }}"

force_basic_auth: yes

status_code: 200

headers:

Content-Type: "application/xml"

body: |

<project>

<actions/>

<description>Jenkins job to execute a shell command</description>

<keepDependencies>false</keepDependencies>

<properties/>

<scm class="hudson.scm.NullSCM"/>

<canRoam>false</canRoam>

<assignedNode>aarch64</assignedNode>

<disabled>false</disabled>

<blockBuildWhenDownstreamBuilding>false</blockBuildWhenDownstreamBuilding>

<blockBuildWhenUpstreamBuilding>false</blockBuildWhenUpstreamBuilding>

<triggers/>

<concurrentBuild>false</concurrentBuild>

<builders>

<hudson.tasks.Shell>

<command>{{ aarch64_common_build_start_command }}

if [ -d "{{ item.source_dir | basename }}" ]; then

rm -rf "{{ item.source_dir | basename }}"

fi

tar -xf "{{ item.archive_file | basename }}"

cd "{{ item.source_dir | basename }}"

pwd

{{ item.build_command }}

</command>

</hudson.tasks.Shell>

</builders>

<publishers/>

<buildWrappers/>

</project>

body_format: raw

timeout: 60

loop: "{{ jenkins_jobs.cross_compiling_temporary_tools }}"

ignore_errors: yes

tags:

- aarch64_jobs

- aarch64_cross_compiling_temporary_toolsJobs are configured for AMD64 and AARCH64 system and are defined in terms for build command in a Ansible Vars file. For example:

- name: 0009 - Grep (Cross Compiling Temporary Tools)

version: 3.11

archive_file: /mnt/lfs/sources/grep-3.11.tar.xz

source_dir: /mnt/lfs/sources/grep-3.11

description: |

Grep is a command-line utility for searching plain-text data for lines that match a regular expression. This job builds Grep, which is essential for text searching in the LFS environment.

category:

This job is part of the cross compiling temporary tools setup, specifically for building Grep.

jenkins_job_url: http://localhost:8080/job/cross_compiling_temporary_tools/job/Grep-3.11%20(Cross%20Compiling%20Temporary%20Tools)/

build_command: |

./configure --prefix=/usr \

--host=$LFS_TGT \

--build=$(./build-aux/config.guess)

make

make DESTDIR=$LFS installPrepare to the chroot…

I would say that the most fundamental tool, and the one I use the most during these activities, is the following.

sudo chroot "$LFS" /usr/bin/env -i \

HOME=/root \

TERM="$TERM" \

PS1='(lfs chroot) \u:\w\$ ' \

PATH=/usr/bin:/usr/sbin \

MAKEFLAGS="-j$(nproc)" \

TESTSUITEFLAGS="-j$(nproc)" \

/bin/bash

I place it with Ansible under Jenkins’ home directory...- name: Copy chroot_lfs.sh to /home/jenkins

ansible.builtin.copy:

src: chroot_lfs.sh

dest: /home/jenkins/chroot_lfs.sh

owner: jenkins

group: jenkins

mode: '0755'

It will be very common to have to enter the chroot environment to see what is not working inside the distro we are building.

Execution version-check.sh

Here https://www.linuxfromscratch.org/lfs/view/stable/chapter02/hostreqs.html a bash script is provided to check the versions of the tools present on the initial system. Running it, I see that everything is fine except for an issue related to Bash itself.

root@ubuntu-arm-lfs:~# /tmp/version-check.sh

OK: Coreutils 8.32 >= 8.1

OK: Bash 5.1.16 >= 3.2

OK: Binutils 2.38 >= 2.13.1

OK: Bison 3.8.2 >= 2.7

OK: Diffutils 3.8 >= 2.8.1

OK: Findutils 4.8.0 >= 4.2.31

OK: Gawk 5.1.0 >= 4.0.1

OK: GCC 11.4.0 >= 5.2

OK: GCC (C++) 11.4.0 >= 5.2

OK: Grep 3.7 >= 2.5.1a

OK: Gzip 1.10 >= 1.3.12

OK: M4 1.4.18 >= 1.4.10

OK: Make 4.3 >= 4.0

OK: Patch 2.7.6 >= 2.5.4

OK: Perl 5.34.0 >= 5.8.8

OK: Python 3.10.12 >= 3.4

OK: Sed 4.8 >= 4.1.5

OK: Tar 1.34 >= 1.22

OK: Texinfo 6.8 >= 5.0

OK: Xz 5.2.5 >= 5.0.0

OK: Linux Kernel 6.8.0 >= 5.4

OK: Linux Kernel supports UNIX 98 PTY

Aliases:

OK: awk is GNU

OK: yacc is Bison

ERROR: sh is NOT Bash

Compiler check:

OK: g++ works

OK: nproc reports 4 logical cores are available

To fix the error ERROR: sh is NOT Bash, I just need to force sh to point to bash. Do this only in your LFS machines.

ls -l /usr/bin/sh

ln /usr/bin/bash /usr/bin/sh

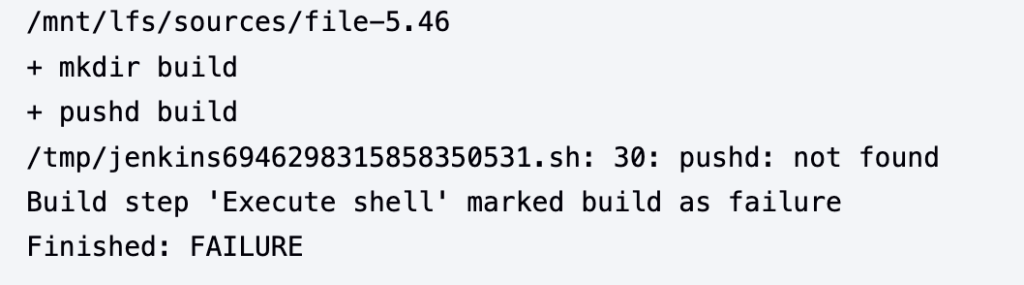

This should solve problems like the absence of pushd as a built-in in my bash interpreter.

The Server Environment

On the server side, I installed Ansible, Jenkins, Cockpit, and Libvirt.

In Jenkins, I created all the jobs needed to build the projects that are part of the GNU/Linux ecosystem using Ansible. They are defined in the vars of a role that you can find here: https://github.com/lucky-sideburn/Generic-Distro-ToolK1t/blob/main/jenkins-lfs/playbooks/roles/ansible-gdt/vars/main.yml

I am very satisfied with a simple bash script that wraps the playbooks to be called with the relevant tags. I use it for any modifications in the Jenkins folder and jobs or test OS image via QEMU.

ubuntu@ns3137793:~/gdt$ bash start.sh

=========================================

Welcome to the Generic Distro Toolkit!

=========================================

Select an option:

0) Create Jenkins Folders

1) Build AMD64 all Jenkins Jobs

2) Build AMD64 cross_toolchain Jenkins Jobs

3) Build AMD64 cross_compiling_temporary_tools Jenkins Jobs

4) Build AMD64 chroot_and_building_additional_temporary_tools Jenkins Jobs

5) Build AMD64 basic_system_software Jenkins Jobs

6) Build AMD64 system_configuration Jenkins Jobs

7) Build AMD64 containers Jenkins Jobs

8) Build AARCH64 all Jenkins Jobs

9) Build AARCH64 cross_toolchain Jenkins Jobs

10) Build AARCH64 cross_compiling_temporary_tools Jenkins Jobs

11) Build AARCH64 chroot_and_building_additional_temporary_tools Jenkins Jobs

12) Build AARCH64 basic_system_software Jenkins Jobs

13) Build AARCH64 system_configuration Jenkins Jobs

14) Build AARCH64 containers Jenkins Jobs

15) Start AARCH64 VM on QEMU

16) Exit

Enter your choice:

Enter your choice: 9

Building AARCH64 cross_toolchain Jenkins Jobs...

On Cockpit, I test the newly created VMs from the images built through Jenkins.

On ARM (my MacBook M3), I don’t have Cockpit and KVM, so I will use QEMU.

The AARCH64 (ARM) build node

I’m using my work Apple MacBook Pro M3, on which I provisioned a VM via Vagrant. As you can see, the node is also a slave of my Jenkins, which I manually labeled as aarch64.

# Vagrantfile for Ubuntu ARM

Vagrant.configure("2") do |config|

config.vm.box = "arm64-boxes/ubuntu-22.04"

config.vm.box_version = "0.2"

config.vm.hostname = "ubuntu-arm-lfs"

config.vm.define "ubuntu-arm-lfs"

config.vm.provider "virtualbox" do |vb|

vb.memory = "12288"

vb.cpus = 4

end

config.vm.provision "ansible" do |ansible|

ansible.playbook = "./jenkins-lfs/playbooks/aarch64_lfs.yml"

ansible.become = true

ansible.extra_vars = {

"jenkins_agent_jar" => "/opt/jenkins/agent/agent.jar",

"jenkins_master_url" => "https://jenkins.garantideltalento.it",

"jenkins_user" => "jenkins",

"jenkins_group" => "jenkins",

"jenkins_agent_workdir" => "/opt/jenkins/workdir",

"jenkins_agent_home" => "/opt/jenkins/home",

"jenkins_agent_name" => "ubuntu-arm-lfs",

"jenkins_agent_secret" => ENV['JENKINS_AGENT_SECRET'],

"lfs_repo_url" => "http://repo.garantideltalento.it",

}

end

config.vm.network "private_network", type: "dhcp"

endI created a dedicated Ansible playbook to provision the node. It does very simple tasks and you can find it here: https://github.com/lucky-sideburn/Generic-Distro-ToolK1t/blob/main/jenkins-lfs/playbooks/roles/ansible-gdt/tasks/aarch64_lfs.yml

Basically, the tasks are very simple:

[[email protected]]:~/WORK/Generic-Distro-ToolK1t $ vagrant provision

==> ubuntu-arm-lfs: Running provisioner: ansible...

ubuntu-arm-lfs: Running ansible-playbook...

PLAY [Print node name] *********************************************************

TASK [Gathering Facts] *********************************************************

ok: [ubuntu-arm-lfs]

TASK [Display the node name] ***************************************************

ok: [ubuntu-arm-lfs]

TASK [Start arm_node.yml task of ansible-gdt role] *****************************

TASK [ansible-gdt : Show machine architecture] *********************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Ensure user 'jenkins' exists] ******************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create Jenkins Workdir] ************************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create Jenkins Agent Home] *********************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create Jenkins Agent Workdir] ******************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Update apt cache] ******************************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Install Java] **********************************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Copy agent.jar to Jenkins home] ****************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create SystemD unit for start Jenkins agent] ***************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Start and enable Jenkins agent service] ********************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create /mnt/lfs directory] *********************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Set LFS environment variable] ******************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Set LFS environment variable for jenkins] ******************

changed: [ubuntu-arm-lfs]

TASK [ansible-gdt : Set LFS environment variable for root] *********************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create /mnt/lfs/sources directory] *************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create directories under $LFS] *****************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create symbolic links for bin, lib, and sbin] **************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create lib directory for ARM architecture] *****************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create $LFS/tools directory] *******************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create 'lfs' group] ****************************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Create 'lfs' user] *****************************************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Change ownership of lib for aarch64 architecture] **********

changed: [ubuntu-arm-lfs]

TASK [ansible-gdt : Configure environment variables for LFS] *******************

ok: [ubuntu-arm-lfs]

TASK [ansible-gdt : Configure environment variables for Jenkins] ***************

changed: [ubuntu-arm-lfs]

TASK [ansible-gdt : Install additional packages] *******************************

After I prepared the build node and joined it to my Jenkins server as an executor, it is time to create all Jenkins jobs via Ansible, and then run them in the specific order, following the numbered names.

Cross Tool Chain

aarch64_cross_toolchain - amd64_cross_toolchain

└─0001 - Binutils Pass 1 (Cross Toolchain)

└─0002 - GCC Pass 1 (Cross Toolchain)

└─0003 - Linux API Headers (Cross Toolchain)

└─0004 - Glibc (Cross Toolchain)

└─0005 - Libstdc++ from GCC (Cross Toolchain)Cross Compiling Temporary Tools

aarch64_cross_compiling_temporary_tools - amd64_cross_compiling_temporary_tools

└─0001 - M4 (Cross Compiling Temporary Tools)

└─0002 - Ncurses (Cross Compiling Temporary Tools)

└─0003 - Bash (Cross Compiling Temporary Tools)

└─0004 - Coreutils (Cross Compiling Temporary Tools)

└─0005 - Diffutils (Cross Compiling Temporary Tools)

└─0006 - File (Cross Compiling Temporary Tools)

└─0007 - Findutils (Cross Compiling Temporary Tools)

└─0008 - Gawk (Cross Compiling Temporary Tools)

└─0009 - Grep (Cross Compiling Temporary Tools)

└─0010 - Gzip (Cross Compiling Temporary Tools)

└─0011 - Make (Cross Compiling Temporary Tools)

└─0012 - Patch (Cross Compiling Temporary Tools)

└─0013 - Sed (Cross Compiling Temporary Tools)

└─0014 - Tar (Cross Compiling Temporary Tools)

└─0015 - Xz (Cross Compiling Temporary Tools)

└─0016 - Binutils (Cross Compiling Temporary Tools)

└─0017 - GCC Pass 2 (Cross Compiling Temporary Tools)

Entering Chroot and Building Additional Temporary Tools

aarch64_chroot_and_building_additional_temporary_tools - amd64_chroot_and_building_additional_temporary_tools

└─0001 - Changing Ownership and Preparing Virtual Kernel File Systems (Chroot and Building Additional Temporary Tools)

└─0002 - Gettext (Chroot and Building Additional Temporary Tools)

└─0003 - Bison (Chroot and Building Additional Temporary Tools)

└─0004 - Perl (Chroot and Building Additional Temporary Tools)

└─0005 - Python (Chroot and Building Additional Temporary Tools)

└─0006 - Texinfo (Chroot and Building Additional Temporary Tools)

└─0007 - Util-linux (Chroot and Building Additional Temporary Tools)

└─0008 - Cleaning up and Saving the Temporary System (Chroot and Building Additional Temporary Tools)Installing Basic System Software

aarch64_basic_system_software - amd64_basic_system_software

└─0001 - Man-pages (Basic System Software)

└─0002 - Iana-Etc (Basic System Software)

└─0003 - Glibc (Basic System Software)

└─0004 - Zlib (Basic System Software)

└─0005 - Bzip2 (Basic System Software)

└─0006 - Xz (Basic System Software)

└─0007 - Lz4 (Basic System Software)

└─0008 - Zstd (Basic System Software)

└─0009 - File (Basic System Software)

└─0010 - Readline (Basic System Software)

└─0011 - M4 (Basic System Software)

└─0012 - Bc (Basic System Software)

└─0013 - Flex (Basic System Software)

└─0014 - Tcl (Basic System Software)

└─0015 - Expect (Basic System Software)

└─0016 - DejaGNU (Basic System Software)

└─0017 - Pkgconf (Basic System Software)

└─0017A - pkg-config (Basic System Software)

└─0018 - Binutils (Basic System Software)

└─0019 - GMP (Basic System Software)

└─0020 - MPFR (Basic System Software)

└─0021 - MPC (Basic System Software)

└─0022 - Attr (Basic System Software)

└─0023 - Acl (Basic System Software)

└─0024 - Libcap (Basic System Software)

└─0025 - Libxcrypt-4.4.38 (Basic System Software)

└─0026 - Shadow (Basic System Software)

└─0027 - GCC (Basic System Software)

└─0028 - Ncurses (Basic System Software)

└─0029 - Sed (Basic System Software)

└─0030 - Psmisc (Basic System Software)

└─0031 - Gettext (Basic System Software)

└─0032 - Bison (Basic System Software)

└─0033 - Grep (Basic System Software)

└─0034 - Bash-5.2.37 (Basic System Software)

└─0035 - Libtool (Basic System Software)

└─0036 - GDBM (Basic System Software)

└─0037 - Gperf (Basic System Software)

└─0038 - Expat (Basic System Software)

└─0039 - Inetutils (Basic System Software)

└─0040 - Less (Basic System Software)

└─0041 - Perl (Basic System Software)

└─0042 - XML Parser (Basic System Software)

└─0043 - Intltool (Basic System Software)

└─0044 - Autoconf (Basic System Software)

└─0045 - Automake (Basic System Software)

└─0046 - OpenSSL (Basic System Software)

└─0047 - Libelf (Basic System Software)

└─0048 - Libffi (Basic System Software)

└─0049 - Python (Basic System Software)

└─0050 - Flit-Core (Basic System Software)

└─0051 - Wheel (Basic System Software)

└─0052 - Setuptools (Basic System Software)

└─0053 - Ninja (Basic System Software)

└─0054 - Meson (Basic System Software)

└─0055 - Kmod (Basic System Software)

└─0056 - Coreutils (Basic System Software)

└─0057 - Check (Basic System Software)

└─0058 - Diffutils (Basic System Software)

└─0059 - Gawk (Basic System Software)

└─0060 - Findutils (Basic System Software)

└─0061 - Groff (Basic System Software)

└─0062 - GRUB (Basic System Software)

└─0063 - Gzip (Basic System Software)

└─0064 - IPRoute2 (Basic System Software)

└─0065 - Kbd (Basic System Software)

└─0066 - Libpipeline (Basic System Software)

└─0067 - Make (Basic System Software)

└─0068 - Patch (Basic System Software)

└─0069 - Tar (Basic System Software)

└─0070 - Texinfo (Basic System Software)

└─0071 - Vim (Basic System Software)

└─0072 - MarkupSafe (Basic System Software)

└─0073 - Jinja2 (Basic System Software)

└─0074 - Udev from Systemd (Basic System Software)

└─0075 - Man-DB (Basic System Software)

└─0076 - Procps-ng (Basic System Software)

└─0077 - Util-linux (Basic System Software)

└─0078 - E2fsprogs (Basic System Software)

└─0079 - Sysklogd (Basic System Software)

└─0080 - SysVinit (Basic System Software)

└─0081 - openssh (Basic System Software)

└─0082 - Stripping (Basic System Software)

└─0083 - Cleaning Up (Basic System Software)System Configuration

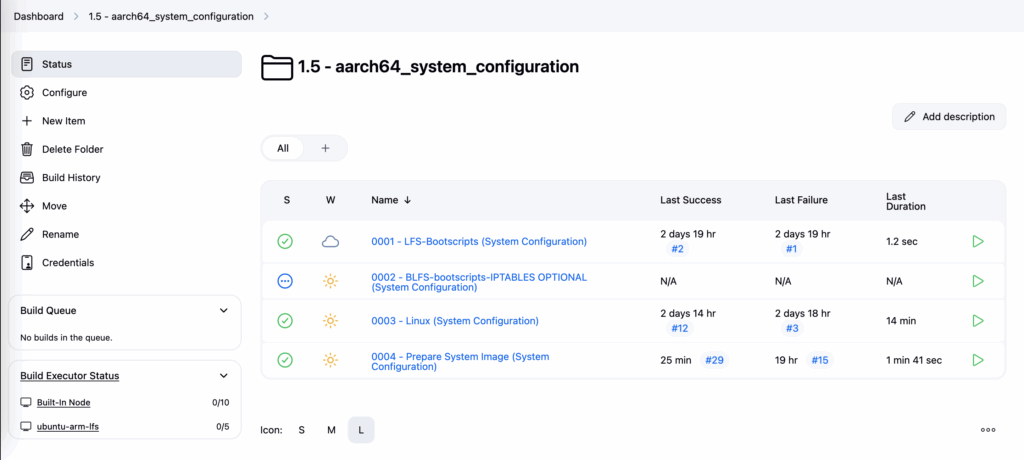

This set of Jenkins jobs automates the complete system configuration and image preparation process. It includes setting up LFS and optional BLFS boot scripts, configuring the core Linux system components, and creating a ready-to-use system image. Together, these jobs ensure a fully configured, functional, and deployable operating system.

Run OS via qemu-system-aarch64

For troubleshooting my operating system (in case of a broken boot, filesystem, or configuration problem), I used the following strategy:

During the image preparation, I create lfs.img as well as lfs-clone.img, which is a clone, as suggested by the name. I run an Alpine Linux live instance to mount the image of the OS that I built.

qemu-system-aarch64 \

-M virt \

-cpu host \

-accel hvf \

-smp 2 \

-m 2048 \

-drive file=$OS_IMAGE_BASE_DIR/alpine.iso,if=virtio,media=cdrom \

-drive file=$OS_IMAGE_BASE_DIR/lfs-clone.qcow2,if=virtio,format=qcow2 \

-netdev user,id=net0,hostfwd=tcp::2222-:22 \

-device virtio-net-device,netdev=net0 \

-device virtio-gpu-pci \

-device usb-ehci \

-device usb-kbd \

-display cocoa \

-bios /opt/homebrew/Cellar/qemu/10.0.3/share/qemu/edk2-aarch64-code.fd \

-serial mon:stdio \

-boot dThis permits me to mount the disk and check if everything is fine

Welcome to Alpine Linux 3.22

Kernel 6.12.38-0-lts on aarch64 (/dev/ttyAMA0)

localhost login: root

Welcome to Alpine!

The Alpine Wiki contains a large amount of how-to guides and general

information about administrating Alpine systems.

See <https://wiki.alpinelinux.org/>.

You can setup the system with the command: setup-alpine

You may change this message by editing /etc/motd.

localhost:~# mount /dev/vdb

vdb vdb1 vdb2

localhost:~# mount /dev/vdb2 /mnt/

localhost:~# ls /mnt/

bin home mnt right srv var

boot lib opt root sys

dev lost+found posix run tmp

etc media proc sbin usr

localhost:~#

After checking everything, I can start my image

# echo "Starting the AARCH64 VM with the LFS image..."

qemu-system-aarch64 \

-M virt \

-cpu host \

-accel hvf \

-smp 2 \

-m 2048 \

-drive file=$OS_IMAGE_BASE_DIR/lfs.qcow2,if=virtio,format=qcow2 \

-netdev user,id=net0,hostfwd=tcp::2222-:22 \

-device virtio-net-device,netdev=net0 \

-device virtio-gpu-pci \

-device usb-ehci \

-device usb-kbd \

-display cocoa \

-bios /opt/homebrew/Cellar/qemu/10.0.3/share/qemu/edk2-aarch64-code.fd \

-serial mon:stdio \

-boot c

EFI stub: Booting Linux Kernel...

EFI stub: EFI_RNG_PROTOCOL unavailable

EFI stub: Generating empty DTB

EFI stub: Exiting boot services...

[ 0.000000] Booting Linux on physical CPU 0x0000000000 [0x610f0000]

[ 0.000000] Linux version 6.13.4 (root@ubuntu-arm-lfs) (gcc (GCC) 14.2.0, GNU ld (GNU Binutils) 2.44) #1 SMP PREEMPT Fri Aug 15 21:55:14 UTC 2025

[ 0.000000] KASLR disabled due to lack of seed

[ 0.000000] efi: EFI v2.7 by EDK II

[ 0.000000] efi: SMBIOS 3.0=0xbfed0000 MEMATTR=0xbef84018 ACPI 2.0=0xbcb43018 MEMRESERVE=0xbc696e98

[ 0.000000] ACPI: Early table checksum verification disabled

[ 0.000000] ACPI: RSDP 0x00000000BCB43018 000024 (v02 BOCHS )

[ 0.000000] ACPI: XSDT 0x00000000BCB43F18 00006C (v01 BOCHS BXPC 00000001 01000013)

[ 0.000000] ACPI: FACP 0x00000000BCB43B18 000114 (v06 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: DSDT 0x00000000BCB41018 001468 (v02 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: APIC 0x00000000BCB43C98 0000FC (v04 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: PPTT 0x00000000BCB43E18 000060 (v02 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: GTDT 0x00000000BCB43098 000068 (v03 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: MCFG 0x00000000BCB43A98 00003C (v01 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: SPCR 0x00000000BCB43818 000050 (v02 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: DBG2 0x00000000BCB43A18 000057 (v00 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: IORT 0x00000000BCB43898 000080 (v03 BOCHS BXPC 00000001 BXPC 00000001)

[ 0.000000] ACPI: BGRT 0x00000000BCB43998 000038 (v01 INTEL EDK2 00000002 01000013)

[ 0.000000] ACPI: SPCR: console: pl011,mmio32,0x9000000,9600

[ 0.000000] ACPI: Use ACPI SPCR as default console: Yes

[ 0.000000] NUMA: Faking a node at [mem 0x0000000040000000-0x00000000bfffffff]

[ 0.000000] NODE_DATA(0) allocated [mem 0xbfa589c0-0xbfa5afff]

[ 0.000000] Zone ranges:

[ 0.000000] DMA [mem 0x0000000040000000-0x00000000bfffffff]

[ 0.000000] DMA32 empty

[ 0.000000] Normal empty

[ 0.000000] Movable zone start for each node

[ 0.000000] Early memory node ranges

[ 0.000000] node 0: [mem 0x0000000040000000-0x00000000bc55ffff]

[ 0.000000] node 0: [mem 0x00000000bc560000-0x00000000bc56ffff]

[ 0.000000] node 0: [mem 0x00000000bc570000-0x00000000bc67ffff]

[ 0.000000] node 0: [mem 0x00000000bc680000-0x00000000bc68ffff]

[ 0.000000] node 0: [mem 0x00000000bc690000-0x00000000bc76ffff]

[ 0.000000] node 0: [mem 0x00000000bc770000-0x00000000bcb3ffff]

[ 0.000000] node 0: [mem 0x00000000bcb40000-0x00000000bfe1ffff]

[ 0.000000] node 0: [mem 0x00000000bfe20000-0x00000000bfeaffff]

[ 0.000000] node 0: [mem 0x00000000bfeb0000-0x00000000bfebffff]

[ 0.000000] node 0: [mem 0x00000000bfec0000-0x00000000bffdffff]

[ 0.000000] node 0: [mem 0x00000000bffe0000-0x00000000bfffffff]

[ 0.000000] Initmem setup node 0 [mem 0x0000000040000000-0x00000000bfffffff]

[ 0.000000] cma: Reserved 32 MiB at 0x00000000ba400000 on node -1

[ 0.000000] psci: probing for conduit method from ACPI.

[ 0.000000] psci: PSCIv1.1 detected in firmware.

[ 0.000000] psci: Using standard PSCI v0.2 function IDs

[ 0.000000] psci: Trusted OS migration not required

[ 0.000000] psci: SMC Calling Convention v1.0

[ 0.000000] percpu: Embedded 23 pages/cpu s54552 r8192 d31464 u94208

[ 0.000000] pcpu-alloc: s54552 r8192 d31464 u94208 alloc=23*4096

[ 0.000000] pcpu-alloc: [0] 0 [0] 1

[ 0.000000] Detected PIPT I-cache on CPU0

[ 0.000000] CPU features: detected: Spectre-v4

[ 0.000000] alternatives: applying boot alternatives

[ 0.000000] Kernel command line: BOOT_IMAGE=/vmlinuz-6.13.4-lfs-12.3 root=/dev/vda2 ro console=ttyAMA0 nomodeset debug earlyprintk=efi,keep

[ 0.000000] Booted with the nomodeset parameter. Only the system framebuffer will be available

[ 0.000000] Unknown kernel command line parameters "BOOT_IMAGE=/vmlinuz-6.13.4-lfs-12.3 earlyprintk=efi,keep", will be passed to user space.

[ 0.000000] printk: log buffer data + meta data: 131072 + 458752 = 589824 bytes

[ 0.000000] Dentry cache hash table entries: 262144 (order: 9, 2097152 bytes, linear)

[ 0.000000] Inode-cache hash table entries: 131072 (order: 8, 1048576 bytes, linear)

[ 0.000000] Fallback order for Node 0: 0

[ 0.000000] Built 1 zonelists, mobility grouping on. Total pages: 524288

[ 0.000000] Policy zone: DMA

[ 0.000000] mem auto-init: stack:all(zero), heap alloc:off, heap free:off

[ 0.000000] software IO TLB: SWIOTLB bounce buffer size adjusted to 2MB

[ 0.000000] software IO TLB: area num 2.

[ 0.000000] software IO TLB: mapped [mem 0x00000000bf514000-0x00000000bf714000] (2MB)

[ 0.000000] SLUB: HWalign=64, Order=0-3, MinObjects=0, CPUs=2, Nodes=1

[ 0.000000] rcu: Preemptible hierarchical RCU implementation.

[ 0.000000] rcu: RCU event tracing is enabled.

[ 0.000000] rcu: RCU restricting CPUs from NR_CPUS=512 to nr_cpu_ids=2.

[ 0.000000] Trampoline variant of Tasks RCU enabled.

[ 0.000000] Tracing variant of Tasks RCU enabled.

[ 0.000000] rcu: RCU calculated value of scheduler-enlistment delay is 25 jiffies.

[ 0.000000] rcu: Adjusting geometry for rcu_fanout_leaf=16, nr_cpu_ids=2

[ 0.000000] RCU Tasks: Setting shift to 1 and lim to 1 rcu_task_cb_adjust=1 rcu_task_cpu_ids=2.

[ 0.000000] RCU Tasks Trace: Setting shift to 1 and lim to 1 rcu_task_cb_adjust=1 rcu_task_cpu_ids=2.

[ 0.000000] NR_IRQS: 64, nr_irqs: 64, preallocated irqs: 0

[ 0.000000] Root IRQ handler: gic_handle_irq

[ 0.000000] GICv2m: ACPI overriding V2M MSI_TYPER (base:80, num:64)

[ 0.000000] GICv2m: range[mem 0x08020000-0x08020fff], SPI[80:143]

[ 0.000000] rcu: srcu_init: Setting srcu_struct sizes based on contention.

[ 0.000000] arch_timer: cp15 timer(s) running at 24.00MHz (virt).

[ 0.000000] clocksource: arch_sys_counter: mask: 0xffffffffffffff max_cycles: 0x588fe9dc0, max_idle_ns: 440795202592 ns

[ 0.000000] sched_clock: 56 bits at 24MHz, resolution 41ns, wraps every 4398046511097ns

[ 0.000029] Console: colour dummy device 80x25

[ 0.000038] ACPI: Core revision 20240827

[ 0.000057] Calibrating delay loop (skipped), value calculated using timer frequency.. 48.00 BogoMIPS (lpj=96000)

[ 0.000058] pid_max: default: 32768 minimum: 301

[ 0.000065] LSM: initializing lsm=capability

[ 0.000093] Mount-cache hash table entries: 4096 (order: 3, 32768 bytes, linear)

[ 0.000099] Mountpoint-cache hash table entries: 4096 (order: 3, 32768 bytes, linear)

[ 0.029540] rcu: Hierarchical SRCU implementation.

[ 0.029541] rcu: Max phase no-delay instances is 1000.

[ 0.029584] Timer migration: 1 hierarchy levels; 8 children per group; 1 crossnode level

[ 0.029620] Remapping and enabling EFI services.

[ 0.029700] smp: Bringing up secondary CPUs ...

[ 0.029913] Detected PIPT I-cache on CPU1

[ 0.029968] CPU1: Booted secondary processor 0x0000000001 [0x610f0000]

[ 0.030048] smp: Brought up 1 node, 2 CPUs

[ 0.030049] SMP: Total of 2 processors activated.

[ 0.030050] CPU: All CPU(s) started at EL1

[ 0.030050] CPU features: detected: ARMv8.4 Translation Table Level

[ 0.030051] CPU features: detected: Data cache clean to the PoU not required for I/D coherence

[ 0.030052] CPU features: detected: Common not Private translations

[ 0.030052] CPU features: detected: CRC32 instructions

[ 0.030052] CPU features: detected: Data independent timing control (DIT)

[ 0.030052] CPU features: detected: E0PD

[ 0.030053] CPU features: detected: Enhanced Privileged Access Never

[ 0.030053] CPU features: detected: RCpc load-acquire (LDAPR)

[ 0.030053] CPU features: detected: LSE atomic instructions

[ 0.030054] CPU features: detected: Privileged Access Never

[ 0.030054] CPU features: detected: RAS Extension Support

[ 0.030054] CPU features: detected: Speculation barrier (SB)

[ 0.030054] CPU features: detected: TLB range maintenance instructions

[ 0.030088] alternatives: applying system-wide alternatives

[ 0.030265] Memory: 1975484K/2097152K available (16832K kernel code, 4874K rwdata, 11828K rodata, 2816K init, 738K bss, 85280K reserved, 32768K cma-reserved)

[ 0.030435] devtmpfs: initialized

[ 0.030636] clocksource: jiffies: mask: 0xffffffff max_cycles: 0xffffffff, max_idle_ns: 7645041785100000 ns

[ 0.030637] futex hash table entries: 512 (order: 3, 32768 bytes, linear)

[ 0.030689] 23440 pages in range for non-PLT usage

[ 0.030690] 514960 pages in range for PLT usage

[ 0.030702] pinctrl core: initialized pinctrl subsystem

[ 0.030868] SMBIOS 3.0.0 present.

[ 0.030870] DMI: QEMU QEMU Virtual Machine, BIOS edk2-stable202408-prebuilt.qemu.org 08/13/2024

[ 0.030872] DMI: Memory slots populated: 1/1

[ 0.031591] NET: Registered PF_NETLINK/PF_ROUTE protocol family

[ 0.031717] DMA: preallocated 256 KiB GFP_KERNEL pool for atomic allocations

[ 0.031768] DMA: preallocated 256 KiB GFP_KERNEL|GFP_DMA pool for atomic allocations

[ 0.031841] DMA: preallocated 256 KiB GFP_KERNEL|GFP_DMA32 pool for atomic allocations

[ 0.031846] audit: initializing netlink subsys (disabled)

[ 0.031914] audit: type=2000 audit(0.000:1): state=initialized audit_enabled=0 res=1

[ 0.031980] thermal_sys: Registered thermal governor 'step_wise'

[ 0.031980] thermal_sys: Registered thermal governor 'power_allocator'

[ 0.031986] cpuidle: using governor menu

[ 0.032002] hw-breakpoint: found 6 breakpoint and 4 watchpoint registers.

[ 0.032042] ASID allocator initialised with 256 entries

[ 0.032185] acpiphp: ACPI Hot Plug PCI Controller Driver version: 0.5

[ 0.032226] Serial: AMBA PL011 UART driver

[ 0.032401] HugeTLB: registered 1.00 GiB page size, pre-allocated 0 pages

[ 0.032402] HugeTLB: 0 KiB vmemmap can be freed for a 1.00 GiB page

[ 0.032402] HugeTLB: registered 32.0 MiB page size, pre-allocated 0 pages

[ 0.032402] HugeTLB: 0 KiB vmemmap can be freed for a 32.0 MiB page

[ 0.032403] HugeTLB: registered 2.00 MiB page size, pre-allocated 0 pages

[ 0.032403] HugeTLB: 0 KiB vmemmap can be freed for a 2.00 MiB page

[ 0.032403] HugeTLB: registered 64.0 KiB page size, pre-allocated 0 pages

[ 0.032403] HugeTLB: 0 KiB vmemmap can be freed for a 64.0 KiB page

[ 0.032691] ACPI: Added _OSI(Module Device)

[ 0.032691] ACPI: Added _OSI(Processor Device)

[ 0.032692] ACPI: Added _OSI(3.0 _SCP Extensions)

[ 0.032692] ACPI: Added _OSI(Processor Aggregator Device)

[ 0.032883] ACPI: 1 ACPI AML tables successfully acquired and loaded

[ 0.032925] ACPI: Interpreter enabled

[ 0.032925] ACPI: Using GIC for interrupt routing

[ 0.032928] ACPI: MCFG table detected, 1 entries

[ 0.033347] ACPI: CPU0 has been hot-added

[ 0.033356] ACPI: CPU1 has been hot-added

[ 0.033401] ARMH0011:00: ttyAMA0 at MMIO 0x9000000 (irq = 12, base_baud = 0) is a SBSA

[ 0.033403] printk: legacy console [ttyAMA0] enabled

[ 0.058298] ACPI: PCI: Interrupt link L000 configured for IRQ 35

[ 0.058461] ACPI: PCI: Interrupt link L001 configured for IRQ 36

[ 0.058610] ACPI: PCI: Interrupt link L002 configured for IRQ 37

[ 0.058757] ACPI: PCI: Interrupt link L003 configured for IRQ 38

[ 0.058907] ACPI: PCI Root Bridge [PCI0] (domain 0000 [bus 00-ff])

[ 0.059063] acpi PNP0A08:00: _OSC: OS supports [ExtendedConfig ASPM ClockPM Segments MSI HPX-Type3]

[ 0.059298] acpi PNP0A08:00: _OSC: platform does not support [LTR]

[ 0.059467] acpi PNP0A08:00: _OSC: OS now controls [PME AER PCIeCapability]

[ 0.059688] acpi PNP0A08:00: ECAM area [mem 0x4010000000-0x401fffffff] reserved by PNP0C02:00

[ 0.059903] acpi PNP0A08:00: ECAM at [mem 0x4010000000-0x401fffffff] for [bus 00-ff]

[ 0.060094] ACPI: Remapped I/O 0x000000003eff0000 to [io 0x0000-0xffff window]

[ 0.060291] PCI host bridge to bus 0000:00

[ 0.060396] pci_bus 0000:00: root bus resource [mem 0x10000000-0x3efeffff window]

[ 0.060576] pci_bus 0000:00: root bus resource [io 0x0000-0xffff window]

[ 0.060746] pci_bus 0000:00: root bus resource [mem 0x8000000000-0xffffffffff window]

[ 0.060938] pci_bus 0000:00: root bus resource [bus 00-ff]

[ 0.061091] pci 0000:00:00.0: [1b36:0008] type 00 class 0x060000 conventional PCI endpoint

[ 0.061367] pci 0000:00:01.0: [1af4:1050] type 00 class 0x038000 conventional PCI endpoint

[ 0.062027] pci 0000:00:01.0: BAR 1 [mem 0x10002000-0x10002fff]

[ 0.062760] pci 0000:00:01.0: BAR 4 [mem 0x8000000000-0x8000003fff 64bit pref]

[ 0.063227] pci 0000:00:02.0: [8086:24cd] type 00 class 0x0c0320 conventional PCI endpoint

[ 0.063542] pci 0000:00:02.0: BAR 0 [mem 0x10001000-0x10001fff]

[ 0.064318] pci 0000:00:03.0: [1af4:1001] type 00 class 0x010000 conventional PCI endpoint

[ 0.064632] pci 0000:00:03.0: BAR 0 [io 0x0000-0x007f]

[ 0.064868] pci 0000:00:03.0: BAR 1 [mem 0x10000000-0x10000fff]

[ 0.065310] pci 0000:00:03.0: BAR 4 [mem 0x8000004000-0x8000007fff 64bit pref]

[ 0.065689] pci 0000:00:01.0: BAR 4 [mem 0x8000000000-0x8000003fff 64bit pref]: assigned

[ 0.066077] pci 0000:00:03.0: BAR 4 [mem 0x8000004000-0x8000007fff 64bit pref]: assigned

[ 0.066283] pci 0000:00:01.0: BAR 1 [mem 0x10000000-0x10000fff]: assigned

[ 0.066599] pci 0000:00:02.0: BAR 0 [mem 0x10001000-0x10001fff]: assigned

[ 0.066769] pci 0000:00:03.0: BAR 1 [mem 0x10002000-0x10002fff]: assigned

[ 0.066943] pci 0000:00:03.0: BAR 0 [io 0x1000-0x107f]: assigned

[ 0.067201] pci_bus 0000:00: resource 4 [mem 0x10000000-0x3efeffff window]

[ 0.067367] pci_bus 0000:00: resource 5 [io 0x0000-0xffff window]

[ 0.067519] pci_bus 0000:00: resource 6 [mem 0x8000000000-0xffffffffff window]

[ 0.068087] iommu: Default domain type: Translated

[ 0.068242] iommu: DMA domain TLB invalidation policy: strict mode

[ 0.068487] SCSI subsystem initialized

[ 0.068679] libata version 3.00 loaded.

[ 0.068895] ACPI: bus type USB registered

[ 0.069000] usbcore: registered new interface driver usbfs

[ 0.069138] usbcore: registered new interface driver hub

[ 0.069276] usbcore: registered new device driver usb

[ 0.069434] pps_core: LinuxPPS API ver. 1 registered

[ 0.069571] pps_core: Software ver. 5.3.6 - Copyright 2005-2007 Rodolfo Giometti <[email protected]>

[ 0.069810] PTP clock support registered

[ 0.069924] EDAC MC: Ver: 3.0.0

[ 0.070617] scmi_core: SCMI protocol bus registered

[ 0.070833] efivars: Registered efivars operations

[ 0.071109] FPGA manager framework

[ 0.071261] Advanced Linux Sound Architecture Driver Initialized.

[ 0.071644] vgaarb: loaded

[ 0.071863] clocksource: Switched to clocksource arch_sys_counter

[ 0.072074] VFS: Disk quotas dquot_6.6.0

[ 0.072178] VFS: Dquot-cache hash table entries: 512 (order 0, 4096 bytes)

[ 0.072405] pnp: PnP ACPI init

[ 0.072509] system 00:00: [mem 0x4010000000-0x401fffffff window] could not be reserved

[ 0.072716] pnp: PnP ACPI: found 1 devices

[ 0.078669] NET: Registered PF_INET protocol family

[ 0.078956] IP idents hash table entries: 32768 (order: 6, 262144 bytes, linear)

[ 0.079485] tcp_listen_portaddr_hash hash table entries: 1024 (order: 2, 16384 bytes, linear)

[ 0.080003] Table-perturb hash table entries: 65536 (order: 6, 262144 bytes, linear)

[ 0.080216] TCP established hash table entries: 16384 (order: 5, 131072 bytes, linear)

[ 0.080435] TCP bind hash table entries: 16384 (order: 7, 524288 bytes, linear)

[ 0.080723] TCP: Hash tables configured (established 16384 bind 16384)

[ 0.080932] UDP hash table entries: 1024 (order: 4, 65536 bytes, linear)

[ 0.081118] UDP-Lite hash table entries: 1024 (order: 4, 65536 bytes, linear)

[ 0.081342] NET: Registered PF_UNIX/PF_LOCAL protocol family

[ 0.081679] RPC: Registered named UNIX socket transport module.

[ 0.081831] RPC: Registered udp transport module.

[ 0.081948] RPC: Registered tcp transport module.

[ 0.082067] RPC: Registered tcp-with-tls transport module.

[ 0.082205] RPC: Registered tcp NFSv4.1 backchannel transport module.

[ 0.082446] PCI: CLS 0 bytes, default 64

[ 0.082813] Initialise system trusted keyrings

[ 0.083041] workingset: timestamp_bits=42 max_order=19 bucket_order=0

[ 0.083255] squashfs: version 4.0 (2009/01/31) Phillip Lougher

[ 0.083506] NFS: Registering the id_resolver key type

[ 0.083708] Key type id_resolver registered

[ 0.083954] Key type id_legacy registered

[ 0.084085] nfs4filelayout_init: NFSv4 File Layout Driver Registering...

[ 0.084254] nfs4flexfilelayout_init: NFSv4 Flexfile Layout Driver Registering...

[ 0.084490] 9p: Installing v9fs 9p2000 file system support

[ 0.090011] Key type asymmetric registered

[ 0.090115] Asymmetric key parser 'x509' registered

[ 0.090250] Block layer SCSI generic (bsg) driver version 0.4 loaded (major 245)

[ 0.090441] io scheduler mq-deadline registered

[ 0.090555] io scheduler kyber registered

[ 0.090659] io scheduler bfq registered

[ 0.091238] ledtrig-cpu: registered to indicate activity on CPUs

[ 0.091712] input: Power Button as /devices/LNXSYSTM:00/LNXSYBUS:00/PNP0C0C:00/input/input0

[ 0.092066] ACPI: button: Power Button [PWRB]

[ 0.096215] ACPI: \_SB_.L001: Enabled at IRQ 36

[ 0.096889] ACPI: \_SB_.L003: Enabled at IRQ 38

[ 0.097004] virtio-pci 0000:00:03.0: enabling device (0005 -> 0007)

[ 0.099091] Serial: 8250/16550 driver, 4 ports, IRQ sharing enabled

[ 0.099820] msm_serial: driver initialized

[ 0.100120] SuperH (H)SCI(F) driver initialized

[ 0.100244] STM32 USART driver initialized

[ 0.101242] loop: module loaded

[ 0.101376] virtio_blk virtio2: 2/0/0 default/read/poll queues

[ 0.101732] virtio_blk virtio2: [vda] 52428800 512-byte logical blocks (26.8 GB/25.0 GiB)

[ 0.102671] vda: vda1 vda2

[ 0.102960] megasas: 07.727.03.00-rc1

[ 0.103498] tun: Universal TUN/TAP device driver, 1.6

[ 0.104054] thunder_xcv, ver 1.0

[ 0.104138] thunder_bgx, ver 1.0

[ 0.104218] nicpf, ver 1.0

[ 0.104367] hns3: Hisilicon Ethernet Network Driver for Hip08 Family - version

[ 0.104545] hns3: Copyright (c) 2017 Huawei Corporation.

[ 0.104676] hclge is initializing

[ 0.104758] e1000: Intel(R) PRO/1000 Network Driver

[ 0.104876] e1000: Copyright (c) 1999-2006 Intel Corporation.

[ 0.105025] e1000e: Intel(R) PRO/1000 Network Driver

[ 0.105151] e1000e: Copyright(c) 1999 - 2015 Intel Corporation.

[ 0.105309] igb: Intel(R) Gigabit Ethernet Network Driver

[ 0.105452] igb: Copyright (c) 2007-2014 Intel Corporation.

[ 0.105600] igbvf: Intel(R) Gigabit Virtual Function Network Driver

[ 0.105764] igbvf: Copyright (c) 2009 - 2012 Intel Corporation.

[ 0.105939] sky2: driver version 1.30

[ 0.106389] VFIO - User Level meta-driver version: 0.3

[ 0.106971] usbcore: registered new interface driver usb-storage

[ 0.107055] ehci-pci 0000:00:02.0: EHCI Host Controller

[ 0.107368] ehci-pci 0000:00:02.0: new USB bus registered, assigned bus number 1

[ 0.108057] ehci-pci 0000:00:02.0: irq 46, io mem 0x10001000

[ 0.111606] rtc-efi rtc-efi.0: registered as rtc0

[ 0.111995] rtc-efi rtc-efi.0: setting system clock to 2025-08-18T12:58:55 UTC (1755521935)

[ 0.112273] i2c_dev: i2c /dev entries driver

[ 0.112834] sdhci: Secure Digital Host Controller Interface driver

[ 0.112987] sdhci: Copyright(c) Pierre Ossman

[ 0.113142] Synopsys Designware Multimedia Card Interface Driver

[ 0.113353] sdhci-pltfm: SDHCI platform and OF driver helper

[ 0.113642] pstore: Using crash dump compression: deflate

[ 0.113776] pstore: Registered efi_pstore as persistent store backend

[ 0.114064] usbcore: registered new interface driver usbhid

[ 0.114262] usbhid: USB HID core driver

[ 0.115006] NET: Registered PF_PACKET protocol family

[ 0.115205] 9pnet: Installing 9P2000 support

[ 0.115376] Key type dns_resolver registered

[ 0.116210] registered taskstats version 1

[ 0.116334] Loading compiled-in X.509 certificates

[ 0.117012] Demotion targets for Node 0: null

[ 0.117233] clk: Disabling unused clocks

[ 0.117332] PM: genpd: Disabling unused power domains

[ 0.117458] ALSA device list:

[ 0.117537] No soundcards found.

[ 0.120423] ehci-pci 0000:00:02.0: USB 2.0 started, EHCI 1.00

[ 0.120654] hub 1-0:1.0: USB hub found

[ 0.120749] hub 1-0:1.0: 6 ports detected

[ 0.121876] EXT4-fs (vda2): mounted filesystem df86d824-3058-48bd-9515-24ac42491dc6 ro with ordered data mode. Quota mode: none.

[ 0.122316] VFS: Mounted root (ext4 filesystem) readonly on device 254:2.

[ 0.123100] devtmpfs: mounted

[ 0.123527] Freeing unused kernel memory: 2816K

[ 0.123736] Run /sbin/init as init process

[ 0.123910] with arguments:

[ 0.123983] /sbin/init

[ 0.124050] with environment:

[ 0.124128] HOME=/

[ 0.124186] TERM=linux

[ 0.124253] BOOT_IMAGE=/vmlinuz-6.13.4-lfs-12.3

[ 0.124372] earlyprintk=efi,keep

INIT: version 3.14 booting

* Mounting virtual file systems: /run /proc /sys /dev/shm /sys/fs/c[ OK ]

* Create symlinks in /dev targeting /proc: /dev/stdin /dev/stdout /[ OK ]rr /dev/fd

* Bringing up the loopback interface... [ OK ]

Setting hostname to # Hostname configuration

# This file is written and managed by Ansible of Generic Distro Toolkit

* ... [ OK ]

Populating /dev with device nodes... [ 0.197662] udevd[177]: Starting systemd-udevd version 257.3

[ 0.198802] udevd[178]: Using default interface naming scheme 'v257'.

[ 0.371879] usb 1-1: new high-speed USB device number 2 using ehci-pci

[ 0.530167] input: QEMU QEMU USB Keyboard as /devices/pci0000:00/0000:00:02.0/usb1/1-1/1-1:1.0/0003:0627:0001.0001/input/input1

[ 0.655926] hid-generic 0003:0627:0001.0001: input: USB HID v1.11 Keyboard [QEMU QEMU USB Keyboard] on usb-0000:00:02.0-1/input0

* [ OK ]

* Activating all swap files/partitions... [ OK ]

Mounting root file system in read-only mode... [ 1.232877] EXT4-fs (vda2): re-mounted df86d824-3058-48bd-9515-24ac42491dc6 ro. Quota mode: none.

* [ OK ]

* Checking file systems... [ OK ]

Remounting root file system in read-write mode...[ 1.247071] EXT4-fs (vda2): re-mounted df86d824-3058-48bd-9515-24ac42491dc6 r/w. Quota mode: none.

* [ OK ]

* Mounting remaining file systems... [ OK ]

* Cleaning file systems: /tmp [ OK ]

* Retrying failed uevents, if any... [ OK ]

* Setting kernel runtime parameters... [ OK ]

INIT: Entering runlevel: 3

* Starting system log daemon... [ OK ]

devbox-aarch4 login: root

Password:

No mail.

-bash-5.2#

-bash-5.2# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

2: eth0: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000

link/ether 52:54:00:12:34:56 brd ff:ff:ff:ff:ff:ff

altname enx525400123456

-bash-5.2#

-bash-5.2# echo "test"

test

-bash-5.2# uname -a

Linux 0xHrtz 6.13.4 #1 SMP PREEMPT Fri Aug 15 21:55:14 UTC 2025 aarch64 GNU/Linux

-bash-5.2# uname -n

devbox-aarch4

-bash-5.2# uname -m

aarch64

-bash-5.2# uname -a

Linux devbox-aarch4 6.13.4 #1 SMP PREEMPT Fri Aug 15 21:55:14 UTC 2025 aarch64 GNU/LinuxA Londra mi sembrano tutti molto educati e in presa bene, e poi sono stati 5 giorni di sole. Quest’anno anche al Fosdem c’era il sole. Insomma, dal punto di vista metereologico sono stato fortunato ad entrambi gli eventi dell’anno (considero questi due gli “eventi dell’anno”, ma ce ne sono tanti altri interessanti).

La conferenza si è tenuta ad ExCeL London di cui adoro il mix tra location dell’evento ed esercizi commerciali “embedded”. I panini della KubeCon sono buoni, ma anche farsi dei noodles in pausa pranzo fa piacere. L’organizzazione dell’evento è stata perfetta, non ci sono mai state code per i talk, le presentazioni molto chiare.

Naturalmente, il mio viaggio, essendo stato sponsorizzato da parte della mia società, Sourcesense (che ringrazio), ho avuto il piacevole mandato di non presidiare la conferenza solo per accumulare gadget (tema su cui dopo scriverò qualche riga) ma anche per carpire quelli che sono i trend tecnologici, le soluzioni e gli spunti per architetture e tool-chain nuove.

Kubernetes ha da poco compiuto 10 anni e devo dire che la community è ancora molto attiva e determinata.

Ogni tanto si è parlato di una grande numerosità di progetti nella tool-chain presente nel CNCF. Questo aspetto genera complessità, ma credo che sia facile individuare i tool su cui puntare grazie alle attività di divulgazione che i membri della community svolgono. L’anno scorso, a Parigi, ricordo che si parlò di era dell’AI e in effetti anche in questa KubeCon si è ripreso il tema. Come eseguire i modelli, containerizzarli, distribuire i carichi a seconda delle risorse all’interno di Kubernetes, sono alcuni punti di vari talk a cui ho partecipato. Come l’anno scorso, il tema su cui ci è si è soffermati parecchio è quello della osservabilità. Kubernetes e le architetture a microservizi (tanti microservizi) possono risultare complessi da osservare. Ma è un problema che grazie a Prometheus e Open Telemetry è risolvibile a mio parere. Naturalmente, senza farsi sommergere dalle metriche e applicando una selezione di quest’ultime che abbia senso. Anche perchè tali metriche allertano i reperibili ed è necessario svegliarli veramente quando serve!

L’aspetto interessante di KubeCon sono i talk di ingegneri che lavorano in grandi realtà dove hanno grandi (ma veramente grandi) cluster Kubernetes e risorse a disposizione. Sono spunti interessanti per capire se la tool-chain, i pattern di CI/CD e Observability, la distro Kubernetes scelta, sono in linea con chi affronta sfide simili (e a volte più grandi, come nel caso del CERN).

Si è parlato anche di Rust e della sua presenza sempre più crescente all’interno del progetto Linux. Si è anche un po’ scherzato sullo spirito di repulsione che gli sviluppatori della vecchia scuola, amanti e utilizzatori ormai abitudinari del C, hanno nei confronti di Rust. Non scenderò nel dettaglio ma ricordo come sono state visionate alcune CVE del Kernel che banalmente sono state prodotte da una dimenticanza dei programmatori nel valutare correttamente i ritorni di funzioni. Rust non impone il controllo su tutti i ritorni sempre, ma lo fa in modo intelligente grazie a tipi come Result e Option combinati con annotazioni tipo #[must_use]. Insomma, il messaggio che è arrivato è che il compilatore non risolve qualsiasi problema ma facilità la vita degli sviluppatori.

Ho trovato i soliti cloni di KubeInvaders e quest’anno ce n’era uno nuovo! Ho postato qui le foto. Devo dire che preferivo SpotInvaders di AWS a questo punto  Naturalmente lo dico in modo scherzoso.

Naturalmente lo dico in modo scherzoso.

Andiamo ora su alcuni aspetti ludici degli eventi tech..

Stickers

A livello di sticker ce ne sono veramente tanti. Ci sono degli Stickers Wall dove accollandosi un po’ di fila è possibile fare scorta. Credo però che sia possibile prenderne uno per tool (ricordo che a Parigi venni ripreso…). Tuttavia, a questa KubeCon non ci sono andato allo Stickers Wall.

Ci sono anche gli sticker che distribuiscono nei vari banchetti e chioschi dell’area Solutions Showcase. I vendor più grandi e potenti hanno chioschi che sembrano delle “micro discoteche”. C’è anche spesso un qualcuno microfonato che fa molto “venghino signori!”.

I progetti che seguo io, di solito, hanno il banchetto piccolo e una persona sola a presidiare.

Gadgets

Quelli non li ho proprio presi. Gadget uguale “tonnellate di email quando torno” (scherzo naturalmente).

In sostanza, quest’anno non ho rimediato gadget e ho portato con me veramente pochissimi sticker. Non so perchè, ma mi sento molto più a mio agio al FOSDEM sul tema dell’acquisizione compulsiva degli adesivi… Lì, basta una stretta di mano e un’occhiata per ottenerli mentre a KubeCon, giustamente, un po’ di chiacchiere in più è gradito che ci siano. Ripeto, non è una critica. Il mercato va alimentato in qualche modo e le aziende (anche quelle che lavorano a contatto con l’open-source) devono promuoversi come è giusto che sia.

Quindi, il FOSDEM rimane l’unico luogo dove puoi prendere tonnellate di sticker in tranquillità (non frequento troppe conferenze per cui perdonatemi se ci sono posti in cui è possibile prenderne di più).

Il bilancio di questo viaggio

Veramente super positivo. Ho assistito a talk di persone che seguo e che per me sono i punti di riferimento su Kubernetes e sull’ecosistema che si è creato intorno.

Torno con qualche informazione in più sui trend, le architetture di riferimento e progetti di rilievo. Torno anche con qualche accordo interessante :D.

È importante sapere che Kubernetes è supportato da una community enorme e distribuita a livello globale perchè ormai lo utilizziamo per esercire molte delle infrastrutture su cui lavoriamo. Presidiare tali eventi è fondamentale.

]]>The steps are quite simple.

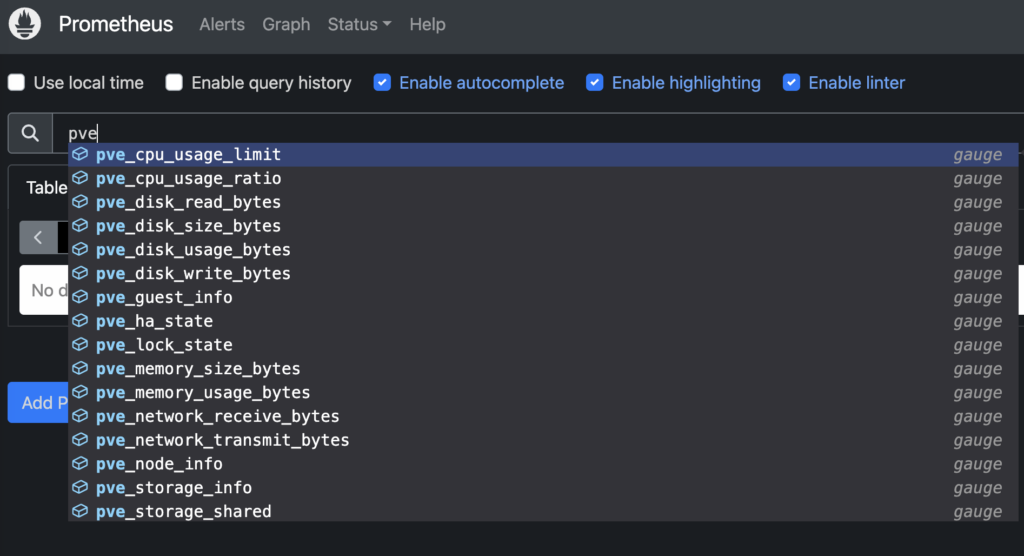

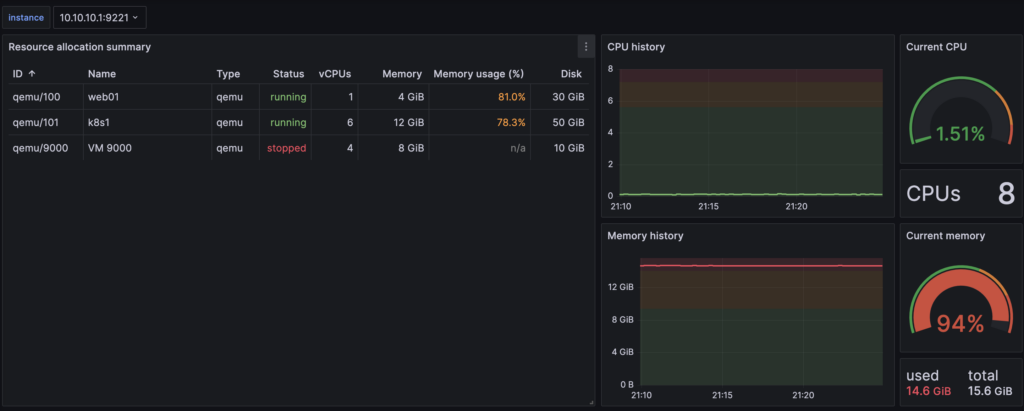

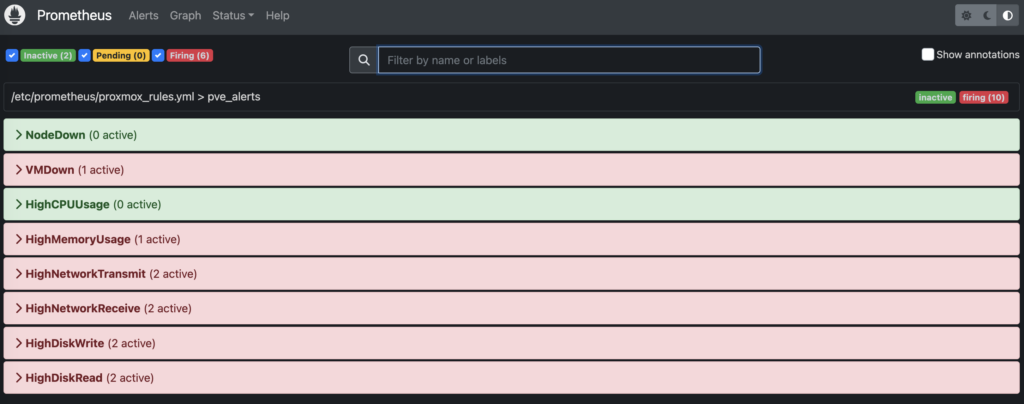

python3 -m venv /opt/prometheus-pve-exporter

/opt/prometheus-pve-exporter/bin/pip install prometheus-pve-exporter

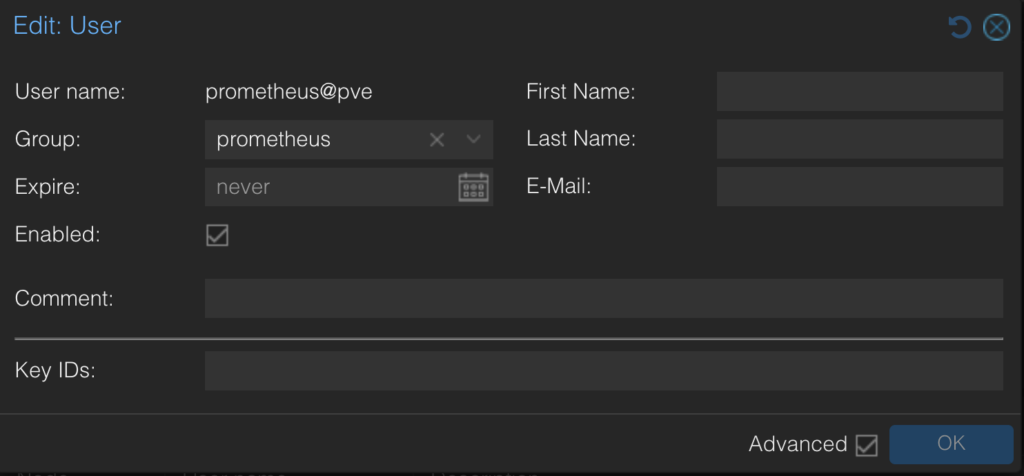

# Check the installation with: /opt/prometheus-pve-exporter/bin/pve_exporter --helpOnce the Python module is installed, I can set up the configuration file for the exporter, and I also need a user dedicated to read-only access.

I have created a prometheus user

As described in the exporter’s documentation, it’s fine to assign the PVEAuditor role to the user, and I have configured the pve.yml file

Now, I can create the pve.yml file in /etc/prometheus/pve.yml.

$ root@ns304365 (~) > cat /etc/prometheus/pve.yml

$ root@ns304365 (~) > cat /etc/prometheus/pve.yml

default:

user: prometheus@pve

password: ****

verify_ssl: false

# I used the password but you can use also an API tokenThis is the SystemD service unit, located at /etc/systemd/system/prometheus-pve-exporter.service.

$ root@ns304365 (~) > cat /etc/systemd/system/prometheus-pve-exporter.service

[Unit]

Description=Prometheus exporter for Proxmox VE

Documentation=https://github.com/znerol/prometheus-pve-exporter

[Service]

Restart=always

User=prometheus

ExecStart=/opt/prometheus-pve-exporter/bin/pve_exporter --config.file /etc/prometheus/pve.yml

[Install]

WantedBy=multi-user.targetOnce the file is created, you need to reload the daemon’s configuration and start the service.

systemctl daemon-reload

systemctl start prometheus-pve-exporterYou can test if the exporter is working properly using curl.

$ root@ns304365 (~) > curl localhost:9221/pve

# HELP pve_up Node/VM/CT-Status is online/running

# TYPE pve_up gauge

pve_up{id="node/ns304365"} 1.0

pve_up{id="qemu/100"} 1.0

pve_up{id="qemu/101"} 1.0

pve_up{id="qemu/9000"} 0.0

pve_up{id="storage/ns304365/local"} 1.0

# HELP pve_disk_size_bytes Storage size in bytes (for type 'storage'), root image size for VMs (for types 'qemu' and 'lxc').

# TYPE pve_disk_size_bytes gauge

pve_disk_size_bytes{id="qemu/100"} 3.221225472e+010

pve_disk_size_bytes{id="qemu/101"} 5.36870912e+010

pve_disk_size_bytes{id="qemu/9000"} 1.073741824e+010

pve_disk_size_bytes{id="node/ns304365"} 2.0940804096e+010

pve_disk_size_bytes{id="storage/ns304365/local"} 2.7177187328e+011

# HELP pve_disk_usage_bytes Used disk space in bytes (for type 'storage'), used root image space for VMs (for types 'qemu' and 'lxc').

# TYPE pve_disk_usage_bytes gauge

pve_disk_usage_bytes{id="qemu/100"} 0.0

pve_disk_usage_bytes{id="qemu/101"} 0.0

pve_disk_usage_bytes{id="qemu/9000"} 0.0

pve_disk_usage_bytes{id="node/ns304365"} 1.9636924416e+010

pve_disk_usage_bytes{id="storage/ns304365/local"} 1.93465360384e+011

# HELP pve_memory_size_bytes Number of available memory in bytes (for types 'node', 'qemu' and 'lxc').

# TYPE pve_memory_size_bytes gauge

pve_memory_size_bytes{id="qemu/100"} 4.294967296e+09

pve_memory_size_bytes{id="qemu/101"} 1.2884901888e+010

pve_memory_size_bytes{id="qemu/9000"} 8.589934592e+09

pve_memory_size_bytes{id="node/ns304365"} 1.6759209984e+010

# HELP pve_memory_usage_bytes Used memory in bytes (for types 'node', 'qemu' and 'lxc').

# TYPE pve_memory_usage_bytes gauge

pve_memory_usage_bytes{id="qemu/100"} 3.226718208e+09

pve_memory_usage_bytes{id="qemu/101"} 1.0086023168e+010

pve_memory_usage_bytes{id="qemu/9000"} 0.0

pve_memory_usage_bytes{id="node/ns304365"} 1.569089536e+010

# HELP pve_network_transmit_bytes The amount of traffic in bytes that was sent from the guest over the network since it was started. (for types 'qemu' and 'lxc')

# TYPE pve_network_transmit_bytes gauge

pve_network_transmit_bytes{id="qemu/100"} 8.446923247e+010

pve_network_transmit_bytes{id="qemu/101"} 1.2573177635e+010

pve_network_transmit_bytes{id="qemu/9000"} 0.0

# HELP pve_network_receive_bytes The amount of traffic in bytes that was sent to the guest over the network since it was started. (for types 'qemu' and 'lxc')

# TYPE pve_network_receive_bytes gauge

pve_network_receive_bytes{id="qemu/100"} 2.1083896353e+010

pve_network_receive_bytes{id="qemu/101"} 7.7540201276e+010

pve_network_receive_bytes{id="qemu/9000"} 0.0

# HELP pve_disk_write_bytes The amount of bytes the guest wrote to its block devices since the guest was started. This info is not available for all storage types. (for types 'qemu' and 'lxc')

# TYPE pve_disk_write_bytes gauge

pve_disk_write_bytes{id="qemu/100"} 1.91578735104e+011

pve_disk_write_bytes{id="qemu/101"} 5.312994432e+011

pve_disk_write_bytes{id="qemu/9000"} 0.0

# HELP pve_disk_read_bytes The amount of bytes the guest read from its block devices since the guest was started. This info is not available for all storage types. (for types 'qemu' and 'lxc')

# TYPE pve_disk_read_bytes gauge

pve_disk_read_bytes{id="qemu/100"} 1.578918018804e+012

pve_disk_read_bytes{id="qemu/101"} 5.544803722e+09

pve_disk_read_bytes{id="qemu/9000"} 0.0

# HELP pve_cpu_usage_ratio CPU utilization (for types 'node', 'qemu' and 'lxc').

# TYPE pve_cpu_usage_ratio gauge

pve_cpu_usage_ratio{id="qemu/100"} 0.0685821712501984

pve_cpu_usage_ratio{id="qemu/101"} 0.132691592201471

pve_cpu_usage_ratio{id="qemu/9000"} 0.0

pve_cpu_usage_ratio{id="node/ns304365"} 0.148930720962991

# HELP pve_cpu_usage_limit Number of available CPUs (for types 'node', 'qemu' and 'lxc').

# TYPE pve_cpu_usage_limit gauge

pve_cpu_usage_limit{id="qemu/100"} 1.0

pve_cpu_usage_limit{id="qemu/101"} 6.0

pve_cpu_usage_limit{id="qemu/9000"} 4.0

pve_cpu_usage_limit{id="node/ns304365"} 8.0

# HELP pve_uptime_seconds Uptime of node or virtual guest in seconds (for types 'node', 'qemu' and 'lxc').

# TYPE pve_uptime_seconds gauge

pve_uptime_seconds{id="qemu/100"} 8.069085e+06

pve_uptime_seconds{id="qemu/101"} 5.448312e+06

pve_uptime_seconds{id="qemu/9000"} 0.0

pve_uptime_seconds{id="node/ns304365"} 8.069122e+06

# HELP pve_storage_shared Whether or not the storage is shared among cluster nodes

# TYPE pve_storage_shared gauge

pve_storage_shared{id="storage/ns304365/local"} 0.0

# HELP pve_ha_state HA service status (for HA managed VMs).

# TYPE pve_ha_state gauge

pve_ha_state{id="qemu/100",state="stopped"} 0.0

pve_ha_state{id="qemu/100",state="request_stop"} 0.0

pve_ha_state{id="qemu/100",state="request_start"} 0.0

pve_ha_state{id="qemu/100",state="request_start_balance"} 0.0

pve_ha_state{id="qemu/100",state="started"} 0.0

pve_ha_state{id="qemu/100",state="fence"} 0.0

pve_ha_state{id="qemu/100",state="recovery"} 0.0

pve_ha_state{id="qemu/100",state="migrate"} 0.0

pve_ha_state{id="qemu/100",state="relocate"} 0.0

pve_ha_state{id="qemu/100",state="freeze"} 0.0

pve_ha_state{id="qemu/100",state="error"} 0.0

pve_ha_state{id="qemu/101",state="stopped"} 0.0

pve_ha_state{id="qemu/101",state="request_stop"} 0.0

pve_ha_state{id="qemu/101",state="request_start"} 0.0

pve_ha_state{id="qemu/101",state="request_start_balance"} 0.0

pve_ha_state{id="qemu/101",state="started"} 0.0

pve_ha_state{id="qemu/101",state="fence"} 0.0

pve_ha_state{id="qemu/101",state="recovery"} 0.0

pve_ha_state{id="qemu/101",state="migrate"} 0.0

pve_ha_state{id="qemu/101",state="relocate"} 0.0

pve_ha_state{id="qemu/101",state="freeze"} 0.0

pve_ha_state{id="qemu/101",state="error"} 0.0

pve_ha_state{id="qemu/9000",state="stopped"} 0.0

pve_ha_state{id="qemu/9000",state="request_stop"} 0.0

pve_ha_state{id="qemu/9000",state="request_start"} 0.0

pve_ha_state{id="qemu/9000",state="request_start_balance"} 0.0

pve_ha_state{id="qemu/9000",state="started"} 0.0

pve_ha_state{id="qemu/9000",state="fence"} 0.0

pve_ha_state{id="qemu/9000",state="recovery"} 0.0

pve_ha_state{id="qemu/9000",state="migrate"} 0.0

pve_ha_state{id="qemu/9000",state="relocate"} 0.0

pve_ha_state{id="qemu/9000",state="freeze"} 0.0

pve_ha_state{id="qemu/9000",state="error"} 0.0

pve_ha_state{id="node/ns304365",state="online"} 0.0

pve_ha_state{id="node/ns304365",state="maintenance"} 0.0

pve_ha_state{id="node/ns304365",state="unknown"} 0.0

pve_ha_state{id="node/ns304365",state="fence"} 0.0

pve_ha_state{id="node/ns304365",state="gone"} 0.0