Mientras el debate público sobre tecnología oscila entre el tecno-optimismo de Silicon Valley y el pesimismo ludita, hay una realidad que pasa desapercibida: existen infraestructuras tecnológicas construidas y gobernadas por comunidades, sin ánimo de lucro, que funcionan a escala planetaria y que, en muchos casos, superan en calidad y fiabilidad a sus equivalentes corporativos. No son experimentos marginales. Son los cimientos invisibles sobre los que se sostiene buena parte de la economía digital mundial.

ste artículo examina cinco de esas experiencias —Linux, Wikipedia, guifi.net, Decidim y Som Energia— no como curiosidades, sino como pruebas empíricas de que otro modelo de desarrollo tecnológico es posible, viable y escalable. Y argumenta que, si queremos que esa posibilidad se convierta en transformación social, la clave está en la educación.

El oligopolio invisible

Para entender por qué importan los comunes digitales, conviene primero dimensionar el problema que resuelven.

Cinco empresas —Alphabet (Google), Amazon, Apple, Meta y Microsoft— acumulan una capitalización bursátil combinada que supera los 12 billones de dólares (datos de 2024). Controlan las búsquedas en internet (Google: 91 % de cuota global), las redes sociales (Meta: 3.000 millones de usuarios activos mensuales solo en Facebook), el comercio electrónico (Amazon: 37 % de las ventas online en EE. UU.), los sistemas operativos de los teléfonos móviles (Android de Google + iOS de Apple: 99 % del mercado) y la infraestructura de computación en la nube (AWS de Amazon + Azure de Microsoft + Google Cloud: 66 % del mercado).

Esta concentración no es solo un problema económico. Es un problema político. Quien controla la infraestructura digital controla los flujos de información, los algoritmos que determinan qué vemos y qué no, los datos que generamos con cada clic y, en última instancia, las condiciones materiales de la participación democrática. Como señaló la politóloga Shoshana Zuboff en La era del capitalismo de la vigilancia, no somos los clientes de estas plataformas: somos la materia prima.

La pregunta no es si la tecnología transforma la sociedad —eso ya está ocurriendo—, sino quién la gobierna y en beneficio de quién.

Qué son los comunes digitales (y por qué importan)

El concepto de comunes —o commons en inglés— tiene una larga historia. Se refiere a recursos compartidos que una comunidad gestiona colectivamente, sin que sean propiedad privada de nadie ni estén controlados por el Estado. Los pastos comunales medievales, los sistemas de riego gestionados (la vega de Granada y sus sistema de riego, la huerta valenciana) por agricultores o los bancos de pesca regulados por comunidades costeras son ejemplos clásicos.

La economista Elinor Ostrom, primera mujer en recibir el Nobel de Economía (2009), demostró que las comunidades pueden gestionar recursos compartidos de forma sostenible y eficiente, sin necesidad de privatización ni de intervención estatal, siempre que se cumplan ciertos principios de diseño:

- límites claros,

- reglas adaptadas al contexto local,

- participación de los usuarios en la toma de decisiones,

- mecanismos de resolución de conflictos y

- capacidad de autoorganización.

Los comunes digitales trasladan esta lógica al ámbito tecnológico. Son software, conocimiento, infraestructuras o plataformas creados y mantenidos colectivamente, con licencias que garantizan su acceso libre y su gobernanza comunitaria. A diferencia de los recursos naturales, los bienes digitales tienen una propiedad económica particular: son no rivales —el hecho de que yo use un programa de software libre no impide que tú lo uses— y su coste de reproducción es prácticamente cero. Esto los convierte en candidatos ideales para la gestión comunal.

El término soberanía tecnológica complementa esta idea. Se refiere a la capacidad de una comunidad —ya sea un barrio, una ciudad, un país o una red global de personas— para controlar las tecnologías de las que depende: entender cómo funcionan, modificarlas según sus necesidades, no depender de una corporación para acceder a ellas y participar en las decisiones sobre su desarrollo. No se trata de autarquía ni de reinventar la rueda, sino de que la dependencia tecnológica no se convierta en subordinación política. A continuación detallamos cinco comunes que funcionan.

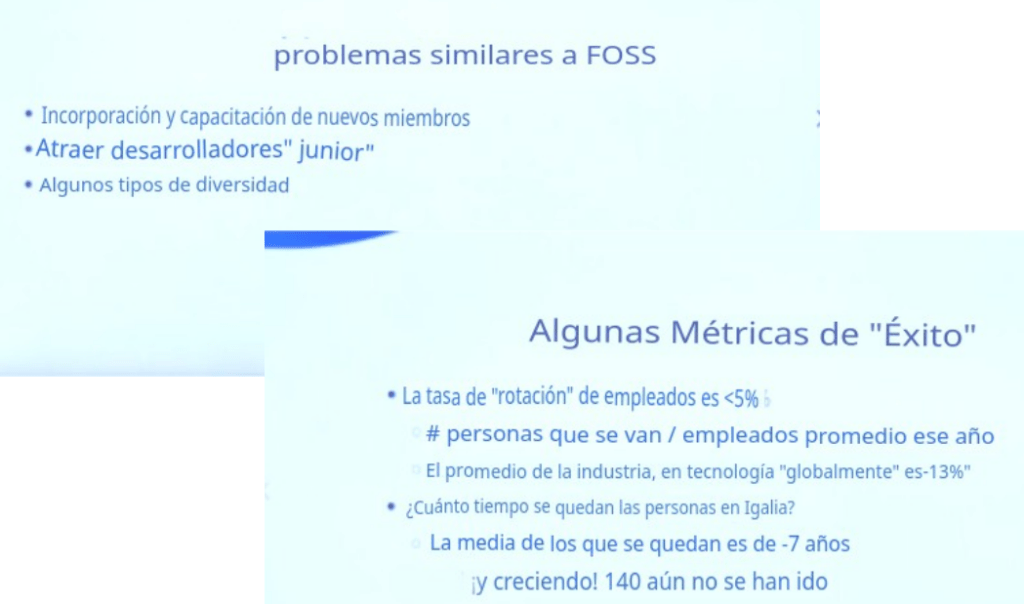

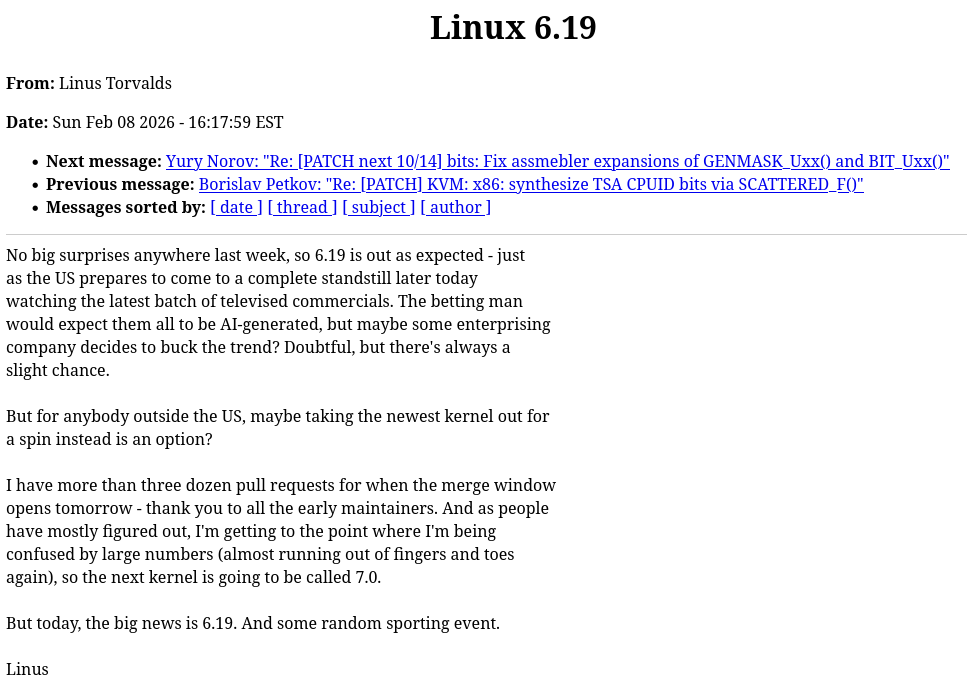

1. Linux: el sistema operativo que sostiene internet

Linux es un sistema operativo de código abierto —esto es, un programa cuyo código fuente es público y cualquier persona puede leer, modificar y redistribuir— creado en 1991 por Linus Torvalds, entonces un estudiante finlandés de 21 años. Lo que comenzó como un proyecto personal se convirtió en uno de los mayores esfuerzos colaborativos de la historia de la humanidad.

Los números son difíciles de asimilar. Más de 20.000 personas de 1.700 empresas distintas han contribuido al núcleo de Linux (kernel). El resultado es un sistema que, sin pertenecer a ninguna corporación, domina la infraestructura tecnológica global:

- El 96 % de los servidores web del millón de sitios más visitados del mundo funcionan con Linux.

- El 85 % de los teléfonos inteligentes usan Android, que está construido sobre Linux.

- El 100 % de los 500 supercomputadores más potentes del mundo ejecutan Linux.

- La Estación Espacial Internacional funciona con Linux. Los coches Tesla funcionan con Linux. La infraestructura de Amazon, Google, Facebook y Netflix funciona con Linux.

Dicho de otro modo: el software más importante del planeta no es propiedad de nadie. Es un bien común. Y no solo funciona, sino que es técnicamente superior a sus alternativas privativas en fiabilidad, seguridad y rendimiento para la inmensa mayoría de usos profesionales.

Dicho de otro modo: el software más importante del planeta no es propiedad de nadie. Es un bien común. Y no solo funciona, sino que es técnicamente superior a sus alternativas privativas en fiabilidad, seguridad y rendimiento para la inmensa mayoría de usos profesionales.

¿Cómo es posible? Porque la producción colaborativa entre iguales —lo que el profesor de Harvard Yochai Benkler denominó producción entre pares basada en el procomún (commons based peer production)— genera incentivos que el mercado no puede replicar: revisión constante del código por miles de ojos expertos, ausencia de obsolescencia programada, adaptabilidad a necesidades locales y una velocidad de innovación que ninguna empresa individual puede igualar.

GNU – Linux lleva 33 años demostrando que la cooperación a gran escala, sin jefes ni accionistas, produce resultados que superan al modelo corporativo.

2. Wikipedia: el conocimiento como bien común

Wikipedia es la enciclopedia más grande jamás creada. Contiene más de 60 millones de artículos en más de 300 idiomas, escritos y editados por más de 300.000 personas voluntarias. Opera con un presupuesto anual de unos 150 millones de dólares —financiado íntegramente por donaciones— y un equipo técnico de apenas unos cientos de personas. Para ponerlo en perspectiva: la Enciclopedia Británica, con sus 4.000 articulistas profesionales y tres siglos de historia, publicó 120.000 artículos en su última edición impresa. Wikipedia tiene 500 veces más contenido.

Pero lo verdaderamente notable no es el volumen, sino la gobernanza. Wikipedia funciona con un sistema de autoorganización comunitaria que encaja punto por punto con los principios de Ostrom:

- normas claras sobre qué constituye una fuente fiable,

- mecanismos de resolución de disputas entre editores,

- procesos democráticos para elegir administradores,

- transparencia total (cada edición queda registrada y es reversible) y

- sanciones graduales para quienes violan las normas.

¿Es perfecta? No. Tiene sesgos de género (solo el 15–20 % de editores activos son mujeres), sesgos lingüísticos (la Wikipedia en inglés es mucho más completa que la de lenguas minoritarias) y es vulnerable al vandalismo. Pero estas son limitaciones conocidas, documentadas por la propia comunidad, y objeto de esfuerzos activos de corrección. Lo relevante es que, con todos sus defectos, Wikipedia lleva 25 años demostrando que una comunidad global de voluntarios puede producir y mantener un recurso de conocimiento de referencia mundial, sin publicidad, sin muros de pago y sin control corporativo.

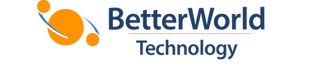

3. guifi.net: internet como infraestructura comunitaria

Aquí la cosa se pone tangible. Porque si Linux y Wikipedia demuestran que el software y el conocimiento pueden ser comunes, guifi.net demuestra que la infraestructura física también puede serlo.

guifi.net es una red de telecomunicaciones comunitaria nacida en 2004 en Osona (Cataluña), en una zona rural donde las operadoras comerciales no ofrecían servicio de banda ancha porque no les resultaba rentable. La respuesta de la comunidad fue: «Si no nos dan internet, lo construimos nosotros».

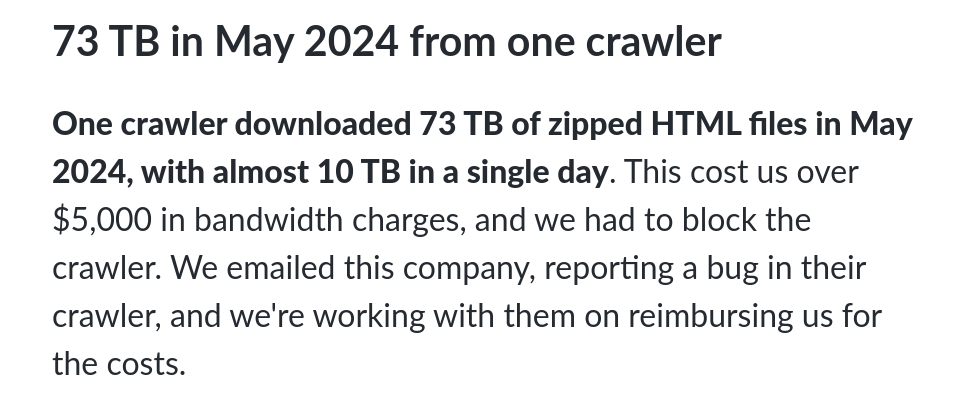

![]() Hoy, guifi.net cuenta con más de 40.000 nodos operativos y más de 40.000 kilómetros de fibra óptica desplegada. Es la red comunitaria de telecomunicaciones más grande del mundo. Ofrece conectividad a hogares, empresas y administraciones públicas, y opera bajo el principio de procomún de red: la infraestructura es de titularidad colectiva, y cualquier persona u organización puede conectarse, usarla y ampliarla siempre que respete unas reglas básicas de interconexión abierta.

Hoy, guifi.net cuenta con más de 40.000 nodos operativos y más de 40.000 kilómetros de fibra óptica desplegada. Es la red comunitaria de telecomunicaciones más grande del mundo. Ofrece conectividad a hogares, empresas y administraciones públicas, y opera bajo el principio de procomún de red: la infraestructura es de titularidad colectiva, y cualquier persona u organización puede conectarse, usarla y ampliarla siempre que respete unas reglas básicas de interconexión abierta.

El modelo económico es ingenioso. guifi.net no es una empresa ni una ONG, sino una fundación que gestiona un bien común. Los operadores locales (pequeñas empresas, cooperativas, asociaciones) pueden ofrecer servicios comerciales sobre la infraestructura compartida, pero la red en sí no es propiedad de nadie. Es como una carretera pública sobre la que circulan distintos transportistas.

Lo que guifi.net demuestra es crucial: no solo el software inmaterial puede ser un común, sino también el hardware, los cables, las antenas, la infraestructura pesada. Y cuando una comunidad controla su propia conectividad, deja de depender de las decisiones de una corporación sobre dónde invertir y dónde no, qué velocidad ofrecer, a qué precio y con qué condiciones.

Nodos en el mundo guifi.net

| Zone name | Operatiu | Planned | Building | Testing | Inactive | Total |

|---|---|---|---|---|---|---|

| Africa | 8 | 62 | 1 | 4 | 1 | 78 |

| America | 20 | 215 | 5 | 13 | 1 | 258 |

| Asia | 11 | 22 | 2 | 0 | 0 | 35 |

| Australia | 0 | 1 | 0 | 0 | 0 | 1 |

| Europe | 37.590 | 22.140 | 469 | 659 | 8.161 | 69.627 |

| Ukraine-test | 0 | 1 | 0 | 0 | 0 | 1 |

| 37.629 | 22.441 | 477 | 676 | 8.163 | 70.000 |

4. Decidim: democracia participativa con código abierto

Decidim (del catalán, “decidimos”) es una plataforma digital de participación democrática de código abierto, nacida en el Ayuntamiento de Barcelona en 2016. Permite a cualquier institución u organización crear procesos participativos: presupuestos participativos, consultas ciudadanas, debates públicos, recogida de propuestas, asambleas digitales y procesos de rendición de cuentas.

Lo que distingue a Decidim de otras plataformas de participación es su arquitectura política. No es solo una herramienta técnica: es un proyecto explícitamente comprometido con la democracia radical. Su código es libre (cualquiera puede auditarlo, modificarlo y usarlo), su gobernanza es comunitaria (las decisiones sobre el desarrollo del software se toman en asambleas abiertas llamadas Metadecidim) y su diseño incorpora deliberadamente salvaguardas contra la concentración de poder: transparencia, trazabilidad de todas las decisiones y resistencia a la manipulación.

Hoy, más de 400 instituciones en todo el mundo usan Decidim: desde el Ayuntamiento de Barcelona y el de Helsinki hasta la Comisión Europea, gobiernos regionales, universidades, cooperativas y movimientos sociales. En Barcelona, más de 70.000 personas han participado en procesos a través de la plataforma.

Decidim encarna un principio que el filósofo francés Bernard Stiegler llamó el carácter farmacológico de la tecnología —del griego phármakon, que significa simultáneamente remedio y veneno—:

la misma tecnología digital que permite la vigilancia masiva y la manipulación algorítmica puede, si se diseña y gobierna de otro modo, convertirse en herramienta de profundización democrática. La tecnología no es buena ni mala por naturaleza; lo que importa es quién la diseña, para qué y bajo qué reglas.

5. Som Energia: energía renovable y cooperativa

Som Energia (“Somos energía” en catalán) es una cooperativa de energía verde sin ánimo de lucro, fundada en 2010 en Girona. Sus más de 80.000 socias y socios —que son a la vez propietarios y usuarios— producen y comercializan electricidad 100 % renovable.

El modelo es sencillo y poderoso: cada socia aporta una cuota de capital (100 euros, recuperables si se da de baja), paga la electricidad que consume y participa en la gobernanza de la cooperativa según el principio de «una persona, un voto», independientemente del capital aportado. Los beneficios se reinvierten en nuevas instalaciones renovables: placas solares, parques eólicos, plantas de biogás.

Som Energia no es un caso aislado. Forma parte de un movimiento europeo de comunidades energéticas que está reconfigurando el sector eléctrico desde abajo. La Directiva Europea de Energías Renovables (2018/2001) reconoce explícitamente el derecho de la ciudadanía a producir, consumir, almacenar y vender su propia energía renovable. En Alemania, las cooperativas energéticas representan casi el 40 % de la capacidad renovable instalada. En Dinamarca, cooperativas ciudadanas fueron las pioneras de la energía eólica en los años 80.

Lo que Som Energia demuestra es que el modelo cooperativo funciona incluso en sectores intensivos en capital como la energía. Y que la transición energética no tiene por qué significar simplemente sustituir a Repsol por Tesla: puede significar que la energía sea un bien común, gestionado democráticamente por quienes la consumen.

El patrón: por qué funcionan

Estos cinco casos son muy diferentes entre sí: software, conocimiento, telecomunicaciones, democracia digital, energía. Pero comparten una estructura común que explica su éxito:

1. Gobernanza comunitaria con reglas claras. Todos aplican, de forma más o menos explícita, los principios de Ostrom: normas de acceso y uso definidas colectivamente, mecanismos de resolución de conflictos, capacidad de los usuarios para participar en las decisiones y sanciones para quienes incumplen.

2. Código abierto o infraestructura abierta. La transparencia técnica es condición necesaria para la soberanía tecnológica. Si no puedes ver cómo funciona un sistema, no puedes gobernarlo. Linux, Wikipedia, Decidim y guifi.net son radicalmente transparentes. Som Energia lo es en su gobernanza económica.

3. Federación, no centralización. Ninguno de estos proyectos funciona con una estructura jerárquica centralizada. Linux se desarrolla de forma distribuida entre miles de colaboradores. Wikipedia tiene ediciones independientes por idioma. guifi.net es una red de redes locales. Decidim se despliega como instancias autónomas. Som Energia es una cooperativa con grupos locales. Esta estructura federada es lo que les da resiliencia: no tienen un punto único de fallo.

4. Motivación no exclusivamente económica. Las personas que contribuyen a estos proyectos lo hacen por razones diversas: aprendizaje, reputación profesional, compromiso político, sentido de comunidad, satisfacción intrínseca. Esto no significa que sean «gratis» (todos necesitan financiación), sino que su motor principal no es la maximización del beneficio privado, y eso los hace más robustos ante las presiones del mercado.

5. Escala demostrada. No son prototipos ni utopías. Linux sostiene el 96 % de la web mundial. Wikipedia es la quinta web más visitada del planeta. guifi.net tiene más nodos que muchas operadoras comerciales regionales. Decidim lo usan más de 400 instituciones. Som Energia tiene 80.000 socios (y nacida Gerona tiene grupos locales de socios en Granada, Costa Granadina, Sevilla, Málaga). Funcionan a escala real, con usuarios reales, durante años o décadas.

Lo que falta: la brecha entre lo posible y lo real

Si estas alternativas existen, funcionan y son escalables, ¿por qué no son hegemónicas? ¿Por qué la mayoría de la población sigue usando Windows, buscando en Google, comunicándose por WhatsApp y comprando electricidad a Iberdrola?

La respuesta no es técnica. Es política y cultural.

Primero, hay un problema de poder económico. Las grandes corporaciones tecnológicas invierten miles de millones en crear ecosistemas cerrados que generan dependencia (lock-in): si usas Gmail, es más fácil usar Google Drive, que te lleva a Google Docs, que te lleva a Android, que te lleva a Google Play. Migrar de un ecosistema corporativo a alternativas libres tiene costes de transición reales, aunque sean temporales.

Segundo, hay un problema de desconocimiento. La inmensa mayoría de la población no sabe que Linux existe, no sabe que guifi.net es posible, no sabe que puede ser socia de una cooperativa energética. Y no lo sabe porque el sistema educativo no se lo ha enseñado.

Y aquí llegamos al argumento central de este artículo.

La educación como infraestructura de transformación

Si los comunes digitales demuestran que otro modelo tecnológico es posible, la pregunta inmediata es cómo hacer que esa posibilidad se convierta en realidad amplia. Y la respuesta, aunque no sea la más espectacular, es probablemente la más sólida: educación.

No hablo de educación como eslogan vacío. Hablo de cambios concretos en lo que enseñamos, cómo lo enseñamos y para qué lo enseñamos.

Primero: alfabetización tecnológica real, no instrumental. En la mayoría de los colegios e institutos, la «competencia digital» se reduce a saber usar procesadores de texto, hojas de cálculo y presentaciones —es decir, a saber usar los productos de Microsoft o Google—. Esto no es alfabetización tecnológica; es adiestramiento como consumidores. Una alfabetización tecnológica real incluiría entender qué es el software libre y por qué importa, saber qué hace una aplicación con tus datos, conocer alternativas a las plataformas corporativas y tener nociones básicas de cómo funciona internet (no para ser ingenieros, sino para ser ciudadanos informados, igual que enseñamos biología sin pretender que todos sean médicos).

Segundo: enseñar cooperación, no solo competición. Nuestro sistema educativo sigue estructurado, en gran medida, alrededor de la evaluación individual y la competencia entre estudiantes. Pero los cinco ejemplos que hemos visto —Linux, Wikipedia, guifi.net, Decidim, Som Energia— son logros colectivos. Nadie construyó Linux solo. Nadie escribió Wikipedia solo. Si queremos que las personas sean capaces de construir y sostener comunes, necesitamos que desde la escuela practiquen la colaboración, la deliberación, la toma de decisiones colectiva y la gestión de conflictos. No como contenido teórico, sino como método pedagógico.

Tercero: enseñar gobernanza de lo común. Los principios de Ostrom —cómo se gestiona un recurso compartido sin que se destruya ni se privatice— deberían ser parte de la formación básica de cualquier ciudadana, igual que lo son las nociones de democracia representativa. Si una comunidad de adolescentes puede gestionar un huerto escolar con reglas acordadas colectivamente, está aprendiendo los mismos principios que permiten que funcione guifi.net o Wikipedia. No hace falta esperar a la universidad para entender qué es un bien común y cómo se cuida.

Cuarto: hacer visibles las alternativas. Uno de los efectos más perversos del oligopolio tecnológico es la invisibilización de las alternativas. Cuando un niño de 12 años cree que «internet» es sinónimo de Google y que «comunicarse» es sinónimo de WhatsApp, el problema no es tecnológico: es de imaginación política. Las escuelas podrían usar software libre en sus aulas. Podrían contribuir a Wikipedia como ejercicio educativo. Podrían tener sus propias instancias de Decidim para tomar decisiones escolares. No como gesto testimonial, sino como práctica que demuestra que otro modo de hacer es real.

Reflexión final: la fuerza social necesaria

Los cinco ejemplos que hemos recorrido en este artículo son la prueba de algo que a menudo se descarta como ingenuo: que la cooperación voluntaria entre personas libres, organizada con reglas claras y tecnología abierta, puede producir resultados que igualan o superan a los del capital concentrado y a los de la burocracia estatal.

Linux no necesitó un oligopolio para convertirse en el sistema operativo dominante del planeta. Wikipedia no necesitó un consejo de administración para reunir todo el conocimiento humano. guifi.net no necesitó a Telefónica para llevar internet a zonas rurales. Decidim no necesitó a Facebook para crear espacios de deliberación democrática. Som Energia no necesitó a Iberdrola para generar electricidad limpia.

Si se ha podido con el software, con el conocimiento, con las telecomunicaciones, con la democracia digital y con la energía, ¿por qué no con la alimentación, la vivienda, la salud, el transporte, la educación?

La respuesta honesta es: se puede, pero no se podrá sin una masa crítica de personas que sepan que es posible, que entiendan cómo funciona y que estén dispuestas a sostenerlo. Y esa masa crítica no surge espontáneamente. Se construye. Se construye con educación, desde las etapas más tempranas, que enseñe a cooperar y no solo a competir; que muestre alternativas y no solo productos; que forme ciudadanas y no solo consumidores.

No estamos hablando de una revolución violenta. Estamos hablando de algo más profundo y más lento: una transformación cultural que cambie las condiciones de posibilidad. Los comunes digitales ya han demostrado que funciona. Lo que necesitan ahora no es más tecnología, sino más personas que sepan construirlos, usarlos y defenderlos.

El filósofo anarquista Piotr Kropotkin escribió en 1902, en El apoyo mutuo, que la cooperación —no la competencia— es el factor decisivo en la evolución de las especies más exitosas. Más de un siglo después, Linux, Wikipedia, guifi.net, Decidim y Som Energia le dan la razón con datos, código y fibra óptica.

La pregunta ya no es si las alternativas son posibles. La pregunta es si seremos capaces de educar a las generaciones que las conviertan en norma.

El artículo y el autor

Este artículo se basa en el paper académico «Peaceful Anarcho-Accelerationism: Decentralized Full Automation for a Society of Universal Care» (Garrido-Merchán, 2026), disponible en acceso abierto.

Eduardo C. Garrido-Merchán es investigador en Inteligencia Artificial y profesor en la Universidad Pontificia Comillas (ICAI). Su investigación explora la intersección entre tecnología, ética y transformación social.

|

🖌La batalla decisiva para la fase final de la Guerra Total ha comenzado: Objetivo Irán |

A pesar de los esfuerzos de Google para eliminarlo desde 2013, el formato RSS sigue siendo un componente esencial de una web abierta e independiente, todavía en uso generalizado tanto en el lado del servidor como del cliente: se estima que hay más de 500 millones de sitios web que usan

A pesar de los esfuerzos de Google para eliminarlo desde 2013, el formato RSS sigue siendo un componente esencial de una web abierta e independiente, todavía en uso generalizado tanto en el lado del servidor como del cliente: se estima que hay más de 500 millones de sitios web que usan

La identidad visual fue hecha por

La identidad visual fue hecha por