Shell-History

Wer mit einer Shell unter Linux arbeitet, weiss schnell die History-Funktion zu schätzen. Statt Befehle immer wieder einzutippen, verwendet man die Pfeiltaste, um alte Befehle zurück zu holen oder man wiederholt Befehle aus der History mit «!<Befehlsnummer>». Auch die Kombination history | grep Suchstring kommt sicher vielen bekannt vor.

In diesem Blogbeitrag stelle ich eine bessere und mächtigere Variante vor, mit der Shell-History zu arbeiten, indem man das Werkzeug Atuin verwendet.

Was ist Atuin

Auf der Webseite mit der Dokumentation wird Atuin wie folgt beschrieben:

Atuin replaces your existing shell history with a SQLite database, and records additional context for your commands. With this context, Atuin gives you faster and better search of your shell history.

Additionally, Atuin (optionally) syncs your shell history between all of your machines. Fully end-to-end encrypted, of course.

Atuin ist ein Ersatz der Shell-History durch eine Datenbank, der nützliche Erweiterungen und, wenn das gewünscht wird, sogar die Synchronisation der Shell-History über mehrere Systeme hinweg bietet.

Atuin ist OpenSource-Software und wird nur durch Sponsoren unterstützt. Die Entwicklerinnen sind froh um Unterstützung.

Unterstützte Shells

Atuin unterstützt die folgenden Shell-Varianten:

- zsh

- bash

- fish

- nushell

- xonsh

Weiterentwicklung

Im Zusammenhang mit Atuin werden inzwischen auch Werkzeuge entwickelt, mit denen Shell-Konfigurationsfiles zwischen Rechnern synchronisiert werden können, um Umgebungsvariablen und Aliases konsistent auf verschiedenen Rechnern verwenden zu können. (Siehe: https://docs.atuin.sh/guide/dotfiles/)

Ein weiteres Werkzeug ist Atuin Desktop, das Dokumentation und ausführbare Programmsequenzen zusammenbringen will. (Siehe: https://github.com/atuinsh/desktop)

Installation

Für die Installation von Atuin gibt es ein Skript, das mit folgendem Befehl heruntergeladen und ausgeführt werden kann:

curl --proto '=https' --tlsv1.2 -LsSf https://setup.atuin.sh | sh

Das Kommando ergänzt z.B. die Konfigurationsdatei .bashrc für bash mit dem Befehl

eval "$(atuin init bash)"

zum Start des Initialisierungs-Skripts von Atuin beim Starten der bash-Shell. Die Pfadvariable sollte in .bashrc mit dem atuin-Befehl ergänzt werden:

PATH="$PATH:~/.atuin/bin"

Es wird empfohlen, für die bash-Shell auch ble.sh zu installieren.

ble.sh ist ein bash-Shell Zeileneditor, der Syntax-Highlighting (auch mit Farben), Kommandovervollständigung, einen vim-Editiermodus und weitere Features bietet. Atuin kann ihn für die Kommandovervollständigung und die farbige Darstellung von Befehlen brauchen. Der aktuelle Buildstand von ble.sh kann mit folgendem Befehl (alles auf einer Zeile) installiert werden:

curl -L https://github.com/akinomyoga/ble.sh/releases/download/nightly/ble-nightly.tar.xz | tar xJf -bash ble-nightly/ble.sh --install ~/.local/share

In .bashrc sollte ble.sh vor dem Start von Atuin mit folgender Zeile auch gleich gestartet werden:

source -- ~/.local/share/blesh/ble.sh

Bestehende Kommandhistorie

Atuin kann nach der Installation die bestehende Shell-Kommandhistorie importieren und dann wie jene neuer Kommandos verwenden. Der Import geschieht mit folgendem Kommando:

atuin import auto

Hier noch die Dokumentation des Import-Befehls:

$ atuin help import

Import shell history from file

Usage: atuin import <COMMAND>

Commands:

auto Import history for the current shell

zsh Import history from the zsh history file

zsh-hist-db Import history from the zsh history file

bash Import history from the bash history file

replxx Import history from the replxx history file

resh Import history from the resh history file

fish Import history from the fish history file

nu Import history from the nu history file

nu-hist-db Import history from the nu history file

xonsh Import history from xonsh json files

xonsh-sqlite Import history from xonsh sqlite db

help Print this message or the help of the given subcommand(s)Verwendung und gespeicherte Daten

Atuin kann via Konfigurationsdateien den eigenen Bedürfnissen angepasst werden. Die Angaben hier beziehen sich auf die Defaultkonfiguration nach der Installation von Atuin in der bash-Shell.

Während der Verwendung der Shell speichert Atuin in der Datenbank die folgenden Angaben, die dann in Atuin gebraucht werden können (siehe: https://docs.atuin.sh/guide/basic-usage/):

- verwendetes Kommando

- Verzeichnis, in dem das Kommando aufgerufen wurde

- Zeitpunkt des Kommandoaufrufs und die Ausführungszeit

- Returnwert des Kommandos

- Host- und Usernamen

- Shell-Session, in der das Kommando aufgerufen wurde

TUI, Terminal User Interface

Mit der Pfeiltaste gegen oben oder mit <ctrl><r> kann das User Interface gestartet werden. Hier ein Screenshot als Beispiel:

Zuoberst sieht man auch gleich die wichtigsten Shortcuts:

<esc>um Atuin zu verlassen<tab>um den Befehl auf die Kommandozeile zu holen, um ihn dort anzupassen<enter>um den Befehl direkt auszuführen

Mit der Pfeiltaste nach oben oder unten kann man durch die Befehle navigieren.

Mit <ctrl><R> kann man den Scope wechseln zwischen [GLOBAL] wie im Screenshot und [HOST], [SESSION] oder [DIRECTORY]. Es werden dann jeweils alle Befehle aus der History oder nur jene von demselben Host, jene aus der aktuellen Session oder jene, die im aktuellen Verzeichnis aufgerufen wurden, angezeigt.

<ctrl><o> öffnet den ‹Inspektor›. Mit dem Inspektor kann man die Angaben, die zum aktuellen Befehl gespeichert sind, anschauen und auch den entsprechenden Eintrag aus der Atuin-Datenbank löschen.

<Alt><#>, wobei # für die Nummer (1 bis 9) des Befehls in der Liste steht, ruft den Befehl mit dieser Nummer auf.

Wenn man einfach beginnt zu tippen, so wird in der History mit einer ‹fuzzy›-Suche nach dem eingetippten Text gesucht und es werden die gefundenen Befehle angezeigt.

Mit <ctrl><s> kann man zwischen den verschiedenen Suchmodi PREFIX, FULLTEXT und FUZZY wechseln. PREFIX würde im Beispiel kein Resultat liefern, FULLTEXT nur die untersten Befehle, bei denen der Suchtext rot umrandet ist und FUZZY hilft meist auch dann, wenn man den genauen Befehl nicht mehr weiss.

Shortcuts

Die Default-Shortcuts werden in der Dokumentation wie folgt beschrieben:

| Shortcut | Action |

| enter | Execute selected item |

| tab | Select item and edit |

| ctrl + r | Cycle through filter modes |

| ctrl + s | Cycle through search modes |

| alt + 1 to alt + 9 | Select item by the number located near it |

| ctrl + c / ctrl + d / ctrl + g / esc | Return original |

| ctrl + y | Copy selected item to clipboard |

ctrl +  / alt + b / alt + b | Move the cursor to the previous word |

ctrl +  / alt + f / alt + f | Move the cursor to the next word |

ctrl + b /  | Move the cursor to the left |

ctrl + f /  | Move the cursor to the right |

| ctrl + a / home | Move the cursor to the start of the line |

| ctrl + e / end | Move the cursor to the end of the line |

| ctrl + backspace / ctrl + alt + backspace | Remove the previous word / remove the word just before the cursor |

| ctrl + delete / ctrl + alt + delete | Remove the next word or the word just after the cursor |

| ctrl + w | Remove the word before the cursor even if it spans across the word boundaries |

| ctrl + u | Clear the current line |

ctrl + n / ctrl + j /  | Select the next item on the list |

ctrl + p / ctrl + k /  | Select the previous item on the list |

| ctrl + o | Open the inspector |

| page down | Scroll search results one page down |

| page up | Scroll search results one page up |

(with no entry selected) (with no entry selected) | Return original or return query depending on settings |

| Select the next item on the list |

Suche

Atuin bietet viele Suchmöglichkeiten, um Befehle in der History zu finden. Ein kleines Beispiel ist die folgende Suche, die den ältesten sudo-Befehl aus der History anzeigt:

atuin search --limit 1 --reverse sudo

Die Suche in Atuin ist auf der Webseite wie folgt beschrieben:

Atuin search supports wildcards, with either the * or % character. By default, a prefix search is performed (ie, all queries are automatically appended with a wildcard).

| Arg | Description |

| –cwd/-c | The directory to list history for (default: all dirs) |

| –exclude-cwd | Do not include commands that ran in this directory (default: none) |

| –exit/-e | Filter by exit code (default: none) |

| –exclude-exit | Do not include commands that exited with this value (default: none) |

| –before | Only include commands ran before this time(default: none) |

| –after | Only include commands ran after this time(default: none) |

| –interactive/-i | Open the interactive search UI (default: false) |

| –human | Use human-readable formatting for the timestamp and duration (default: false) |

| –limit | Limit the number of results (default: none) |

| –offset | Offset from the start of the results (default: none) |

| –delete | Delete history matching this query |

| –delete-it-all | Delete all shell history |

| –reverse | Reverse order of search results, oldest first |

| –format/-f | Available variables: {command}, {directory}, {duration}, {user}, {host}, {time}, {exit} and {relativetime}. Example: —format “{time} – [{duration}] – {directory}$\t{command}“ |

| –inline-height | Set the maximum number of lines Atuin’s interface should take up |

| –help/-h | Print help |

Interessant ist die Möglichkeit, mit --exit oder --exclude-exit vergangene Kommandos mit einem bestimmten Exitcode oder beispielsweise jene, die nicht erfolgreich ausgeführt wurden

(--exclude-exit 0), zu suchen.

Statistik

Mit atuin stats bekommt man eine einfache Statistik zu den Befehlen in der History. Mit atuin history list werden die gespeicherten Befehle und Daten ausgegeben, wobei das Format der Ausgabe mit Parametern angepasst werden kann.

Update

Wenn Zugriff zum Internet besteht, so lässt sich ein Update ganz einfach mit folgendem Befehl durchführen:

atuin-update

Support

Für Fragen zu Atuin gibt es ein Forum: https://forum.atuin.sh/

Im Forum können auch Ideen für Weiterentwicklungen vorgeschlagen werden.

Synchronisation zwischen Rechnern

Es ist möglich, die History mit Atuin über Rechnergrenzen hinweg zu speichern und zu synchronisieren. Dazu braucht es für Atuin eine Datenbank auf einem Synchronisationsserver in der Cloud oder auf einem eigenen Rechner, die dann von verschiedenen Rechnern aus verwendet wird. Der Datentransport von und zur Datenbank wird dabei sicher verschlüsselt.

Auf die Details wird in diesem Blogbeitrag nicht eingegangen. Sie sind auf der Atuin-Webseite beschrieben: https://docs.atuin.sh/self-hosting/server-setup.

Fazit

Das OpenSource-Werkzeug Atuin bietet eine verbesserte und einfach zu bedienende Shell-History mit vielen Suchmöglichkeiten. Es ist schnell installiert und es kann bei Bedarf auch über Rechnergrenzen hinweg sicher verwendet werden. Ein rundum gelungenes kleines Werkzeug, das die Arbeit mit der Shell erleichtert.

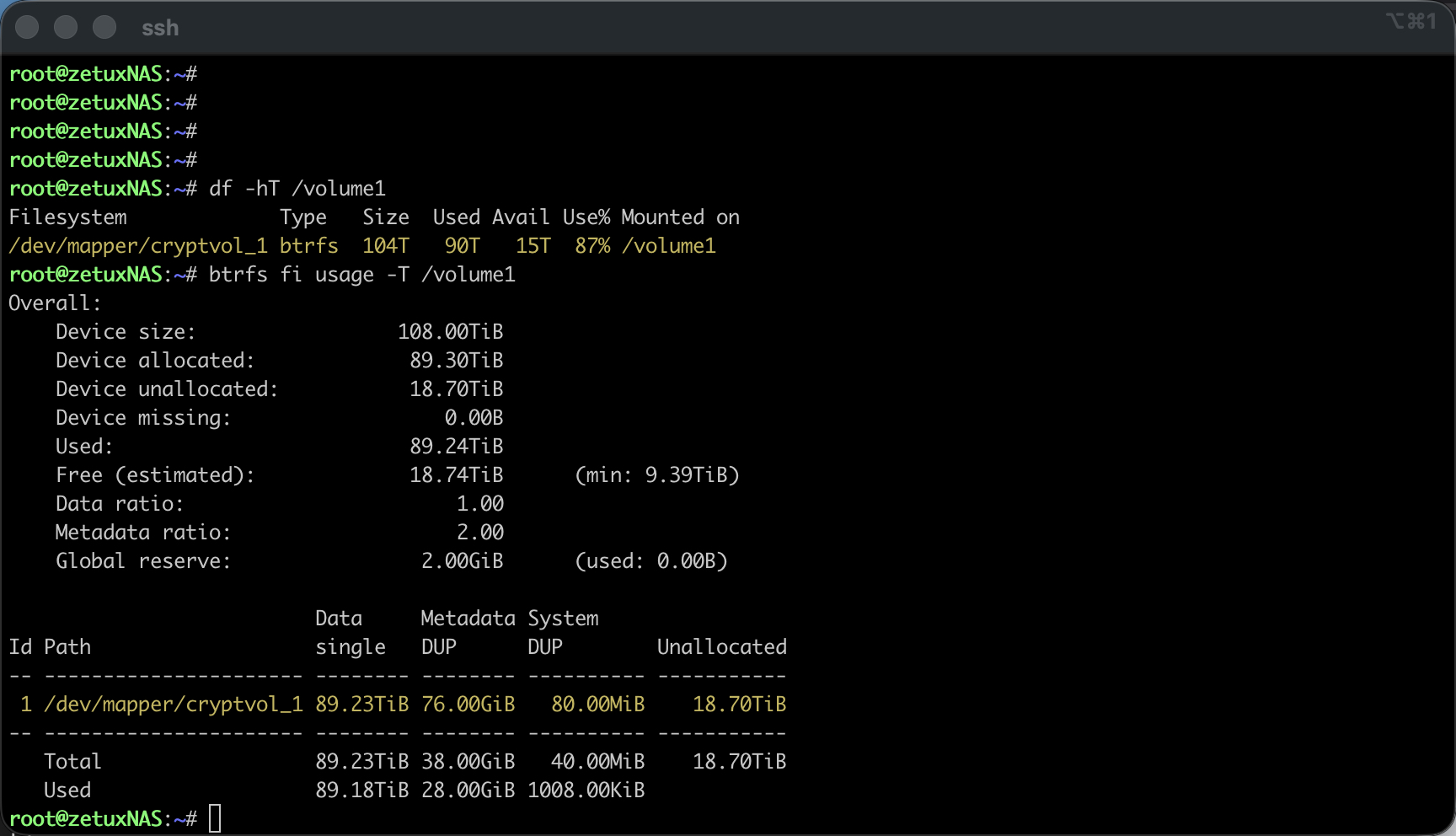

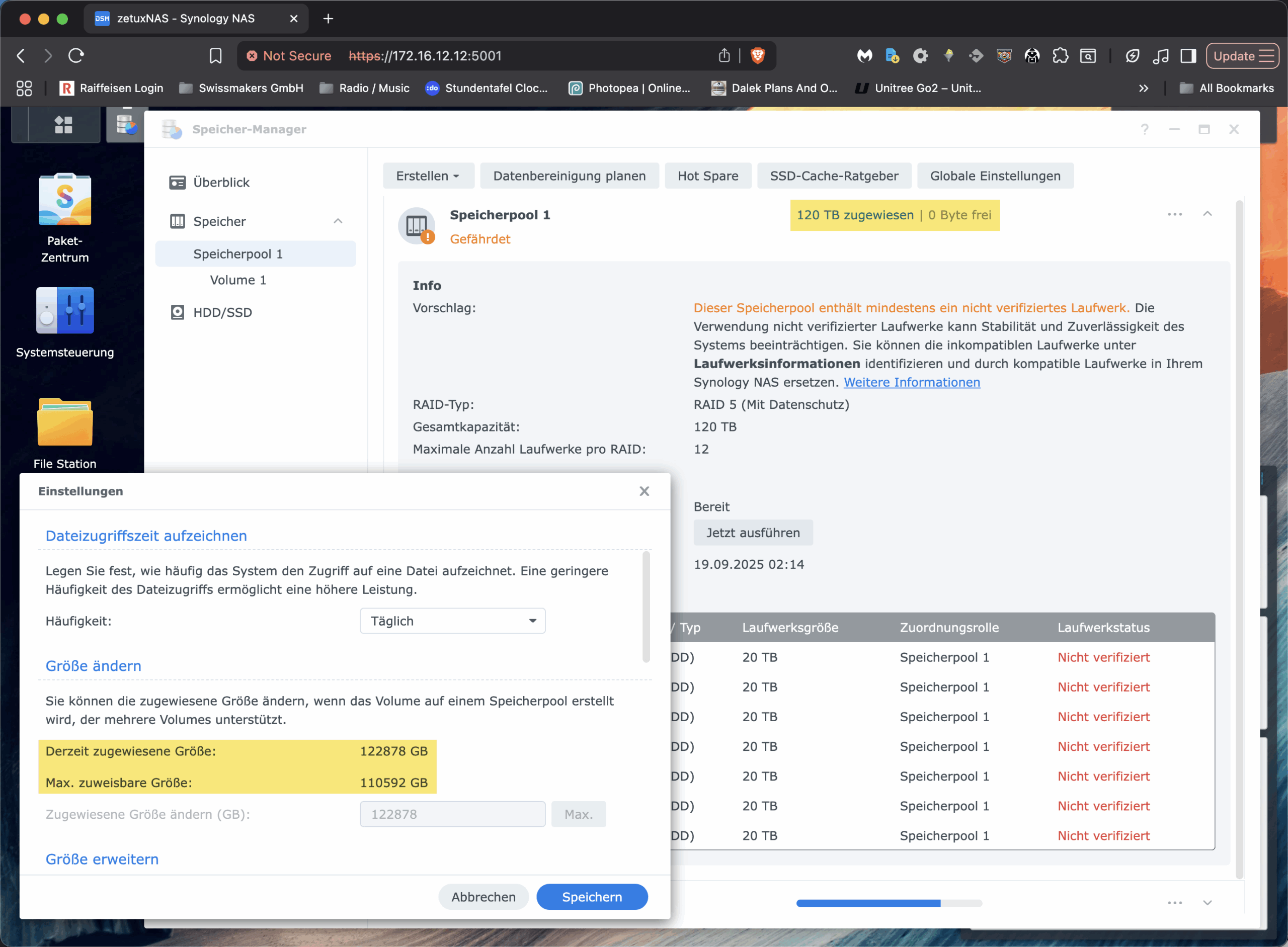

Vor dieser Frage stand ich kürzlich, als wir bei einer unserer Installationen von Swissmakers vor einem vertrauten, aber irritierenden Phänomen standen: Ein Synology-NAS mit sieben 22-TB-HDDs im RAID-5 zeigte im Speicherpool korrekt rund «120 TB» an (1), liess aber das vorhandene Volume partout nicht über ca. 108 TB vergrössern (2/3). Die Oberfläche bot keine Option, obwohl der Pool noch freie Kapazität hatte. Für alle, die ähnliches beobachten und in dem GUI gegen eine unsichtbare Decke laufen: Das ist kein technologisches Limit von Btrfs oder LVM und hat auch nichts mit der RAM-Bestückung zu tun. Es ist eine modellabhängige Software-Schranke in der DSM-Oberfläche. In diesem Beitrag zeige ich, warum das so ist und wie man das Synology Volume trotzdem sauber und online per CLI über diese Grenze hinaus erweitert.

Die Fakten

Beginnen wir mit den Zahlen. Festplattenhersteller rechnen dezimal: 1 TB sind 10¹² Byte. Betriebssysteme und auch das DSM rechnen binär: 1 TiB sind 2⁴⁰ Byte. Eine 22-TB-Platte entspricht also real etwa 20,0 TiB. Sieben dieser Laufwerke in RAID-5 ergeben brutto ungefähr 140 TiB; eine Platte fällt für Parität weg, netto bleiben rund 120 TiB im Pool. An dieser Stelle ist noch alles stimmig. Der Stolperstein entsteht später, auf der Ebene des Volumes.

Synology organisiert sein System so: Zuunterst läuft ein mdadm-RAID, darauf liegt ein LVM mit einer Volume Group (bei vielen Geräten „vg1“ genannt), und darauf wiederum das eigentliche Dateisystem, in unserem Fall Btrfs. DSM trennt bewusst zwischen Speicherpool und Volume. Der Pool repräsentiert die physische Kapazität des RAID-Sets; Volumes sind LVM-Logical-Volumes, denen man via GUI Kapazität aus dem Pool zuweist. Und genau hier besitzt DSM eine modellabhängige Obergrenze für die Grösse eines einzelnen Volumes, die bei zahlreichen Plus-Modellen und anderen Modellen bei 108 TiB liegt. Das ist keine technische Notwendigkeit von LVM oder Btrfs, sondern eine durch Synology bewusst platzierte Software-Schranke in der Oberfläche. Der Beleg dafür ist trivial: Der Pool zeigt freie Extents und LVM kann sie an das bestehende LV hängen; danach lässt sich das Btrfs online resizen, vollständig ohne Umformatieren, Downtime oder sonstige «magische» Schritte.

Btrfs selbst ist in dieser Konstellation nicht der limitierende Faktor. Das Dateisystem unterstützt Online-Resize, ist chunk-basiert aufgebaut und verwaltet Daten und Metadaten in getrennten Bereichen. Es skaliert auf Kapazitäten weit oberhalb dessen, was eine 7-Bay-Konfiguration überhaupt liefern kann. Auch die block-device-Geschichte ist mit LVM unkritisch: Solange die VG freie Extents hat, lässt sich das LV vergrössern. Weder die CPU-Architektur eines Plus-Modells noch die RAM-Ausstattung bestimmen hart die maximal adressierbare Grösse eines Btrfs-Volumes. Mehr RAM hilft Caches und damit der Performance, aber es ändert nichts an den Adressbreiten der beteiligten Schichten. Wer also in der DSM-Maske bei «Max. zuweisbare Grösse 110 592 GB» hängenbleibt, stösst auf eine UI-Einschränkung, nicht aber auf eine technisch bedingte Grenze.

Die Lösung dazu

Die Lösung liegt im Werkzeugkasten, den wir als Linux-Ingenieure ohnehin täglich benutzen: Wir erweitern das Logical Volume mit LVM und ziehen das Btrfs anschliessend nach. Dabei bleibt das System im Betrieb; Services, Freigaben und NFS/SMB-Clients arbeiten weiter. Der Ablauf ist bei jedem UNIX-basierten System, welches LVM einsetzt, gleich: zunächst den Ist-Zustand zweifelsfrei verifizieren, das LV vergrössern, und zum Schluss das Dateisystem auf 100% der Grösse des LVs resizen. Ich werden gleich die konkreten Kommandos alle niederschreiben, damit man die einzelnen Schritte direkt auch in die eigene Umgebung durchführen kann.

Zuerst wähle ich den sicheren Einstieg per SSH und eskaliere auf root (Wie das genau gemacht werden kann, wurde bereits hier beschrieben: Link). Danach prüfe ich die beteiligten Storage-Schichten.# df -hT /volume1 bestätigt das Dateisystem und den Mountpunkt, # mount | grep volume1 zeigt die tatsächliche Gerätedatei, die bei Synology in der Regel bei verschlüsselten Volumen über den Mapper als /dev/mapper/cryptvol_1 eingebunden ist. Mit # vgs -o vg_name,vg_size,vg_free,# lvs -o lv_name,vg_name,lv_size,lv_path und # pvs -o pv_name,vg_name,pv_size,pv_free verschaffe ich mir Klarheit, wie die Volume Group heisst, welche Logical Volumes existieren und wie viele freie Extents im Pool tatsächlich anliegen. An dieser Stelle sollte «VFree» eine Grössenordnung um die in der GUI angezeigten 12 TB, «12.00t» frei zeigen; entscheidend ist ausserdem der exakte lv_path, meist /dev/vg1/volume_1.

Ist die Ausgangslage eindeutig, kann das LV erweitert werden. Dazu genügt ein einzelner Aufruf, der alle freien Extents der VG an das Ziel-LV hängt. Mit einer Pfadangabe aus der lvs-Ausgabe sieht das so aus:

lvextend -l +100%FREE /dev/vg1/volume_1Die Option -l arbeitet mit Extents und ist in dieser Situation robuster als eine genaue Grössenangabe in Bytes; sie konsumiert in Kombination mit 100% exakt den freien Bereich der VG, unabhängig von Rundungen. Ein unmittelbar folgendes # lvs -o lv_name,lv_size,lv_path zeigt die neue LV-Grösse. Bis hierher hat sich am Dateisystem noch nichts geändert, wir haben lediglich die Blockdevice-Schicht erweitert.

Reboot (Empfohlen)

Ein Reboot ist nicht in allen Fällen nötig, jedoch falls das Volume1 zusätzlich verschlüsselt wurde, oder das Synology den Einbau eines Caches unterstützt, so muss noch vor dem btrfs resize das dm-crypt/LUKS-Device (cryptvol_1) als sowohl das darunter liegende cachedev_0 auf die neue LV-Grösse vergrössert werden. Eine kurze Kontrolle erfolgt anhand: # dmsetup ls --tree

Wird eines oder beide der genannten virtuellen Devices angezeigt, so empfielt sich ein reboot. Um cachedev_0 als sowohl cryptvol_1 alternativ online zu vergrössern kann folgendermassen vorgegangen werden: (Ohne Reboot – jedoch nicht ohne Risiko)

# Aktuelle Sektorgrösse von cachedev_0 abfragen:

dmsetup table --showkeys cachedev_0

# Neue Sektorgrösse vom LV holen:

SECTORS=$(blockdev --getsz /dev/vg1/volume_1)

# cachedev_0 suspenden, cachedev_0 Table mit neuer Länge reloaden und reaktivieren:

dmsetup suspend cachedev_0

dmsetup table --showkeys cachedev_0 \

| sed '/^Size Hist:/,$d' \

| awk -v S="$SECTORS" 'NR==1{$2=S} {print}' OFS=" " \

| dmsetup reload cachedev_0 --table -

dmsetup resume cachedev_0

# Falls vorhanden LUKS/dm-crypt auf neue Grösse von cachedev_0 resizen:

cryptsetup resize cryptvol_1

# Prüfen ob cachedev_0 (und cryptvol_1) erfolgreich resized wurden:

dmsetup table --showkeys cachedev_0

blockdev --getsize64 /dev/mapper/cryptvol_1Resize des Filesystems

Nach dem Reboot oder dem manuellen resize des cachedev_0 sowie anfälligem cryptvol_1, informiere ich jetzt das Btrfs über den zusätzlichen Platz. Das funktioniert online über den Mountpoint. Wer die maximale verfügbare Grösse auch im FS nutzen möchte, nimmt die bequeme Variante:

btrfs filesystem resize max /volume1Alternativ lässt sich eine konkrete Differenz angeben, zum Beispiel +12t. Nach wenigen Augenblicken bestätigt # df -h /volume1 die gewachsene Kapazität, und # btrfs fi usage -T /volume1 zeigt den neuen freien Bereich auf der Ebene der Btrfs-Chunks. Der gesamte Vorgang läuft ohne Unterbrechung der Freigaben.

Je nach Füllstand lohnt sich anschliessend ein leichter Balance-Lauf, der nur stark belegte Chunks anfasst, um die Verteilung zu glätten, ohne das System unnötig zu beschäftigen:

btrfs balance start -dusage=5 -musage=5 /volume1

btrfs balance status /volume1Der Balance-Schritt ist optional; er sorgt dafür, dass zukünftige Allokationen nicht an Altlasten scheitern, z.B. wenn Daten und Metadaten ungleichmässig verteilt sind. Er ist gerade bei sehr grossen Dateisystemen mit langer Historie nützlich, in frischen Setups jedoch oft nicht nötig.

Zurück in der DSM-Oberfläche wird das Volume anschliessend mit der neuen, vollen Grösse angezeigt. Der Dialog «Grösse ändern» wird weiterhin die bekannte Obergrenze als «Max. zuweisbare Grösse» nennen; dies gilt jedoch lediglich für den DSM-Disk-Assistent. Künftige Erweiterungen laufen auf demselben Weg wieder über LVM und btrfs filesystem resize. Wer die Operation kontrolliert begleiten möchte, überwacht parallel # dmesg -w und die Btrfs-Statistiken, während die Änderung greift.

Ein Wort zur Sicherheit gehört in diesen Kontext: Auch wenn der Weg technisch sauber ist, bleibt er von Synology in dieser Form «nicht unterstützt». Für produktive Volumes gilt wie immer, dass ein aktuelles, getestetes Backup Voraussetzung ist. Das Verfahren verändert keine Dateninhalte, aber es operiert an verschiedenen Speicher Schichten, die für alles darüber verantwortlich sind. Wer mehrere Volumes im selben Pool betreibt, vergewissert sich vor dem Extend, dass er das richtige LV erwischt; die eindeutige lv_path-Prüfung vor dem eigentlichen Befehl ist der entscheidende Schutz gegen Vertipper.

Fazit

Der scheinbare Widerspruch zwischen freiem Speicher im Pool und einer starren Grenze beim Volume ist kein Indiz für ein Limit von Btrfs, LVM oder der Hardware und schon gar nicht eine Frage der RAM-Ausstattung. Es ist eine Hersteller- und GUI-seitige Schranke im DSM, die den Disk-Assistent limitiert, nicht die darunter liegende Technologie. Wer das versteht, kann ein bestehendes Volume online und ohne Downtime vergrössern, indem er das Logical Volume per lvextend erweitert und das Btrfs per btrfs filesystem resize nachzieht. Danach steht die Kapazität dort zur Verfügung, wo sie hingehört: im Dateisystem, dort wo die Daten gespeichert werden. Für mich ist das der pragmatischste Weg, mit dem sich grosse Pools auf allen Synology Geräten sinnvoll nutzen lassen, ohne dabei auf die künstliche 108-TiB-Deckelung hereinzufallen.

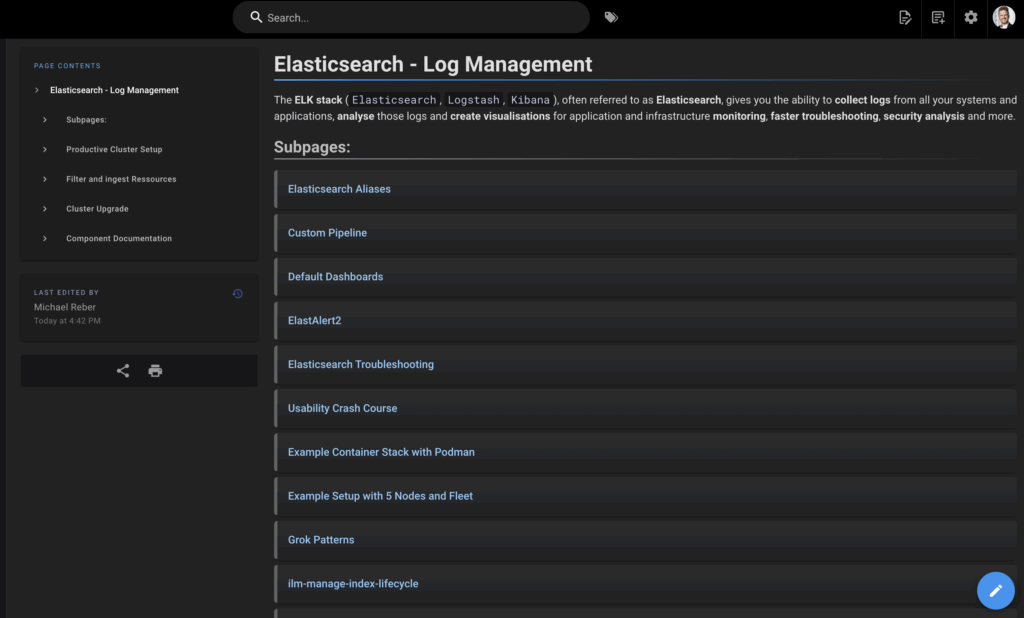

]]>Für Swissmakers GmbH war klar: Eine dynamische Landingpage, die sich ohne manuellen Aufwand aktualisiert, ist essenziell für konsistente Dokumentation und effizientes Auffinden von Informationen.

Warum Wiki.js das nicht von Haus aus mitliefert

Die Wiki.js-Version 2 basiert intern auf einem Vue.js Single-Page-Application-Ansatz. Alle Seiteninhalte werden clientseitig nachgeladen; serverseitig generierte Platzhalter wie „[children]“ (bekannt aus anderen Markdown-Plugins) existieren nicht. Das Entwicklerteam von Wiki.js hat zwar für Version 3 ein modulares Blocks-System angekündigt, doch für v2-Instanzen bleibt nur der Weg über die öffentliche GraphQL-API oder ein Upgrade. Letzteres ist jedoch im produktiven Umfeld definitiv nicht empfohlen da die v3 seit nun fast zwei Jahren lediglich als Alpha Version verfügbar ist und bis heute als «unstable» gilt. Zudem sind die meisten Features noch gar nicht oder nicht richtig implementiert.

Unsere Lösung: Ein leichtgewichtiger GraphQL-Client im Frontend

Um das Feature umzusetzen, haben wir ein JavaScript-Snippet entwickelt, das wir in jeder gewünschten Landingpage oder übergeordnete «Tech-Page» einbinden können. Der Code wird dabei in die jeweilige Seite unter den «Page Properties» im Tab «Script» eingefügt:

Der Code folgt beim Aufruf der jeweiligen Seite dem folgendem Ablauf:

- holt einmalig alle Seiten aus der GraphQL-API (Standartlimit bis 1000 gesetzt),

- filtert ausschliesslich jene, deren Pfad unterhalb des automatisch erkannten Seitenpfads liegt (also unterhalb der aktuell geöffneten Seite),

- entfernt die Landingpage selbst aus der Ausgabe,

- rendert das Ergebnis als übersichtliche Link-Liste mit dem bereits eingebauten

links-list-Styling von Wiki.js.

In der wiki-Seite selbst wird dann der gerenderte HTML-content innerhalb des<div id="pageTree">Loading pages …</div> mit dem generierten Menu ersetzt.

Die Page kann dabei beliebig gestaltet oder erweitert werden, wichtig ist nur, dass das erwähnte Div am gewünschten Ort innerhalb der Seite platziert wird, wo die dynamische Sub-Übersicht gewünscht ist.

JavaScript Code

Achtung: Für alle, die diese Seite auf Englisch lesen. Bitte kopiert den Code aus der deutschen Original-Seite. Unsere Deepl-Übersetzungsapp hat momentan einen Bug und löscht teils Code aus Codeblöcken oder Newlines heraus. Ein Bugreport ist erstellt. Besten Dank und Sorry für die Umstände.

<script>

(() => {

const debug = false; // auf true setzen, falls etwas nicht wie gewünscht funktioniert.

const MAX_ATTEMPTS = 30; // bis zu 30 × 200 ms auf #pageTree warten (timeout)

let attempts = 0;

const log = (...a) => debug && console.log(...a);

const warn = (...a) => debug && console.warn(...a);

const error = (...a) => debug && console.error(...a);

function init() {

const container = document.getElementById('pageTree');

if (!container) {

attempts++;

warn(`#pageTree not found, attempt ${attempts}`);

if (attempts < MAX_ATTEMPTS) return setTimeout(init, 200);

error('Gave up waiting for #pageTree');

return;

}

/** Pfad der aktuellen Seite ohne führenden Locale-Teil */

const selfPath = location.pathname

.replace(/^\/[^/]+\//, '') // z.B. /en/ entfernen

.replace(/^\/|\/$/g, ''); // führenden / und trailing / entfernen

/** Präfix, das alle childs gemeinsam haben (selfPath + "/") */

const childPrefix = selfPath.endsWith('/') ? selfPath : selfPath + '/';

log('[Wiki.js] selfPath:', selfPath);

log('[Wiki.js] childPrefix:', childPrefix);

const query = `

query {

pages {

list(limit: 1000, orderBy: PATH, orderByDirection: ASC) {

path

title

locale

}

}

}`;

fetch('/graphql', {

method: 'POST',

headers: { 'Content-Type': 'application/json' },

body: JSON.stringify({ query })

})

.then(r => r.json())

.then(({ data }) => {

if (!data?.pages?.list) {

container.textContent = 'API-Fehler: keine Seitendaten.';

error('pages.list fehlt im Response', data);

return;

}

const pages = data.pages.list

.filter(p => p.path.startsWith(childPrefix)) // nur echte Unterseiten

.filter(p => p.path !== selfPath); // Landingpage selbst soll raus

log('[Wiki.js] gefilterte Seiten:', pages);

if (!pages.length) {

container.textContent = 'Keine Unterseiten vorhanden.';

return;

}

const listHTML = pages.map(

p => `<li><a href="proxy.php?url=/${p.locale}/${p.path}">${p.title}</a></li>`

).join('');

container.innerHTML = `<ul class="links-list">${listHTML}</ul>`;

})

.catch(err => {

container.textContent = 'Fehler beim Laden der Seitenliste.';

error(err);

});

}

init();

})();

</script>Was passiert im Detail?

Nachfolgend haben wir für jene, die sich für JavaScript interessieren oder einfach genauer wissen möchten, was Zeile für Zeile genau passiert, das Ganze auf die einzelnen Zeilen aufgeschlüsselt. (Die Zeilennummern beziehen sich auf das komplette Snippet, inklusive <script>-Tag.)

| Zeile(n) | Code | Technische Erklärung |

|---|---|---|

| 1 | <script> | Öffnet einen HTML-Script-Block – der Browser interpretiert alles bis </script> als JavaScript. |

| 2 | (() => { | Start eines IIFE (Immediately Invoked Function Expression). Dadurch liegt der gesamte Code in einem eigenen Scope; globale Namenskollisionen werden vermieden. |

| 3 | const debug = true; | Schalter für ausführliche Konsolenausgabe. Bei false werden alle Log-Aufrufe unterdrückt. |

| 4 | const MAX_ATTEMPTS = 30; | Maximale Anzahl Wiederholungen beim Polling auf das DOM-Element. |

| 5 | let attempts = 0; | Zähler für die bereits erfolgten Polling-Versuche. |

| 7 – 9 | const log…warn…error… | Drei Arrow Functions, die jeweils nur dann auf console.* zugreifen, wenn debug aktiv ist. So spart man if-Blöcke in der Logik darunter. |

| 11 | function init() { | Hauptfunktion. Sie wird wiederholt aufgerufen, bis das Ziel-Element vorhanden ist. |

| 12 | const container = document.getElementById('pageTree'); | Sucht das DIV, in dem später die Linkliste gerendert wird. |

| 13 – 18 | if (!container) { … } | Polling-Logik: • Zähler erhöhen • Warnung loggen • Wenn attempts < MAX_ATTEMPTS, mit setTimeout(init, 200) nach 200 ms erneut prüfen.• Nach dem Limit Abbruch mit Fehlermeldung. |

| 22 – 24 | const selfPath = location.pathname.replace… | Ermittelt den Pfad der aktuellen Wiki-Seite, entfernt dabei: 1. die Sprachpräfix-Sektion (Regex ^\/[^\/]+\/)2. evtl. führenden bzw. abschliessenden Slash. |

| 27 | const childPrefix = selfPath.endsWith('/') ? selfPath : selfPath + '/'; | Stellt sicher, dass der Child-Präfix immer mit / endet. Beispiel: 07-internal-it/it-services/. |

| 29 – 30 | log('[Wiki.js] selfPath:' …) | Debug-Ausgabe des aktuellen Pfades und des sub-Präfixes. |

| 32 – 41 | const query = \…`;` | Template Literal mit GraphQL-Query. • pages.list liefert bis zu 1000 Seiten.• Sortiert nach Pfad, damit childs automatisch gruppiert sind. |

| 43 – 47 | fetch('/graphql', { … }) | Stellt einen HTTP-POST an den Wiki.js-GraphQL-Endpunkt. Header Content-Type: application/json ist Pflicht. |

| 48 | }).then(r => r.json()) | Erster Promise-Schritt: Die Antwort wird per Response.json() geparst. |

| 49 | .then(({ data }) => { | Zweiter Promise-Schritt: ES6-Destrukturierung, um data sofort herauszuziehen. |

| 50 – 54 | if (!data?.pages?.list) { … } | Prüfung auf Existenz der erwarteten Struktur unter Nutzung von Optional Chaining (?.). Bei Fehler: Meldung für den Benutzer und Logging. |

| 56 – 58 | const pages = data.pages.list.filter… | Zweistufiger Filter: 1. startsWith(childPrefix) → nur echte Unterseiten2. !== selfPath → eigene Seite ausschliessen. |

| 60 | log('[Wiki.js] gefilterte Seiten:', pages); | Debug-Ausgabe des Ergebnisses nach dem Filter. |

| 62 – 65 | if (!pages.length) { … } | Fehlermeldung, falls keine Unterseiten existieren (z. B. nach Migration). |

| 67 – 69 | const listHTML = pages.map(p => `<li>…`).join(''); | Baut für jede Unterseite ein <li><a …></a></li> und verbindet alles zu einem HTML-String. |

| 71 | container.innerHTML = \<ul class=»links-list»>${listHTML}</ul>`;` | Rendert die Linkliste. Die Klasse links-list sorgt für das card-artige Styling, das Wiki.js mitliefert. |

| 73 – 76 | .catch(err => { … }) | Fehlerbehandlung der Fetch-Kette. Zeigt nutzerfreundliche Meldung und loggt das Exception-Objekt. |

| 79 | init(); | Erster Aufruf der Init-Funktion – löst das Polling aus. |

| 80 | })(); | Schliesst das IIFE und ruft es sofort auf. |

| 81 | </script> | Ende des Script-Blocks. |

Kleiner Zusatz: Alphabetisches Sortieren nach «Page-Titel» anstatt Pfad

Im Standard GraphQL-Respond sind die jeweiligen Pages nach dem Pfad (PATH URL) sortiert. Diese kann sich aber vom eigentlichen Titel unterscheiden und so kann es auch Sinn machen, die Seiten nach ihrem Titel alphabetisch zu sortieren.

Dafür wird im JavaScript-Code noch vor dem Rendern der Liste const listHTML = pages.map (Zeile 67) das Array der Seiten mit der Funktion sort() und localeCompare() nachsortiert. Der benötigte Code sieht so aus:

pages.sort((a, b) => a.title.localeCompare(b.title));Die nötige Änderung, respektive Ergänzung im Code müsste also wie folgt aussehen:

pages.sort((a, b) => a.title.localeCompare(b.title));

const listHTML = pages.map(

p => `<li><a href="proxy.php?url=/${p.locale}/${p.path}">${p.title}</a></li>`

).join('');Praxiserfahrungen nach der Integration

Nach wenigen Minuten ist das Snippet in mehreren Bereichen aktiv. Seitdem

- erscheinen neue Dokumente sofort in der Übersicht,

- entfällt die manuelle Pflege der Landingpages / Subpages Übersicht,

- bleibt die Navigation auch bei tiefen Verschachtelungen konsistent.

Gleichzeitig ist das Skript so schlank, dass es künftige Migrationen bis v3 (sollte diese Version dann doch noch irgendwann erscheinen) nicht behindert. Bis dahin sichert es die Funktionsfähigkeit unseres Wikis mit minimalem Aufwand.

Der folgende Screenshot zeigt ein Beispiel, bei dem eine alphabetische Sortierung nach dem Page-Namen mehr Sinn machen würde.

Fazit

Ein fehlendes Kernfeature muss nicht zwangsläufig auf das nächste Major-Upgrade warten. Mit einem präzisen Blick in die GraphQL-API und wenigen Zeilen JavaScript konnten wir unsere Dokumentationsqualität deutlich erhöhen. Wer ebenfalls auf Wiki.js v2 setzt, kann das Snippet ohne weitere Abhängigkeiten übernehmen. Fragen oder Verbesserungsvorschläge bitte an [email protected], wir tauschen uns gerne aus. Für Unterstützung bei der Installation und Konfiguration von Wiki.js kontaktieren Sie uns ungeniert für ein Beratungsgespräch.

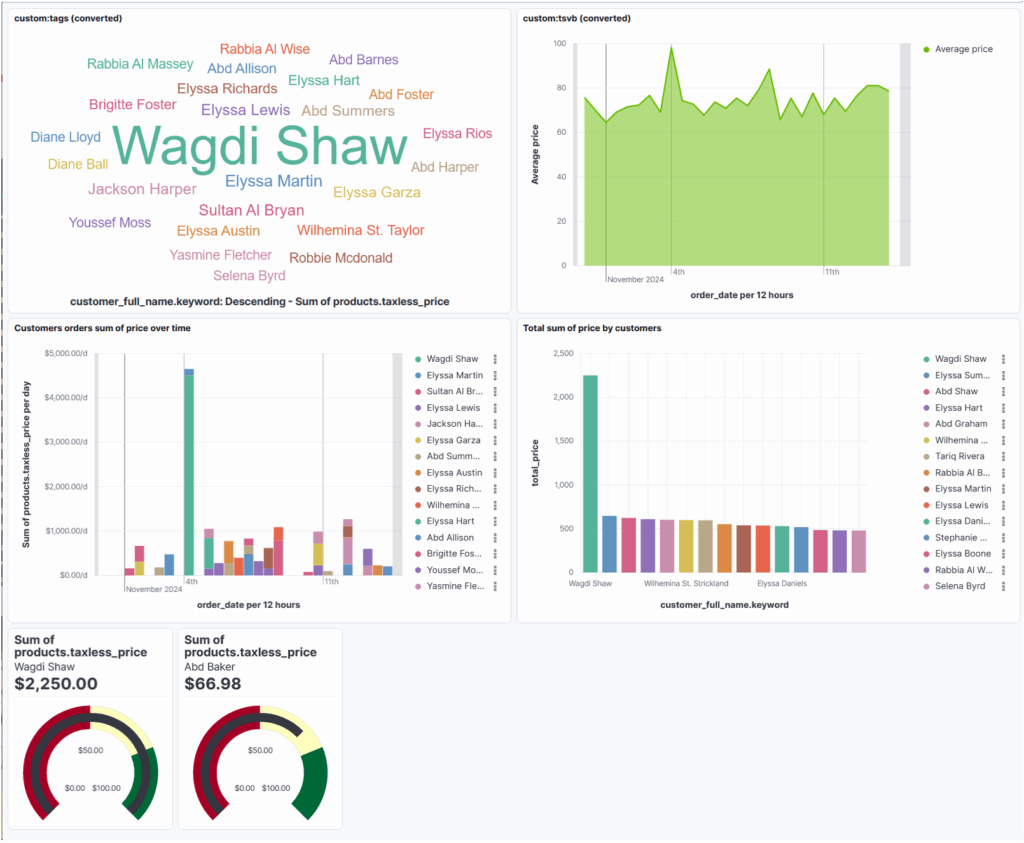

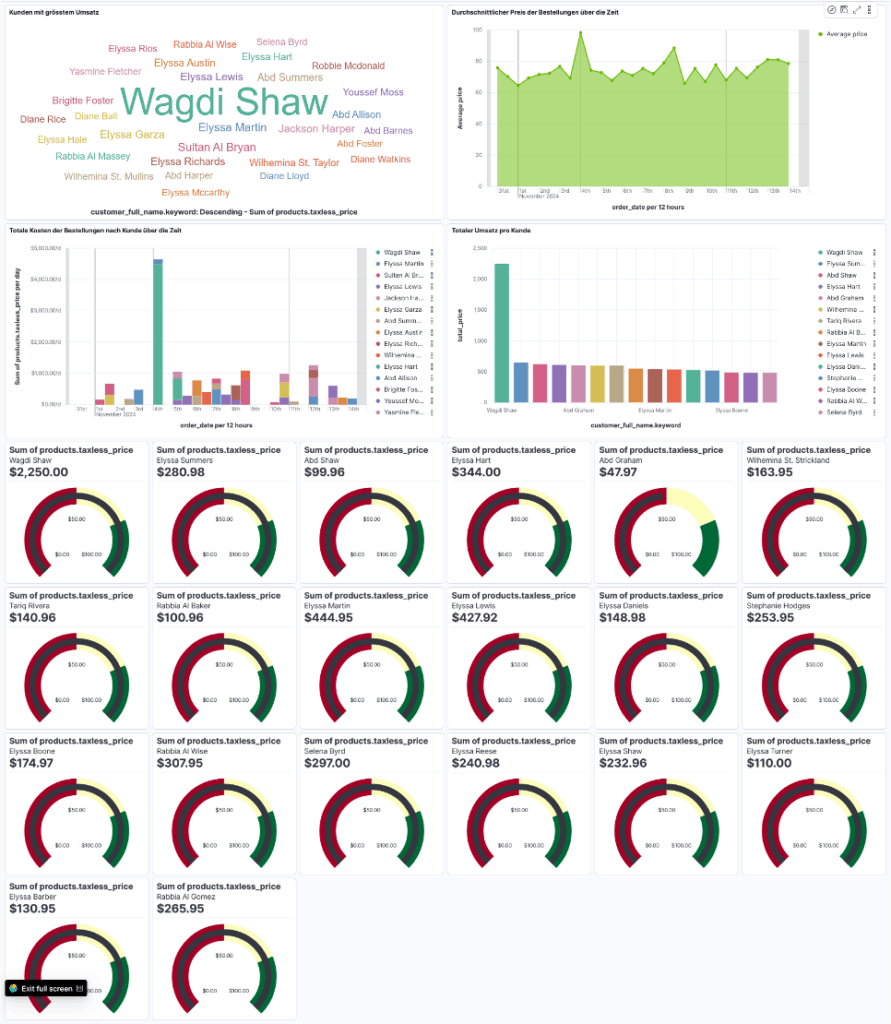

]]>Elastic bietet Beispieldaten, die unter ‹Integrations → Sample data → Other sample data sets› installiert werden können. Im folgenden Beispiel werden die Beispiele aus «Sample eCommerce orders» verwendet. Mit diesen Daten kann das Beispiel nachvollzogen werden.

Dashboard als Vorlage

Daten aus dem eCommerce-Beispiel sind im Dashboard in einem Tag-cloud-, einem Liniengrafik-, zwei Balkendiagramm- und zwei Gauge-Panels (Pegeldiagramme) dargestellt worden. Die Gauge-Panels zeigen via Filter die Daten einzelner Kunden aus der eCommerce-Datei. Das Tag-cloud-Panel mit 25 Tags und das Panel mit der Liniengrafik sind als «Legacy → Aggregation based» Panels erstellt und dann in Kibana-Lens-Panels konvertiert worden, die anderen Panels sind direkt mit Kibana-Lens definiert worden. Das Dashboard sieht wie folgt aus:

Dieses Beispiel-Dashboard ist dann in die Datei blog_beispiel5.ndjson exportiert worden.

Inputdatei mit Variablen

In der Inputdatei blog_beispiel5_vars.json werden vorerst wieder einige Variablen definiert.

{

"tag_cloud": {

"title": "Kunden mit grösstem Umsatz",

"anzahl": 30

},

"area": {

"title": "Durchschnittlicher Preis der Bestellungen über die Zeit"

},

"bars_stacked": {

"title": "Totale Kosten der Bestellungen nach Kunde über die Zeit"

},

"bars": {

"title": "Totaler Umsatz pro Kunde"

},

"gauge": {

"hoehe": 10,

"breite": 8

},

"dashboard_title": "generiertes_dashboard_blog_beispiel5"

}Es wird wiederum ein Titel für das Dashboard definiert. Für die ersten 4 Grafiken werden nur andere Titel gesetzt und für die Tag-cloud die Anzahl Tags geändert und die Grösse der Gauge-Panel wird angegeben. Das sind alles nur triviale Anpassungen, die aber zeigen, wie ein solches Dashboard mit Variablen angepasst und neu generiert werden kann. Bei Bedarf lässt sich das dann weiter ausbauen.

Einfügen von jinja2 Elementen

Die Datei blog_beispiel5.j2 ist wiederum erst umgeformt worden, damit sie einfacher angepasst werden kann. Für das Tag-cloud-Panel wird der Titel und die Anzahl Tags wie folgt eingefügt:

"panelsJSON": "[{\"type\":\"lens\",

--------->\"gridData\":{\"x\":0,

--------->\"y\":0,

--------->\"w\":24,

--------->\"h\":15,

--------->\"i\":\"7338d1e1-501e-4084-8d8a-5b7593a87e66\"},

--------->\"panelIndex\":\"7338d1e1-501e-4084-8d8a-5b7593a87e66\",

--------->\"embeddableConfig\":{\"attributes\":{\"title\":\"{{ tag_cloud.title }}\",

--------->\"visualizationType\":\"lnsTagcloud\",

--------->\"type\":\"lens\",

--------->\"references\":[{\"type\":\"index-pattern\",

--------->\"id\":\"ff959d40-b880-11e8-a6d9-e546fe2bba5f\",

--------->\"name\":\"indexpattern-datasource-layer-83a576c3-0e7c-4f46-8284-f87ab836f522\"}],

--------->\"state\":{\"visualization\":{\"layerId\":\"83a576c3-0e7c-4f46-8284-f87ab836f522\",

--------->\"tagAccessor\":\"8ff218c8-cd38-42a9-90bf-06ba8c0543a1\",

--------->\"valueAccessor\":\"d0227fac-22a7-4277-aa2e-cabe22f58736\",

--------->\"maxFontSize\":72,

--------->\"minFontSize\":18,

--------->\"orientation\":\"single\",

--------->\"showLabel\":true,

--------->\"colorMapping\":{\"assignments\":[],

--------->\"specialAssignments\":[{\"rule\":{\"type\":\"other\"},

--------->\"color\":{\"type\":\"loop\"},

--------->\"touched\":false}],

--------->\"paletteId\":\"eui_amsterdam_color_blind\",

--------->\"colorMode\":{\"type\":\"categorical\"}},

--------->\"layerType\":\"data\",

--------->\"palette\":{\"name\":\"default\",

--------->\"type\":\"palette\"}},

--------->\"query\":{\"query\":\"\",

--------->\"language\":\"kuery\"},

--------->\"filters\":[],

--------->\"datasourceStates\":{\"formBased\":{\"layers\":{\"83a576c3-0e7c-4f46-8284-f87ab836f522\":{\"ignoreGlobalFilters\":false,

--------->\"columns\":{\"8ff218c8-cd38-42a9-90bf-06ba8c0543a1\":{\"label\":\"customer_full_name.keyword: Descending\",

--------->\"dataType\":\"string\",

--------->\"operationType\":\"terms\",

--------->\"scale\":\"ordinal\",

--------->\"sourceField\":\"customer_full_name.keyword\",

--------->\"isBucketed\":true,

--------->\"params\":{\"size\":{{ tag_cloud.anzahl }},

--------->\"orderBy\":{\"type\":\"column\",Die Id des Dashboards wird wiederum gelöscht, damit Kibana beim Import eine neue, eindeutige Dashboard-Id generiert.

"created_at": "2024-12-11T16:21:16.255Z",

"id": "24248d69-cca9-4e52-be60-bd2fa96d24ac",Das mit dem Template und der obigen Inputdatei generierte Dashboard sieht dann wie folgt aus, wobei das Tag-cloud-Panel nun 30 Tags darstellt und die Titel der Panels angepasst sind (im Screenshot rot umrahmt):

Inputdatei für eine flexible Anzahl Gauge-Panels

Um das Beispiel 5 etwas interessanter zu machen, wird die Inputdatei mit Variablen für mehrere Gauge-Panels ergänzt. Diese sollen wie im früheren Beispiel die Markdown-Panels in Reihen und Spalten angeordnet werden und sie sollen Angaben für verschiedene Kunden aus den eCommerce-Beispieldaten anzeigen.

"tag_cloud": {

"title": "Kunden mit grösstem Umsatz",

"anzahl": 30

},

"area": {

"title": "Durchschnittlicher Preis der Bestellungen über die Zeit"

},

"bars_stacked": {

"title": "Totale Kosten der Bestellungen nach Kunde über die Zeit"

},

"bars": {

"title": "Totaler Umsatz pro Kunde"

},

"gauge": {

"hoehe": 10,

"breite": 8,

"spalten": 6,

"anzahl": 20

},

"namen": [

"Wagdi Shaw",

"Elyssa Summers",

"Abd Shaw",

"Elyssa Hart",

"Abd Graham",

"Wilhemina St. Strickland",

"Tariq Rivera",

"Rabbia Al Baker",

"Elyssa Martin",

"Elyssa Lewis",

"Elyssa Daniels",

// etc. ...

"Elyssa Hale",

"Abd Burton",

"Sultan Al Marshall",

"Betty Morrison",

"Mary Hampton",

"Elyssa Rowe",

"Elyssa Austin"

],

"dashboard_title": "generiertes_dashboard_blog_beispiel5"

}Das Array mit den Namen von Kunden aus eCommerce kann für die Filter und Beschriftungen der Gauge-Panels verwendet werden.

Data-View-Ids

DataView-Ids werden in Kibana für Referenzen auf die Daten verwendet. In den ndjson-Dateien wird noch der frühere Name Indexpattern verwendet. Die DataView-Ids sind in der ndjson-Vorlage meist schon vorhanden und sie können einfach weiter verwendet werden. Ansonsten findet man die DataView-Ids unter «Stack Management→DataViews». Dort wählt man die DataView aus, klickt auf «Edit» und «Show advanced settings» und bekommt dann die DataView-Id angezeigt. Die Id ist zudem Teil der Url:

Referenzen und Panel-Ids

Anders als bei den Beispielen mit den Markdown-Panels werden in Beispiel 5 in Elastic gespeicherte Daten verwendet, auf die aus dem Dashboard zugegriffen wird. Dazu werden im Dashboard gegen Ende der ndjson-Datei Referenzen und Ids definiert und z.B. in den Gauge-Panels wird im Array «references» darauf referenziert.

Etwas Dokumentation dazu findet man unter den folgenden Links:

References

References (references) are regular saved object references forming a graph of saved objects which depend on each other. For the Lens case, these references can be annotation groups or data views (called type: «index-pattern» in code), referencing permanent data views which are used in the current Lens visualization. Often there is just a single data view in use, but it’s possible to use multiple data views for multiple layers in a Lens xy chart. The id of a reference needs to be the saved object id of the referenced data view (see the «Handling data views» section below). The name of the reference is comprised out of multiple parts used to map the data view to the correct layer : indexpattern-datasource-layer-<id of the layer>. Even if multiple layers are using the same data view, there has to be one reference per layer (all pointing to the same data view id). References array can be empty in case of adhoc dataviews (see section below).

references array

Objects with name, id, and type properties that describe the other saved objects that this object references. Use name in attributes to refer to the other saved object, but never the id, which can update automatically during migrations or import and export.

In der exportierten Dashboardvorlage sieht die Definition der Referenzen beispielsweise wie folgt aus:

"references": [

{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "7338d1e1-501e-4084-8d8a-5b7593a87e66:indexpattern-datasource-layer-83a576c3-0e7c-4f46-8284-f87ab836f522",

"type": "index-pattern"

},

//… …

{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "1400e794-2571-4b4a-b78b-2d5aab20263b:indexpattern-datasource-layer-38148eb9-48c3-40ac-8090-011abf2cdefe",

"type": "index-pattern"

},

{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "1400e794-2571-4b4a-b78b-2d5aab20263b:08984911-134f-4ff2-8c1d-bf86d034351c",

"type": "index-pattern"

}

],Die Einträge mit

"name": "1400e794-2571-4b4a-b78b-2d5aab20263bsind jene, die im einen Gauge-Panel referenziert werden. Dort kommt der «name» als «panelIndex» und als Komponente «i» in «gridData» vor. So kann man diese Einträge im Referenz-Array finden. Die übrigen Einträge dort gehören zu den anderen Panels. «id» ist überall die DataView-Id für die eCommerce-Beispieldaten, auf die von allen Panels aus referenziert wird.

Wenn im Dashboard mehrere Gauge-Panels definiert werden sollen, so müssen diese alle einen eindeutigen Panel-Index haben. Für das Format der Panel-Indices gelten offenbar keine grossen Vorgaben, so dass man ziemlich frei ist bei der Wahl eindeutiger Werte. Die Panel-Indices müssen bei den Gauge-Paneldefinitionen und übereinstimmend im Array mit den Referenzen definiert werden.

Einfügen von jinja2 Elementen

Die Definitionen der Gauge-Panels werden in einer Schleife generiert wie in beispiel4.j2 jene für die Markdown-Panels. Als Panelindex wird einfach «gauge_panel_nri» definiert, wobei «i» eine Laufnummer ist. So können die Indices einfach für die Panels und die Referenzen in zwei unabhängigen Schleifen generiert werden.

Die wichtigsten jinja2-Elemente bei der Definition der Gauge-Panels in blog_beisiel5.j2 sind dann:

--------->{% set global = namespace(row = 0) %}{% for i in range(0, gauge.anzahl) %}{\"type\":\"lens\",

--------->\"gridData\":{\"x\":{{ (i) % gauge.spalten * gauge.breite }},

--------->\"y\":{{ 30 + gauge.hoehe * global.row }}{% if (i + 1) % gauge.spalten == 0 %}{% set global.row = global.row + 1 %}{% endif %},

--------->\"w\":{{ gauge.breite }},

--------->\"h\":{{ gauge.hoehe }},

--------->\"i\":\"gauge_panel_nr{{ i }}\"},

--------->\"panelIndex\":\"gauge_panel_nr{{ i }}\",

--------->\"embeddableConfig\":{\"attributes\":{\"title\":\"Gauge visualization\",

--------->\"visualizationType\":\"lnsGauge\",

--------->\"type\":\"lens\",

--------->\"references\":[{\"type\":\"index-pattern\",

--------->\"id\":\"ff959d40-b880-11e8-a6d9-e546fe2bba5f\",

--------->\"name\":\"indexpattern-datasource-layer-38148eb9-48c3-40ac-8090-011abf2cdefe\"}],

--------->\"state\":{\"visualization\":{\"shape\":\"arc\",

--------->\"layerId\":\"38148eb9-48c3-40ac-8090-011abf2cdefe\",

--------->\"layerType\":\"data\",

--------->\"ticksPosition\":\"auto\",

--------->\"labelMajorMode\":\"auto\",

--------->\"metricAccessor\":\"e4f872bd-8510-456b-ac48-8da24c92b19d\",

--------->\"colorMode\":\"palette\",

--------->\"percentageMode\":false,

--------->\"palette\":{\"name\":\"custom\",

--------->\"params\":{\"maxSteps\":5,

--------->\"name\":\"custom\",

--------->\"progression\":\"fixed\",

--------->\"rangeMax\":100,

--------->\"rangeMin\":0,

--------->\"rangeType\":\"number\",

--------->\"reverse\":false,

--------->\"continuity\":\"none\",

--------->\"colorStops\":[{\"color\":\"#A50026\",

--------->\"stop\":0},

--------->{\"color\":\"#FEFEBD\",

--------->\"stop\":50},

--------->{\"color\":\"#006837\",

--------->\"stop\":75}],

--------->\"stops\":[{\"color\":\"#A50026\",

--------->\"stop\":50},

--------->{\"color\":\"#FEFEBD\",

--------->\"stop\":75},

--------->{\"color\":\"#006837\",

--------->\"stop\":100}],

--------->\"steps\":5},

--------->\"type\":\"palette\"},

--------->\"minAccessor\":\"4399d773-95c6-4ecb-bc1b-a26a9d9f0d09\",

--------->\"maxAccessor\":\"9a3f8db0-a822-4627-9906-8fab5bf235df\",

--------->\"labelMinor\":\"{{ namen[i] }}\"},

--------->\"query\":{\"query\":\"customer_full_name.keyword : \\\"{{ namen[i] }}\\\" \",

--------->\"language\":\"kuery\"},

--------->\"filters\":[{\"meta\":{\"alias\":null,

--------->\"disabled\":false,

--------->\"index\":\"5c0dea8b-d51a-4f34-8240-520a78d12164\",

--------->\"key\":\"products.taxless_price\",

--------->\"negate\":false,

--------->\"type\":\"exists\",

--------->\"value\":\"exists\"},

--------->\"query\":{\"exists\":{\"field\":\"products.taxless_price\"}},

//… ...

--------->\"enhancements\":{},

--------->\"hidePanelTitles\":true},

--------->\"title\":\"Gauge visualization\"}{% if loop.index != loop.length %},{% endif %}{% endfor %}]",Am Anfang und Ende stehen die Angaben für die Schleife, wobei am Ende wieder geprüft werden muss, ob ein Komma nötig ist oder ob das letzte Element des Arrays erreicht ist. Das uns die Berechnung der Position der Panels ist analog Beispiel 4 gemacht.

Weiter wird noch der Name aus dem Array mit den Kundennamen als Label definiert und in der Filterabfrage angegeben.

Wichtig sind die zwei Definitionen für die Panelindices.

--------->\"i\":\"gauge_panel_nr{{ i }}\"},

--------->\"panelIndex\":\"gauge_panel_nr{{ i }}\",Zudem müssen weiter unten die Referenzen für alle Gauge-Panels in einer Schleife generiert werden.

{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "51c3912f-6d82-4be5-82e4-31a6549d9df4:indexpattern-datasource-layer-446d03ef-469d-419a-90ab-40632cd777f5",

"type": "index-pattern"

},

{% for i in range(0, gauge.anzahl) %}{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "gauge_panel_nr{{ i }}:indexpattern-datasource-layer-38148eb9-48c3-40ac-8090-011abf2cdefe",

"type": "index-pattern"

},{% endfor %}

{

"id": "ff959d40-b880-11e8-a6d9-e546fe2bba5f",

"name": "gauge_panel_nr0:08984911-134f-4ff2-8c1d-bf86d034351c",

"type": "index-pattern"

}Der Befehl

jinjanate blog_beispiel5.j2 blog_beispiel5_vars.json -o generiertes_dashboard_blog_beispiel5.ndjsongeneriert nun folgendes Dashboard, in dem die Gauge-Panels wiederholt werden und regelmässig in 6 Spalten angeordnet sind:

Variante mit Gauge-Panels zu verschiedenen Metriken

Als weitere Variante von Beispiel 5 habe ich Gauge-Panels zu zwei Metriken generiert und die Grenzen für die Farben sowie die Maximalwerte in den Gauge-Panels über Variablen in der Inputdatei definiert. Wenn nur eine Metrik angegeben wird, kann damit auch das vorherige Dashboard generiert werden.

Inputdatei mit zwei Metriken für die Gauge-Panels

Der folgende Teil der Inputdatei ist angepasst worden, wobei für die Angaben jeweils Arrays verwendet worden sind.

"gauge": {

"hoehe": 10,

"breite": 8,

"spalten": 6,

"anzahl": 18,

"query_fields": [

"products.taxless_price",

"products.quantity"

],

"range_max" : [500, 12],

"color_start" : [[0, 100, 300],

[0,3,6]],

"color_stop" : [[100, 300, 500],

[3,6,12]]

},

"namen": [

"Wagdi Shaw",

"Elyssa Summers",Einfügen von jinja2 Elementen

Hier sind nun zwei verschachtelte Schleifen nötig, eine über die Metriken und innerhalb dieser Schleife jeweils eine über die Anzahl gewünschter Gauge-Panels.

Als Hilfestellung hier noch die wichtigen Teile der json-Datei vor der Umformatierung in blog_beispiel5.j2:

--------->{% set global = namespace(row = 0) %}{% for field in gauge.query_fields %}{% set outer_loop = loop %}{% for i in range(0, gauge.anzahl) %}{\"type\":\"lens\",

--------->\"gridData\":{\"x\":{{ (i + ( outer_loop.index0 * gauge.anzahl ) ) % gauge.spalten * gauge.breite }},

--------->\"y\":{{ 30 + gauge.hoehe * global.row }}{% if (i + 1 + ( outer_loop.index0 * gauge.anzahl ) ) % gauge.spalten == 0 %}{% set global.row = global.row + 1 %}{% endif %},

--------->\"w\":{{ gauge.breite }},

--------->\"h\":{{ gauge.hoehe }},

--------->\"i\":\"gauge_panel_nr{{ i + ( outer_loop.index0 * gauge.anzahl ) }}\"},

--------->\"panelIndex\":\"gauge_panel_nr{{ i + ( outer_loop.index0 * gauge.anzahl ) }}\",

--------->\"embeddableConfig\":{\"attributes\":{\"title\":\"Gauge visualization\",

//… …

--------->\"rangeMax\":{{ gauge.range_max[outer_loop.index0] }},

--------->\"rangeMin\":0,

--------->\"rangeType\":\"number\",

--------->\"reverse\":false,

--------->\"continuity\":\"none\",

--------->\"colorStops\":[{\"color\":\"#A50026\",

--------->\"stop\":{{ gauge.color_start[outer_loop.index0][0] }}},

--------->{\"color\":\"#FEFEBD\",

--------->\"stop\":{{ gauge.color_start[outer_loop.index0][1] }}},

--------->{\"color\":\"#006837\",

--------->\"stop\":{{ gauge.color_start[outer_loop.index0][2] }}}],

--------->\"stops\":[{\"color\":\"#A50026\",

--------->\"stop\":{{ gauge.color_stop[outer_loop.index0][0] }}},

--------->{\"color\":\"#FEFEBD\",

--------->\"stop\":{{ gauge.color_stop[outer_loop.index0][1] }}},

--------->{\"color\":\"#006837\",

--------->\"stop\":{{ gauge.color_stop[outer_loop.index0][2] }}}],

--------->\"steps\":5},

//… …

--------->\"9a3f8db0-a822-4627-9906-8fab5bf235df\":{\"label\":\"Static value: {{ gauge.range_max[outer_loop.index0] }}\",

--------->\"dataType\":\"number\",

--------->\"operationType\":\"static_value\",

--------->\"isStaticValue\":true,

--------->\"isBucketed\":false,

--------->\"scale\":\"ratio\",

--------->\"params\":{\"value\":\"{{ gauge.range_max[outer_loop.index0] }}\"},

//… …

--------->\"title\":\"Gauge visualization\"}{% if outer_loop.index != outer_loop.length or loop.index != loop.length %},{% endif %}{% endfor %}{% endfor %}]",Das generierte Dashboard mit den Gauge-Panels zu den zwei verschiedenen Metriken sieht dann wie folgt aus:

Weitere Ideen

Es geht in dieser Blogreihe darum, das Prinzip zur Generierung von Dashboards mit jinja2-Templates vorzustellen. Analog können viele weitere Ideen zur Automatisierung umgesetzt werden und zwar auch in anderen Bereichen.

Mit Shell-Skripts oder Skripts in anderen Skriptsprachen kann die Automatisierung erweitert werden. Beispielsweise können in einem Skript mehrere Dashboards generiert oder in einer Schleife können Dashboards für verschiedene Umgebungen oder Kunden generiert werden.

Es können auch mehrere Dashboards in eine einzelne ndjson-Datei geschrieben werden.

Der Import von Dashboards in Kibana per REST-Schnittstelle kann ebenfalls nach der Generierung von Dashboards in dasselbe Skript eingefügt werden. Die Dokumentation dazu findet man hier:

- https://www.elastic.co/docs/api/doc/kibana/operation/operation-importsavedobjectsdefault

- https://www.elastic.co/docs/api/doc/kibana/operation/operation-resolveimporterrors

Fazit

Mit den vorgestellten Ideen und Werkzeugen lassen sich Kibana-Dashboards flexibel generieren. Leider fehlt eine Referenzdokumentation für das Format der beim Export und Import von Dashboards und weiteren gespeicherten Objekten verwendeten ndjson-Dateien. So braucht es manchmal etwas Fantasie und Tests für die konkrete Umsetzung. Das Vorgehen lohnt sich aber schnell, wenn mehrere ähnliche Dashboards gebraucht werden.

Dasselbe Vorgehen zur Automatisierung kann nicht nur im Elastic Stack sondern mit vielen anderen Softwarepaketen verwendet werden.

Melden Sie sich ohne zu zögern für ein kostenloses Beratungsgespräch bei Swissmakers, um zu erfahren, wie wir Sie in den Bereichen Automatisierung und Elastic unterstützen können.

]]>Kinder und Jugendliche verdienen unseren umfassenden Schutz – besonders in Bildungseinrichtungen wie Schulen, Internaten, Kindergärten, Kitas oder Kompetenzzentren. Viele Einrichtungen sind bereits auf externe Gefahren vorbereitet und setzen Firewalls, Virenscanner oder Zugangsbeschränkungen ein. Trotzdem entsteht eine empfindliche Lücke, sobald potenzielle Bedrohungen innerhalb der Organisation auftauchen: Übergriffe durch Mitarbeitende, Radikalisierung, Cybermobbing oder das unerlaubte Konsumieren illegaler Inhalte bleiben oft lange unentdeckt.

Als Vater eines dreijährigen Sohnes kann ich mir nur schwer vorstellen, was es bedeutet, wenn das eigene Kind in eine solche Situation gerät. Die Dunkelziffer ist nach wie vor hoch, und viele Fälle bleiben unentdeckt. Aus der Überzeugung heraus, dass wir alle Verantwortung dafür tragen, unsere Kinder bestmöglich zu schützen, haben wir bei der Swissmakers GmbH entschieden, unsere technologische Expertise im Bereich Cybersicherheit und Elasticsearch zu nutzen und gezielt zum Kinderschutz einzusetzen. In diesem Blog-Beitrag möchten wir daher einen ersten Überblick geben, wie ein klassisches SIEM-System durch minimale Anpassungen im Schul- und Betreuungsumfeld, effizient zum Schutz von Kindern eingesetzt werden kann.

Was ist ein SIEM-System und warum ist es ideal für den Kinderschutz?

Ein SIEM-System (Security Information and Event Management System) sammelt und analysiert in Echtzeit die Protokolldaten sämtlicher Anwendungen und Endgeräte innerhalb einer Einrichtung. Im Gegensatz zu einer lückenlosen Überwachung aller Inhalte, verarbeitet ein SIEM in erster Linie Metadaten (z. B. Zeitpunkt einer Kommunikation, Abweichungen vom üblichen Nutzungsverhalten), um Anomalien frühzeitig zu erkennen. Lehrkräften und Sozialpädagogen bietet dies eine Möglichkeit, erste Warnsignale für problematisches Verhalten zu identifizieren, bevor Schlimmeres passiert – und zwar ohne die Privatsphäre von Kindern und Jugendlichen unnötig zu verletzen.

Gerade im pädagogischen Kontext sorgt das Thema „digitale Überwachung“ verständlicherweise für Skepsis. Ein modernes SIEM-Konzept kann Ängste vor totaler Kontrolle jedoch wirksam entkräften, weil es keine lückenlose Überprüfung sämtlicher Chats oder Dokumente vornimmt. Vielmehr beobachtet das System grundlegende Parameter (zum Beispiel die Häufigkeit, mit der Dateien ausgetauscht werden) und löst nur dann einen Alarm aus, wenn bestimmte, zuvor definierte Muster auftreten. So bleibt die persönliche Kommunikation weitgehend geschützt, während potenziell kritische Ereignisse rechtzeitig ans Licht kommen.

Wie ein SIEM konkret hilft: Praxisnahe Beispiele

Schulen, Internate und weitere Betreuungseinrichtungen bündeln eine Vielzahl an digitalen Aktivitäten: Chats, E-Mails, Online-Lernplattformen, Lern-Apps, Netzwerkspeicher und vieles mehr. Hinzu kommt, dass viele Kinder und Jugendliche bereits in sehr jungem Alter eigenständig im Internet surfen – teils auf privaten Geräten, teils auf Schul-Tablets oder Computern im Schulnetzwerk. Gerade in diesem komplexen Umfeld ist es entscheidend, Frühwarnsignale zu erkennen, bevor Missbrauch stattfindet.

Ein SIEM-System hilft dabei, diese Vorgänge frühzeitig zu registrieren. Anstatt erst nach schweren Vorfällen reagieren zu können, kann die Schulleitung oder ein eingestelltes Security-Team präventiv einschreiten und klärende Gespräche führen, sobald auffällige Anomalien im Verhalten auftauchen.

Vorteile und Herausforderungen

Warum viele Schulen noch hinterherhinken

Obwohl die IT-Ausstattung an Schulen stetig wächst, bleibt die Sicherheitsinfrastruktur häufig auf einem veralteten Stand. Firewalls und Virenscanner lassen sich relativ einfach einrichten, doch die Analyse interner Datenströme ist komplexer. Fehlendes Fachpersonal, unklare Zuständigkeiten und die Scheu vor vermeintlicher Überwachung führen dazu, dass ein grosser Teil der Problematiken unentdeckt bleibt. Genau hier setzen SIEM-Lösungen an: Sie werten Daten automatisch aus, schlagen zuverlässig Alarm und ermöglichen es, rechtzeitig einzugreifen. So wird aus Technik eine wertvolle Hilfe für mehr Sicherheit im pädagogischen Alltag. Mit anderen Worten: Wenn Gefahr nicht laut ruft, braucht es Systeme, die leise Signale erkennen.

Warum Swissmakers GmbH?

Die Swissmakers GmbH ist seit Jahren ein verlässlicher Schweizer Partner von Elasticsearch und verfügt über umfassende Erfahrung im Bereich Cybersicherheit und SIEM-Implementierungen. Unser oberstes Ziel bei diesem Projekt ist es, das Wohl der Kinder zu unterstützen und gleichzeitig die Privatsphäre von Schülern und Mitarbeitenden zu respektieren.

- Technische Fachkenntnisse: Wir verfügen über langjährige Erfahrung in der technischen Umsetzung von SIEM-Lösungen und IT-Sicherheitskonzepten – auch in sensiblen Einsatzbereichen.

- Individuelle Lösungen: Jede Institution ist einzigartig. Wir entwickeln passgenaue Konzepte, die Ihre bestehenden Abläufe nahtlos ergänzen.

- Datenschutzkompetenz: Durch unsere langjährige Erfahrung können wir die geltenden Vorgaben des DSG und des Kinderschutzes integrieren, um einen sicheren und gesetzeskonformen Betrieb zu gewährleisten.

- Ganzheitlicher Ansatz: Von der Konzeption über die Implementierung und Schulung bis zum Betrieb und fortlaufenden Audits – wir begleiten Sie durchgehend.

Fazit: Technologie zum Schutz unserer Kinder

Die Vorstellung, dass unsere Kinder Opfer von Übergriffen werden, ist für viele Eltern kaum erträglich. Dennoch ist es wichtig, dieser Realität ins Auge zu sehen und aktiv etwas dagegen zu unternehmen. Durch den gezielten Einsatz eines SIEM-Systems auf Basis von Elasticsearch lassen sich auffällige Muster, riskante Interaktionen und gefährliche Online-Aktivitäten frühzeitig erkennen – ohne dabei wahllos alle Daten offenzulegen oder die Privatsphäre der Schülerinnen und Schüler zu verletzen.

Kein technologisches Werkzeug kann 100-prozentigen Schutz garantieren oder den menschlichen Blick sowie das persönliche Gespräch vollständig ersetzen. Doch je besser wir unsere digitalen Hilfsmittel nutzen, desto eher können wir potenzielle Gefahren erkennen, bevor irreparabler Schaden entsteht.

Falls Sie mehr darüber erfahren möchten, wie eine solche SIEM-Lösung in Ihrer Einrichtung technisch und organisatorisch umgesetzt werden kann, stehen wir Ihnen gerne zur Verfügung. Unsere Expertinnen und Experten beraten Sie umfassend zu den Themen Datensicherheit, Datenschutz und Prozessintegration – damit wir gemeinsam einen wichtigen Schritt zum Schutz unserer Kinder gehen können.

In diesem ersten Beispiel geht es nur darum, das Vorgehen zu zeigen.

Dashboard als Vorlage

Als einfaches Beispiel, das keine Datenabfragen macht, kann ein Dashboard mit einem oder mehreren Makrdown-Panels verwendet werden. In der Praxis werden Dashboards, die nur Markdown-Panels enthalten, wohl nur selten gebraucht, aber das Vorgehen lässt sich daran gut zeigen und die Beispiele lassen sich einfach nachvollziehen. Hier der Screenshot der interaktiv erstellten Dashboardvorlage für das erste Beispiel:

Dieses Dashboard wird nun exportiert und als blog_beispiel1.ndjson gespeichert.

Inputdatei mit Variablen

Da sonst auch json-Dateien verwendet werden, bietet es sich an, die Variablen ebenfalls in einer neuen json-Datei blog_beispiel1_vars.json zu definieren. Es empfiehlt sich, auch den Titel resp. Namen des Dashboards – in diesem Beispiel steht «title»: «Blog_Beispiel1» in der ndjson-Datei – in der Inputdatei zu definieren und dabei einen neuen Namen zu wählen, damit man beim Import das ursprüngliche Dashboard nicht gleich überschreibt, falls keine neue Id generiert wird.

Hier ein Beispiel des Dateiinhaltes, in dem alle Texte des Markdown-Panels definiert sind:

{

"markdown": {

"title": "Markdown_Titel",

"textzeilen": ["Textzeile1", "Textzeile2"," "]

},

"dashboard_title": "generiertes_dashboard_blog_beispiel1"

}

"]

},

"dashboard_title": "generiertes_dashboard_blog_beispiel1"

}Umformen der ndjson-Datei mit dem Dashboard

Danach macht man am besten eine Kopie der Datei mit dem Dashboard, hier mit dem Namen blog_beispiel1.j2.

Die Zeile mit der Dashboarddefinition kopiert man nun in eine weitere, neue Datei blog_beispiel1.json, um sie besser editieren zu können. Diese neue Datei öffnet man in VSCode und formatiert sie mit <ctrl><alt><b> (vscode-json: Beautify). Zudem können an Kommata Zeilenumbrüche und die Zeichenfolge ——> angehängt werden, um eine bessere Übersicht zu bekommen. Die Zeilenumbrüche und die Zeichenfolge lassen sich später wieder einfach entfernen.

Der Teil der Datei mit der Definition des Markdown-Panels sieht dann etwa wie folgt aus:

...

"panelsJSON": "[{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

------>\"y\":0,

------>\"w\":20,

------>\"h\":9,

------>\"i\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\"},

------>\"panelIndex\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\",

------>\"embeddableConfig\":{\"enhancements\":{\"dynamicActions\":{\"events\":[]}},

------>\"savedVis\":{\"id\":\"\",

------>\"title\":\"\",

------>\"description\":\"\",

------>\"type\":\"markdown\",

------>\"params\":{\"fontSize\":12,

------>\"openLinksInNewTab\":false,

------>\"markdown\":\"# Markdown_Titel\\n\\nTextzeile1\\n\\nTextzeile 2\\n\\n \"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},\"filter\":[]}}}}}]",

"timeRestore": false,

],

"timeRestore": false,

"title": "Blog_Beispiel1",

"version": 2

},

…

\"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},\"filter\":[]}}}}}]",

"timeRestore": false,

],

"timeRestore": false,

"title": "Blog_Beispiel1",

"version": 2

},

…Achtung, die Backslashes vor den Anführungs- und Schlusszeichen und vor Backslashes müssen nach dem Umformen der Datei noch vorhanden sein.

Einfügen von jinja2 Elementen

Jetzt können in der Datei blog_beispiel1.json Referenzen auf die Variablen aus der Inputdatei eingefügt werden. Die Dokumentation zu jinja2 ist wie schon zuvor angegeben auf folgender Webseite zu finden: https://jinja.palletsprojects.com/en/stable/templates/. Um den Wert eines Elementes der Inputdatei einzufügen, genügt es, den Namen der Variable in doppelten geschweiften Klammern anzugeben.

"markdown": "# Markdown_Titel\n\nTextzeile1\n\nTextzeile 2\n\n "

"muss dazu für die obige Inputdatei wie folgt angepasst werden:

"markdown": "# {{ markdown.title }}\n\n{{ markdown.textzeilen.0 }}\n\n{{ markdown.textzeilen.1 }}\n\n{{ markdown.textzeilen.2 }}"markdown.textzeilen ist als Array definiert und mit den Zahlen kann auf die einzelnen Arrayelemente zugegriffen werden. Die Zeile mit dem Dashboardnamen (gegen Ende der Datei vor der Versionsangabe) wird dann noch wie folgt definiert:

"title": "{{ dashboard_title }}",Dashboard-Id löschen

Jetzt muss man noch die Dashboard-Id in blog_beispiel1.json löschen, da man sonst möglicherweise einen Konflikt mit dem ursprünglichen Dashboard und dem mit neuem Namen generierten Dashboard bekommt. Die Id steht gegen Ende der Datei nach der Angabe created_at:

"created_at": "2024-11-26T16:56:50.240Z",

"id": "2d77705c-912a-4730-a565-242f6ae43475",Man kann einfach die Zeile mit der Id löschen.

Formatieren als ndjson-Template

Zuerst müssen die eingefügten Zeilenumbrüche und Zeichenfolgen mit einem entsprechenden Replace all im Editor wieder gelöscht werden.

Mit der Tastenkombination <ctrl><alt><u> (vscode-json: Uglify) kann jetzt das json in blog_beisiel1.json wieder auf eine einzelne Zeile geschrieben werden.

Mit dieser Zeile ersetzt man die ursprüngliche Zeile in blog_beisiel1.j2 und erhält so ein Template, um das Dashboard, das interaktiv erstellt wurde, neu zu generieren.

Dashboard generieren und importieren

Auf der Kommandozeile generiert man nun das neue Dashboard:

jinjanate blog_beispiel1.j2 blog_beispiel1_vars.json -o generiertes_dashboard_blog_beispiel1.ndjsonIn Elastic kann nun unter dem Menüpunkt «Management → Stack Management → Saved Objects» die neu generierte Dateien generiertes_dashboard_blog_beispiel1.ndjson importiert werden. Es sollte zum Import die Option «Create new objects with random Ids» ausgewählt werden. So erhält man am wenigsten Konflikte, bekommt aber allenfalls mehrere Objekte mit demselben Namen, bei denen man die alten Versionen löschen kann. Da muss man schauen, welche Variante am einfachsten ist und ob eventuell die Ids oben nicht gelöscht werden sollen.

Wenn man beim Import eine Meldung folgender Art bekommt « ‚generiertes_dashboard_blog_beispiel‘ conflicts with an existing object.», so hat man ein Problem mit Ids und dem neuen Dashboardnamen.

Das neu importierte Dashboard sieht dann genau so aus wie die Vorlage im Screenshot oben.

Mehrere Markdown Panels generieren

Ausgangspunkt ist dieselbe Vorlage wie in Beispiel 1.

Inputdatei mit Variablen

Die Inputdatei wird mit Angaben für mehrere Markdown-Panels erweitert. Neben dem Text für die Panels wird auch die Position und Grösse definiert. Hier die Beispieldatei blog_beispiel2_vars.json:

{

"markdown": [

{

"title": "Swissmakers",

"textzeilen": [

"Aus Freude an Technik",

"Engeneering / Security / Consulting",

"swissmakers.ch  "

],

"position": [4,0],

"groesse": [20,8]

},

{

"title": "Codeatelier",

"textzeilen": [

"Wir bauen deine digitale Zukunft",

"Webdesign

"

],

"position": [4,0],

"groesse": [20,8]

},

{

"title": "Codeatelier",

"textzeilen": [

"Wir bauen deine digitale Zukunft",

"Webdesign  SEO

SEO  Webapps

Webapps  Webshops",

"codeatelier.ch

Webshops",

"codeatelier.ch  "

],

"position": [9,9],

"groesse": [25,8]

},

{

"title": "Swissmakers",

"textzeilen": [

"Ihre ITC-Spezialistinnen und -Spezialisten",

"Engeneering, Linux und Netzsicherheit",

"swissmakers.ch

"

],

"position": [9,9],

"groesse": [25,8]

},

{

"title": "Swissmakers",

"textzeilen": [

"Ihre ITC-Spezialistinnen und -Spezialisten",

"Engeneering, Linux und Netzsicherheit",

"swissmakers.ch  "

],

"position": [0,18],

"groesse": [35,8]

}

],

"dashboard_title": "generiertes_dashboard_blog_beispiel2"

}

"

],

"position": [0,18],

"groesse": [35,8]

}

],

"dashboard_title": "generiertes_dashboard_blog_beispiel2"

}Umformen der ndjson-Datei mit dem Dashboard

Wie in Beispiel 1 sollte man die Datei blog_beispiel2.j2 umformen, damit sie einfacher zu ändern ist. Damit man mehrere Markdown-Panels erhält, kann man im jinja2-Template in panelsJSON die Angaben für die Panels wiederholen. Im mit eckigen Klammern begrenzten Teil nach panelsJSON wiederholt man den ganzen Teil von {\"type\":\"visualization\", bis zu \"filter\":[]}}}}} wobei zwischen diesen Definitionen der Panels jeweils ein Komma als Trennzeichen von Array-Elementen eingefügt werden muss. Am Ende des Arrays darf aber kein Komma mehr stehen. Das Ganze kann in einer ersten Variante direkt im Editor gemacht werden und sieht dann wie folgt aus:

"panelsJSON": "[{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

------>\"y\":0,

------>\"w\":20,

------>\"h\":9,

------>\"i\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\"},

------>\"panelIndex\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\",

------>\"embeddableConfig\":{\"enhancements\":{\"dynamicActions\":{\"events\":[]}},

------>\"savedVis\":{\"id\":\"\",

------>\"title\":\"\",

------>\"description\":\"\",

------>\"type\":\"markdown\",

------>\"params\":{\"fontSize\":12,

------>\"openLinksInNewTab\":false,

------>\"markdown\":\"# Markdown_Titel\\n\\nTextzeile1\\n\\nTextzeile 2\\n\\n \"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}},

------>{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

------>\"y\":0,

------>\"w\":20,

------>\"h\":9,

------>\"i\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\"},

------>\"panelIndex\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\",

------>\"embeddableConfig\":{\"enhancements\":{\"dynamicActions\":{\"events\":[]}},

------>\"savedVis\":{\"id\":\"\",

------>\"title\":\"\",

------>\"description\":\"\",

------>\"type\":\"markdown\",

------>\"params\":{\"fontSize\":12,

------>\"openLinksInNewTab\":false,

------>\"markdown\":\"# Markdown_Titel\\n\\nTextzeile1\\n\\nTextzeile 2\\n\\n

\"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}},

------>{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

------>\"y\":0,

------>\"w\":20,

------>\"h\":9,

------>\"i\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\"},

------>\"panelIndex\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\",

------>\"embeddableConfig\":{\"enhancements\":{\"dynamicActions\":{\"events\":[]}},

------>\"savedVis\":{\"id\":\"\",

------>\"title\":\"\",

------>\"description\":\"\",

------>\"type\":\"markdown\",

------>\"params\":{\"fontSize\":12,

------>\"openLinksInNewTab\":false,

------>\"markdown\":\"# Markdown_Titel\\n\\nTextzeile1\\n\\nTextzeile 2\\n\\n \"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}},

------>{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

… …

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}}]",

"timeRestore": false,

"title": "Blog_Beispiel2",

"version": 2

},

"coreMigrationVersion": "8.8.0",

\"},

------>\"uiState\":{},

------>\"data\":{\"aggs\":[],

------>\"searchSource\":{\"query\":{\"query\":\"\",

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}},

------>{\"type\":\"visualization\",

------>\"gridData\":{\"x\":0,

… …

------>\"language\":\"kuery\"},

------>\"filter\":[]}}}}}]",

"timeRestore": false,

"title": "Blog_Beispiel2",

"version": 2

},

"coreMigrationVersion": "8.8.0",Löschen der Panel-Indices

Ein Panel bekommt in Kibana einen Index-Wert. Diese müssen (ausser dem ersten) gelöscht werden, resp. es darf nicht mehrmals derselbe Index vorkommen, sonst überschreiben sich die Panels. Folgende Zeilen in der Datei blog_beispiel2.j2 müssen also noch gelöscht werden:

-----→\"panelIndex\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\",Auch die Dashboard-Id sollte am besten wieder gelöscht werden.

Einfügen von jinja2 Elementen

Analog Beispiel 1 können nun die Variablen aus der Inputdatei eingefügt werden. Man hat dabei eine Array-Ebene mehr als im ersten Beispiel und neben den Texten sind auch noch die Positionen und die Grösse der Panels anzugeben. Auszugsweise sieht das dann so aus:

"panelsJSON": "[{\"type\":\"visualization\",

------>\"gridData\":{\"x\":{{ markdown.0.position.0 }},

------>\"y\":{{ markdown.0.position.1 }},

------>\"w\":{{ markdown.0.groesse.0 }},

------>\"h\":{{ markdown.0.groesse.1 }},

… …

------>\"markdown\":\"# {{ markdown.0.title }}\\n\\n{{ markdown.0.textzeilen.0 }}\\n\\n{{ markdown.0.textzeilen.1 }}\\n\\n{{ markdown.0.textzeilen.2 }}\"},

… …Für die weiteren zwei Panels heisst es dann {{ markdown.1. … }} und {{ markdown.2. … }}.

Auch der Name des Dashboards muss noch angepasst werden:

"title":"{{ dashboard_title }}"Weitere Schritte

Analog Beispiel 1 muss die Datei blog_beispiel2.j2 wieder als ndjson formatiert werden.

Dann kann das Dashboard generiert werden mit dem Befehl:

jinjanate blog_beispiel2.j2 blog_beispiel2_vars.json -o generiertes_dashboard_blog_beispiel2.ndjsonDas generierte Dashboard wird wiederum mit der Option «Create new objects with random Ids» importiert. Das Resultat sieht man im folgenden Screenshot:

Generieren von mehreren Panels in einer Schleife

Das Dashboard aus Beispiel 2 lässt sich auch etwas eleganter generieren. Anstelle der Aneinanderreihung der Markdown-Panels im jinja2-Template können die Panels in Beispiel 3 in einer Schleife generiert werden. Diese Lösung bietet mehr Flexibilität.

Als Inputdatei mit Variablen wird vorerst eine Kopie blog_beispiel3_vars.json der Inputdatei von Beispiel 2 gebraucht, in der nur der Name resp. Titel des Dashboards auf generiertes_dashboard_blog_beispiel3 angepasst worden ist.

blog_beispiel3.json ist wieder die umformatierte Datei mit dem ursprünglich interaktiv erstellten Dashboard, in die nun jinja2-Elemente eingefügt werden. Die Datei ist vorerst eine Kopie von blog_beispiel1.json, die nur die Definition eines Markdown-Panels enthält, nicht die Datei mit den drei Panels aus Beispiel 2. Hier nun der entsprechende Teil der Datei mit den neuen jinja2-Elementen:

"panelsJSON": "[{% for item in markdown %}{\"type\":\"visualization\",

------->\"gridData\":{\"x\":{{ markdown[loop.index0]['position'][0] }},

------->\"y\":{{ markdown[loop.index0]['position'][1] }},

------->\"w\":{{ markdown[loop.index0]['groesse'][0] }},

------->\"h\":{{ markdown[loop.index0]['groesse'][1] }},

------->\"i\":\"09747f18-d4b6-4cb0-a25e-63abf3a9cce8\"},

------->\"embeddableConfig\":{\"enhancements\":{\"dynamicActions\":{\"events\":[]}},

------->\"savedVis\":{\"id\":\"\",

------->\"title\":\"\",

------->\"description\":\"\",

------->\"type\":\"markdown\",

------->\"params\":{\"fontSize\":12,

------->\"openLinksInNewTab\":false,

------->\"markdown\":\"# {{ markdown[loop.index0]['title'] }}\\n\\n{{ markdown[loop.index0]['textzeilen'][0] }}\\n\\n{{ markdown[loop.index0]['textzeilen'][1] }}\\n\\n{{ markdown[loop.index0]['textzeilen'][2] }}\"},

------->\"uiState\":{},

------->\"data\":{\"aggs\":[],

------->\"searchSource\":{\"query\":{\"query\":\"\",

------->\"language\":\"kuery\"},

------->\"filter\":[]}}}}}{% if loop.index != loop.length %},{% endif %}

{% endfor %}]",

"timeRestore": false,

"title": "{{ dashboard_title }}",

"version": 2

},In jinja2 kann eine Schleife mit den folgenden Elementen definiert werden:

{% for item in markdown %}

{% endfor %}Für jedes Element im Array markdown in der Inputdatei wird dann der ganze Teil innerhalb der Schleife wiederholt. Damit erhält man die drei Paneldefinitionen im Output.

Wie beim Anpassen der Datei für Beispiel 2 muss man beachten, dass die Paneldefinitionen in einem json-Array stehen, zwischen dessen Elementen ein Komma stehen muss, aber am Ende des Arrays darf kein Komma mehr stehen. Dies kann mit einer Bedingung in jinja2 erreicht werden:

{% if loop.index != loop.length %},{% endif %}Wenn der Schleifenindex noch nicht gleich der Anzahl Schleifen ist, so wird das Komma zwischen der if-Bedingung und dem {% endif %} in den Output geschrieben, aber beim letzten Schleifendurchgang nicht mehr.

Für die Angabe der Arrayelemente aus der Inputdatei wird hier eine alternative Syntax verwendet, bei der die Array-Ebenen nicht durch Punkte getrennt sind wie es in Beispiel 1 und Beispiel 2 gebraucht wurde, sondern in eckigen Klammern angegeben werden. loop.index0 ist eine Variable, die innerhalb einer for-Schleife zur Verfügung steht und die angibt, in welchem Durchgang der Schleife man ist, wenn mit 0 zu zählen begonnen wird, um Unterschied zur oben verwendeten Variable loop.index, bei der mit 1 zu zählen begonnen wird. Die Namensteile ohne Anführungs- und Schlusszeichen sind jinja2-Variablen, deren Wert dort eingesetzt wird, jene in Anführungs- und Schlusszeichen sind die Namen aus dem json in der Inputdatei. Anführungs- und Schlusszeichen sind also wichtig und müssen korrekt gesetzt sein.

Wie in den anderen Beispielen muss nun die Datei umformatiert und als ganzes Template blog_beispiel3.j2 gespeichert werden.

Der Befehl

jinjanate blog_beispiel3.j2 blog_beispiel3_vars.json -o generiertes_dashboard_blog_beispiel3.ndjsongeneriert dann ein Dashboard, das genau so aussieht wie jenes in Beispiel 2.

Neue Inputdatei mit Variablen

Mit der Schleife im Template ist Beispiel 3 nun viel flexibler als Beispiel 2. Es genügt, die Inputdatei anzupassen, um unterschiedlich viele Markdown-Panels im Dashboard zu generieren. Es können natürlich auch verschiedene Inputdateien mit demselben Template verwendet werden, z.B. für verschiedene Stages (dev, preprod, prod) etc.

Hier eine neue Inputdatei:

{

"markdown": [

{

"title": "**Swissmakers**",

"textzeilen": [

"Aus Freude an Technik",

"Engeneering / Security / Consulting",

"swissmakers.ch  "

],

"position": [0,0],

"groesse": [15,8]

},

{

"title": "**Swissmakers**",

"textzeilen": [

"Einfach Top!",

"swissmakers.ch

"

],

"position": [0,0],

"groesse": [15,8]

},

{

"title": "**Swissmakers**",

"textzeilen": [

"Einfach Top!",

"swissmakers.ch

",

""

],

"position": [18,0],

"groesse": [15,8]

},

{

"title": "**Codeatelier**",

"textzeilen": [

"Wir bauen deine digitale Zukunft",

"Webdesign

",

""

],

"position": [18,0],