バーチャルモーションキャプチャー全画面解説

作成バージョン

VirtualMotionCapture0.50r1

基本的な使い方

- 起動します。

- VRMの読込からモデルを読み込みます。

- キャリブレーションを行います。

- リップシンクのデバイスを設定します。

- カメラをフリーカメラにし、好きな角度にします。

以上です。

ファイアーウォール警告画面

仮想トラッカーや、外部アプリケーションとの連携に必要になります。

予期せぬトラブルを避けるためには、基本的に許可してください。

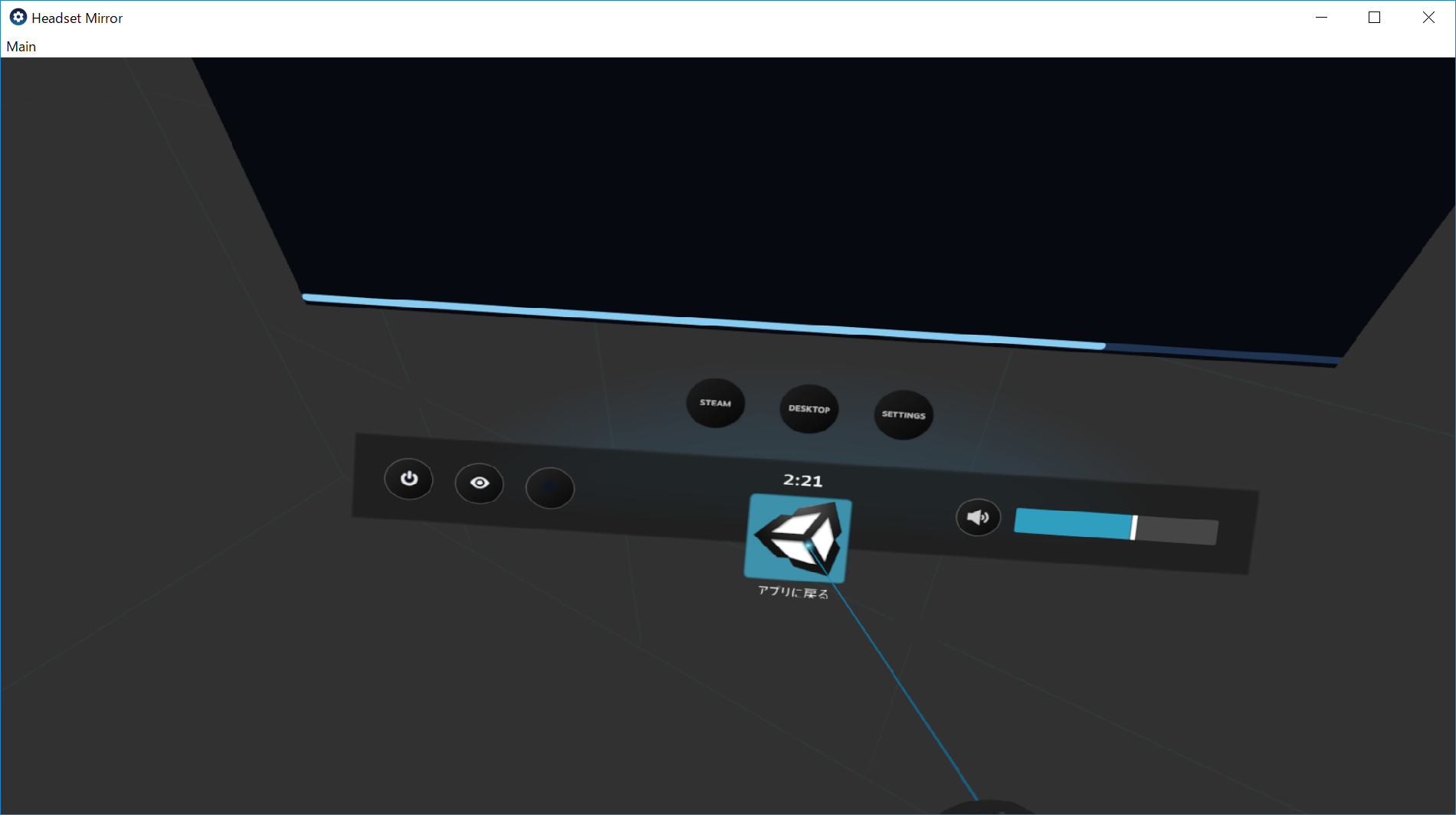

基本画面

左クリックで掴んで移動できます。

フリーカメラでは以下の操作ができます。

- Alt + 左クリックでモデルを中心にカメラを回転

- 右クリックでカメラ位置を中心にカメラを回転

- マウスホイール回転でカメラのズームイン・アウト

- マウスホイールクリックでカメラの平行移動

- Alt + マウスホイール回転でカメラの細かいズームイン・アウト

画面は通常通りリサイズできます。

背景色を透過設定にすると、背景が透過するので、合成ソフトなどなしに簡易的な合成ができます。

ただし、透過設定時など、ウィンドウ枠の非表示時はリサイズできません。

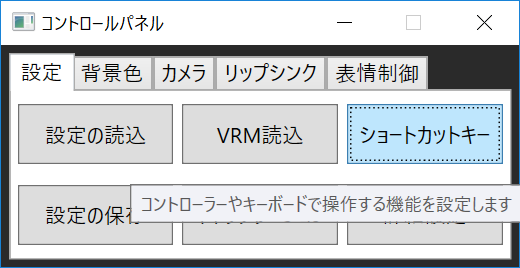

設定

バーチャルモーションキャプチャーを利用するためのシステム設定ができます。

設定の読込

設定ファイルを読み込みます。

この設定には、現在読み込んでいるVRMファイルも含みます。

設定の保存

設定ファイルを保存します。

また、バーチャルモーションキャプチャーに同梱されているdefault.jsonを上書きすると、次回起動時から自動で読み込まれます。

VRMの読込

モデルを読み込みます。

キャリブレーション

身体のキャリブレーションを行います。モデルを読み込むたび、必ず実行する必要があります。

モデルが読み込まれていない状態では実行できません。

ショートカットキー

ショートカットキーを設定します。

機能、表情、ハンドジェスチャーといった機能を割り当て、あるいはプリセットの選択を行います。

詳細設定

詳細設定を行います。

- 手の角度調整

- カメラ設定ファイル

- トラッカーやコントローラの割り当て

- 仮想Webカメラドライバのインストールと設定

- アイトラッキングの設定

- CameraPlus設定

- 外部モーション送信設定

- 言語設定

などが含まれます。

ステータスバー

バーチャルモーションキャプチャーの動作状態が表示されます。

エラーが発生した場合、ここに表示されます。

ダブルクリックすることで、クリップボードに詳細情報がコピーされます。

不具合発生時にはこちらを添付することをおすすめします。

VRM読込

VRM読み込み

モデルファイルを読み込みます。

VRM規格に基づいたライセンス情報が表示されます。

VRoid Hub

VRoid Hubからモデルを読み込みます。

なお、このボタンは使用できないビルドバージョンや、VMC Mod利用時などの利用できない状態では表示されません。

DMM VR Connect

DMM VR Connectからモデルを読み込みます。

なお、このボタンは使用できないビルドバージョンや、VMC Mod利用時などの利用できない状態では表示されません。

同意して読み込み

モデルの利用規約に同意し、モデルを読み込みます。

同意しない

キャンセルして戻ります。

VRoid Hub

VRoid Hubからモデルを読み込みます。

ブラウザ側でいいねをつけたものおよび、自分でアップロードしたモデルが一覧に表示されます。

公開モデルの場合はモデルの立ち絵表示の右にライセンス表示が出ます。

自分でアップロードしたモデルの場合はライセンス表示は出ません。

また、この画面の表示中に他のウィンドウを開くなどしてフォーカスを外した場合、リストを自動で再読み込みします。

その際、モデルの選択が外れることがあります。

VRoid Hubでモデルを探す

ブラウザでVRoid Hubのアプリ情報ページを開きます。

VRoid Hubで開く

ブラウザでVRoid Hubのモデル情報ページを開きます。

同意して読み込む

画面のライセンス表示に同意してモデルを読み込みます。

DMM VR Connect

DMM VR Connectからモデルを読み込みます。

ログインボタンを押すと、DMM VR Connectサイトで利用対象としたアバターが読み込まれます。

ショートカットキー設定画面

ショートカットキーを設定します。

キーボードやコントローラの入力に対して、以下の3種類の割り当てが設定できます。

- 機能ショートカットキー

- ハンドジェスチャー(Hand bones)

- 表情(BlendShape)

v0.38以降では、MIDIコントローラやMIDI鍵盤の入力(Note ON, CC)にも対応しています。

一覧

割り当てられているショートカットキーの一覧です。

項目をダブルクリックすると直接文字列として編集できます。

編集

選択したショートカットキーを編集します。

対応する設定画面が表示されます。

削除

選択したショートカットキーを削除します。

タッチパッド/スティックの割り当て状態

タッチパッド(Vive等)およびスティック(Oculus等)の反応の仕方を設定します。

- 分割数

タッチパッド/スティックの分割数を設定します。

- 左コントローラ・右コントローラ

つまみをドラッグすることで分割位置を微調整できます。

- センターキー

中心へのタッチを判定し、追加の機能に割り当てる領域とするかを設定できます。

適用ボタンで変更を適用します。

手の動きにSkeletalを使う

手の動きにSteam VR Skeletal Inputを使用するかどうかを選択します。

- Indexコントローラで指の操作を反映したい場合はオンにします。

- 従来のVRコントローラでは、一部の指の状態が反映されます。

この機能がオンの場合、ハンドジェスチャーは動かなくなることがあります。

(バージョンにより同時に動くこともありますが保証されません)

ハンドジェスチャー追加

新規にハンドジェスチャーを追加します。

表情追加

新規に表情を追加します。

機能追加

新規に機能ショートカットキーを追加します。

プリセットから選択

以下を選択できます。

- 全消去プリセット

- 既存アプリケーションと同等のプリセット

- 自分で登録したプリセット

カスタム名称・保存

現在のショートカットキーに名前を付けて保存します。

ショートカットキーは「設定の保存」で記録されますが、別の設定などにプリセットとして持ち込みたい場合に使用します。

ハンドジェスチャー設定

ハンドジェスチャーを設定します。

使用キー

空欄を選択し、キーボード、コントローラ、MIDIコントローラなどのボタンを押すと、キーが登録されます。

複数のキーを押すと、複数のキーが登録されます。

これにより、複数操作を同時に行った場合のみ適用するようにできます。

クリアボタンで登録キーを削除します。

角度制限

指の角度を制限します。

プリセットから選択

一般的によく使われる手の形状から選択できます。

カスタム名称

よく使う手の形状を保存します。

別の設定などにプリセットとして持ち込みたい場合に使用します。

登録

ショートカットキーを登録します。

その他の詳細はスクリーンショットをご確認ください。

表情コントロール設定

表情のコントロールを設定します。

複数のBlendShapeを組み合わせて追加することができます。

VRMの標準のBlendShapeだけではなく、UniVRMのBlendShapeEditorで追加したBlendShapeも登録することができます。

操作に関してはハンドジェスチャー設定および、スクリーンショットをご確認ください。

“BlendShape受信を無効にする”をオンにすると、その表情の設定中はVMCProtocolによって受け取った表情情報が反映されないようになります。

機能キー設定

バーチャルモーションキャプチャーの機能にショートカットキーを割り当てます。

- コントロールパネルの再表示

- 背景をGBに切替

- 背景をBBに切替

- 背景を白に切替

- 背景をカスタムに切替

- 背景を透過に切替

- フロントカメラに切替

- バックカメラに切替

- フリーカメラに切替

- 座標追従カメラに切替

が登録できます。

操作に関してはハンドジェスチャー設定および、スクリーンショットをご確認ください。

キャリブレーション

キャリブレーションを行います。

注意として

キャリブレーション方式の選択

3種類あります。

- 通常モード(自然に動くようにスケールを現実の身体に合わせて調整する)

- MR合成モード(スケールを現実の腕の長さに厳密に合わせる。現実に対し足が長いモデルの場合は床面を突き抜ける)

- MR合成モード(スケールを現実の腕の長さに厳密に合わせる。現実に対し足が長いモデルの場合は足を曲げて床に合わせる)

キャリブレーション

5秒後にキャリブレーションを行います。

なお、コントローラのトリガーでも同じ操作ができます。

詳細設定

手の角度調整

手の角度を調整します。

コントローラで持っている角度が通常の角度ではない場合や、アバターの腕がねじれてしまうときなどに使用します。

使用トラッカー設定

トラッカー割り当て設定画面を開きます。

3点トラッキングの場合を除き、多くの場合で設定することが強く推奨されます。

Virtual Motion Tracker (VMT)

MR合成用仮想トラッカーの設定をします。

詳細はLIVとVMTでVRゲーム内合成 をご参照ください。

VMTとの通信にはUDP/IP通信が使用されています。

仮想Webカメラ設定・解像度設定

LIV合成およびビデオ会議システムなどにアバターを出力するための仮想Webカメラの設定を行います。

詳細はスクリーンショットをご確認ください。

Eye Tracking

視線追従デバイス向けの設定画面を開きます。

Lip Tracking

唇追従デバイス向けの設定画面を開きます。

VMC Mod

拡張プラグインの設定画面を開きます。

使用言語

言語を選択します。

日本語、英語、中国語、韓国語に対応しています。

Camera Plus

Camera Plus向けの設定をImport, Exportします。

モーション送信(VMCProtocol)

外部アプリケーションにモーションなどの情報を送信します。

- OSCでモーション送信を有効にする: 送信機能の有効化をします

- Adress, Port: UDP/IP通信をするための接続情報(IPアドレス、ポート)を設定します

- 送信間隔: 送信頻度です。1=毎フレームで、2以上は送信間隔を落とします。0でその情報を送信しなくなります。

- Option: Option文字列です。外部アプリケーションの設定や識別に使用することがあります。

- デバイス探索要求への応答を許可: 外部デバイスからの探索信号を受け付けます。対応しているデバイスやアプリケーションの場合、接続情報の設定が自動で行われます。

上記の設定の一部は、適用ボタンを押すまで反映されません。

使用方法やプロトコルなどは、Virtual Motion Capture Protocol (VMCProtocol 公式ページ)を参照してください。

モーション受信(VMCProtocol)

外部アプリケーションから表情などの情報を受信します。

Check IPボタンで、PCに割り当てられているIPアドレスの一覧を表示することができます。

- OSCでモーション受信を有効にする: 受信機能の有効化をします。

- Port: UDP/IP通信の待ち受けポートを設定します。

- 自動でデバイス探索を行う: 外部デバイスの探索信号を繰り返し発信します。対応しているデバイスやアプリケーションの場合、相手側の接続情報の設定が自動で行われます。

- 手ボーン取得: 外部からのボーン情報のうち、手ボーンを反映します。(通常は反映しません)

上記の設定の一部は、適用ボタンを押すまで反映されません。

使用方法やプロトコルなどは、Virtual Motion Capture Protocol (VMCProtocol 公式ページ)を参照してください。

MIDI CC BlendShape割り当て

MIDIデバイスを使って表情などを制御することができます。

“MIDIデバイスを有効にする”をオンにすることで、現在オープン可能なMIDIデバイスをオープンします。

トラッキングロスト時の飛び軽減

トラッキングデバイスがベースステーションを見失うなどして、追跡できなくなった際に異常な動作をするのを軽減します。

オフにすると従来の動作に戻ります。(オフにすることは非推奨です)

モデル修正

モデルのボーン等の問題により正常に動作しない問題を修正するのを試みます。

トラッキングオプション

特殊な条件下でのトラッキングに関する設定です

- トラッキングを一時停止する: トラッキングを一時的に停止します。

- コントローラーをトラッカーとして扱う(特殊持ち対応): コントローラーをトラッカーとして認識させます。これにより、コントローラーの持ち方を前提とした補正が無効になります。コントローラーとは別デバイス扱いとなり自動認識は失敗するため、必ずトラッカー割り当て設定から「シリアル番号[Controller]」と書かれたトラッカーを手に割り当ててください。

描画品質

描画品質の設定です

externalcamera.cfg(フリーカメラ座標を設定)

MR合成用のカメラ位置ファイルを出力します。現在非推奨です。

Unityでトラッカーカメラを使用する際にも設定します。

以下の手順で利用します。

- 予めカメラからフリーカメラを選択し、カメラ位置として使用するトラッカーおよび仮想コントローラと位置を合わせておきます。

- コントローラ番号で対象のトラッカーあるいは仮想コントローラを選択します。

- externalcamera.cfgを出力で保存し、対象のソフトウェアに読み込ませます。

- externalcamera.cfgを開くでバーチャルモーションキャプチャー自体に読み込ませます。

詳細はMR合成用のexternalcamera.cfgの作成をご確認ください。

手の角度調整

手の角度を調整します。

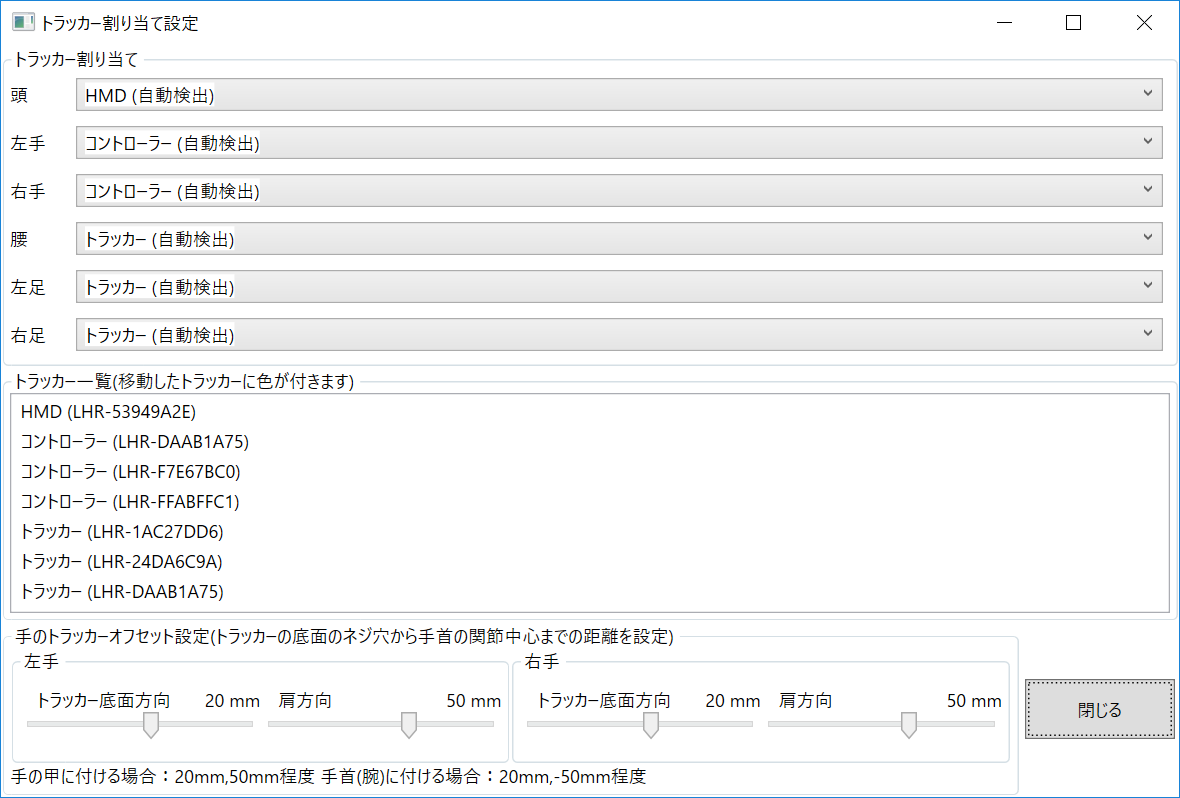

トラッカー割り当て設定

トラッキングデバイスの割り当ておよび認識状態、微調整を行います。

トラッカー割り当て

トラッキングデバイスの割り当てを設定します。

自動検出の場合、OpenVRの認識及びキャリブレーション時の位置で自動判別されます。

意図しない割り当てを防ぐため、

- 割り当てを希望する位置には固定割り当て(シリアル番号による割り当て)

- 希望しない位置は「割り当てしない(自動検出)」

にすることを推奨します。

トラッカー一覧

認識しているトラッキングデバイスが一覧として表示されます。

動かしたデバイスには色が付くため、どのデバイスがどのシリアル番号かを調べることができます。

手のトラッカーオフセット設定

手に割り当てたトラッカーの位置のオフセットを設定します。

手の実際の位置と、固定具のズレを補正します。

トラッカー底面のネジ穴の位置から、手首の関節中心までの距離を設定することで、手の動きがより自然になります。

調整の際、左右を同期するをオンにすると、左のオフセット調整が右に同じ値で反映されるようになります。

Tobii Eye Tracker 4C

アイトラッキングデバイスの設定をします。

詳細はスクリーンショットをご確認ください。

VIVE Pro Eye Droolon F1

アイトラッキングデバイスの設定をします。

詳細はスクリーンショットをご確認ください。

VIVE Lip Tracker

リップトラッキングデバイスの設定をします。

詳細はスクリーンショットをご確認ください。

ロード済みModリスト

ロード済みの拡張プラグインの一覧です。

Log

バーチャルモーションキャプチャー動作ログです。

主に拡張プラグイン開発者が、動作状況の確認や、不具合特定に使用します。

ファイルの読み書きや、キーボード操作も含めて表示されるため、取り扱いにはご注意ください。

Midi CC BelndShape Setting

表情とMIDI CCノブの割り当てを設定します。

背景色設定

モデル画面の背景色を設定します。

GB

RGB(0,255,0)にします。

BB

RGB(0,0,255)にします。

白240

目に優しいRGB(240,240,240)にします。

カスタム

カスタムカラーにします。

このボタンを右クリックするとカスタム背景色設定画面を開きます。

透過

ウィンドウを透過します。

この際、自動でウィンドウ枠の非表示が有効になります。

ウィンドウを常に手前に表示

ウィンドウを常に手前に表示します。

透過合成時に便利です。

ウィンドウ枠の非表示

ウィンドウの枠を非表示にします。

背景を透過させる場合は必須です。

リサイズができなくなります。

マウス操作を透過

モデル画面でマウスの操作を受け付けなくします。

透過表示と組み合わせ、コーディング作業配信などに便利です。

カスタム背景色設定

背景色を設定します。

カメラ設定

カメラ位置の設定および高解像度な写真の撮影をします。

操作は基本画面を参照してください。

フロント

モデルのルーム位置に関係なく、カメラを常にモデルの正面に追従させます。

常にモデルの正面が見えます。卓上実況向きです。

操作はズームのみできます。

バック

モデルのルーム位置に関係なく、カメラを常にモデルの背面に追従させます。

常にモデルの背面が見えます。MR合成非対応のVR実況向きです。

操作はズームのみできます。

フリー

カメラをルームスケールに配置します。モデルに追従しません。

MR合成や、一般的な撮影に使用します。

操作は絶対位置移動・ズーム・回転ができます。

座標追従

カメラをモデルの中心座標に追従させますが、回転に対して追従しません。

操作は相対位置移動・ズーム・回転ができます。

撮影ボタン(カメラマーク)

写真撮影画面を開きます。

高解像度の写真を撮影することができます。

ミラー

カメラを鏡像反転します。

グリッドの表示

カメラ構図(三分割法)の調整に便利なグリッドを表示します。

FOV

カメラのFOVを調整します。

一般的には25(標準)~100(広角)の間で使用されます。

FOVは大きいほど広い範囲が写り、遠近感が増し、魚眼になります。

小さいほど望遠になり、歪みが小さくなり、遠近感がなくなります。

Smooth

カメラの動きをなめらかにします。

写真撮影

モデル画面を撮影します。

単なるスクリーンショットではなく、高解像度なpng画像を撮影できます。

背景を透過するで、透過pngにすることができます。

なお、標準の7680px x 4320pxの撮影で1MBくらいのサイズになります。

リップシンク設定

リップシンクを設定します。

タブが赤色になっている場合、音声入力デバイスが選択されていないことを示します。

リップシンク

リップシンクの有効無効を設定します。

最大の音素のみ

検出される音素のうち、もっとも大きいものだけ反映することでアニメ的な口の動きを実現します。

オフにした場合、現実の音素に合わせて細かく口が動きます。

最大音素の強調

検出される音素を強調し、アニメ的な口の動きを実現します。

オフにした場合、はっきりと発声しないと口が大きく動かなくなります。

使用するデバイス

音声入力デバイスを選択します。更新ボタンで一覧を更新します。

ゲイン(感度)

音声入力の感度を調整します。既定で100.0です。

音素の最小

小さすぎる音素をカットオフして表情に反映しない閾値を設定します。

ノイズや込み入った音の際に無駄に口が動くのを防止します。

表情制御設定

瞬きなど、自動で動作する表情の設定を行います。

自動瞬き

自動でまばたきをするかどうかを選択します。

デフォルトの表情

特に表情ショートカットキーが押されていないときの表情を設定します。

次の瞬きまで(秒)

瞬きの感覚を設定します。

機械的な感覚を与えないよう、ランダムさをもたせているため範囲で設定します。

アニメーション時間(秒)

まばたきの際の瞼の動きを設定します。

見た目(環境・照明)設定

DirectionalLight(平行光源)の設定をします。

照明角度

DirectionalLight(平行光源)の角度を設定します。

照明色

照明カスタムカラー設定画面を開きます。

Advanced Graphics Option

高度な画質設定画面を開きます。

照明カスタムカラー設定

DirectionalLight(平行光源)の色を設定します。

Graphics Option

ポストプロセッシング、環境光のオフなどを設定します。

ブルーム、ボケ、色調・色温度、ビネット、にじみなど。

ヘルプ

説明です。

以上

]]>