👏 欢迎通过我们的  Modelscope在线Demo 或

Modelscope在线Demo 或  百炼在线Demo 试用 Mobile-Agent-v3.5!

百炼在线Demo 试用 Mobile-Agent-v3.5!

❗️我们在百炼上提供 Mobile-Agent-v3.5 API,方便快速体验。请查看文档。

🤗 GUI-Owl-1.5 Collection|

GUI-Owl-1.5 Collection

GUI-Owl-1.5 Collection

🤗 GUI-Owl-32B |

GUI-Owl-32B |

🤗 GUI-Owl-7B |

GUI-Owl-32B |

🤗 GUI-Owl-7B |

GUI-Owl-7B

GUI-Owl-7B

[2026.3.31]🔥🔥 Mobile-Agent-v3.5现已在阿里云无影云手机上线——这是一个基于云端的安卓环境,可提供无缝的移动使用体验。了解更多Alibaba Cloud Wuying Cloud Phone | Documentation[2026.3.19]🔥🔥 GUI-Owl-1.5 系列模型现已上线阿里云百炼平台,可供在线推理。请参考 阿里云百炼,

阿里云百炼, 魔搭API-Inference。

魔搭API-Inference。[2026.2.14]🔥 GUI-Owl-1.5 正式发布,这是一个全新的原生多平台 GUI 代理基础模型系列(2B/4B/8B/32B/235B;指令与思考)。该新一代原生 GUI 代理模型系列基于 Qwen3-VL 构建,支持桌面/移动/浏览器自动化,并在 20 多个 GUI 基准测试中取得了SOTA 性能,在端到端任务、接地、工具/MCP 调用和长时域记忆方面均表现出色。模型权重可在 HuggingFace 获取。技术报告可在 链接 获取。详情请参阅 GUI-Owl 1.5 README。[2025.11.25]GUI-Owl系列模型现已支持在线推理,感谢阿里云百炼提供的算力支持。详情请见链接。[2025.10.30]我们发布了 OSWorld-MCP,这是一个用于评估模型上下文协议 (MCP) 工具在实际场景中调用能力的基准测试工具。请参阅链接。[2025.9.24]我们在 ModelScope 上发布了基于无影云电脑和云手机的 demo。无需本地部署模型或准备设备,只需输入指令即可体验 Mobile-Agent-v3! ModelScope Demo 链接 和

ModelScope Demo 链接 和  百炼 Demo 链接。限时免费的 Mobile-Agent-v3 API请查看文档。基于Qwen-3-VL的新版本即将到来。

百炼 Demo 链接。限时免费的 Mobile-Agent-v3 API请查看文档。基于Qwen-3-VL的新版本即将到来。[2025.9.19]GUI-Critic-R1 已被 第三十九届神经信息处理系统年会 (NeurIPS 2025) 接收。我们发布了最新成果 UI-S1:通过半在线强化学习推进 GUI 自动化。论文、代码 和 模型 现已开源。[2025.9.16]我们发布了最新成果 UI-S1:通过半在线强化学习推进 GUI 自动化。论文(https://www.arxiv.org/abs/2509.11543)、代码(https://github.com/X-PLUG/MobileAgent/tree/main/UI-S1)、数据集(https://huggingface.co/datasets/mPLUG/UI_S1_dataset)和模型(https://huggingface.co/mPLUG/UI-S1-7B)现已开源。[2025.9.16]我们在 OSWorld、AndroidWorld 和实际移动场景中开源了 GUI-Owl 和 Mobile-Agent-v3 的代码。请参阅 OSWorld 代码。GUI-Owl 的 OSWorld 强化学习 checkpoint 也已发布。请参阅 AndroidWorld 代码 和 真实场景代码。[2025.8.20]全新 GUI-Owl 和 Mobile-Agent-v3 正式发布!技术报告可在此处查看(https://arxiv.org/abs/2508.15144)。模型检查点将在 GUI-Owl-7B 和 GUI-Owl-32B 上发布。- GUI-Owl 是一个多模态跨平台 GUI 虚拟层模型 (VLM),具备 GUI 感知、落地和端到端操作能力。

- Mobile-Agent-v3 是一个基于 GUI-Owl 的跨平台多智能体框架,提供规划、进度管理、反射和内存管理等功能。

[2025.8.14]Mobile-Agent-v3 在第二十四届全国计算语言学大会 (CCL 2025) 上荣获 最佳演示奖。[2025.3.17]PC-Agent 已被 ICLR 2025 研讨会 接收。[2024.9.26]Mobile-Agent-v2 已被 第三十八届神经信息处理系统年会 (NeurIPS 2024) 接收。[2024.7.29]Mobile-Agent 在第二十三届全国计算语言学大会 (CCL 2024) 上荣获 最佳演示奖。[2024.3.10]Mobile-Agent 已被 ICLR 2024 研讨会 录用。

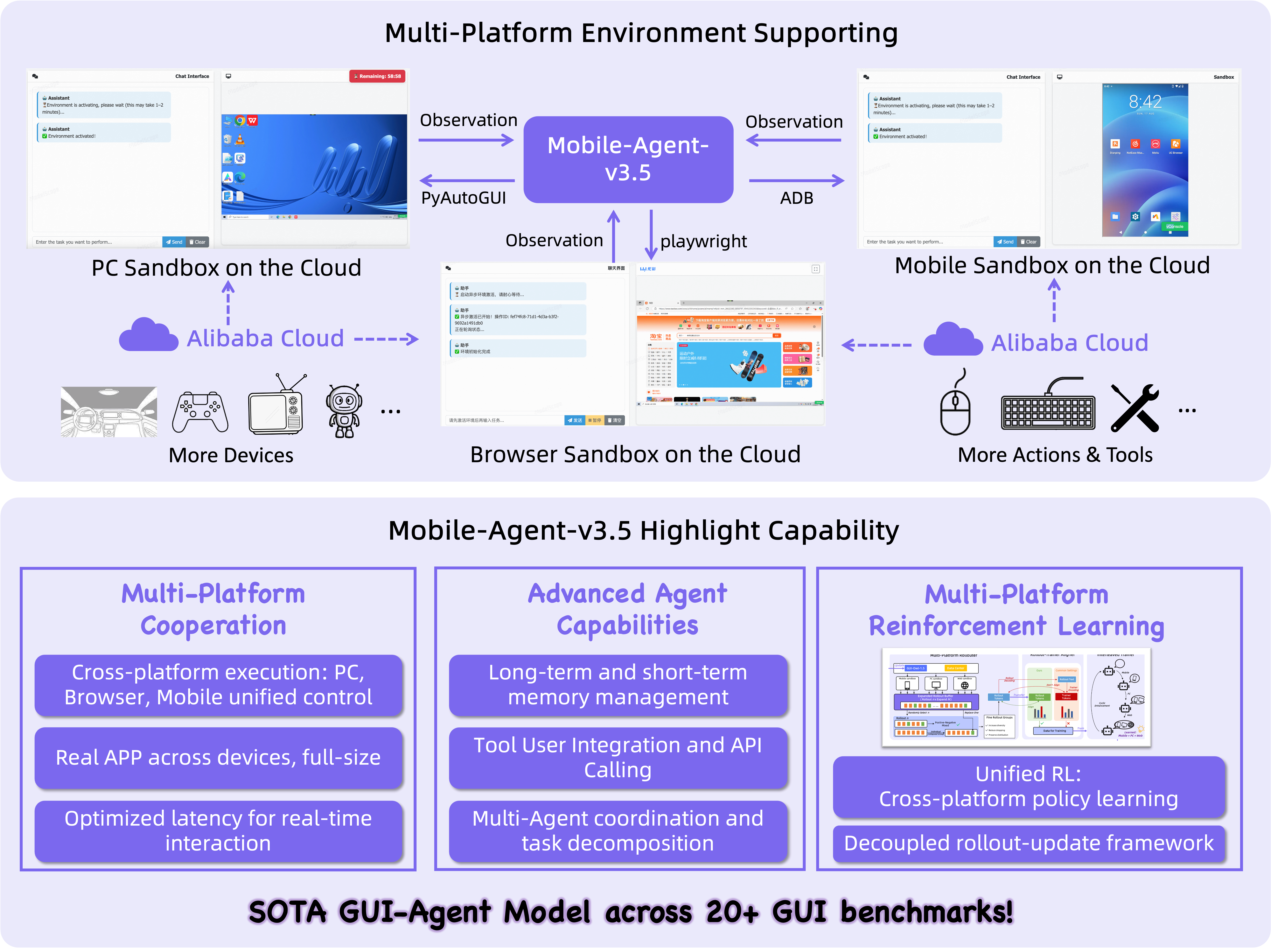

- Mobile-Agent-v3.5 (预印本): 多平台统一 GUI 代理。[论文] [代码]

- Mobile-Agent-v3 (预印本): 多模态、多平台 GUI 代理。[论文] [代码]

- UI-S1 (预印本): 通过半在线强化学习推进 GUI 自动化。 [论文] [代码]

- GUI-Critic-R1 (NeurIPS 2025): 一种事前错误诊断方法的 GUI-Critic。 [论文] [代码]

- PC-Agent (ICLR 2025 研讨会): 用于多模态 PC 操作的多智能体。 [论文] [代码]

- Mobile-Agent-E (预印本): 用于自进化手机操作的多智能体。 [论文] [代码]

- Mobile-Agent-v2 (NeurIPS 2024):用于多模式手机操作的多智能体。 [论文] [代码]

- Mobile-Agent-v1 (ICLR 2024 Workshop): 单代理用于多模态手机操作。[论文] [代码]

如果您发现 Mobile-Agent 对您的研究和应用有用,请使用此 BibTeX 进行引用:

@article{xu2026mobile,

title={Mobile-Agent-v3. 5: Multi-platform Fundamental GUI Agents},

author={Xu, Haiyang and Zhang, Xi and Liu, Haowei and Wang, Junyang and Zhu, Zhaozai and Zhou, Shengjie and Hu, Xuhao and Gao, Feiyu and Cao, Junjie and Wang, Zihua and others},

journal={arXiv preprint arXiv:2602.16855},

year={2026}

}

@article{ye2025mobile,

title={Mobile-Agent-v3: Foundamental Agents for GUI Automation},

author={Ye, Jiabo and Zhang, Xi and Xu, Haiyang and Liu, Haowei and Wang, Junyang and Zhu, Zhaoqing and Zheng, Ziwei and Gao, Feiyu and Cao, Junjie and Lu, Zhengxi and others},

journal={arXiv preprint arXiv:2508.15144},

year={2025}

}

@article{lu2025ui,

title={UI-S1: Advancing GUI Automation via Semi-online Reinforcement Learning},

author={Lu, Zhengxi and Ye, Jiabo and Tang, Fei and Shen, Yongliang and Xu, Haiyang and Zheng, Ziwei and Lu, Weiming and Yan, Ming and Huang, Fei and Xiao, Jun and others},

journal={arXiv preprint arXiv:2509.11543},

year={2025}

}

@article{wanyan2025look,

title={Look Before You Leap: A GUI-Critic-R1 Model for Pre-Operative Error Diagnosis in GUI Automation},

author={Wanyan, Yuyang and Zhang, Xi and Xu, Haiyang and Liu, Haowei and Wang, Junyang and Ye, Jiabo and Kou, Yutong and Yan, Ming and Huang, Fei and Yang, Xiaoshan and others},

journal={arXiv preprint arXiv:2506.04614},

year={2025}

}

@article{liu2025pc,

title={PC-Agent: A Hierarchical Multi-Agent Collaboration Framework for Complex Task Automation on PC},

author={Liu, Haowei and Zhang, Xi and Xu, Haiyang and Wanyan, Yuyang and Wang, Junyang and Yan, Ming and Zhang, Ji and Yuan, Chunfeng and Xu, Changsheng and Hu, Weiming and Huang, Fei},

journal={arXiv preprint arXiv:2502.14282},

year={2025}

}

@article{wang2025mobile,

title={Mobile-Agent-E: Self-Evolving Mobile Assistant for Complex Tasks},

author={Wang, Zhenhailong and Xu, Haiyang and Wang, Junyang and Zhang, Xi and Yan, Ming and Zhang, Ji and Huang, Fei and Ji, Heng},

journal={arXiv preprint arXiv:2501.11733},

year={2025}

}

@article{wang2024mobile2,

title={Mobile-Agent-v2: Mobile Device Operation Assistant with Effective Navigation via Multi-Agent Collaboration},

author={Wang, Junyang and Xu, Haiyang and Jia, Haitao and Zhang, Xi and Yan, Ming and Shen, Weizhou and Zhang, Ji and Huang, Fei and Sang, Jitao},

journal={arXiv preprint arXiv:2406.01014},

year={2024}

}

@article{wang2024mobile,

title={Mobile-Agent: Autonomous Multi-Modal Mobile Device Agent with Visual Perception},

author={Wang, Junyang and Xu, Haiyang and Ye, Jiabo and Yan, Ming and Shen, Weizhou and Zhang, Ji and Huang, Fei and Sang, Jitao},

journal={arXiv preprint arXiv:2401.16158},

year={2024}

}